最近,一篇名为《Attention Residuals》的论文让Kimi成为了全球人工智能界的焦点。作者之一是一名仅17岁的高中生。xAI首席执行官埃隆·马斯克和Google的Shubham Saboo也分别对此表示祝贺,后者更是指出,Kimi触及了长达十年无人问津的Transformer架构领域。

这项成果迅速在舆论界引起了巨大反响,诸如“打破Transformer架构”、“硅谷震动”、“行业规则被改写”等标题充斥着各大新闻头条。

本文的核心观点是:尽管这一研究展示了天才般的创新思维和扎实的技术基础,它并未脱离Transformer架构的核心框架。那些夸张的标签大多来源于营销号,缺乏实际证据支持。

实际上,对残差连接的改进并非首次。从2022年的DeepNorm到2024年的DenseFormer,优化深层神经网络的残差连接一直是业界关注的焦点。Kimi团队虽然不是这一技术路线的开创者,但他们的解决方案在激进性、优雅性和工程潜力方面都有独到之处。

01

深层Transformer的固有问题

在规模化的趋势下,提升模型性能越来越依赖于参数和规模的增长,这导致神经网络的层数不断增加。然而,研究团队观察到一个关键现象:数据在神经网络层之间传输时,存在“PreNorm稀释问题”。作为一种归一化技术,PreNorm因其能有效稳定训练和加速收敛,已成为现代架构的主流选择。

为了更直观地理解,可以将一个大型模型比作由一百名程序员组成的流水线,每位程序员对应一层神经网络,共同完成一个大型软件项目。

在传统的标准残差连接模式下,层与层之间的状态更新遵循如下公式:

当前层的输出等于上一层的输出加上该层自身的“修改部分”(即变换函数的输出)。类比来说,每位程序员接收前一位的代码,添加自己的修改后,再传递给下一位。

这种简单的累加方式在实践中会引发一系列问题。从数学角度来看,它会导致两个相关的问题:

一是早期信息被逐渐稀释和掩盖。首层神经网络提取的初始特征(例如token的初始语义)在经过数十层累加后,其相对权重逐渐被削弱,难以辨认。流水线末端的程序员很难了解源头的底层逻辑。模型越深入,早期特征的精确检索和利用就越困难。

二是数值尺度膨胀与梯度不平衡。残差的持续累加,类似于代码库的不断膨胀。后期加入的程序员若想让自己的修改产生显著影响,不得不添加更多的代码。对应到网络,深层必须输出数值规模更大的信号才能在累加中占据一席之地。这在正向传播中或许还能容忍,但在反向传播中则会产生问题:浅层梯度可能剧烈震荡,而深层梯度则趋于微小,整个网络的梯度分布极度不均,训练过程极易失稳。

因此,研究的关键问题在于:如何让网络最深层的“程序员”依然能够清晰地识别并利用首位“程序员”编写的初始代码?

02

时间维度与深度维度的对应关系

Kimi团队的核心洞察在于,他们发现神经网络发展史中,时间序列处理和网络深度构建之间存在某种对应关系。

Transformer并非神经网络的最早形式。大约在2018年前,循环神经网络(RNN)占据主导地位。RNN以时间序列的方式逐词处理文本,将历史信息压缩为单一隐藏状态向后传递。这导致后序单元只能接收一个混合了过往信息的“压缩包”,早期输入极易被遗忘——这一过程,与标准残差连接的信息传递方式非常相似。

Transformer通过注意力机制颠覆了这一范式。在自回归解码中,每一位置的词元都能直接“回望”序列中所有前置词元,并通过加权聚焦关键信息。在时间维度上,注意力机制完美解决了信息压缩和遗忘的问题。

这促使了一个自然的类比:能否在网络深度维度上,摒弃残差连接的“RNN式思维”,转而采用注意力机制?

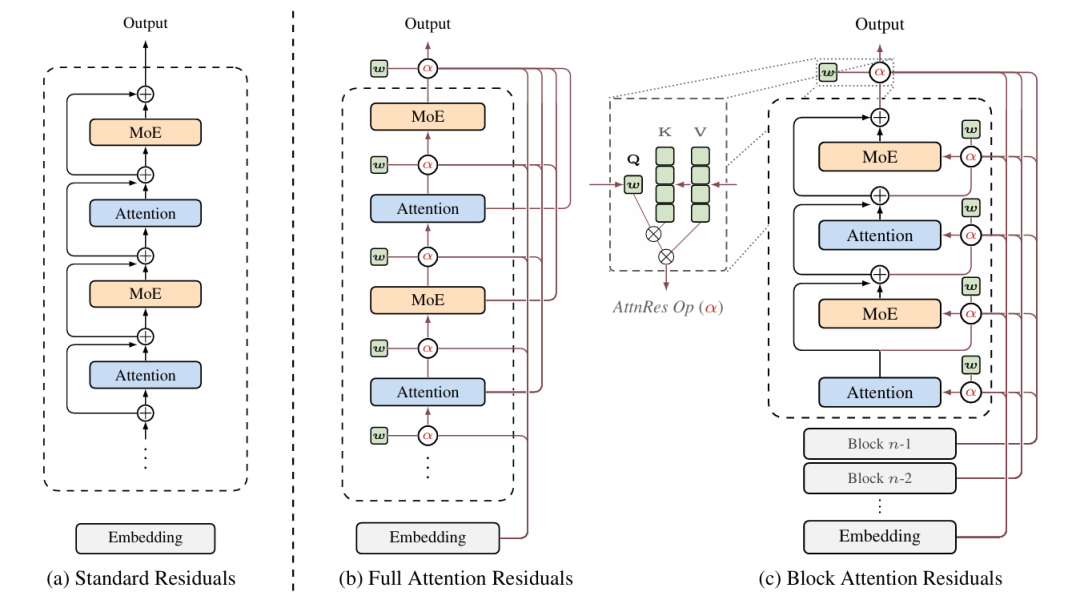

这正是Kimi论文的核心创新——注意力残差(Attention Residuals, AttnRes)。传统残差累加公式被重塑为一个基于Softmax的注意力加权形式:

新公式不再简单相加浅层输出,而是为每一层配备一个“伪查询向量”,使其能够动态扫描之前所有层的输出,并为包含关键信息的层赋予极高的Softmax权重。无关信息层的权重则被压至接近零。

这种内容感知、输入依赖的选择机制,本质上是将Transformer的核心理念横向迁移至残差路径的设计中。残差连接由此从被动的“信息搬运”转变为积极的“按需检索”,有效解决了深层信息稀释的问题。

03

理论构想到实际工程的转变

若仅止于此,注意力残差可能仍局限于实验室的理想设想。真实的大型模型工程实践,尤其是在面对千亿参数和分布式训练的严苛环境中,直接应用该机制将面临显存和通信的“爆炸”。

在分布式训练广泛采用激活重算、流水线并行等技术的前提下,若强行实现跨层全连接,深层网络将不得不跨物理GPU节点获取所有浅层完整的输出张量。随着层数L的增加,跨阶段数据传输量和显存占用将以O(Ld)的规模急剧膨胀,对算力集群构成巨大负担。

因此,Kimi团队为解决工程落地而提出的分块注意力残差,展现出了极高的实用智慧。

为了将理论转化为实践,Kimi团队设计了一套精妙的降维方案:

核心思想是“分块降维”。

回到程序员流水线的比喻:要求末位程序员理解每一位前序同事的具体贡献,意味着每位前序程序员都需保留完整的“草稿箱”——这在物理空间上是不可行的。解决方案是,将程序员分为N个部门。部门内部采用标准残差,将多层的输出压缩成一个单一的“块级表征”。部门之间则启用注意力残差机制,只需关注这N个块级表征,而无需追溯每个具体层级的输出。

这一简单而大胆的策略,直接将显存和通信的复杂度从O(Ld)降至O(Nd),为理论落地扫清了最大障碍。

其次,训练阶段的跨阶段缓存设计进一步优化了通信开销。在主流的交错式流水线并行训练中,缓存机制大大减少了数据传输的次数。

Kimi团队将这套架构部署到一个参数规模为48B(激活3B)的小型MoE模型,并使用高达1.4万亿token的数据进行预训练。

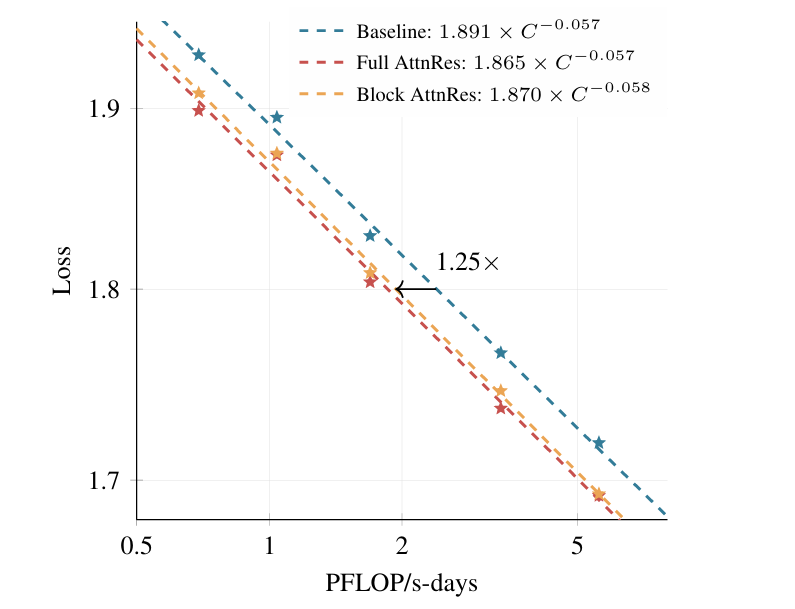

规模化法则曲线显示:在同等算力投入下,应用Block AttnRes的模型始终获得更低的损失值。简单换算,该架构使模型能达到传统基线模型需耗费1.25倍算力才能实现的性能。对于预训练阶段动辄耗资数千万美元的项目而言,“白嫖”25%的算力增益,蕴含着巨大的商业价值。

04

实证效果与产业意义

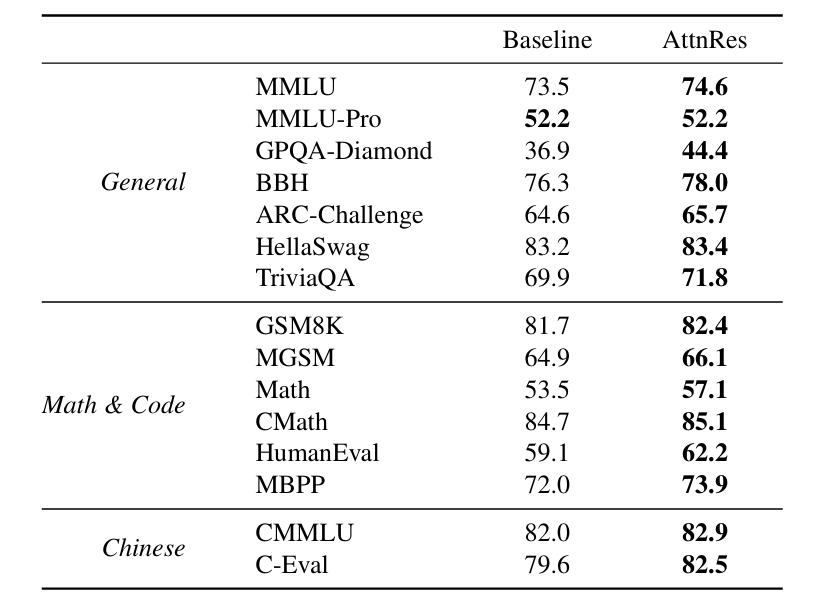

在下游能力测试中,需要多步骤逻辑推理的任务获益最为显著:

GPQA-Diamond提升7.5%,Math提升3.6%,HumanEval提升3.1%。这一结果在逻辑上高度自洽:数学推导与代码生成均要求模型具备长时间推理与信息保持能力,AttnRes的深度检索机制恰好契合了这种需求。

月之暗面创始人杨植麟在2026年英伟达GTC大会上的演讲,也从侧面印证了这套架构的价值:“要推动大模型智能上限的持续突破,必须对优化器、注意力机制和残差连接等底层基石进行重构。”

当然,这项技术距离真正颠覆Transformer架构或改写行业规则,尚有显著距离。核心工程代码尚未完全开源,公开仓库中仅提供伪代码级别的演示。同时,论文中亮眼的实验结果全部出自月之暗面自有的模型结构与私有数据。注意力残差能否在其他主流大模型上复现出稳定且显著的收益,仍有待第三方独立验证。

客观而言,深度学习领域对底层机制的启发式修改尝试并不罕见。但这篇论文能获得马斯克的“光速”点赞,本身就说明了它的分量。

最准确的评价或许是:这是一个兼具学术美学与工程实用性的残差机制新设计,值得全行业深入跟踪。它并非推翻Transformer的神话,而是为这座大厦添上了一块关键的砖石。

而月之暗面借此向世界展示了:在底层架构创新的“深水区”,中国AI企业同样有能力交出极具技术含量、堪称世界级水准的答卷。

最准确的论断或许是:这是一个兼顾了学术美学与工程实用性、值得全行业深入跟踪的残差机制新设计。它并非推翻Transformer的神话,而是为这座大厦添上了一块关键的砖石。

而月之暗面借此向世界展示:在底层架构创新的“深水区”,中国AI企业同样有能力交出极具技术含量、堪称世界级水准的答卷。