新智元报道

未来某一天,AI智能体是否能够自主调整参数、修复错误呢?

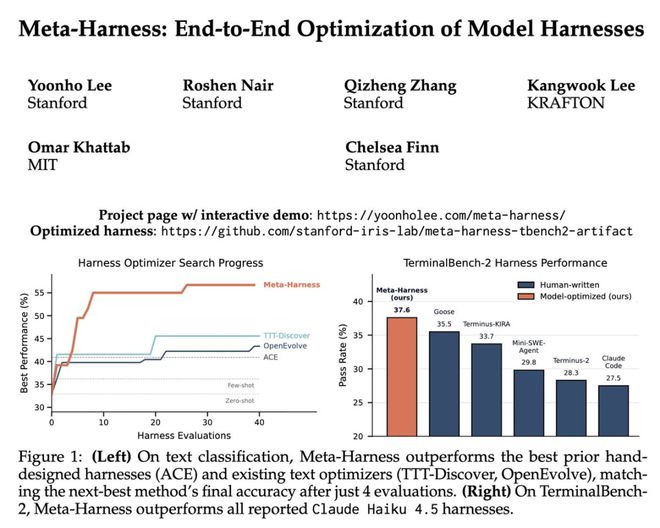

最近,斯坦福大学IRIS实验室的博士生Yoonho Lee与麻省理工学院和威斯康星大学的研究人员合作发表了一篇新论文,颠覆了传统的人工调优方法。

该研究团队阵容强大,包括机器人学习领域的知名学者Chelsea Finn以及DSPy框架的主要作者Omar Khattab。

过去的优化工作多集中在模型参数、训练数据和RLHF上。然而,Meta-Harness项目选择了一条不同的路径:它聚焦于支撑AI运行的基础架构层面进行改进。

以往这些基础架构调整都是由人工完成的。而现在,Meta-Harness使AI能够自动执行这一任务。

实验结果显示,Claude Haiku 4.5的成功率达到37.6%,位居所有Haiku智能体之首;而Claude Opus 4.6则达到了惊人的76.4%,仅次于ForgeCode的81.8%。

模型性能不仅取决于其本身的质量,还依赖于运行它的环境配置。

这个环境包括系统提示词、工具定义、重试逻辑、上下文管理等多个方面。

事实上,模型就像大脑一样提供了智能,而harness则是让这个大脑真正发挥功能的躯体。

2026年,这一概念突然成为热点话题。人们开始意识到,不同的运行环境配置可以使同一模型表现出截然不同的性能水平。

工程师Can Bölük在二月份进行了一项实验。

他仅通过改变编辑格式而不修改模型本身的情况下,提升了15个大型语言模型的编码性能,并减少了约20%的输出token数量。

更令人惊讶的是,GPT-4 Turbo仅仅更换了一种新的编辑格式,就将准确率从26%提升到了59%,提高了两倍多。

同样的模型在不同运行环境下的性能差异可以达到一倍以上,唯一的变量就是harness的配置。

将智能体定义为“模型+Harness”已经成为当前最热门的趋势。

模型提供了核心智力支持,而harness则决定了这些智力能否转化为实际应用价值。

如今,Claude Code和Codex等项目都在致力于通过精心设计的harness来弥补模型自身的不足之处。

然而,当前的harness工程仍然高度依赖于人工操作。

工程师们需要手动编写提示词、调整工具接口参数,并制定重试策略。接着进行测试、查看日志以诊断问题所在并修改代码再次测试。

这一过程不仅耗时且费力,许多失败模式甚至难以由人工直接识别和解决。

Meta-Harness的目标就是将这个循环自动化处理。

该技术可以让AI在400倍的信息量下自我复盘并进行迭代优化。

Meta-Harness尝试让优化器能够获取更多上下文信息,这一做法虽看似简单,但实际上解决了过去所有方法的瓶颈问题。

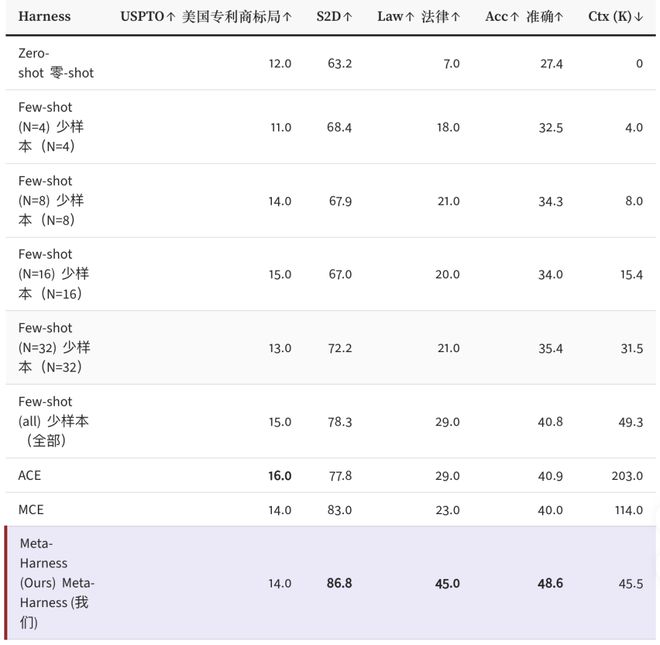

对比表格展示了主流文本每一步能看到多少上下文:

Meta-Harness与传统优化方法相比,在观察量上有着显著的不同。

Self-Refine仅关注最近一次输出及其自我评估结果(约1000 token);

OPRO则回顾了几轮方案和评分,大约为2000 token;

先进的方法如TextGrad、AlphaEvolve以及GEPA等能够访问8000到26000个token。

而Meta-Harness能够观察高达1000万token的信息,差距达到了400倍之多。

为何需要如此大量的信息?因为harness工程中产生的失败模式通常隐藏在执行过程的细节之中。

比如一个任务失败的原因可能是在前几步中的某个工具调用返回了截断的结果导致后续推理出现问题。

如果优化器只能接收到单一的“失败”分数或者简化的摘要信息,它很难定位到具体的问题所在。

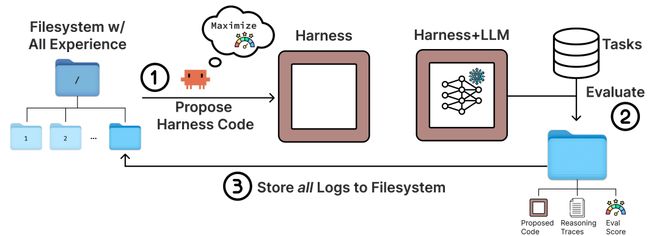

Meta-Harness为优化过程提供了一个完整的文件系统环境。

文件系统内包含了所有候选harness的历史源代码、执行轨迹日志、错误记录以及超时行为等详细数据。

通过标准工具如grep和cat,proposer可以自由地访问这些历史信息进行分析与调试。

这一过程不再是一个简单的提示响应机制,而是涉及到了信息检索、历史浏览和代码编辑等多个层面的操作。

使用Claude Code的proposer能够自主决定需要查看的内容,并自行调整优化策略。

整个搜索循环很直白:

- Proposer从文件系统中读取过往的历史记录

- 针对上述问题,Proposer会设计出新的修复方案

- 在文本分类场景中,研究者使用了三个不同的数据集进行测试,并且实验结果表明Meta-Harness的优化方法超越了现有的最先进方法ACE,达到了更高的准确率和更低的成本。

- 直接对比实验进一步证明,Meta-Harness仅需十分之一的评估次数即可达到与现有最佳方案相当的效果,并且还具有10个百分点以上的性能提升。

循环继续

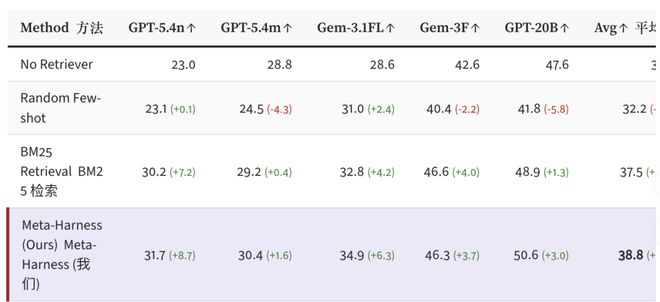

在数学推理任务中,研究团队探索了一套检索增强的推理策略,并通过250道题目进行进化训练,在额外的IMO级别测试集上验证其效果。

生成的单一检索harness在未见过的新模型上平均提升了4.7个百分点的准确率(从34.1%到38.8%)。

Meta-Harness所发现的技术具有良好的跨模型迁移能力,表明它不仅仅针对特定模型有效,而是具备广泛适用性的策略改进方法。

随着模型之间的性能差距逐渐缩小,优化harness本身已成为提升系统智能的关键因素之一。

同一模型在不同环境下的表现差异可以达到两倍以上,因此如何高效地配置和调整运行环境成为了新的研究焦点。

然而目前的harness工程仍然高度依赖于人工经验,缺乏系统的理论支持以及自动化工具的支持。

模型为AI系统提供了智力基础,而harness则是放大这种智力的关键因素。现在我们已经能够将优化harness的任务也交给AI来完成。

这一突破标志着LLM应用开发进入到了一个新的阶段,预示着未来的发展趋势和方向。

Meta-Harness分了三个场景做了测试:文本分类、数学推理、代码代理。

代码代理用的基准是TerminalBench-2,它包含89个Docker化任务,覆盖代码翻译、分布式机器学习配置、系统编程、生物信息学、密码分析等领域。

每个任务都是二元评分,跑5次取平均,难度相当高。

因为它们需要长程自主执行、处理复杂依赖、应对截断的终端输出,还得有相当的领域知识。

这个基准被几乎所有主流前沿实验室用来衡量代码代理的实际能力,是继SWE-bench之后又一个被广泛认可的「真实工作」测试集。

Meta-Harness的做法是优化完整的编码harness,包括系统提示词、工具定义、完成检测逻辑、上下文管理,全部都在优化范围内。

Proposer会读取每个任务的执行轨迹,诊断失败模式,然后提出针对性修复。

结果,Claude Haiku 4.5的成功率达到37.6%,在所有Haiku 4.5代理中排名第一,超过第二名Goose的35.5%

Claude Opus 4.6的成功率高达76.4%,在所有Opus 4.6代理中排名第二,仅次于ForgeCode的81.8%

需要强调的是,Haiku是Claude系列里最轻量的版本,参数量远小于Opus。

传统思路下,小模型就是不如大模型,性能天花板是硬伤。

但Meta-Harness证明,通过优化harness,小模型的天花板可以被显著抬高。

Meta-Harness 端到端优化结果总结。(左)在文本分类任务上,Meta-Harness 以极少的评估次数就超越了 ACE、OpenEvolve 等先前方法;(右)在 TerminalBench-2 基准上,Meta-Harness 优化的 Claude Haiku 4.5 harness 达到 37.6% 通过率,超越所有已报道的 Haiku 4.5 harness(包括 Goose 35.5% 和 Terminus-KIRA 33.7%),实现小模型登顶。

不止代码:文本分类和数学推理同样有效

Meta-Harness不只在代码任务上管用。

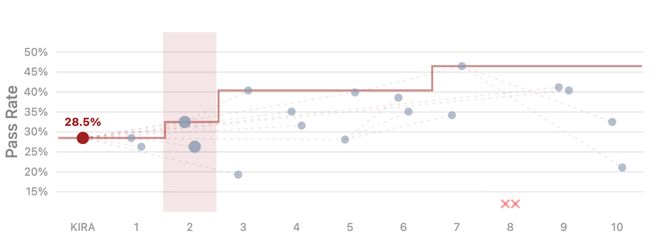

在文本分类场景下,研究者用了三个数据集:LawBench(215个类别)、Symptom2Disease(22个类别)、USPTO-50k(180个类别),模型是GPT-OSS-120B。

跑了20轮进化迭代,每轮2个候选,总共产出40个候选harness。

最佳发现的harness在测试集上达到48.6%准确率,比之前的SOTA方法ACE高出7.7个百分点。

甚至它的成本更低——Meta-Harness只用了45.5K上下文token,而ACE用了203K。

Meta-Harness 在文本分类任务上的表现。

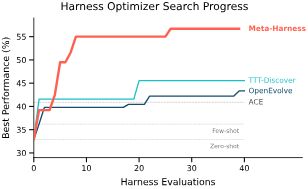

研究者还做了直接对比实验,把Meta-Harness和两个代表性的程序搜索方法放在一起,给同样的proposer和评估预算。

结果是,Meta-Harness用十分之一的评估次数就追平了它们的最终准确率,而最终准确率还比它们高出10个百分点以上。

Harness Optimizer 搜索进度对比。Meta-Harness(红色曲线)在极少的 Harness Evaluations 下快速达到最高性能,显著优于 OpenEvolve、TTTDiscover、ACE 等方法,展现了完整执行轨迹带来的效率优势。

原因就是OpenEvolve和PUCT都把历史压缩成固定的prompt格式,丢掉了执行轨迹。Meta-Harness保留了一切。

在数学推理场景下,Meta-Harness搜索的是检索增强的推理策略。

语料库里有超过50万道题,来自8个开源数据集。

研究者在250道题的搜索集上进化出一个检索harness,然后在200道IMO级别的题目上测试,还额外用了5个搜索时从未见过的模型。

单一发现的检索harness在5个新模型上平均提升了4.7个百分点(从34.1%到38.8%),而且是在模型不变的情况下。

Meta-Harness 检索策略的跨模型迁移能力。

这说明Meta-Harness发现的策略是可迁移的,不是只对特定模型有效的过拟合技巧。

模型能力的竞争正在进入一个新阶段。

过去几年,前沿实验室比的是谁的模型更强、参数更多、训练数据更大、benchmark分数更高。

但现在,GPT-5、Claude 4、Gemini 3在很多任务上已经拉不开太大差距。

真正的差距在哪里?在harness。

同一个模型,配上不同的harness,性能可以差一倍。

而harness工程目前还高度依赖人工经验,没有系统化的方法论,也没有自动化的工具。

模型是智能的来源,harness是智能的放大器,而现在,优化harness本身也可以交给AI来做。

这可能是LLM应用开发进入下一阶段的标志。

参考资料:

https://x.com/yoonholeee/status/2038640635482456118