报!龙虾更新了!

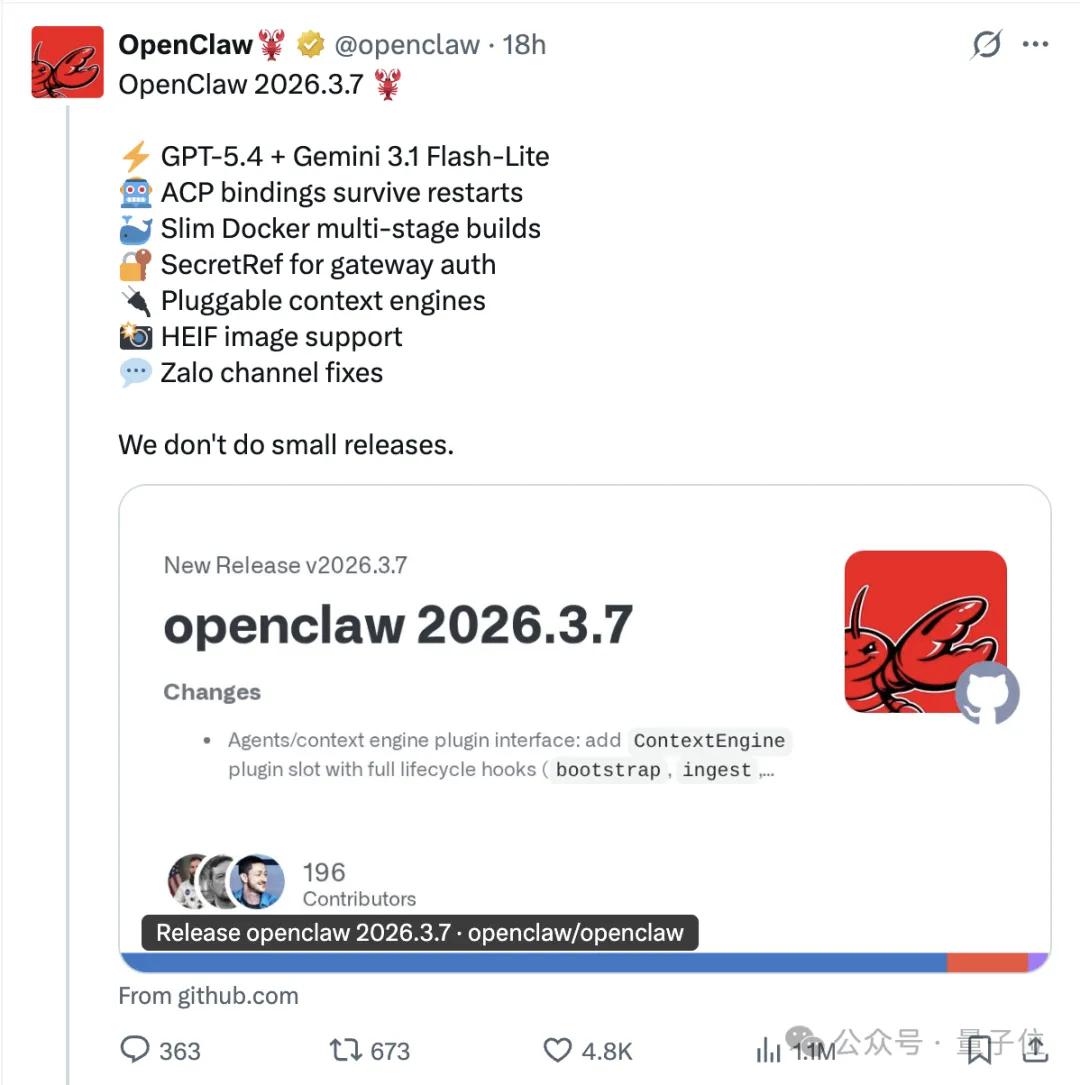

最近,新的OpenClaw测试版(版本号为2026.3.7)已经迅速上线,并包含了最新的GPT-5.4和Gemini Flash 3.1模型。

此次更新还带来了以下改进:

- 在重启后,ACP绑定依然能够保留。

- 精简版Docker支持多阶段构建。

- 新增了用于网关认证的SecretRef功能。

- 可插拔的上下文引擎

- 支持HEIF图像格式

- 修复Zalo渠道问题

其中最受关注的是可插拔上下文引擎(pluggable context engine)的功能更新。许多用户对此表示赞赏,认为相较于模型本身,上下文管理才是关键所在。

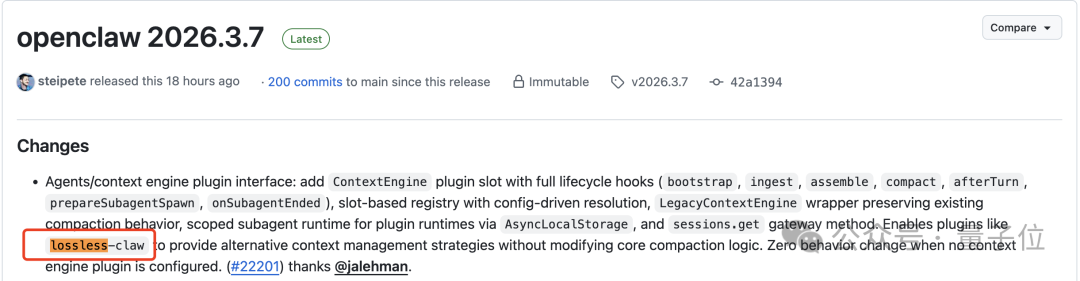

仔细查看官方发布的变更日志可以发现,一个名为lossless-claw的插件被特别提及。

总体而言,此次更新主要集中在三个方面:上下文管理插件化、Agent路由功能增强(包括频道、主题及独立会话)以及部署与工程化的改进(如Docker多阶段构建和SecretRef等安全策略)。

其中最重要的一点就是上下文管理的插件化设计。

根据官方变更日志,此次更新新增了ContextEngine插件接口,并提供了完整的生命周期钩子功能,包括启动、信息摄入、组装、压缩、回合结束后等操作。

这些变化意味着在系统运行的不同阶段可以插入不同的上下文管理策略,从而实现更加灵活的使用场景和更高的效率。

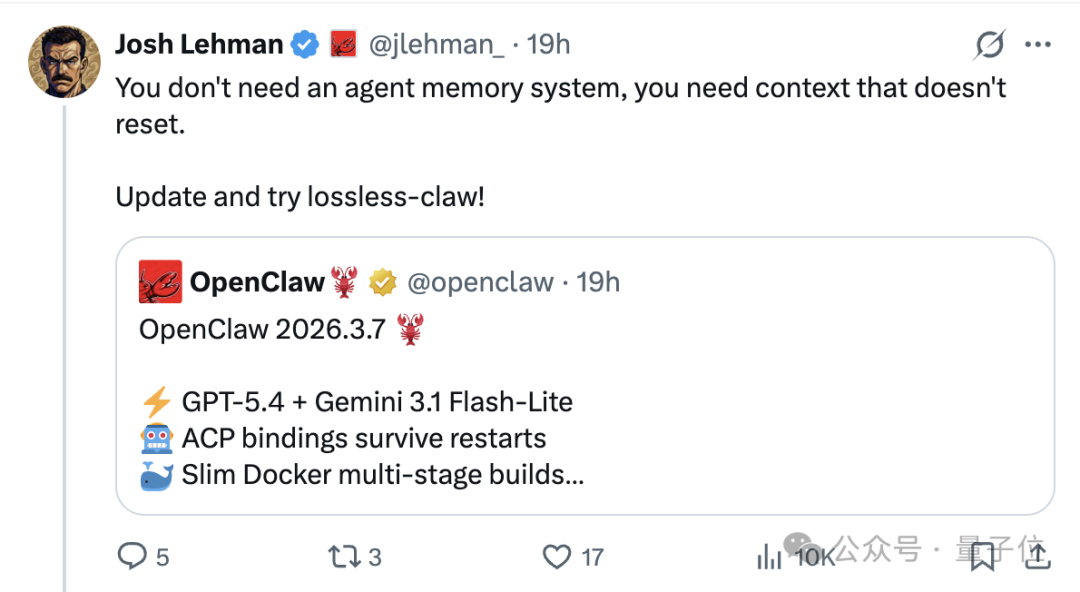

用插件作者Josh Lehman的话来说:“你并不需要一个记忆系统的Agent,你需要的是不会被重置的上下文。”

过去,在OpenClaw系统中,上下文处理逻辑是固定的。

比如在对话变得冗长时如何压缩历史记录、怎样拼接不同的信息片段以及何时丢弃旧的信息等规则均由系统内部设定,插件几乎无法进行干预。

而通过此次更新,这一限制被打破。现在可以采用各种定制化的上下文策略来适应不同的应用场景了。

这种变化具体表现在:不同插件能够提供不一样的上下文管理方案;系统不再强制执行固定的压缩逻辑;插件也可以控制上下文的压缩、组装以及子Agent生命周期等各个方面。

在过去的版本中,随着对话延长,系统可能会开始简化回复或删除旧信息,导致上下文丢失或者Agent忘记先前的计划和任务细节。这不仅影响了用户体验,还可能让模型在后续交流中表现不佳。

新的上下文插件机制正是为解决这些问题而设计的,能够确保对话记录完整保留,方便用户随时查阅或搜索相关信息,并根据需要展开查看原始消息内容。

官方推荐的一个例子是lossless-claw插件。它采用了一种创新的方法来管理旧信息:将它们持久化存储在SQLite数据库中并生成摘要,而不是简单地删除。

通过这样的机制,在多轮对话过程中,原始消息依然可以被完整保留下来,并且系统可以根据摘要和原始消息保持关联性,用户也可以随时展开查看详细的原文内容。

- 实际上,这意味着上下文“永远不会丢失”。

- 据开发者透露,这一设计理念受到了《LCM: Lossless Context Management》一文中所提出的思路启发。有兴趣的读者可以进一步阅读该文献以获取更多细节信息。

- 在OOLONG基准测试中,使用同一模型的情况下,lossless-claw插件的表现优于其他竞品Claude Code,在所有上下文长度下得分均高于对方。

开发者Josh Lehman分享道:“它的表现非常出色,甚至可能低估了其性能。”

除了改进上下文管理之外,此次更新还增强了Agent的路由能力,并且在部署和工程化层面进行了优化。例如支持按主题进行Agent路由、简化Docker构建过程以及准备发布iOS版应用程序等。

- 这些改进使得OpenClaw系统不仅能够更好地服务于开发者社区的需求,在用户体验方面也有了显著提升。

- Agent逐渐忘记之前的计划

- 甚至忘记自己修改过哪些文件

- 任务运行到后期,模型突然变得“变笨”

而新的上下文插件机制,正是为了解决这些问题。

随着定制化上下文策略的开放,未来针对不同场景的记忆方案也将不断出现,让“龙虾”在执行不同任务时变得更加高效,也更加经济。

举例来说,官方重点推荐的插件lossless-claw,就展示了一种新的上下文管理思路。

在传统Agent系统中,一旦对话过长,系统通常会:直接丢弃旧内容。

而在lossless-claw中,旧对话不会被删除,而是:

- 持久化到SQLite数据库,按对话组织

- 对旧消息块生成摘要,使用配置的LLM

- 将摘要压缩为更高层级节点,形成DAG(有向无环图)

- 每轮对话时,将摘要 + 最近原始消息组合成上下文

- 提供工具(lcm_grep、lcm_describe、lcm_expand)让Agent可搜索、回溯历史

也就是说,在多轮对话中,原始消息会被完整保留,系统根据摘要与原始消息保持关联,而Agent随时可以展开摘要查看原文。

理论上,上下文“永远不会丢失”。

(By the way,据作者透露,这一思路来自《LCM: Lossless Context Management》,感兴趣的同学可以进一步阅读。)

在OOLONG benchmark的测试中,使用同一模型时,lossless-claw得分74.8,打败Claude Code70.3。

更关键的是,上下文越长,差距越大。在测试的所有上下文长度下,lossless-claw的得分都高于Claude Code。

PR作者Josh Lehman表示,他已经在OpenClaw上实际运行了一周:

说它表现很好,都算是低估了。

除上下文插件以外,这次龙虾的更新还有两大重点:

首先是强化了Agent的路由系统。

针对Discord、Telegram、Slack、Mattermost等平台,OpenClaw引入了持久化线程绑定机制,即使系统重启,Agent与频道或话题的绑定关系依然能够保持。

同时还支持按主题路由 Agent:例如在Telegram中,每个topic都可以运行一个独立的Agent,因此在同一个论坛群里,也可以同时存在多个各自执行不同任务的Agent。

其次是在部署与工程化层面的优化。

例如官方已经开始为iOS App Store发布做准备,移动端版本也正在筹备中。

与此同时,Docker构建也进行了精简,新增bookworm-slim版本,通过Slim镜像减少不必要的依赖,使容器体积更小、启动速度更快,也更适合在服务器环境中大规模部署。

参考链接

[1]https://github.com/openclaw/openclaw/releases/tag/v2026.3.7

[2]https://x.com/steipete/status/2030508141419372667

[3]https://x.com/jlehman_

[4]https://github.com/Martian-Engineering/lossless-claw