新智元报道

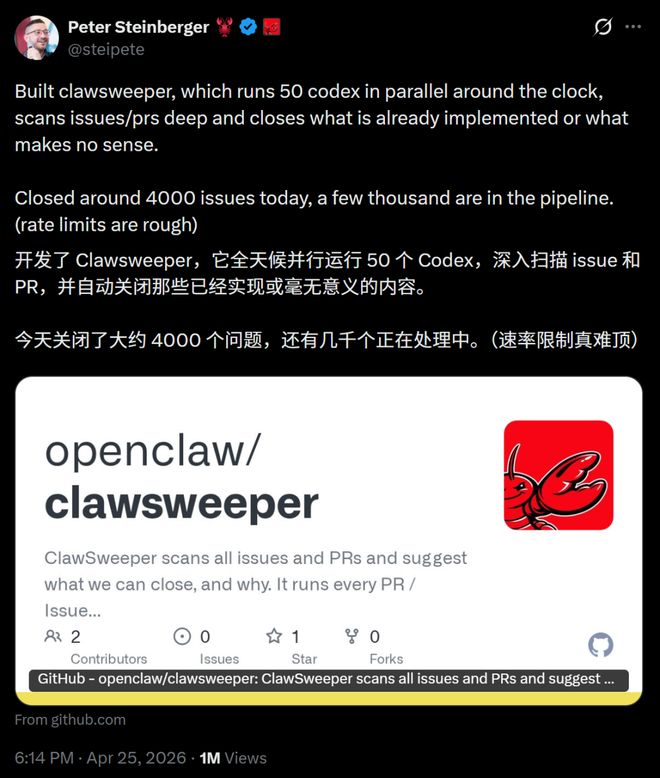

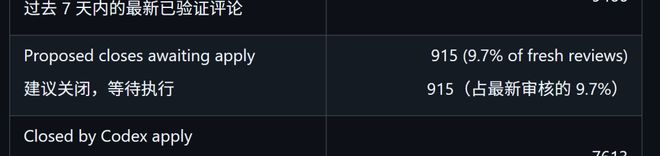

开源维护迎来AI「自愈」时代,ClawSweeper工具在两天内搭建完成,并启动了50个Codex实例进行并行扫描,成功关闭了超过5000个无效Issue。

用不到1000美元的成本,这项创新由OpenClaw创始人、同时也是OpenAI工程师的Peter Steinberger打造。

这位工程师在两天内开发出了名为ClawSweeper的应用程序,该应用利用Codex模型进行7×24小时不间断扫描。

通过这种模式,大量无效Issue被迅速清理,节省了原本可能需要一年时间的人工处理过程。

ClawSweeper对开源仓库中的垃圾信息进行了有效清理,使得维护者得以更专注于有价值的贡献。

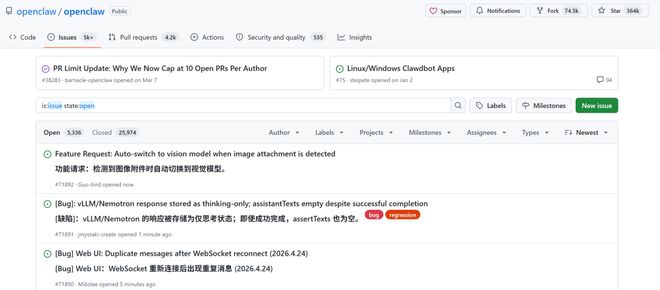

开源项目往往积压了大量的Issue和PRs,在这些项目中,重复的、过时的问题以及已经被解决但未关闭的问题比比皆是。

这些问题堆积如山,对任何人类维护者来说都是巨大的挑战。

然而,AI技术的应用使得这种清理工作变得高效且经济。

尽管Steinberger的工具仅花费不到1000美元就完成了这项任务,但其成效却非常显著。

用ClawSweeper处理5000多个Issue的成本极为低廉,每项问题的平均成本仅为两毛钱左右。

然而,GitHub API速率限制成为整个系统运行效率的主要瓶颈。

这个自愈工具的设计哲学非常谨慎,避免了无脑操作带来的风险。

ClawSweeper的核心运作基于gpt-5.5模型,并采用high reasoning effort和fast service tier配置;每个待审条目审查超时为10分钟。

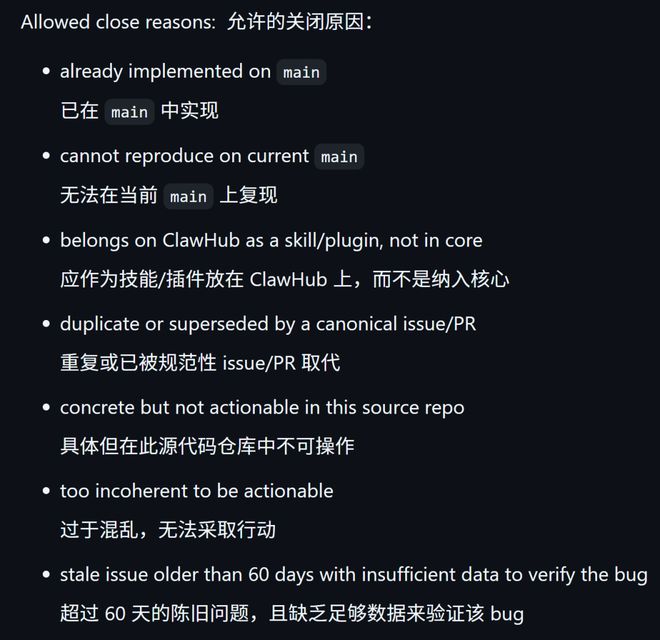

在特定条件下才会关闭一个Issue,比如已经在main实现、当前main无法复现等问题,确保了准确性与可靠性。

系统不会对项目主人或成员发出的问题进行处理,并且Codex在审查过程中没有写权限。

它只能查看代码和上下文信息,然后生成结构化的markdown报告存档。

只有经过二次验证后才会执行关闭动作,确保了每一项操作的准确性。

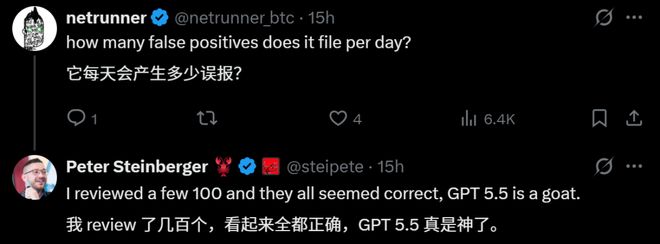

Steinberger亲自检查了几百条关闭记录,发现准确率几乎接近完美。

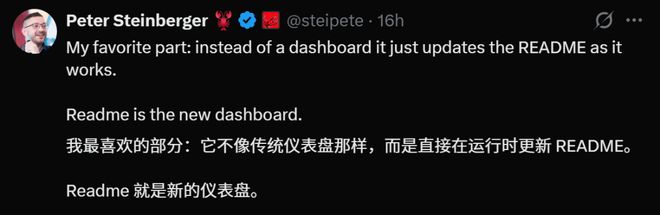

ClawSweeper最令人称道的设计在于其透明度和可审计性。

通过实时更新README.md文件,任何人都可以了解当前有多少未解决的问题以及系统正在处理的情况。

这种做法让整个清理过程变得公开、透明且易于审核。

对于担心AI关闭Issue的贡献者而言,他们可以通过查阅相关文档来获取完整的审查理由。

有人可能会质疑ClawSweeper只是一个自动化脚本而已。

实际上,在GitHub上有超过4亿个仓库中,活跃的大规模开源项目常常面临堆积如山的问题。

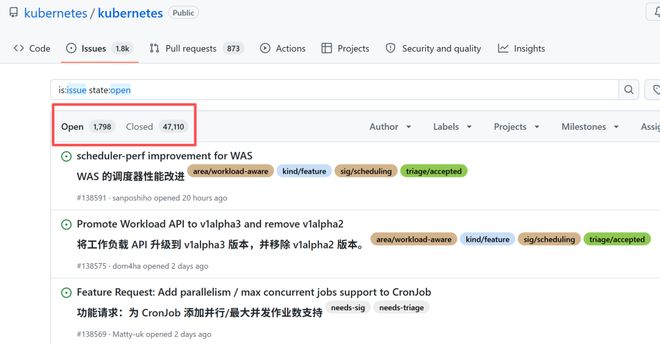

Kubernetes和Linux内核等知名项目也面临着类似的困扰。

维护者的时间非常宝贵,而大量的时间被浪费在重复判断问题是否仍需存在上。

ClawSweeper的出现证明了大规模、保守且可审计的Issue清理是完全可行的。

它用不到1000美元的成本处理了5000多个问题,并以高效和持续的方式进行工作。

传统做法是什么?

未来,大型开源仓库可能会运行类似的bot来自动过滤噪音并监控Issue质量。

当前唯一限制AI工作效率的是GitHub API的速率限制。

在传统软件开发中,限流机制是为了防止攻击,但现在它成为了AI效率的最大瓶颈。

这种情况表明了当前技术基础设施与先进算法之间的差距。

任何人打开GitHub仓库主页,就能看到这个AI判官此刻正在干什么。

它让整个清理过程变得完全透明、完全公开、完全可审计。

任何对「AI擅自关我Issue」有疑虑的贡献者,都可以直接点进对应的items/71514.md查看Codex给出的完整审查理由。

当AI开始「自愈」

你可能会想,这不就是个自动化脚本吗?

格局放大一点。

GitHub上有超过4亿个仓库,其中活跃的大型开源项目几乎都面临着同一个噩梦——Issue坟场。

Kubernetes有4万多个已关闭Issue,Linux内核的邮件列表积压更是天文数字。

维护者的时间是世界上最稀缺的资源之一,而大量时间被浪费在「判断这个Issue到底还需不需要存在」这种机械劳动上。

ClawSweeper的意义在于,它第一次在一个真实的、百万Star级别的仓库里证明了:用AI agent进行大规模的、保守的、可审计的Issue分诊,是完全可行的。

5000多个Issue的深度审查+关闭,总花费不到1000美元。按单个Issue算,成本大约0.2美元。

而且它7×24小时不休息、不抱怨、不带情绪。

唯一让它慢下来的,只有GitHub API的速率限制。

从某种意义上说,这标志着开源项目从「人工维护」迈向「自愈」的起点。

未来,每一个大型开源仓库可能都会跑着一个类似ClawSweeper的bot,持续监控Issue质量,自动过滤噪音,让人类维护者只需要关注那些真正需要人类判断的、高价值的问题。

Rate Limit是最后的防线

有个细节特别有意思。

ClawSweeper的Dashboard上赫然写着:「State: Apply throttled」——GitHub的API限流把它卡住了。

50个Codex并行扫描的速度太快,快到GitHub的服务器开始说「你慢点,我跟不上了」。

在传统软件开发中,速率限制是为了防止攻击。

但现在,它成了AI工作效率的唯一瓶颈。

不是模型不够聪明,不是判断不够准确,纯粹是基础设施跟不上AI的速度。

这大概就是2026年最真实的写照:管道追不上AI。

参考资料:

https://x.com/steipete/status/2047982647264059734

https://github.com/openclaw/clawsweeper