在本周四晚间,谷歌发布了其最新的模型系列 Gemma 4,这一系列被认为是当前开源领域中最强大的。

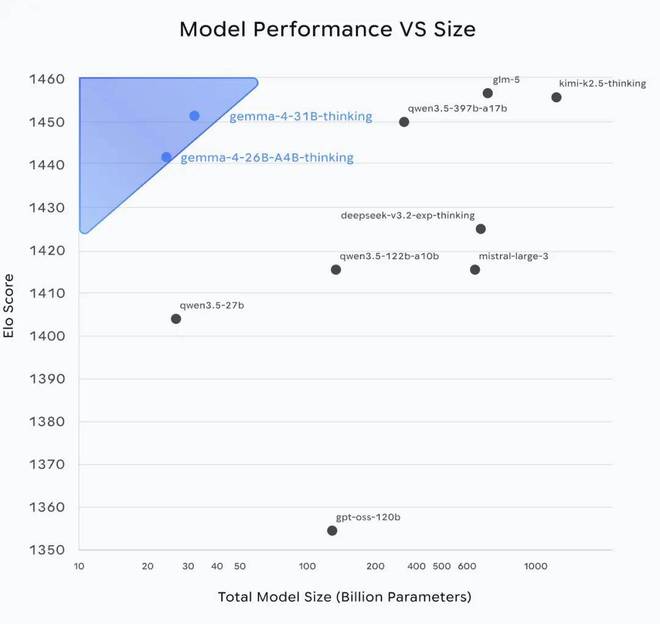

新的 Gemma 系列在 Arena AI 排行榜上获得第三名的位置,并且超过了参数量是它五倍多的大规模模型。此外,Gemma 4 使用了 Apache 2.0 开源许可证,这意味着它可以完全用于商业用途。

Google DeepMind 最近开发的 Gemma 4 是一个多模态模型系列,专门处理文本和图片输入(小型模型还支持音频输入),并生成相应的文本输出。这个版本包括预训练和指令微调的开放权重模型。Gemma 4 的最大上下文窗口可以容纳 25.6 万个 token,并且能够处理超过 140 种语言。

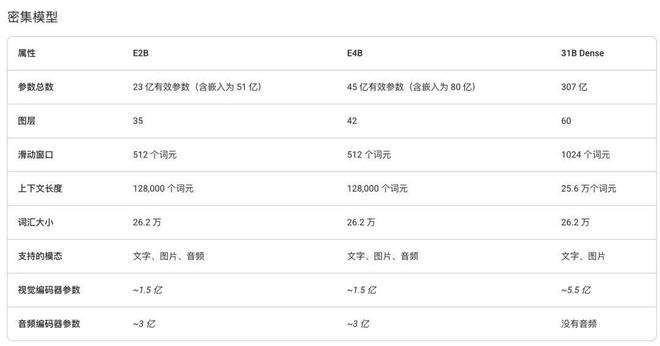

谷歌指出,Gemma 4 系列采用了密集型架构与混合专家 (MoE) 架构的结合方式,这使得它们非常适合进行文本生成、编码和推理等任务。该系列提供了四种不同规模的模型:E2B、E4B、A4B 和 B31。

其中最大的版本 31B,在使用一块 80GB 的 H100 显卡时,可以实现完整精度的推理,其性能与 Qwen 3.5 397B 相当。

最小的 E4B 和 E2B 版本则是为手机和平板电脑等设备端本地推理设计,并且谷歌已经与高通和联发科进行了联合优化。

总体而言,Gemma 4 引入了多项功能和架构上的改进:

- 推理 - 所有模型都具备高性能的推断能力,支持配置思考模式。

- 多模态处理能力 - 能够处理文本输入、各种比例及分辨率的图像(所有型号)、视频以及音频(E2B 和 E4B 版本原生支持)。

- 架构多样性与效率 - 提供从密集型到混合专家 (MoE) 的多种变体,以适应不同规模的应用场景。

- 设备端优化 - 较小的模型设计用于在笔记本电脑和移动设备上高效运行。

- 更大的上下文窗口 - 小型模型支持 12.8 万个 token 的上下文窗口,中型模型则为 25.6 万个 token。

- 编码与智能体功能增强 - 在编码基准测试中取得了显著进步,并且原生支持函数调用,有助于开发强大的自主代理系统。

- 原始系统提示支持 - Gemma 4 引入了对 system 角色的直接支持,以实现更结构化和可控的对话互动。

模型概览

模型设计旨在覆盖从移动设备到边缘计算 (E2B、E4B) 和消费级 GPU 工作站 (A4B、31B) 等多种部署场景。它们在推理、智能体工作流、编码和多模态理解方面表现出色。

这些模型采用了混合注意力机制,将局部滑动窗口注意与全局注意相结合,在最后一层始终保持为全局范围的注意模式。这种设计既保证了轻量级模型的速度优势及低内存占用,又不会牺牲长上下文任务所需的深度感知能力。为了优化长上下文中的内存使用,全局层采用了统一的键和值,并且应用比例 RoPE (p-RoPE) 技术。

E2B 和 E4B 中的“E”代表“有效参数”。较小的模型采用每层嵌入 (PLE),以最大限度地提高设备端部署中的参数效率。这种方法不会向模型添加额外的层级或参数,而是为每个词法单元在解码器层提供了独立的小型嵌入表。

在 26B A4B 中,“A”代表“有效参数”,意味着虽然总数是 260 亿个参数,但在推理过程中仅激活了其中的 40 亿个。这一设计使得模型速度接近于只有 40 亿个参数的标准密集型模型。

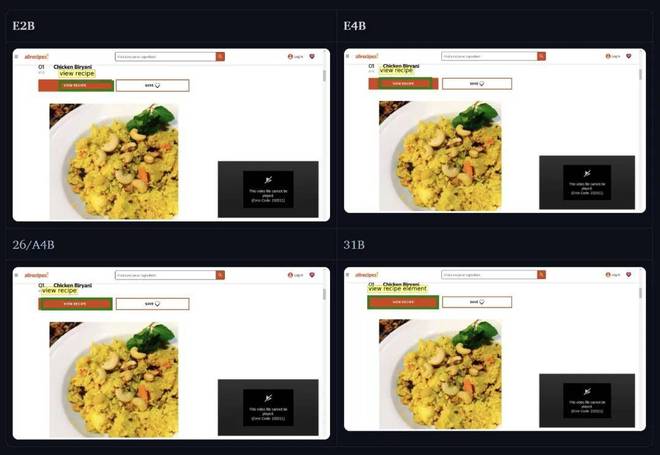

谷歌展示了 Gemma 4 的一些能力,例如检测和定位 GUI 元素:「找出配方图像中的边界框」

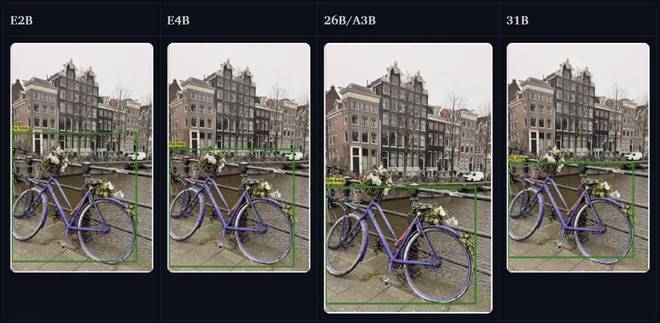

检测日常物体:

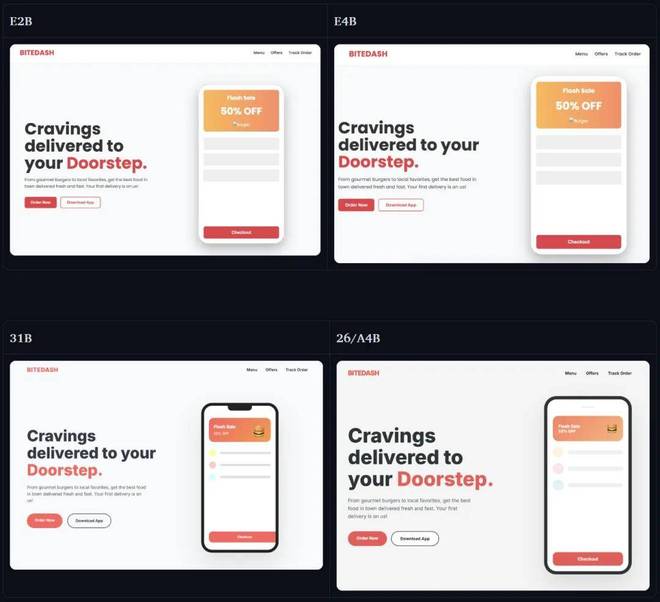

如果要求 Gemma 4 利用 HTML 创建一个页面来复制 Gemini 3 所创建的网页,Gemini 的生成结果如下:

而由 Gemma 4 重建的结果为:

参数大小和量化

Gemma 4 提供了四种不同规模的模型:E2B、E4B、A4B 和 B31。这些版本可以以默认精度(即 16 位)运行,或者通过量化采用更低精度的选项。不同的尺寸和精度代表了一系列性能与成本之间的权衡。

Gemma 4 推理内存需求

下表详细列出了使用不同规模的 Gemma 4 模型版本时进行推理所需的 GPU 或 TPU 内存大约值:

表格展示了加载 Gemma 4 各种规模模型所需的大概 GPU 或 TPU 内存数量,具体取决于参数量和量化等级。

内存规划的行动要点

- 高效架构(E2B 和 E4B):「E」代表“有效”参数。较小的模型采用了每层嵌入 (PLE) 方法来提高设备端部署中的参数效率,这种方法不会向模型添加额外层级或参数,而是为每个词法单元在解码器层提供了独特的小型嵌入表。

- MoE 架构(A4B):26B 是一种混合专家模型。尽管仅激活 40 亿个参数来生成文本,但所有 260 亿个参数都需要加载到内存中以维持高效的路由和推理速度。

- 基准权重:表中的估算值仅考虑了加载静态模型权重所需的内存量,并不包括运行软件或上下文窗口需要的额外 VRAM。

- 上下文缓存:内存使用会根据提示及生成响应中单词的数量动态变化。更大的上下文窗口意味着更高的 VRAM 需求。

- 微调成本:微调 Gemma 模型所需的内存量远高于标准推理,具体占用量取决于开发框架、批次大小以及是否采用全精度调优或参数高效微调(例如结构化工具使用)方法。

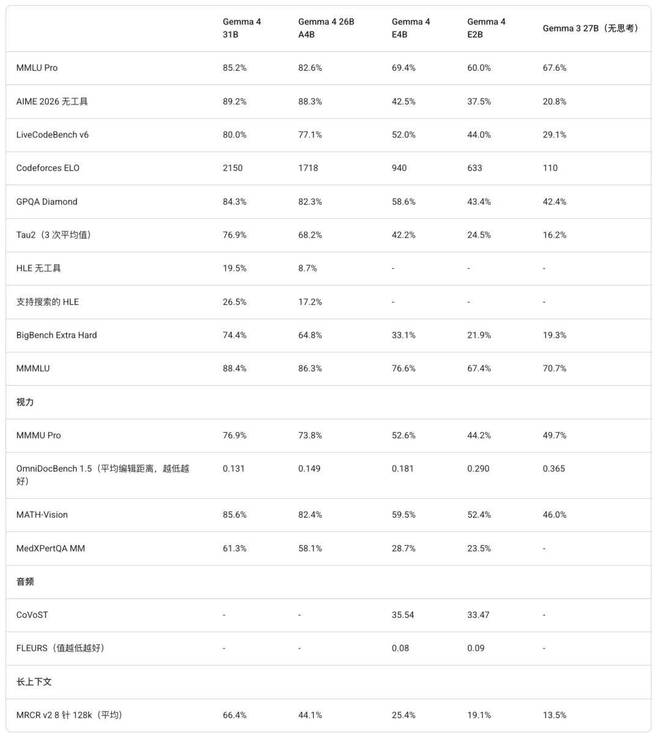

基准测试结果

谷歌为训练模型准备了一个大规模且多样化的数据集合,涵盖广泛的领域和模态,包括网页文档、代码、图像及音频等类型的数据,截止日期为 2025 年 1 月。以下是关键组成部分:

核心功能

网页内容:通过各种网站的文本确保模型接触到广泛的语言风格、主题以及词汇。

- 编程语言和代码片段:帮助模型学习编程语法及模式,提升其生成代码的能力。

- 数学问题和公式:训练以增强逻辑推理能力和符号表示能力。

- 图片素材:涵盖各种类型的图片以便执行图像分析任务。

- 这些多样化的数据源对于培养能够处理多种类型任务的强大模型至关重要。

- 在进行数据准备过程中,谷歌采用了严格的数据清理和过滤方法:

- CSAM 过滤:在整个流程中实施了多次严格的 CSAM(儿童性虐待材料)过滤步骤以排除有害内容。

- 敏感信息过滤:使用自动化技术去除训练集中可能包含的个人身份信息及其他敏感数据,确保模型的安全性和可靠性。

- 其他清理措施包括针对质量和安全性进行筛选。这些方法保证了训练集的质量和安全。

- 音频(仅限 E2B 和 E4B)- 自动语音识别 (ASR) 和语音转译文翻译(支持多种语言)。

训练数据集

谷歌使用的预训练数据集是一个大规模、多样化的数据集合,涵盖广泛的领域和模态,包括网页文档、代码、图片、音频,截止日期为 2025 年 1 月。以下是关键组成部分:

- 网页文档:各种各样的网页文本可确保模型接触到广泛的语言风格、主题和词汇。训练数据集包含 140 多种语言的内容。

- 代码:让模型接触代码有助于其学习编程语言的语法和模式,从而提高其生成代码和理解代码相关问题的能力。

- 数学:通过数学文本训练,模型可以学习逻辑推理、符号表示,并能够回答数学问题。

- 图片:各种各样的图片可让模型执行图片分析和视觉数据提取任务。

这些多样化数据源的组合对于训练强大的模型至关重要,该模型能够处理各种不同的任务和数据格式。

数据预处理

以下是应用于训练数据的主要数据清理和过滤方法:

- CSAM 过滤:在数据准备流程的多个阶段应用了严格的 CSAM(儿童性虐待内容)过滤,以确保排除有害和非法内容。

- 敏感数据过滤:为了确保 Gemma 预训练模型的安全性和可靠性,谷歌使用了自动化技术来过滤掉训练集中的某些个人信息和其他敏感数据。

- 其他方法:根据内容质量和安全性进行过滤。

参考内容:

https://deepmind.google/models/gemma/gemma-4/

https://x.com/Google/status/2039736220834480233

https://huggingface.co/blog/gemma4