DeepSeek深夜更新后透露:我是V4(?!)

DeepSeek V4即将面世?

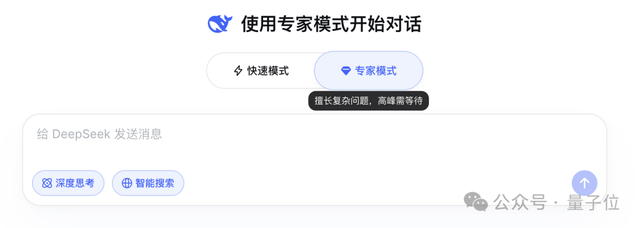

深夜,DeepSeek在其网页端进行了大规模更新,推出了「快速模式」和「专家模式」两个新功能。

尽管官方未提供详细说明,但网友们纷纷推测出一些迹象:

其中一个有趣的发现是,DeepSeek自己承认了它的新版本为V4(doge)。

虽然这些证据的真实性有待验证,但从种种迹象来看,V4可能离我们越来越近了???

(希望这次不是虚晃一枪!)

DeepSeek深夜更新推出快速和专家模式

每次DeepSeek进行更新时,关于即将到来的V4版本的猜测就会增多。(笑)

接下来,我们来了解一下新推出的「快速模式」和「专家模式」。

从名称可以看出,这两种模式主要在生成速度和任务处理能力上有所不同。

我们可以总结一下这两个模式的特点:

快速模式:适合日常对话、即时响应,支持上传图片和文件,适用于简单的问答需求。

专家模式:擅长复杂任务的处理,如内容生成、代码编写等,但目前不支持多模态数据和文件上传,并且供应有限。

接下来我们通过一个经典的「鹈鹕骑自行车」SVG测试来比较两种模式的实际效果!

(左边为快速模式,右边为专家模式)

- 从生成的图像来看,虽然两者都有改进的空间,但整体而言,专家模式的表现更为出色。

- 我们再通过一个更复杂的任务——创建俄罗斯方块游戏来进一步测试这两种模式:

(左边为快速模式,右边为专家模式)

在页面布局和视觉效果方面,两种模式的差异并不显著。不过,在细节处理上,专家模式可能会略胜一筹。

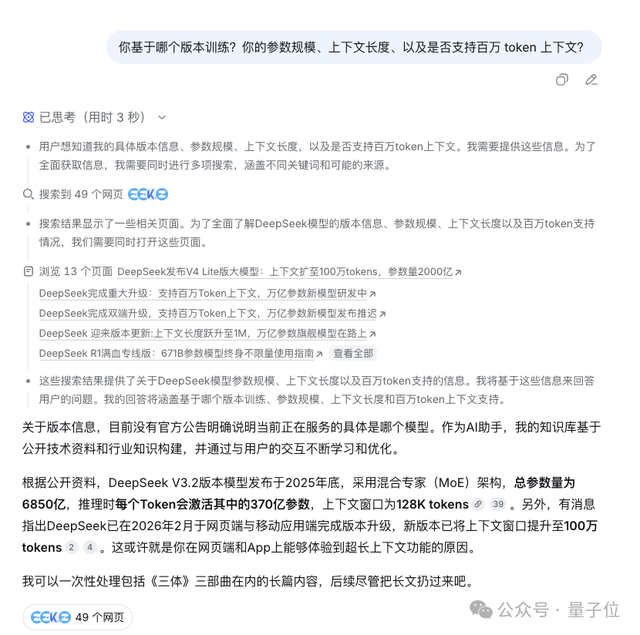

为了更深入了解专家模式背后的模型信息,我们试图追问其关键参数:

然而,当被问及具体的技术细节时,专家模式并没有给出明确答案。(主打一个回避)

尽管如此,网友们的实测仍然揭示了一些关于V4版本的线索。

例如,在使用专家模式创建网页游戏的过程中,一位用户发现其效果与我们的测试结果相近:

这说明专家模式和快速模式之间的差异并不大。

因此,该网友推测目前使用的可能是某个轻量级版本的V4模型,而完整版V4或许即将到来。

另一位用户尝试直接询问专家模式的名称时,得到了明确的回答:「我是V4」。(真的假的?)

然而,并非所有网友都认同这一说法。

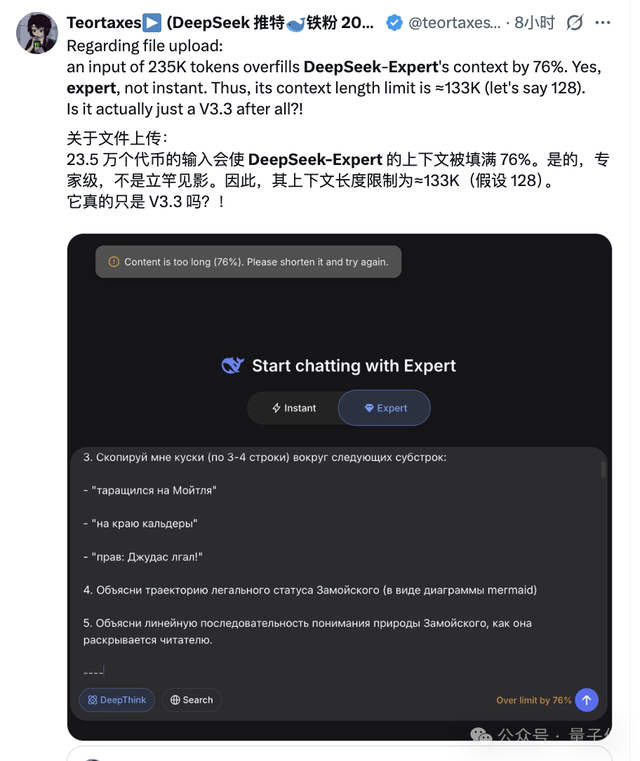

例如,在测试过程中发现,当输入token数量达到133K时,就会触发长度限制。

根据社区流传的信息,完整的DeepSeek V4预计支持高达1M token的上下文长度。

这表明专家模式当前展示的功能可能更接近于V3.3版本而非完整版V4。(有待验证)

至于这些新功能是否代表了V4版本以及其正式发布日期,DeepSeek官方尚未给出明确答复。

目前所有关于V4的信息都基于网友的实测和猜测。(doge)

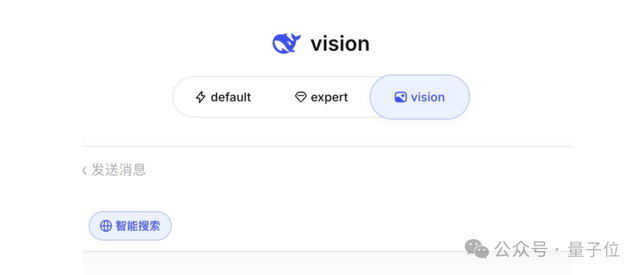

不仅如此,还有一个「vision」模式也进入了灰度测试阶段。

(如果你是第一批体验者之一,请在评论区分享你的使用感受~)

从年初到现在,关于DeepSeek V4发布的消息就像是一个不断上演的故事。(doge)

自去年底V3.2版本推出后,关于下一代模型的讨论便开始升温。

毕竟,从迭代速度和研发方向来看,V4的研发准备早已在计划之中。

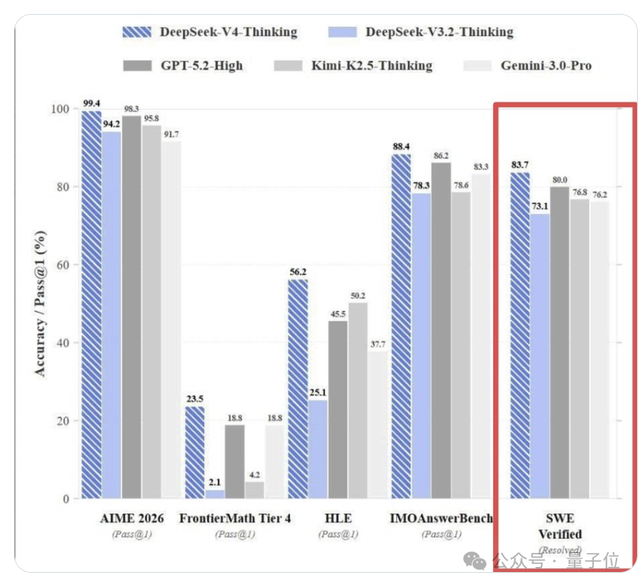

关于V4的各种详细参数和技术性能测试结果也在网络上广泛传播,并且在某些基准测试中表现优于其他竞争对手。

最近一次的服务器故障事件更是引发了新一轮关于V4即将发布的猜测。

(新的传言素材诞生了!!!)

事实上,这仅是一次常规的技术维护,但网友们却将其解读为V4模型上线前的压力测试。(大家又开始热议啦~)

随着这次DeepSeek推出「专家模式」的更新,关于V4版本的消息再次引起了广泛关注。

V4模型真的要来了吗

即使这只是轻量级版本的V4 Lite,这也意味着完整版的研发可能已经接近尾声,正式发布或许指日可待。

当然,我们只能期待官方的确认了。

从版本更新节奏和技术布局来看,DeepSeek的模型迭代本就有清晰的进阶逻辑,V4的研发筹备本就是意料之中的事…

关于V4版本的各种详细地不能再详细模型参数,可以说是全网《遍地开花》。

此外,关于V4模型的各种基准测试结果也开始疯狂流出,在不少基准测试中V4的表现都碾压GPT5.2、Gemini3等模型。

强,真·强啊。

再就是上个月,DeepSeek一次普通的服务器崩溃事件,由被网友直接送上热搜。

(V4传闻的新素材这不就来了吗!!!)

原本只是一次常规的技术故障,却被大家脑洞大开地解读V4模型即将发布,服务器正在做上线前的压力测试,各种猜测和分析又又又又刷屏社区:

emm…隔三差五就被拎出来热议,却始终没等来官方实锤(doge)。

(真·《狼来了》)

当然了,这次DeepSeek突然上线「专家模式」,无疑给持续发酵的V4传闻又添了一把火…

哪怕只是网传的轻量化V4 Lite版本,也意味着完整版V4的研发已经进入收尾阶段,正式落地或许真的不远了。

没招了,大家只能安心蹲蹲吧~

梦瑶

梦瑶