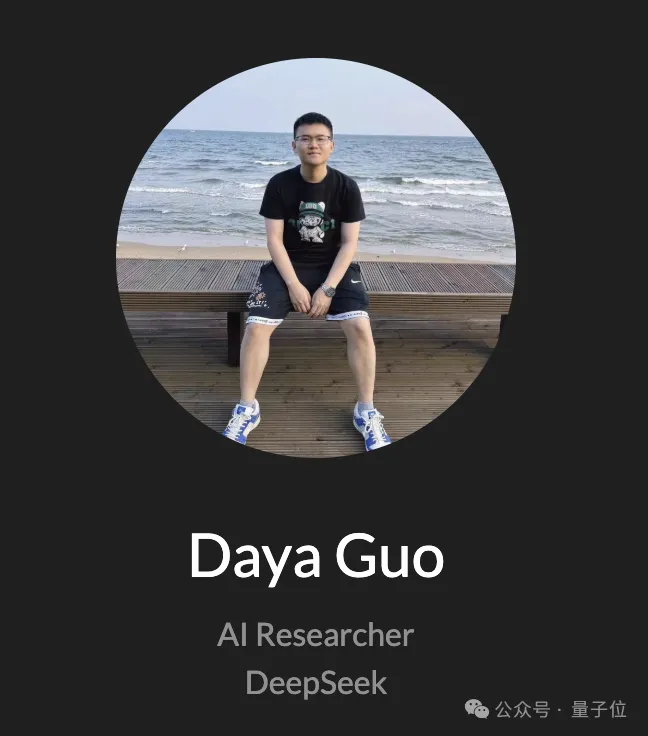

DeepSeek的核心工程师郭达雅正面临新的职业选择。

郭达雅将花落谁家?

他作为V2、V3、R1等模型的主要作者,最近离职的消息引起业内关注。

郭达雅自入学博士后的第三天便完成了毕业所需的论文发表,显示出超常的科研能力。

他还在腾讯广告算法大赛中连续夺冠,并在ATEC科技精英赛和微信大数据挑战赛中斩获头奖。

郭达雅在学术和竞赛领域都有着卓越的表现,被戏称为“中山大学的雷军”。

他加入DeepSeek后,一直致力于代码智能和大语言模型推理的研究。

郭达雅2023年博士毕业后,被一位师姐推荐加入DeepSeek,因为公司追求AGI的目标与他的价值观相契合。

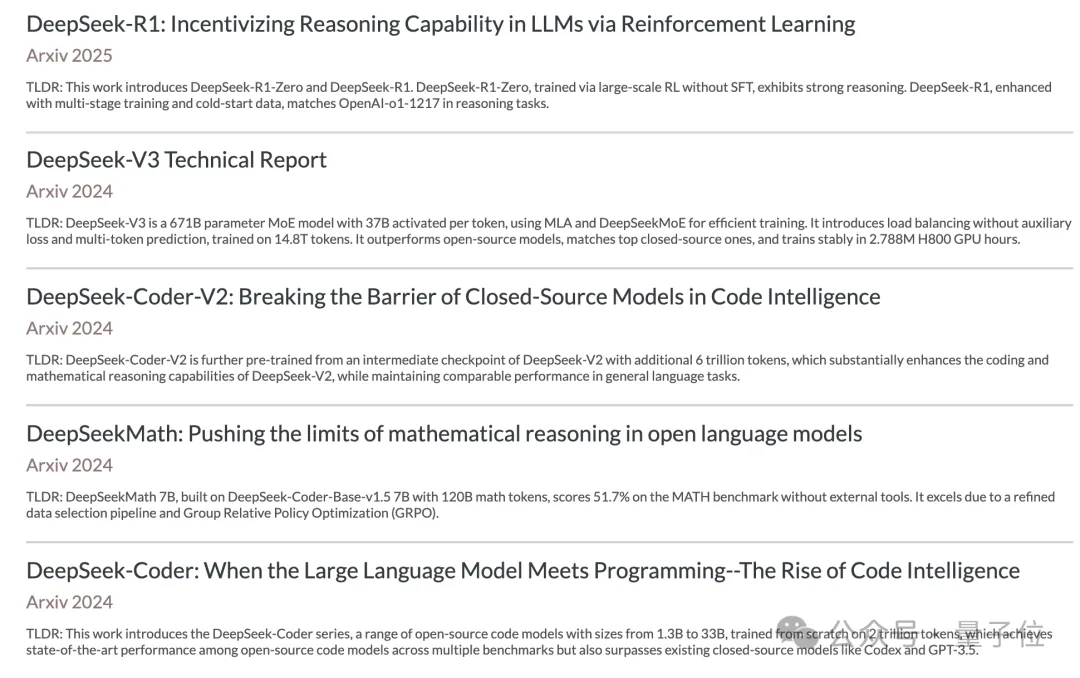

进入DeepSeek后,郭达雅参与了Coder、Math等专项模型,以及从V2、V3到R1的完整研发链条,担任核心作者。

目前,郭达雅的个人主页仍然显示为DeepSeek研究员,尚未更新。

他参与的DeepSeek系列模型,包括V2、V3和R1,以及Math、Coder、Prover和V2-Prover,均是他核心贡献的成果。

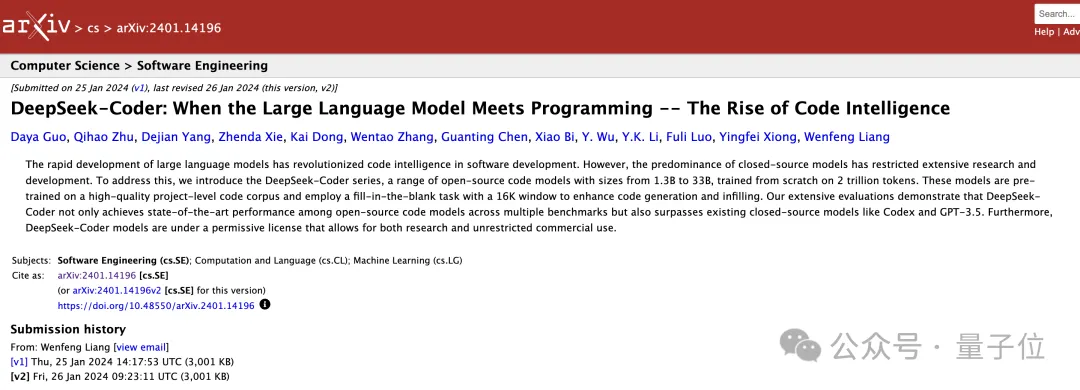

2024年1月,郭达雅带领团队推出了DeepSeek-Coder,这是一个开源代码模型,覆盖了从1.3B到33B的多种规模。

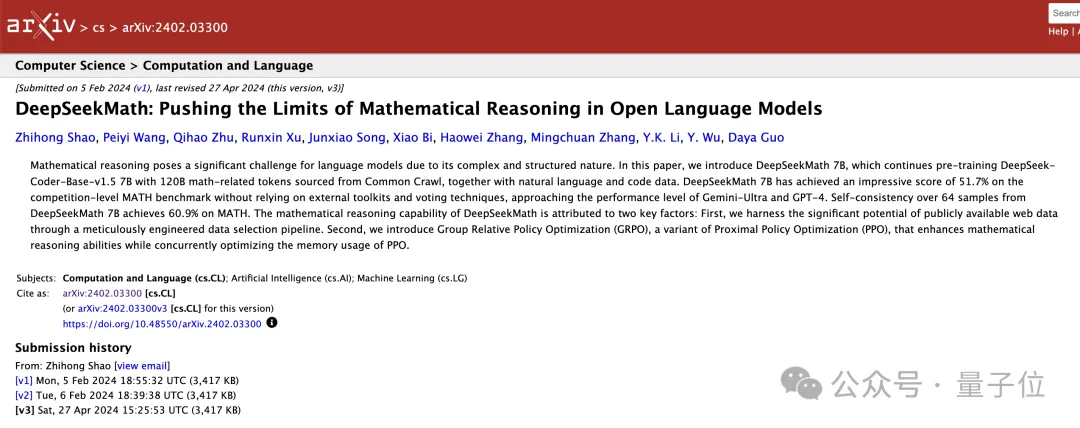

2024年2月,郭达雅团队又发布了DeepSeek-Math,该模型在数学推理方面取得了显著进展。

DeepSeek-Math的论文中提出了一种新的强化学习方法GRPO,后来成为R1推理的关键。

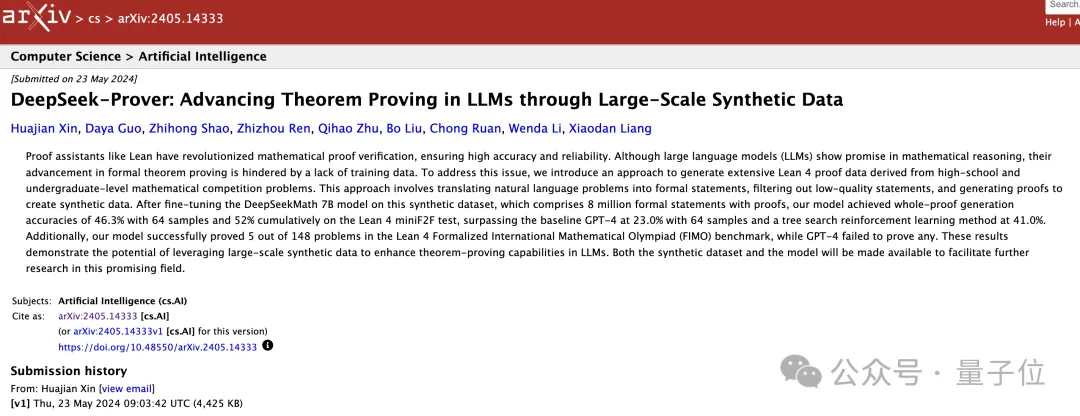

接着在2024年5月,郭达雅团队发布了DeepSeek-Prover,专注于Lean 4定理证明。

该项目在Lean 4 miniF2F上达到了46.3%的准确率,远超GPT-4的表现。

这些成果表明,郭达雅不仅在数学推理方面表现出色,还在更高级别的形式化推理方面取得了突破。

DeepSeek-R1的相关论文后来发表在Nature期刊上,显示其训练成本仅为29.4万美元。

郭达雅的职业生涯从中学时期就开始萌芽,那时他对计算机和编程产生了浓厚的兴趣。

2014年,郭达雅被中山大学计算机学院录取,随后直接攻读博士学位。

他在大四时入选中山大学与微软亚洲研究院联合培养博士生项目,师从印鉴教授和周明博士,研究方向是自然语言处理。

读博期间,郭达雅的实习是在MSRA完成的,期间完成了CodeBert和GraphCodeBert的研究。

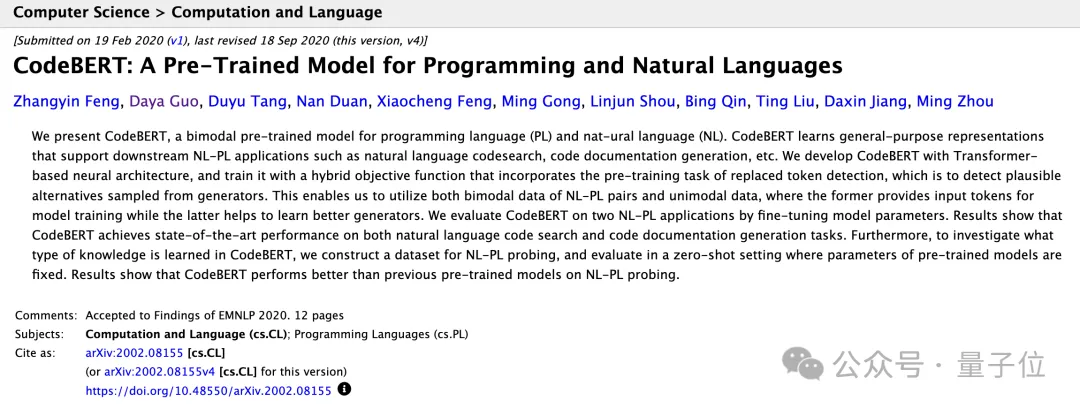

CodeBert开发了一个双模态预训练模型,首次实现了自然语言和编程语言的双模态预训练。

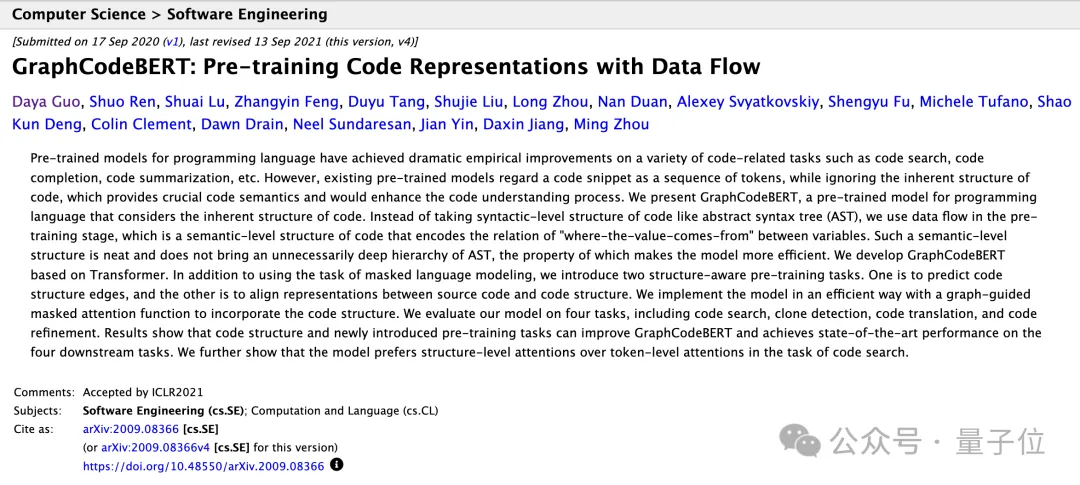

GraphCodeBert则在此基础上,首次将代码的数据流结构纳入预训练,提升了模型的理解能力。

毕业时,郭达雅的博士论文《基于预训练的程序理解与生成》被评为2023年中山大学优秀博士学位论文。

该论文主要针对程序理解与生成领域,提出了基于代码预训练的方法和模型。

从会议论文到博士论文,再到DeepSeek期间的工作,郭达雅的研究几乎都是围绕着编程展开的。

他的导师印鉴教授希望他能成为“中山大学的雷军”,这反映了郭达雅在业界的影响力。

郭达雅已在NeurIPS、ACL、EMNLP等国际顶级AI会议发表论文十余篇,谷歌学术引用量超1300次。

在数据挖掘竞赛方面,郭达雅也是活跃的参赛者,多次获得冠军。

他还在腾讯广告算法大赛中连续夺冠,展现了他在算法领域的深厚功底。

此外,郭达雅还参与了以程序员为主题的综艺真人秀《燃烧吧!天才程序员》。

在节目中,他展现出了顶尖的编码实力,被称为SSS级“巨佬”选手。

郭达雅的这些成就和经历,使他成为业界关注的焦点。

在接受珠海一中的访谈时,郭达雅表示,自己选择计算机专业是兴趣使然,并且这种兴趣正是产生于中学期间。

兴趣是我选择计算机专业并取得如今成就的重要因素,而这一兴趣的萌芽正源自珠海一中。

回想高中时光,学校丰富的实践活动和课程不仅拓宽了我的视野,也让我在信息课上第一次接触到计算机编程。

最初的我对编程一无所知,但很快便被其严谨的逻辑性和无限的创造力深深吸引。

通过编写简单的代码,我不仅感受到算法的精妙,还体会到数学在实际应用中的强大作用。

这段经历让我对计算机科学产生了浓厚兴趣,也让我在高考结束后毫不犹豫地选择了计算机专业。

2014年,郭达雅被中山大学计算机学院录取,随后留在中大继续直博深造。

大四时,他入选中山大学与微软亚洲研究院联合培养博士生项目,师从印鉴教授和周明博士,研究方向是自然语言处理。周明则后来在大模型浪潮中,创办了澜舟科技。

京东探索研究院副院长、阶跃星辰Tech Fellow段楠的博士生导师也是周明,两人算是师出同门。

而郭达雅在中山大学对他进行的采访中表示,自己在刚入学的第三天,就完成了中大博士毕业的论文发表要求。

读博期间,郭达雅的实习是在联培单位MSRA完成的。

其间,郭达雅完成了CodeBert以及GraphCodeBert的研究,分别发表在EMNLP 2020 Findings和ICLR 2021上。

CodeBert开发了一个双模态预训练模型,首次实现了自然语言(NL)和编程语言(PL)的双模态预训练,填补了此前没有模型能同时处理NL和PL混合输入的空白。

而GraphCodeBert则在此基础上,首次将代码的数据流结构纳入预训练,让模型对代码的理解更深入。

毕业时,郭达雅的博士论文《基于预训练的程序理解与生成》,获评2023年中山大学优秀博士学位论文。

这篇论文主要以程序理解与生成为研究课题,并针对该领域现有研究工作在数据与模型方面存在的问题,提出了基于代码预训练的方法和模型,目的是利用人工智能技术提高软件开发的效率。

从会议到博士论文,再到DeepSeek期间的工作,郭达雅的工作几乎是一直围绕着Coding展开,这也增加了曝料中他离职后负责Coding这一说法的可信度。

DeepSeek-V3发布后,他的导师印鉴教授,还特别寄语,希望他能成为“中山大学的雷军”。

截至目前,郭达雅已在NeurIPS、ACL、EMNLP等国际顶级AI会议发表论文十余篇,谷歌学术引用量超1300次。

此外,在数据挖掘竞赛方面,郭达雅也长期活跃于一线赛场:

2021、2022年,他连续两年拿下蚂蚁集团主办的ATEC科技精英赛冠军;

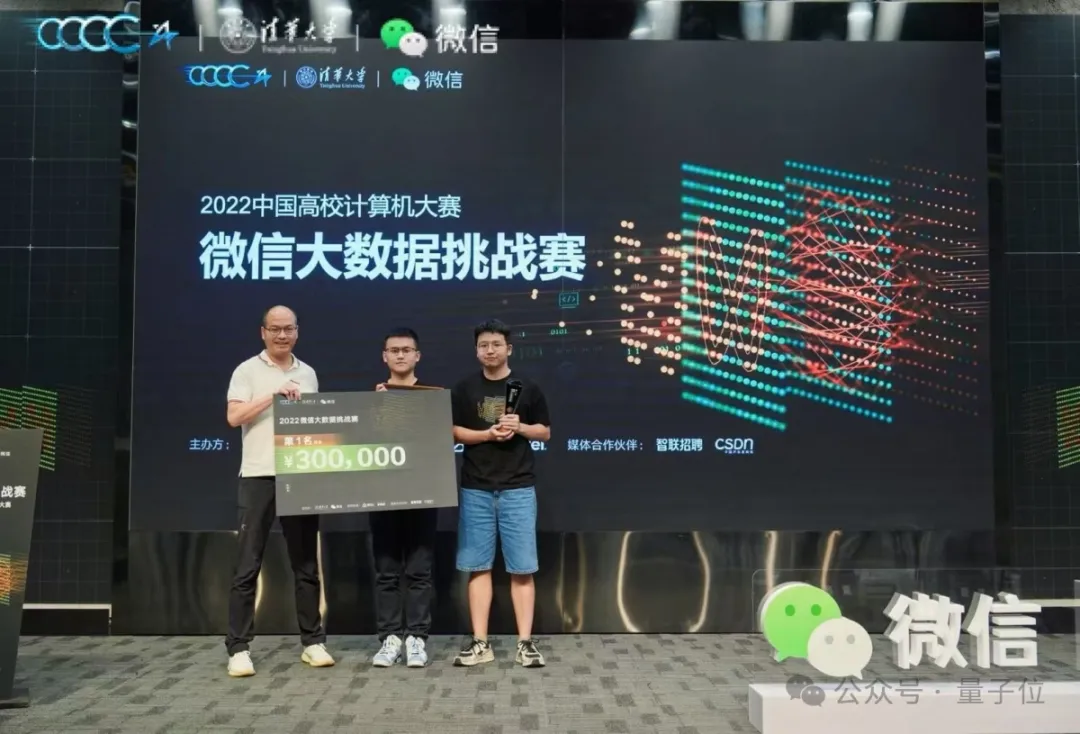

2022年微信大数据挑战赛,3200支队伍同台竞技,他带队夺冠,成功将30万大奖收入囊中。

而郭达雅最具代表性的战绩,是在腾讯广告算法大赛中连续夺冠。

作为DYG战队核心成员,他在2019年获得冠军,并于2020年实现卫冕,利用BERT算法拿下50万元大奖;2021年又成功夺冠。

也算是腾讯广告算法大赛名人堂选手了。

One More Thing

有意思的是,学术和竞赛全面开花的郭达雅,还有不太“科研”的一面——上综艺。

在以程序员为主题的综艺真人秀《燃烧吧!天才程序员》中,郭达雅和另外15名选手一起展开了60小时的代码极限挑战。

节目组把选手分成了S、SS、SSS三个级别,SSS级的“巨佬”只有2名,郭达雅就是其中之一。

郭达雅一出场便引人瞩目,“巨佬来了”“神一样的存在”。

不仅强,而且头发还挺茂密。

但现在,秦失其鹿,天下共逐之…

谁又能得到郭达雅呢?

参考链接:

[1]https://www.reddit.com/r/LocalLLaMA/comments/1rzu7rc/deepseek_core_researcher_daya_guo_rumored_to_have/

[2]https://guoday.github.io/

[3]https://mp.weixin.qq.com/s/bYztba9PwPHePhwufd4L7Q

[4]https://sai.sysu.edu.cn/node/545

克雷西

克雷西