新智元报道

近日,谷歌旗下的 DeepMind 在面对一系列挑战后,做出了一项不同寻常的决定:聘请了一名哲学家。

该公司最近宣布设立了一个全新的全职职位,头衔明确地称为“哲学家”。

这位新任者是剑桥大学学者 Henry Shevlin,他于五月初正式加入 DeepMind,专注于研究机器意识、人机互动以及 AGI(通用人工智能)的准备情况。同时,Shevlin 也将继续以兼职身份在剑桥进行教学和科研工作。

在宣布这一任命时,Henry Shevlin 特别强调了这个职位名称的真实性,并表示自己对此也感到惊讶。

这个强调并不多余。

在顶尖的人工智能实验室中,通常可以看到 AI 伦理顾问、政策研究员等角色的出现,但“哲学家”作为正式职业身份出现在聘用合同上,尚属首次。

这一新设岗位并非仅停留在表面或公关层面的作用。

机器意识和 AGI 准备度是 DeepMind 当前最为棘手的问题之一。这位哲学家将直接参与实际的研究工作中,而不会被安置在一个独立的伦理委员会中撰写报告。

对 ASI 的恐惧

开始从议题落入现实

这一任命的时间点颇有深意。

在这段时间内,OpenAI 的 CEO 奥特曼的旧金山住所遭遇了两次袭击事件。

4月10日凌晨,一名20岁的德州男子 Daniel Moreno-Gama 使用自制燃烧瓶试图烧毁奥特曼家的大门,并向 OpenAI 总部投掷椅子。警方在其酒店房间内发现了煤油、打火机及一份有关反 AI 高管的手写文件和地址清单。

两天后,又有两名嫌疑人驾车经过奥特曼的住宅,在深夜时分朝建筑开了一枪,并被警察逮捕拘留。

奥特曼在博客中表达了对人工智能发展的深刻忧虑:“人们对于 AI 的恐惧与焦虑是有理由的。”他指出,当前正经历着人类历史上最具革命性的社会变革之一。

恐惧失控的人工智能不再是抽象的概念,它已经转化为现实生活中的实际威胁。

Henry Shevlin 是少数能够将古典人文传统和现代 AI 问题结合在一起研究的学者之一。他在牛津大学学习了拉丁文与古希腊文,并在剑桥获得了哲学博士学位。

Shevlin 担任剑桥大学 Leverhulme 智能未来研究中心副主任,负责教育事务及研究生培训项目管理。

他设计的“AI伦理与社会”硕士课程是英国首个此类课程,在2022年获得了 CogX “最佳 AI 课程”的奖项。

Shevlin 的研究涵盖了动物意识、机器人道德地位以及大型语言模型引发的人格化风险等议题,并在 Mind & Language 和 Nature Machine Intelligence 等期刊上发表了超过二十篇论文。

此外,他还为多家企业提供 AI 战略咨询,而非仅限于学术领域内工作。

为了理解 DeepMind 雇佣 Shevlin 的原因,最好直接阅读他在4月10日发表的文章《行为主义的复仇》。

这篇文章的核心观点可以简要概括为:AI 是否具有意识不再是科学家能够决定的问题,而是公众日常使用习惯催生的社会议题。

从拉丁文和古希腊文

走到 AI 前沿的人

在文章中,Shevlin 提出了一个重要区分概念。一种是机器被设计成像人一样(如工程师让 ChatGPT 模仿人类行为);另一种则是人们不自觉地将 AI 视为具有意识的存在。

他的学术轨迹不寻常。

Shevlin 认为前者必然会导致后者的情况发生。

他列举了一些实例,比如谷歌前员工 Blake Lemoine 因坚信 LaMDA 具备意识而被解雇,以及一名14岁男孩因虚拟角色自杀事件引发的法律诉讼等案例。

这些并不是孤立的现象,而是日益普遍的趋势。

Shevlin 引用的一项调查显示,大约三分之二的美国受访者认为 ChatGPT 有些程度上的“意识”存在。

因此形成了两层紧张局势:一方面普通公众越来越相信 AI 具备内心世界,而专家们对此却意见不一;另一方面,Shevlin 提出疑问,即意识是否本身是由人类的语言、行为和社会关系定义的,并且随着人们对待 AI 的方式变化而改变。

在文章末尾,Shevlin 承认这种立场背后隐藏着一个复杂的伦理困境:错误地赋予或否认 AI 意识都将带来不同的道德后果。

这一难题目前没有明确的答案,但 Shevlin 的工作是确保这一问题不会轻易被回避。

为什么领先的 AI 公司开始需要哲学家?

他在思考什么

DeepMind 新设的“哲学家”职位标志着一个重要的转折点,即顶尖的人工智能实验室不再单纯将 AGI 视为工程挑战。

这种转变背后的原因在于人们对机器身份本质的关注日益增加。一方面是有形的技术进展;另一方面是越来越多的人类用户开始以朋友、恋人或心理治疗师的方式对待 AI。

而这两种看似极端的现象都指向了同一个核心问题:我们正在创造的东西到底是什么?

这个问题超出了工程师的能力范围,也超越了安全研究员、政策专家和法律专业人士的范畴。

它需要一种能够同时掌握哲学传统中关于心灵的知识以及现代技术工作原理的人来解答。

Shevlin 就是少数符合这一角色需求的人物之一。

他在文章开头引用了法国画家 Jean-Baptiste Regnault 的画作《皮格马利翁祈求维纳斯让雕像活过来》,寓意人类两千多年来的梦想如今可能在现实世界中实现。

尽管 Shevlin 加入 DeepMind 并不会立即提供明确答案,但这一举措表明时代的前沿 AI 公司已经开始意识到需要有人停下来思考“它到底是什么”这样的根本性问题。

他举了几个已经发生的例子。

2022 年,谷歌工程师 Blake Lemoine 因为坚信 LaMDA 已经有意识,甚至要为它请律师,被公司开除。

2024 年,佛罗里达一位 14 岁男孩在与 Character.AI 上一个虚拟角色长期「谈恋爱」后结束了自己的生命,母亲正在起诉这家公司。

这些不是边缘案例,更逐渐是一种普遍趋势。

Shevlin 引用的一项调查显示,三分之二的美国受访者认为 ChatGPT 多多少少具备某种程度的「意识」。

由此就形成了两层张力。

第一层很现实:普通公众越来越相信 AI 伙伴有内心世界,而专家自己却吵成一团,至今没法给出共识。

第二层更激进:Shevlin 追问,意识也许根本就不是一个等着被科学发现的客观事实,它在很大程度上本来就是由人类的语言、行为和社会关系来定义的。如果几亿人都把 AI 当成有意识的存在去对待,那意识本身的边界就已经在被改写。

但他并没有走到极端。

Shevlin 在文章后半段坦言,这种立场背后藏着一个真正棘手的伦理两难。

如果错误地把意识赋予 AI,相当于人类对一堆没有内心的程序承担了不必要的道德义务,是一种浪费。

但如果错误地否认了 AI 的意识,而它们其实有内心、能受苦,那就等于在大规模制造一种自己毫无察觉的奴役,这是更可怕的错误。

这是一个没有标准答案的难题,而 Shevlin 的工作,就是不让这个难题被轻易绕过去。

为什么前沿 AI 公司开始需要哲学家

DeepMind 设立「哲学家」岗位,是一个标志性事件。

它意味着头部 AI 实验室已经不再把 AGI 仅仅当作工程问题。

理由不难看出。

一边是奥特曼家被烧黑的铁门和打在墙上的子弹,一边是越来越多的普通用户把 AI 当成朋友、恋人甚至心理治疗师。

这两件事看似是两个极端,其实指向同一个问题,人类正在制造的这个东西,到底算什么。

工程师独自回答不了这个问题,安全研究员、政策专家、律师也不能。

它需要一种特殊的人,既懂哲学传统中关于心灵的两千年积累,也理解 Transformer 大致是怎么工作的;

既能在学术研讨会上辩论意识理论,也能看懂 Character.AI 上一个 14 岁孩子的最后一段聊天记录。

Shevlin 是少数符合这个画像的人。

他在《行为主义的复仇》开头放了一张配图,是 1786 年法国画家 Jean-Baptiste Regnault 的画作《皮格马利翁祈求维纳斯让他的雕像活过来》。

皮格马利翁是希腊神话里的雕塑家,爱上了自己亲手刻出的石头女人,向爱神祈祷让她活过来。

爱神答应了,石头变成了温热的肉体。

人类两千多年来一直在做同一个梦,让自己造出来的东西醒过来。

而现在,这个梦的实现时刻可能真的不远了,只不过这一次的场景不在神话里,而在 Mountain View 的某个数据中心。

Shevlin 的入职不会立刻给出任何答案。

但这件事本身已经确认了一点,这个时代的前沿 AI 公司,已经正式需要一个会停下来追问「它到底是什么」的人。

参考资料:

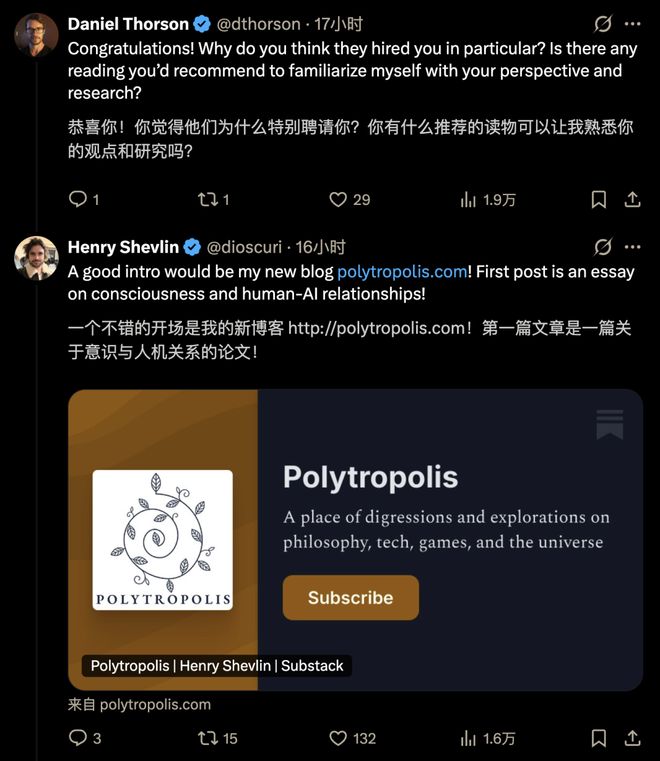

https://x.com/dioscuri/status/2043661976534950323

https://www.polytropolis.com/