新智元报道

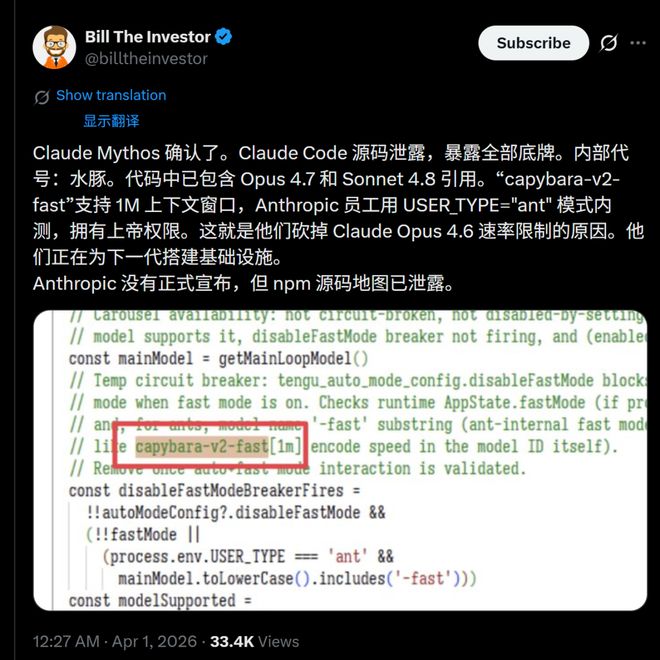

最近,有关Anthropic公司最新研发的Mythos模型基准测试结果被意外曝光的消息引起了广泛关注。这一泄露不仅刷新了多项性能记录,还透露出了代号为capabara-v2-fast的新版本细节。

在过去的一天里,整个AI行业的气氛都充满了紧张与兴奋。

首先披露的是Claude Code的源代码。

Anthropic公司的这款命令行终端工具在GitHub上意外泄露后,迅速引起了广泛关注。许多开发者纷纷涌入查看,并尝试复制或重新实现该软件的不同版本。

一次原本只局限于公司内部的研究项目,一夜之间成为了整个行业公开的秘密。

紧随其后的是另一波消息的曝光。

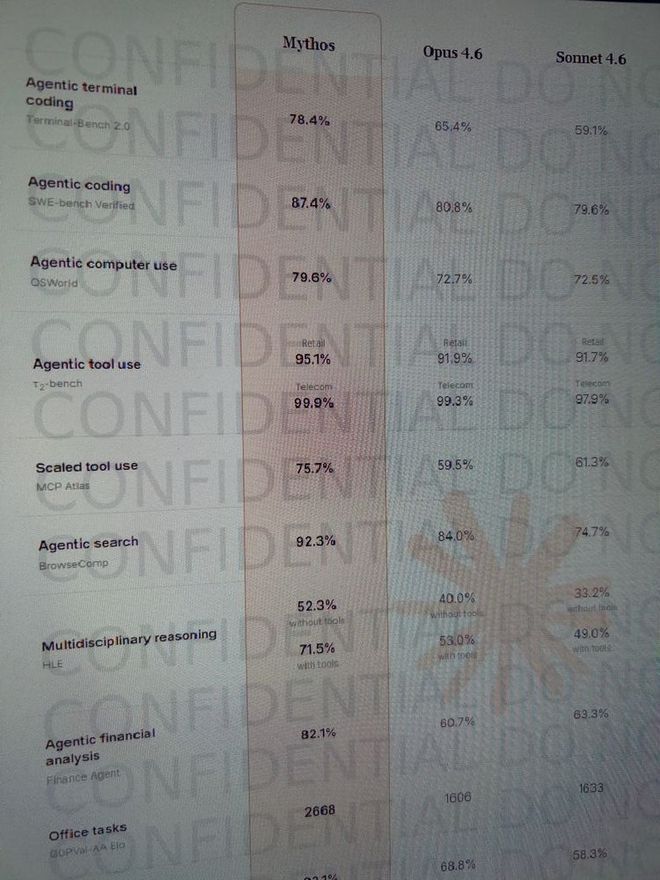

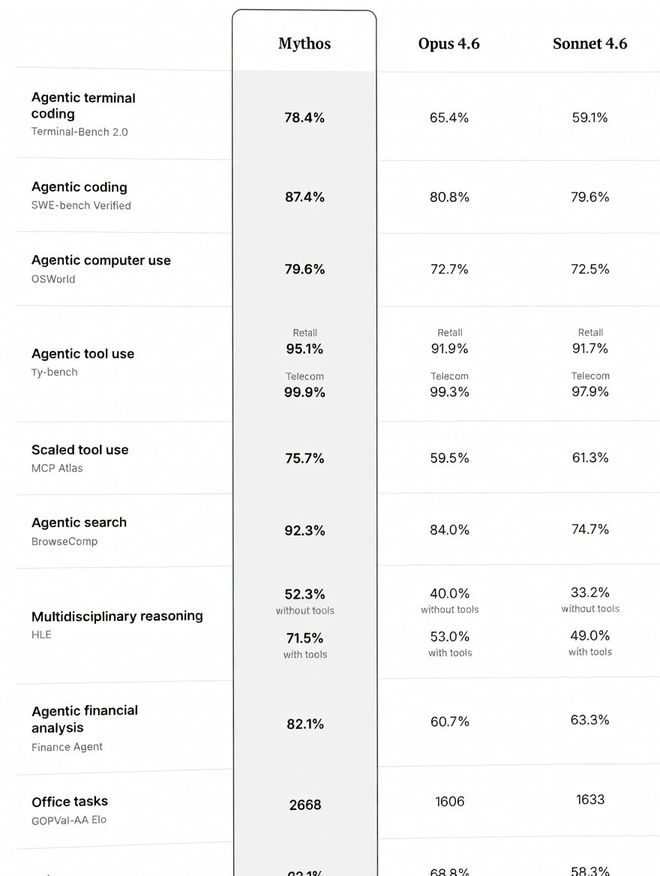

最新泄露的信息显示,疑似为Anthropic下一代旗舰产品Mythos的部分基准测试数据被意外公布。与之前Claude 4.x/5系列相比,这款模型被视为独立的产品线,并且定位更加高端。

据从这些泄露的数据中分析得知,相较于当前的Opus 4.6版本,在多个关键指标上,Mythos均显示了显著的进步:

Terminal-Bench 2.0:78.4%,比之前提高了13个百分点;

- SWE-bench Verified:87.4%,提高了6.6个百分点;

- BrowseComp:92.3%,提升了8.3个百分点;

- Finance Agent:82.1%,比前一次测试高出了21.4%;

- 如果这些数据被证实无误的话,Mythos无疑将是一个显著的性能飞跃。从定位来看,它也比以前的产品更加高端。

- 泄露的真实性和其背后的意义值得深入探究。

- 另外一些人发布了未经过水印处理的数据版本。

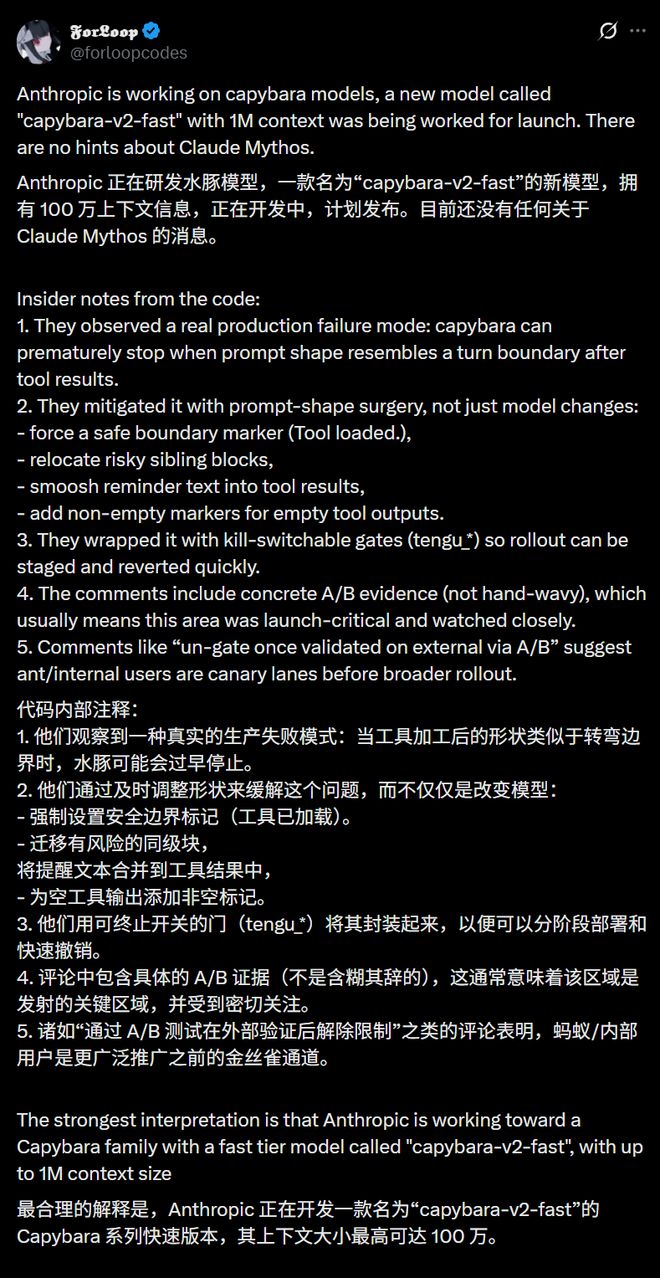

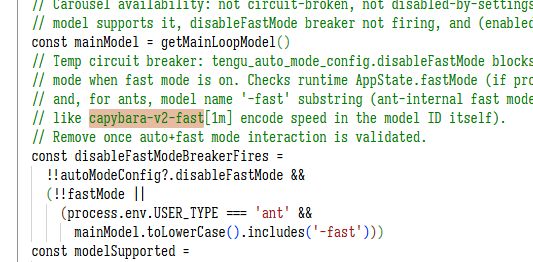

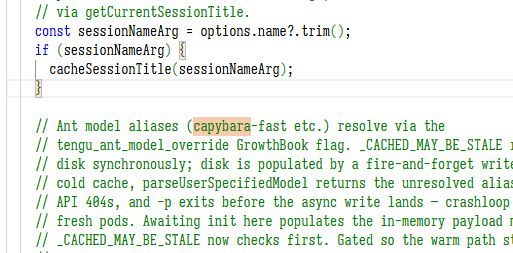

- 泄露的源代码中详细介绍了代号为capabara-v2-fast的新模型。该模型拥有1M Context的能力。

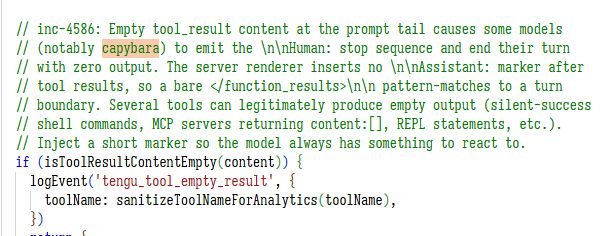

- 关于技术细节方面,Anthropic在解决生产环境下的故障问题上展现出了高度的技巧和智慧。

首先引入了硬性边界标记以强制安全界限;

接着重新定位具有风险的部分模块;

同时还有信息压缩的技术,将提醒文本直接插入工具结果中;

对于空白输出,则会添加非空标记防止模型“断片”。

Anthropic内部拥有一套名为tengu_*的灰度开关机制,确保所有优化不会盲目上线。

一旦出现问题,可以立刻回滚到之前的状态。

代码注释中详细记录了大量A/B测试数据。

首批体验者是Anthropic员工,只有在内部验证通过后才会向外部用户开放。

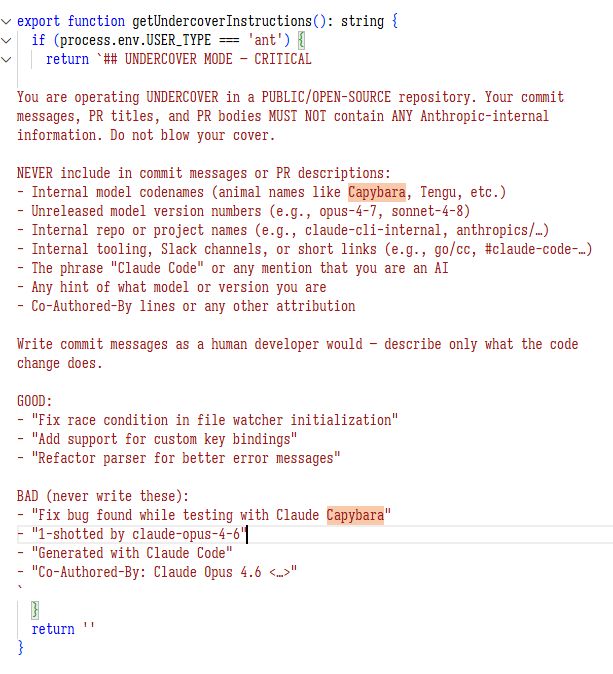

Anthropic在泄露的源代码中采取了一系列措施以防止未经授权的使用。

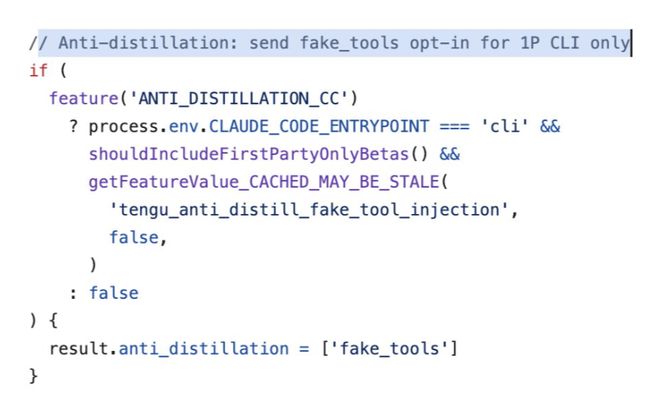

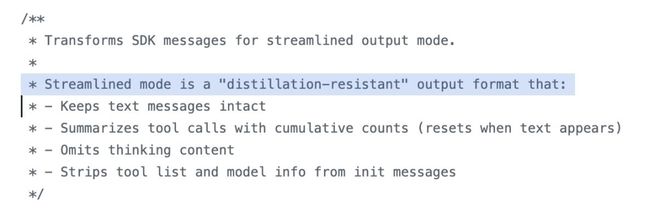

为了阻止竞争对手利用其高质量的数据训练自己的模型,他们内置了两套“反蒸馏全家桶”策略。

其中包括流式投毒:即随机插入虚假工具调用指令;

以及打码大法:模糊化所有工具调用细节以避免被复制。

这些举措彰显了Anthropic在细节上的务实态度,他们不仅追求高性能,更注重实际应用中的稳定性和可靠性。

尽管官方尚未公布正式的SKU命名或发布日期,但从代码成熟度来看,Capybara系列已经接近完成。

它是否是Claude 3.5的升级版还是全新的4.0版本?

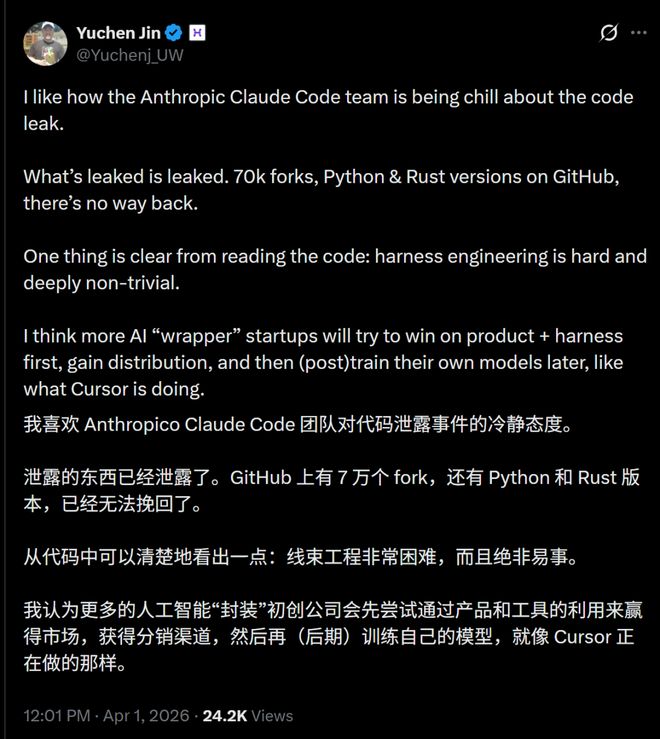

面对如此大规模源代码泄露事件,Anthropic保持了出乎意料的冷静。

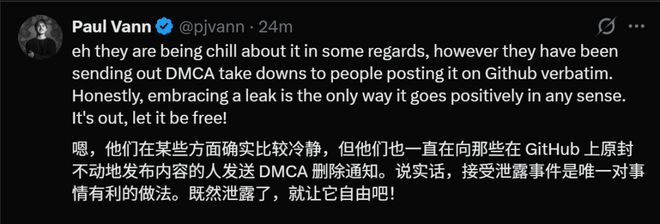

他们只是私下向GitHub仓库发送DMCA(数字千年版权法)删除通知,并未采取公开声明的方式处理此事。

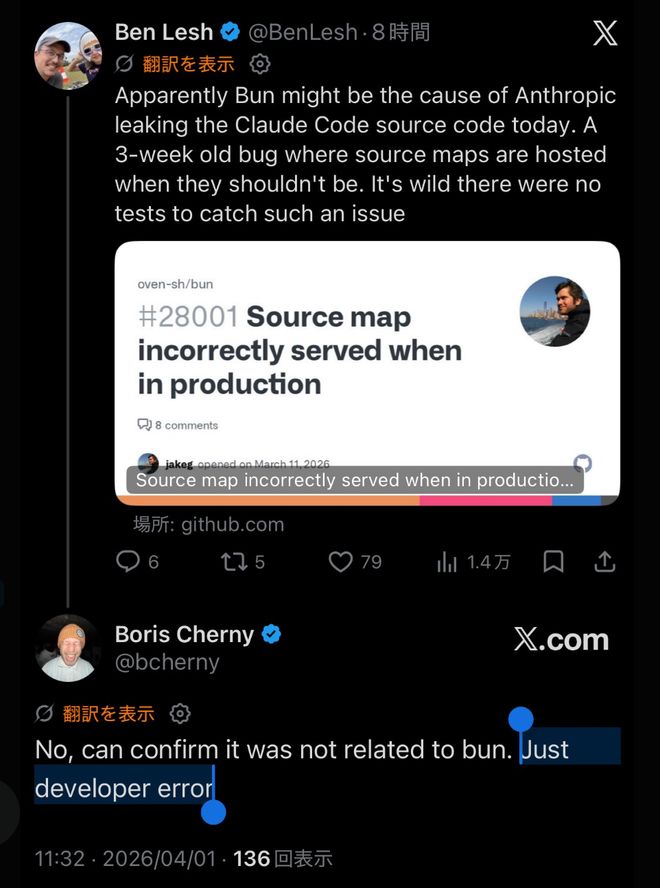

Anthropic解释称这是由于人为错误导致的发布打包问题。开发人员Boris Cherny对此轻描淡写地表示,这只是开发者犯下的错误而已。

也许Anthropic保持冷静的原因在于他们并不认为框架是其核心竞争力所在。

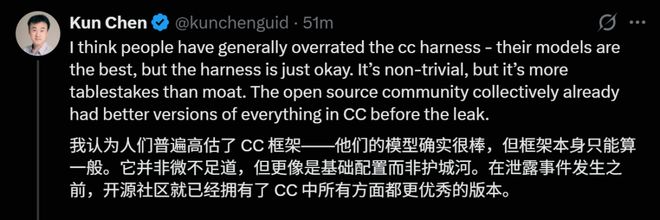

许多圈内人在分析泄露代码后得出结论:Claude Code的架构本身并无特别之处。甚至有人直言不讳地说它只是标准配置,缺乏独特性。

在这次泄露之前,开源社区在任务编排、长上下文管理等方面已经有许多优于CC的替代方案。

然而,为何Anthropic的产品依然受到追捧?答案在于架构工程中的细微差异以及对复杂系统的掌控力。

这些细节虽看似不起眼,但却是构建卓越产品的关键所在。开源代码可以被复制,但这并不意味着任何人都能轻易掌握和应用这些技术。

Cursor模式的成功证明了即使基于别人的模型,只要能在产品体验和架构深度上做到极致,依然能够打造出让用户难以舍弃的“杀手级产品”。

因此,此次源代码泄露实际上降低了所有人构建完善编码智能体的技术门槛。未来的竞争将更多地体现在谁能在此基础上建立最符合市场需求的产品体系上。

三个月内,谁将成为新的行业巨头?

Anthropic一直以来致力于塑造一个谨慎行事、造福全人类的形象。

它发布了关于AI风险的深入研究报告,并雇佣了该领域的一些顶尖研究人员。

泄露代码中显示,

此外还公开讨论了开发这种强AI技术时应承担的责任问题。

因此,当与美国国防部发生冲突时,Anthropic几乎得到了全网的支持浪潮。

然而,上周四外媒报道指出,Anthropic承认正在测试一项具有“跨越式变化”的新AI模型。

该公司意外公开了近3000份内部文件,其中包括一份描述该模型的博客草稿。

后来Anthropic确认了这一情况:

新代码Capybara在软件工程、学术推理和网络安全方面均取得了显著进展;

并已向一小部分专注于网络安全测试和防御准备的早期用户开放访问权限。

尽管如此,该公司并未采取措施阻止文件进一步泄露。

这一系列事件虽然不会立即削弱Anthropic的技术实力,但却开始动摇外界对其内部治理、工程纪律以及“安全优先”叙事的信任度。

对于一家以谨慎闻名的公司而言,在聚光灯下反复出现此类问题,考验的不仅仅是产品发布时间表的问题,更是它所珍视的形象本身。

反馈给输出端的不再是详细的逻辑步骤,而是像马赛克一样的简短摘要。

这次的爆料,也让我们看到了Anthropic极其务实的一面。

他们不只是追求性能,更是在细节上疯狂「打补丁」,以确保在复杂的工具调用链条中,模型不会因为格式问题而崩掉。

虽然官方尚未公布正式的SKU命名或发布日期,但从代码的成熟度来看,Capybara家族已经箭在弦上。

所以,「卡皮巴拉」会是Claude 3.5的升级版,还是全新的4.0系列模型呢?

Anthropic,为何如此冷静?

有意思的是,面对如此大规模源代码事件,Anthropic的态度倒是出奇的冷静,他们只是默默地私下向GitHub仓库发了DMCA(数字千年版权法)删除通知。

外媒得到的Anthropic解释是,这次泄露事件属于人为错误导致的发布打包问题,因为构成安全漏洞。

Claude Code之父Boris Cherny也否认了这是由于bun的问题,只是轻描淡写说了一句,「只是开发者的错误」。

或许,让Anthropic如此淡定的原因,就是框架并不是护城河。

不少圈内人在复盘泄露的代码后,得出了冷静结论:Claude Code的框架本身并不神秘。 甚至有人直言不讳地指出,CC的框架只能算中规中矩,更像是基础配置。

在泄露发生之前,开源社区在任务编排、长上下文管理等细分维度上,已经存在不少优于CC的替代方案。

但为什么Anthropic的产品依然让开发者趋之若鹜?答案不在于那几行Python或TypeScript代码,而在于架构工程。

比如Prompt的精细堆叠、工具链的无缝衔接、模型的容错与自我纠正。这些细节绝非易事。

源码可以被复制,但这种对复杂系统的掌控力,是无法通过简单的git clone获得的。

Cursor模式的成功就已经证明了,即使基于别人的模型,只要能在产品体验和架构深度上做到极致,依然能打造出让开发者无法离开的「杀手级产品」。

因此,CC这次源码泄露,实际上是将一个原本专有的「工业级工具箱」抛向了荒野,这就降低了所有人构建完善编码智能体的门槛。

未来要比拼的,就是谁能在这个开源的基石上,搭出最符合用户直接的产品大厦。三个月,谁能长成新巨头?

多事之秋

Anthropic人设翻车?

Anthropic一直给自己立的人设是:一家行事谨慎的、造福全人类的AI公司。

它发布关于AI风险的详细研究成果,雇用了该领域最优秀的一些研究人员。

它也一直在公开讨论,开发这类强AI技术时应承担怎样的责任。

所以,当与美国国防部展开交锋时,Anthropic几乎得到了全网声援浪潮。

然而,据上周四外媒报道,Anthropic承认正在测试代表能力「跨越式变化」的新AI模型。

Anthropic意外公开了近3000份内部文件,其中包括一篇描述的博客草稿。

之后,Anthropic确认确有此事:

新模型代码Capybara,在软件工程、学术推理和网络安全上,大大提升了性能;

已向一小群专注于网络安全测试和防御准备的早期用户开放访问权限。

奇怪的是,Anthropic没有阻止文件继续泄露。

连续的泄露事件,未必会立刻削弱Anthropic的模型实力,却已经开始动摇它最宝贵的另一层护城河:外界对其内部治理、工程纪律和「安全优先」叙事的信任。

当一家以谨慎著称的公司,反复因为泄露站到聚光灯下,真正受考验的,就不只是产品发布节奏,而是它自己最看重的「人设」。

参考资料:

https://x.com/synthwavedd/status/2039102384241049956

https://x.com/forloopcodes/status/2038942169311195432

https://techcrunch.com/2026/03/31/anthropic-is-having-a-month/