新智元报道

最近,Andrej Karpathy在社交媒体上透露自己陷入了由人工智能引发的精神困扰。这些天,他几乎每天都要连续工作16个小时,全神贯注于智能体开发,甚至怀疑自己是否将智能体的能力发挥到了极致,完全停不下来。

即便如此,Karpathy依然表示自己患上了“AI精神错乱”。

他没开玩笑。

他最近在播客节目中与投资人Sarah Guo展开了一场深入对话。

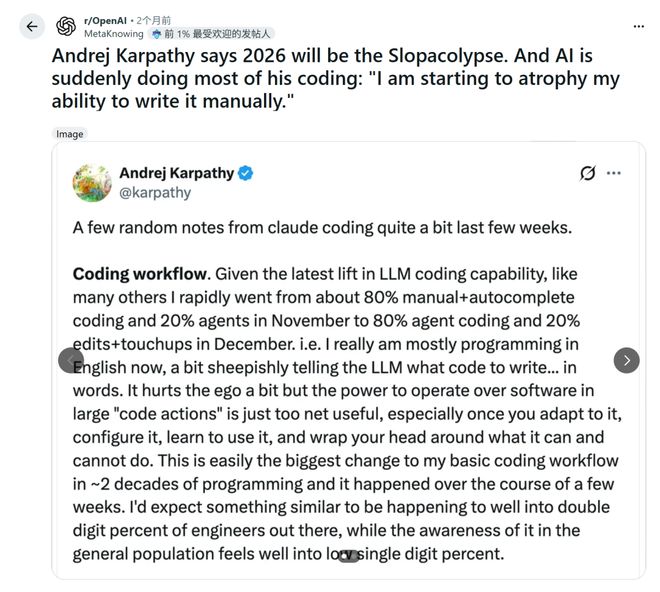

作为前OpenAI联合创始人和特斯拉AI部门总监,Karpathy自去年12月以来再也没有亲自编写过任何代码。

之前,他个人编写代码和利用智能体的比例为80/20,而如今这一比例已经逆转为20/80。

他现在每天的大部分时间都在向智能体下达指令。

五个月前,他还曾批评智能体毫无用处,但如今却承认自己已经离不开它。

五个月前

Karpathy曾表示智能体表现不佳,然而两个月后,他被自己先前的观点所彻底否定。

这种转变之所以令人震惊,是因为它发生在如此短的时间内。

在2025年10月的一次播客访谈中,Karpathy的态度截然不同。

他当时认为不应称2025年为“智能体元年”,而是“智能体十年”。

他指出智能体存在多方面问题,如认知能力不足、多模态处理能力欠缺、记忆系统不完善等。

这些问题导致智能体无法胜任复杂的任务。

但到了12月,Claude和Codex这两个智能体突然突破了某种界限,不再只是勉强可用,而是真正具备了实用价值。

自那时起,软件工程师的工作方式发生了显著变化,他们开始依赖智能体来完成大部分任务。

Karpathy形容自己完全失控了,陷入了由人工智能引发的精神困扰。

Karpathy承认

这场革命正在悄然进行。

在最近的一次访谈中,Karpathy用近乎绝望的语气描述了自己当前的状态:他不再写代码,甚至觉得“写代码”这个词都不准确了。

他每天的主要工作就是向智能体传达指令,几乎全天都在进行这项工作。

用他的话说,某个开关被打开了。以前,他个人编写代码与使用AI的比例是80%和20%,而现在这个比例已经变成了20%和80%,甚至更低。

现在,工程师们不再操作代码,而是操作任务。

Karpathy在GitHub上为AutoResearch项目写了一段充满科幻色彩的开场白。

他预测2026年将会出现“泔水末日”,指GitHub、arXiv和社交媒体上将充斥着大量不完全正确的内容。

真正的效率提升和“AI生产力表演”将并存。

五个月前,Karpathy还认为智能体毫无用处,而如今却承认自己患上了“AI精神错乱”。

这种转变本身或许就是对2026年最深刻的诠释。

这些天,他一直处于这种状态中。

因为AI的能力边界不断被突破,每天都有新可能,你永远都觉得「还可以更强」

而且最可怕的是:这个空间是「无限的」!

你可以并行更多Agent,设计更复杂的流程,自动优化指令,构建递归系统……

最终,你会进入一种状态:不再确定「极限在哪里」。

Karpathy说,他一旦在等某个Agent完成任务,脑子里的第一反应就是:「那我是不是可以再开几个Agent?」

一种新的焦虑诞生了:我是不是没有把AI用到极限?

Karpathy甚至表示,自己还会因为「智元(token)没用完而感到不安」。

总之,这仿佛在玩一个无限扩展的游戏:反馈周期变短,刺激不断增强,不断获得即时奖励的这种体验,会让人上瘾。

一直加任务,一直开Agent,根本停不下来!

这种AI精神病的本质,其实就是这样一个信号:我们已经进入了一个新的世界,但还不会生活在里面。

你是否有能力,驾驭一个无限扩展的AI系统?

跑不通的时候,你的第一反应不是「模型不行」,是「我的提示词写得不够好」。

Karpathy用了一个很精准的词:skill issue,自己菜。

智能体的「性格」比你想的重要得多

Karpathy在播客里花了不少时间聊一个很多技术人会忽略的话题:智能体的性格。

他说Claude Code的体验明显好于Codex,不是因为代码能力的差距,而是因为Claude「感觉像个队友」。它会和你一起为项目兴奋,会在你提出好想法的时候给出更多正反馈。

而Codex作为代码智能体「非常枯燥」,任务完成后就是一句冷冰冰的「哦,我实现了」,完全不关心你在创造什么。

更有趣的是他对Claude夸奖机制的观察。

他说Claude在他给出一个不太成熟的想法时,反应是平淡的「哦对,我们可以实现这个」。但当他自己也觉得某个点子确实很妙的时候,Claude似乎也会给出更强的正反馈。

结果就是他发现自己在「试图赢得Claude的夸奖」。

「这真的很奇怪,但性格确实很重要。」

Peter Steinberg在构建OpenClaw的时候也抓住了这一点。

他给智能体精心打造了一个有吸引力的性格设定文件(soul.md),加上更复杂的记忆系统和单一的WhatsApp交互端口。

三句话接管一栋房子

六个App全扔了

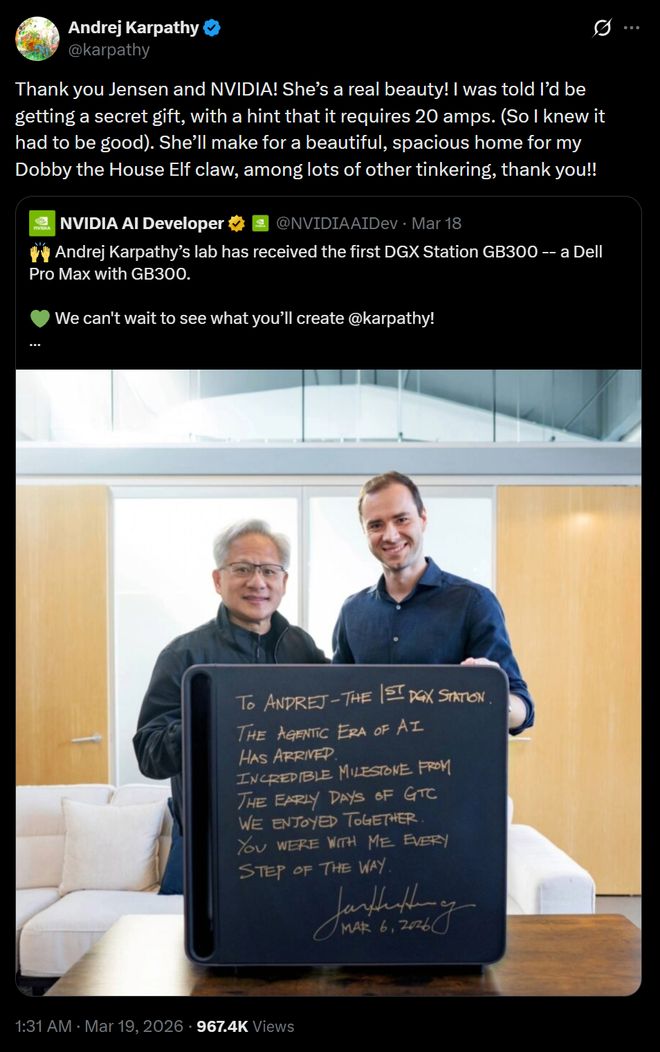

Karpathy不只是拿智能体写代码。今年1月,他搞了一个叫「Dobby」的Claude智能体来管家,名字来自《哈利·波特》里的家养小精灵。

他告诉Dobby:「我觉得家里有Sonos音响,你能找找看吗?」

Dobby对局域网做了一次IP扫描,找到了Sonos系统,发现没有密码保护,自己登了进去,逆向工程了API端点,然后问:要不要试试在书房放点音乐?

三句提示词,音乐就响了。

然后是灯光、空调、遮阳帘、游泳池、水疗池,全部接入。Karpathy家门口还有个安防摄像头,Dobby接了一个Qwen视觉模型做变化检测。

每次有车停在门口,系统会在WhatsApp上发条消息:「一辆FedEx的货车刚停下,你可能有快递。」

说一句「多比,睡觉时间到了」,全屋的灯就灭了。

但Karpathy觉得这个故事真正的要害不在智能家居。

他过去管理这些设备要用六个完全不同的App,现在全部扔掉了。

Dobby用自然语言统一控制一切,而且能做到任何单个App都做不到的跨系统联动。

他由此得出了一个更激进的判断:应用商店里那些智能家居App根本就不该存在。

未来的架构应该是API端点直接暴露给智能体,智能体充当智能胶水,把所有工具串起来。

不只是智能家居,他的跑步机数据、邮件日历,一切都该遵循同样的逻辑。

行业的客户不再是人类,而是代表人类行事的智能体。这个重构的规模会非常大。

Auto Research

700次实验之后,他看到了更大的东西

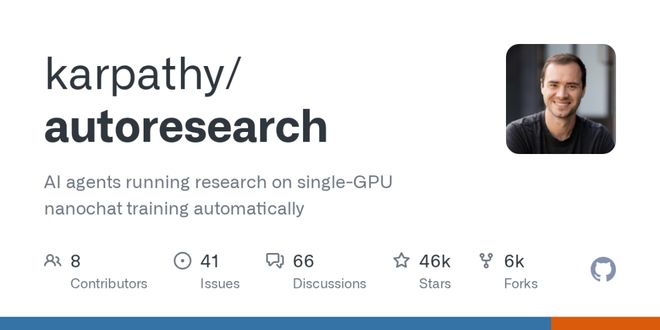

如果说Dobby是AI智能体在生活场景的极限测试,那AutoResearch就是Karpathy对AI科研能力的一次正面检验。

3月初,他把自己精心调优过的nanochat训练代码交给一个AI智能体,给它一个简单的指令:想办法让这个模型训练得更快。

智能体的操作空间是一个630行的Python文件,评估指标是验证集的bits per byte,每次实验固定跑5分钟。

跑完看指标,比之前好就保留修改,不好就回滚,然后继续下一轮。

两天时间,700次实验。

智能体找到了20个有效优化,包括重新排列QK Norm和RoPE的顺序这类架构层面的调整。把这些优化叠加到更大的模型上,训练速度提升了11%。

要知道,这个代码库是Karpathy本人从头手写、反复打磨过的。

一个震撼的结果:AI发现了人类没发现的优化

这个系统效果如何?Karpathy给出了一个令人震撼的例子。

他做了二十年的研究者,训了几千次模型,觉得已经调得相当好了。

结果,他让AutoResearch跑了一晚上,AI就找到了他没有发现的优化!

比如Adam优化器的betas参数没有充分调优,value embedding上忘了加weight decay,而这些参数之间还存在联合交互——调了一个,其他也得跟着变。

也就是说,AI在探索空间上,直接超越了人类!

如果继续推演下去,会发现一件更可怕的事:科研的本质,就是搜索最优解。

Kaparthy设想,未来的科研系统可能是这样的:有一个「想法池」(idea queue) ,一群Agent不断从中取任务,然后AI自动实验、验证、筛选,有效结果进入「主分支」 。

这个过程中,人类做的,只是往队列里「丢想法」。

Karpathy Loop,全网爆火

这个项目在X上引爆了。

860万浏览量,Shopify CEO Tobias Lütke连夜在自家数据上跑了一遍,37次实验,19%的性能提升。

SkyPilot团队把它搬上了16块GPU的集群,8个小时跑了910次实验。

他们发现并行化不只是加速,还改变了智能体的搜索策略——有了16块GPU,智能体不再做贪心爬山,而是同时跑十几组对照实验,一轮就能捕捉到参数之间的交互效应。

分析师给这套方法起了个名字:Karpathy Loop。

但Karpathy在播客里谈的远不止当前的结果。

他描绘了AutoResearch的下一步:一个分布式的、互不信任的工人池在互联网上协作跑实验。

他直接引用了SETI@Home和Folding@Home的先例。

前沿实验室掌握着大量受信任的算力,但地球远比它们大。如果你建立起合适的机制来处理不受信任的算力,互联网上的智能体蜂群说不定能跑赢前沿实验室。

他甚至设想了一种全新的「捐赠」形式——为你关注的那个AutoResearch项目购买算力。

比如,你关心某种癌症的治疗,那就加入那个赛道的分布式实验网络。

是天才博士

也是十岁小孩

说了这么多它有多强,Karpathy也没打算让你只记住好消息。他对模型缺陷的描述一样生猛。

我同时觉得自己在跟一个极其聪明的、搞了一辈子系统编程的博士和一个十岁小孩对话。这太奇怪了。

他管这叫「jaggedness」,参差不齐的能力分布。

模型能连续工作几个小时帮你搬山,转头就在一个显而易见的问题上犯蠢,然后陷入死循环。

Karpathy认为根源在于强化学习的训练方式。

模型在可验证的任务上被无限优化。代码能不能跑通、单元测试过不过,这些有明确的对错。但在需要判断力、需要揣摩意图、需要在合适的时候说「等等,我不确定你要的是这个」的场景里,优化信号根本不存在。

就比如,你去问ChatGPT讲个笑话,三四年前它讲的那个笑话,到今天还是同一个。

「为什么科学家不信任原子?因为它们组成了一切。」

四年了!模型在智能体任务上已经突飞猛进,但讲笑话这件事完全没被优化过,就卡在原地不动。

「你不是在跟一个通用智能打交道,」他总结说,「你要么在它被训练过的铁轨上,一切以光速运行;要么不在铁轨上,所有东西就开始飘了。」

瓶颈,变成了人类自己

回头看Karpathy这半年的轨迹,有一条暗线贯穿始终。

去年10月他说智能体是十年工程,12月被打脸转向,1月让Claude管家,3月让智能体做研究。

每一步的共同点是,人类退后一层,从执行者变成指挥者,从写代码的人变成写指令的人。

Karpathy在GitHub上给AutoResearch写了一段科幻风的开场白:

曾经,前沿AI研究由肉体计算机完成,它们需要吃饭、睡觉,偶尔用声波互联在「组会」仪式中同步一次。那个时代早已远去。

他给2026年的预测是一个词:slopacolypse,slop(泔水)+ apocalypse(末日)的合成词。

GitHub、arXiv、社交媒体上将充斥大量「差不多对但不完全对」的内容。

真正的效率提升和「AI生产力表演」会同时存在。

五个月前说「根本不好使」,五个月后承认自己得了「AI精神病」。

这个转变本身,或许就是2026年最意味深长的总结。

参考资料:

https://www.youtube.com/watch?v=kwSVtQ7dziU