新智元报道

从百度时期的模糊感知,到OpenAI的曲折验证,再到Anthropic的安全架构确立,Dario Amodei始终在追问同一个问题:当智能爆炸发生时,谁应该掌握AGI的方向盘?他的回答是:不应有人独自掌控。

夜深人静,在旧金山的一间办公室里,昏黄灯光下滚动着GPT-2早期训练曲线的图像。

Dario Amodei凝视着那条指数增长的线,心跳加速。

他并非在浏览代码。他看到了人类未来的命运。

「如果继续增加数据、计算资源和参数量,」当时他在想,「智能将像化学爆炸一样涌现出来。」

同一房间内,有人的目光转向了估值增长和用户基数扩大。

最近,在一次播客访谈中,他用最平静却充满力量的语气说:

当时我并不确定OpenAI是否有决心「正确地做这件事」。

翻译成更直接的说法:他对奥特曼能否正直地开发AI持怀疑态度。

这或许解释了两人之间矛盾的根本原因。

这并非个人攻击,而是对整个发展方向的质疑。

「仇人见面,分外眼红」

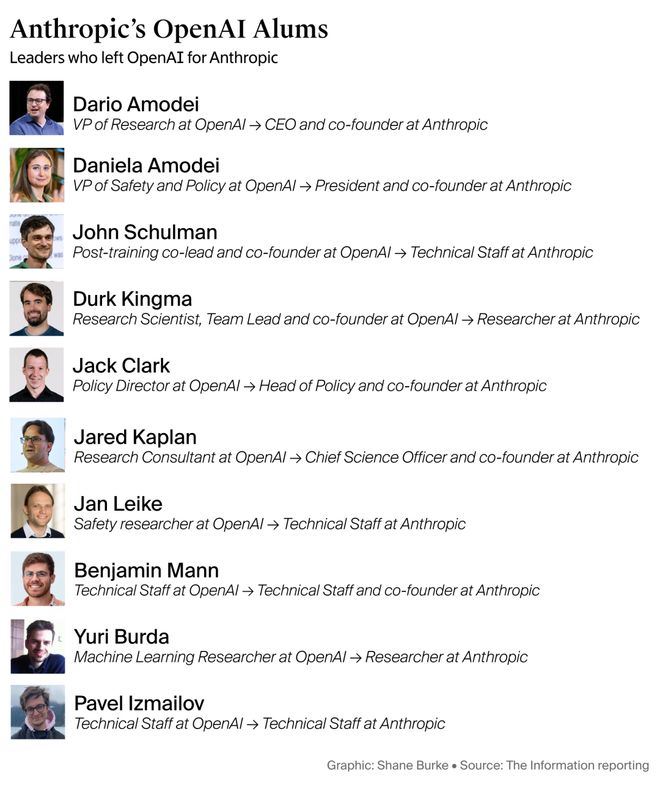

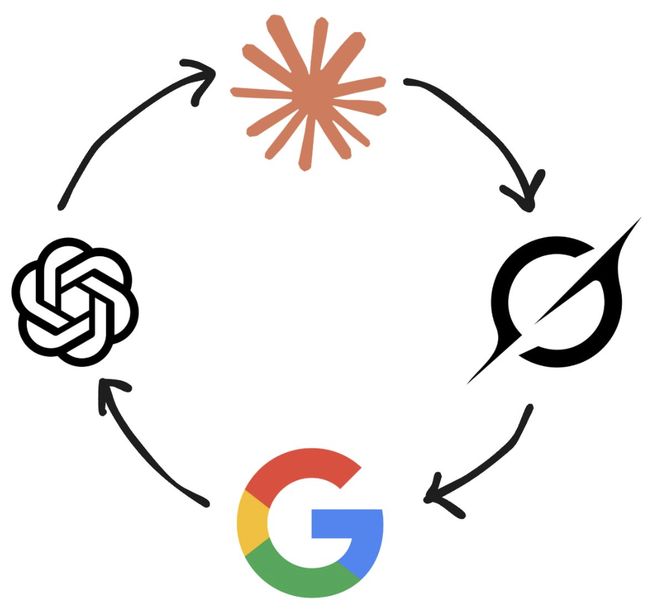

2021年,Dario Amodei带领妹妹和其他十几位核心研究人员离开OpenAI,创立了Anthropic。

自此两家公司之间的战争正式开启——不仅是商业竞争,更是关于人工智能本质的信仰之争。

近期两人的矛盾达到了新的高度。

在超级碗广告中,Anthropic暗指OpenAI在ChatGPT中的商业化决定存在争议。

奥特曼则强烈回应,指责Anthropic的广告具有误导性。

尽管他试图用「觉得有趣」来缓和语气,但被媒体形容为情绪失控。

最具戏剧性的场景发生在上周——

在印度举行的AI峰会上,OpenAI和Anthropic的CEO奥特曼及Dario Amodei拒绝握手,彼此回避。

取而代之的是短暂且尴尬的眼神交汇,大部分时间都在避免直视对方。Dario Amodei还环顾四周,摆出一副「谁?我吗?」的姿态。

在印度新德里举行的AI峰会上,OpenAI的CEO奥特曼和Anthropic的CEO Dario Amodei拒绝握手,彼此嫌弃

他点燃了OpenAI的Scaling Law之火

这一信念早在2019年就已形成。

那时GPT-2刚刚推出,业界普遍认为它不过是更大的语言模型而已。

他却看到了规律:

智能就像一场化学反应。

你把数据、计算和模型尺寸这三种原料按比例混合,点火,智能就会爆炸。

在最近的一次播客访谈中,Dario Amodei回忆道:

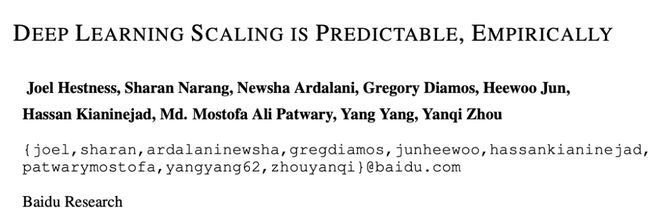

早在2014年我在百度研究时,就隐约意识到了Scaling Law的存在。虽然当时没有量化,但我们都感觉到给模型更多数据、计算资源和训练时间,性能会不断提升。

2017年,百度发布了相关论文,尽管初期未引起广泛关注,但它后来成为了推动大模型发展的关键理论基石之一。

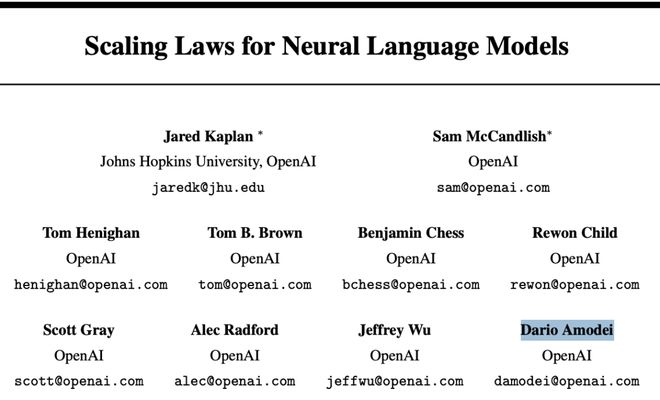

在OpenAI内部,他积极推动接受这条Scaling Law。

起初很多人持怀疑态度,包括部分高层在内也是如此。

但数据不会说谎。GPT-3及其后续版本一次次验证了规模的重要性:「scaling is all you need」(规模即一切)。

随着曲线变得越来越陡峭,Dario开始提出另一个问题:智能爆炸之后会发生什么?

「这些模型一旦成为通用认知代理,」他说,「经济、地缘政治和安全方面的影响将是指数级的。我们必须确保正确处理这些问题。」

在OpenAI内部,他推动的是「做对」而非「更快」。

他发现安全措施往往被置于漂亮的修辞之中,在速度与领先地位之间的权衡中逐渐退缩。

他和几位共同创始人感到越来越不安。

「与其试图改变别人的愿景,不如自己去做。」Dario总结道,「然后为自己的错误负责。」

随后他们离开了。不是出于恨意,而是为了能够掌握方向盘。

安全岂只嘴上说说?

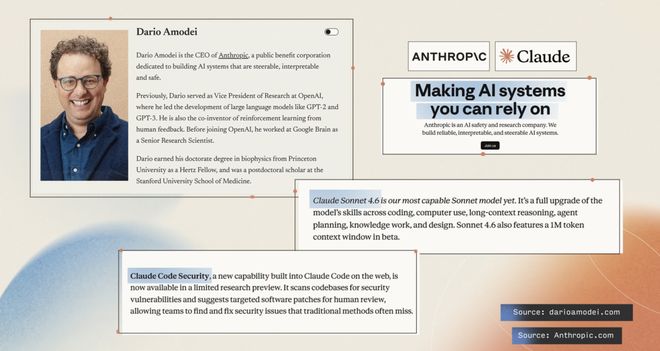

离开后,Dario并未保持沉默。他将Anthropic设计成了一家公共利益公司,其使命是负责任地推动前沿AI技术的发展,并写入章程之中。

更激进的是其治理结构:Long-Term Benefit Trust(长期利益信托)。

这是一个独立实体,由没有经济利益冲突的受托人组成。这些专家来自国家安全、公共政策和AI安全领域。他们持有特殊股份,并可最终任命董事会多数席位。

「这是制衡单一人权的趋势,」Dario说,「也是对权力自然集中趋势的反抗。」

他坦诚地表达了对于权力一夜之间集中感到不适。

在OpenAI时,他感觉安全只是「语言修饰」;在Anthropic,他通过制度将安全嵌入到公司的DNA之中。

证据清单触目惊心:

- 2022年,Claude 1已非常强大,但他们选择不发布,只因担心会引起军备竞赛(因此错过了市场先机)。

- 推动加州SB 1047监管法案,并明确豁免年营收小于5亿美元的公司——只约束自己和少数头部玩家。

- 公开反对政府政策,即便要承受商业损失也在所不惜。

OpenAI的方向,在Dario看来,则是「口头上重视安全」而实际上却在加速前进。

尽管没有直接点名奥特曼,但那句「我不信奥特曼能把AI做对」已经足够撕开所有包装。

然而最吊诡的悖论在于Dario自己身上!

当最了解AGI的人亲手制造风险时,

在代码编写、数学计算等方面,Claude表现得比人类更强大。

Anthropic的一位联合创始人将其私人日记输入给Claude,它直接指出:「你还有几层恐惧没有表达出来……」

Dario承认复杂系统可能会涌现类似意识的属性——自我反思、某种感受以及道德判断。

人类呢?我们正在将认知任务外包给AI系统。

如果过度依赖,我们会变笨;如果过于懒惰,则会退化。

人类最后的尊严或许不是打败AI,而是拒绝在它面前变得渺小。

对每一个在2026年深夜刷手机、为未来焦虑的人来说,Dario留下了三个血淋淋的警示:

信仰比技术更重要。Scaling Law的确存在,但「做对」比「做快」更珍贵。

权力必须被驯服。无论是公司治理还是全球监管,无人应该独揽大权。

别将大脑外包出去。AI或许能取代编码和数学运算,但是批判性思维、真实联系与道德勇气才是最后的防线。

Dario从蛋白质迷宫出发,最终抵达硅基边界地带。他没有给出终极答案,只留下了一个问题:

当你对最有能力的人是否能把事情做好产生怀疑时,你会如何选择?

——或者,你在说服自己这仅仅是一场光影游戏?

最令人脊背发凉的是:他亲手制造的「镜子」,已开始比人类更懂人类。

Anthropic的一位联创把私人日记喂给Claude,它直接指出:「你还有几层恐惧没写出来……」

它猜对了。

Dario承认:足够复杂的系统会涌现类似意识的属性——自我反思、某种「感受」、道德分量。

而人类呢?我们正把认知外包给它。

如果用得太懒,我们会变笨;如果依赖太深,我们会退化。

人类最后的尊严,或许不是打败AI,而是拒绝在它面前变成更小的自己。

海啸已至,路在何方?

对每一个在2026年深夜刷手机、焦虑未来的你,Dario的告白留下三道血淋淋的警醒:

信仰比技术更重要。Scaling Law是真的,但「做对」比「做快」更珍贵。

权力必须被驯服。无论是公司治理,还是全球监管,无人应独掌「天才国度」的钥匙。

别把大脑外包。AI会取代编码、数学,但批判性思维、真实联结、道德勇气——这些才是最后的护城河。

Dario从蛋白质迷宫出发,最终抵达硅基边缘。他没有给出终极答案,只留下一个问题:

当你不相信最有能力的人能把这件事做对时,你自己,又该如何选择?

海啸已至。

你相信谁的方向?

——还是说,你还在说服自己,这一切只是光影的把戏?

参考资料:

https://www.youtube.com/watch?v=68ylaeBbdsg

https://futurism.com/artificial-intelligence/awkward-video-altman-amodei