AI改变了战争。

今年3月,在伊朗德黑兰周边地区,军事设施遭遇了频繁攻击,这是一场以算法为驱动的智能作战行动。

同时,美国华盛顿和硅谷之间也正在进行一场有关AI伦理、战争规范及产业主导权的战略博弈。

在这一背景下,白宫与五角大楼正采取前所未有的强硬措辞向AI巨头Anthropic施压;与此同时,美军前线指挥官却发现他们对该公司开发的Claude模型有着无法割舍的高度依赖性。

一、速度革新:算法推动战场效率飞跃

当美军建议发起首轮打击行动时,情报处理与目标分配的速度引发了许多军事观察家的关注。传统作战中,从收集到分析再到下达指令的过程(OODA循环)受到人力限制,而此次行动则展示了接近实时转化的能力。

支撑这种能力的主要是五角大楼部署的“Maven智能系统”。

· 系统架构:该系统的构建主要依靠大数据公司Palantir的技术支持。

· 关键技术:Claude模型深度嵌入了Anthropic公司的开发成果。

根据知情人士的消息,通过整合卫星图像、无人机侦察、电子监听及各类传感器的数据,“Maven系统”形成了一个战场“数字底座”。而Claude的作用在于利用其先进的语义分析和逻辑推理能力从海量信息中提炼出有价值的军事情报。

专家们指出,这套系统的功能已经远远超出简单的数据检索。在实际操作中,借助搭载了Claude的系统,可以迅速提出打击方案,并生成精确坐标,甚至根据目标的战略价值自动排序。这种协作模式将原本以“周”为单位的工作周期缩短至“小时”,乃至“分钟”级别,极大地压缩了对手的防御时间。

二、效能革命:AI技术重构情报参谋体系

在基层作战单元中,AI对战争效率提升的效果尤为显著。

根据乔治城大学的研究报告,在美军第18空降兵团采用这一智能化系统后,一个仅有20人的情报处理小组就能完成以往需要2000名参谋人员才能完成的工作量。这种工作效率的飞跃使前线指挥部对该技术产生了深度依赖性。

美军中央司令部副作战主任利亚姆·胡林曾公开表示,Maven系统现在能够实时处理来自179个不同渠道的数据源,并且从阿富汗撤军到目前中东地区的高强度冲突中,AI已逐步从实验室测试转向实战应用。

“关键的范式转变在于,AI使军事部门能够在‘机器速度’而非‘人类速度’下开发打击方案。”新美国安全中心副主任保罗·夏雷如是说。

三、严重分歧:国家安全与技术伦理之争

尽管技术表现突出,但华盛顿高层和Anthropic公司之间爆发了严重的矛盾。

在相关军事行动即将启动之际,美方宣布禁止政府机构继续采购Anthropic的AI工具,并要求国防部在六个月内完成技术替换。国防部长皮特·海格塞斯对Anthropic“技术利他主义”的条款表示强烈不满,认为这限制了部队反应能力和战场安全。

争议的核心在于如何控制技术。

Anthropic首席执行官达里奥·阿莫代坚持为AI军事应用设定三条“红线”:

· 反对大规模监控:禁止利用模型分析美国公民社交媒体等敏感数据。

· 拒绝完全自主攻击:坚持人类参与决策闭环,反对AI独立触发致命武器。

· 伦理限制条款:在合同中加入条款防止模型被用于可能导致过度附带伤害的行动。

部分官员认为,这些伦理约束对战术自由度构成了严重限制。

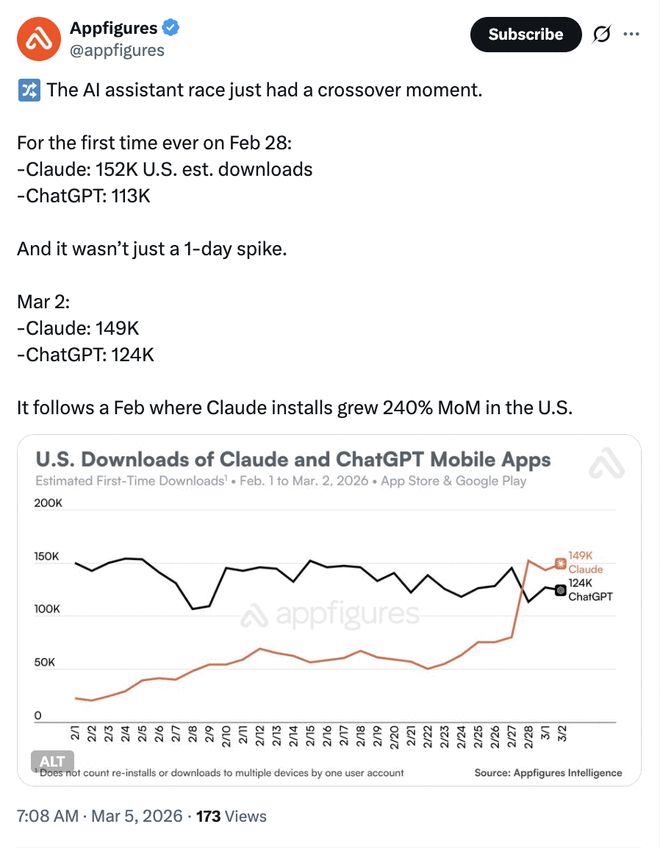

在美国政府发布行政禁令后,意外地引发了市场连锁反应。当特朗普总统批评Anthropic首席执行官时,Claude在苹果App Store上的下载量异常飙升,并迅速超越ChatGPT,登顶免费榜。

许多社交媒体用户对此表示:“如果这个AI被认为不够听话,那它给出的答案可能更值得信赖。”

四、实际困境:无法立即“脱钩”的挑战

即便在舆论上受到严厉打压,美军一线部队依然高度依赖Claude提供的算力和决策支持。

海格塞斯宣布禁令的同时也表示将给予六个月的过渡期。知情人士分析认为,这反映了美军在智能化装备上的路径依赖性。由于现有作战系统与Claude深度耦合,短期内强制剥离可能导致情报链断裂。

“无论公司管理层持何种价值观,军方当前的任务是确保行动效能。”一位不愿透露姓名的分析人士指出,在没有同等替代方案的情况下,“有期限的脱钩”更像是为了战略缓冲的政治姿态。

五、市场重组:硅谷巨头的新机遇

Anthropic面临的政策障碍为其他AI公司重塑军工复合体提供了机会。

· OpenAI策略调整:曾经强调非军事化的OpenAI开始展现更强的灵活性,修改服务条款后与五角大楼签署协议,将其高性能模型集成至机密作战网络中。

· xAI迅速入场:埃隆·马斯克旗下的xAI近期获准进入政府机密系统。鉴于马斯克与现政府深厚的政治联系,其技术被认为具有较强的替代潜力。

更换作战体系的“算法大脑”并非易事。涉及海量数据训练和底层逻辑适配,这六个月的过渡期既是商业竞争的关键时期,也是美军智能化作战系统的风险敏感阶段。

六、反思:在智能战争时代的技术考量

随着军事智能化进程加快,技术安全与伦理底线依然是国际社会关注的重点。

新美国安全中心副主任保罗·夏雷提醒说,生成式AI存在“幻觉”倾向,在处理信息时可能产生虚假或扭曲的结论。在普通场景下这或许只是技术缺陷,但在高强度军事冲突中,一个坐标的偏差或目标误判可能导致严重的人道主义灾难或战略失误。

Claude当前的应用预示着算法正逐渐成为战争的核心要素。然而,在将战争节奏推向“机器速度”的同时,确保人类能够掌握最终的“制动闸”,将是智能化战争时代必须面对的问题。