在2026年3月30日,一场意外事故使Anthropic在人工智能发展史上留下了不可磨灭的痕迹。这场事件的影响范围仍在扩大,其最终结果尚无法完全预料。然而,可以肯定的是,我们正站在一个全新时代的门槛上。

Anthropic是一家以“安全性优先”为原则、估值高达3500亿美元的人工智能领军企业,在筹备备受瞩目的首次公开募股(IPO)之际,意外地向全球开发者开放了其核心产品之一的源代码。这一举动与公司原本保守的技术策略形成了鲜明对比。

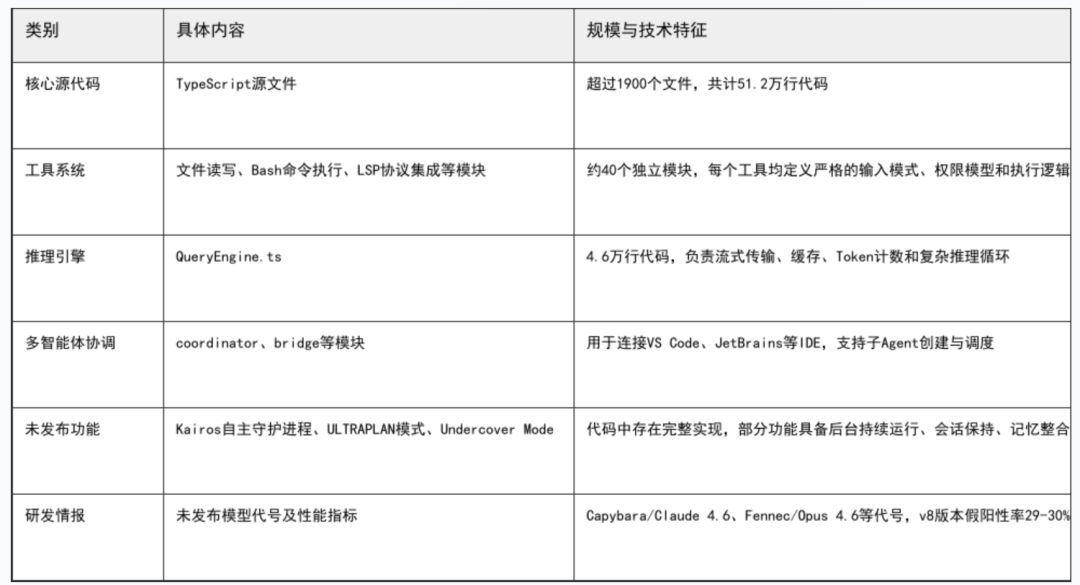

具体而言,Claude Code——一个包含超过51.2万行TypeScript编码、涵盖内部架构逻辑和未发布功能在内的完整项目,在一夜之间被公开在互联网上,供所有人下载和研究。

图:泄露内容全景

这一事件的严重性远不止于一般的代码泄露。它实际上披露了全球领先的AI代理工程化实现方案的核心细节,这种级别的技术暴露类似于核时代下意外公开展示最先进核武器的设计图纸。

称这次事件为“人工智能历史上的首次大规模技术泄漏”,并非夸大其词。它的潜在后果包括:

第一,“平权效应”将在全球AI代理生态系统中显现,促进前所未有的创新爆发。

第二,不同主要模型之间的能力差距将显著缩小,从而改变中美乃至全球范围内的竞争态势。

第三,恶意利用这些先进技术的可能性使得安全风险剧增。

以下是对上述三个方面影响的详细分析。

01

技术故障揭秘:意外公开源自简单失误

这次技术事故的原因极为讽刺。在2026年3月30日,Anthropic通过npm平台发布了Claude Code命令行工具的2.1.88版本。

但是,在这次发布的软件包中不慎包含了名为cli.js.map的一个大型文件(59.8 MB)。

这个Source map文件原本用于开发阶段帮助开发者调试,它将压缩后的代码与人类可读的原始TypeScript源码联系起来。当这个文件出现在公共npm存储库时,实际上等同于公开了Claude Code的所有源代码(超过51.2万行),包括未发布的功能和内部架构。

更糟糕的是,此.map文件还引用了一个托管在Anthropic R2存储桶中的TypeScript源码目录,这使得整个项目结构可以直接被下载。

安全研究员Shou Chaofan首先通过X平台披露了这一发现。随后,GitHub上出现了大量对该代码库的克隆和关注。

重要的是要注意,这次公开并非主动开源的行为艺术或外部黑客攻击的结果,而是内部操作失误导致的技术泄漏。

Anthropic迅速回应,将此事件定性为“发布流程中的配置错误”,并强调无客户敏感数据泄露。这是一次由于系统维护不当引发的大规模技术外泄事故。

值得注意的是,在这一周内,这是Anthropic第二次遭遇安全问题。

五天前,由于内容管理系统设置失误,大约3000份内部未发布资产被意外公开。这反映出该公司在基础运维方面存在明显的系统性风险。

一、平权机会:AI代理生态系统迎来“创新爆发”

02

影响的三重维度

代码开发技能是构建AI代理的核心技术基石。此次泄漏使全球范围内的开发者受益匪浅,因为在此之前,Claude Code的内部实现对外界而言是一个完全封闭的秘密。

现在,这份详细的“官方指南”被公开后,人们可以清晰地看到其复杂的工程架构和设计思路。

泄露的内容包括权限控制、上下文管理、工具调用循环等核心模块的设计细节。这意味着许多过去需要数月甚至多年才能解决的AI代理开发难题现在有了明确的答案。

随着这些信息的公开,未来几个月内,基于Claude Code或其衍生版本的各种代理将大量涌现。

开源社区和商业公司都将能够利用这份意外获得的设计蓝图来加速创新。这将在巨人的肩膀上开启新一轮的技术突破。

AI代理生态系统的“寒武纪大爆发”已经由此被点燃。

二、竞争格局:全球模型竞赛进入新的阶段

过去一年,大型语言模型的关键进步之一是其代码生成能力的提升。如今,这已成为衡量一个模型智能化和实用性的重要指标。

Claude Code之所以备受关注,正是因为将强大的代码理解与生成功能嵌入到了代理系统中。

虽然此次泄漏并未直接涉及Claude模型本身的权重参数,但它揭露了如何最大化地利用该技术的方法论。这为竞争对手提供了宝贵的参考点。

据业内人士透露,“现在是时候借鉴Anthropic的技术了。” 这并非空话。

泄露的代码甚至包含了尚未发布的内部代号(如Capybara/Claude 4.6和Fennec/Opus 4.6)以及其性能指标。

对于竞争对手来说,这些信息具有极高的参考价值,有助于他们了解Anthropic的技术路径和发展进度。

因此,这次技术泄漏将显著缩小全球顶级模型之间的差距。

这可能导致一些仅靠短暂流行或单一功能获得关注的模型失去竞争优势。而那些具备强大工程化能力的新秀则有机会迅速崛起。

中美乃至全球AI竞赛的重点正从单纯的模型规模转向对实际应用能力和系统整合程度的关注。

三、潜在威胁:潘多拉魔盒被意外开启

技术本身是中立的,但掌握技术的人可能带有不同的意图。Claude Code源码泄漏最令人担忧的部分在于它落入了恶意使用者手中。

首先,安全防御机制被公开暴露。

Claude Code内部包含多种防止模型执行有害命令的安全措施,如今这些保护细节已被完全揭示。

恶意攻击者可以利用这些信息设计针对性的攻击策略来绕过Anthropic设置的安全屏障。这类似于恐怖分子获得核电站安保系统的设计图纸后进行精准渗透。

其次,潜在的网络攻击路径被直接展示出来。专家警告说,泄露的代码可能揭示出服务器端请求伪造(SSRF)等漏洞。

第三,恶意复刻和供应链污染的风险增加。

泄漏后的代码已经被广泛存档并在开发社区中传播,使得阻止非法二次利用几乎不可能实现。

在泄露前就有人试图通过关键词误导开发者下载带有后门的软件。如今这种风险将更加严重。

这些潜在威胁往往不易被公众察觉,但它们构成了此次泄漏事件长期影响的关键部分。

03

结语

当AI系统的内部工作原理变成公开的秘密时,如何确保其技术不被滥用成为了一个紧迫的问题。这不仅仅是Anthropic需要面对的挑战,而是整个行业乃至社会都必须共同解决的重大课题。

未来的回顾可能将此次“人工智能历史上的核泄漏”视为一个重要的转折点。

我们既要为即将到来的技术繁荣感到兴奋,也要对潜藏的风险保持警惕。毕竟,一旦潘多拉的盒子被打开,就无法再关上它了。

几年后,当我们回顾这一事件时,也许会将其视为人工智能发展史上的一个重大转折点。我们既期待创新带来的繁荣,也必须为潜在的安全风险做好准备。因为一旦潘多拉魔盒开启,便再也无法关闭。