近日,硅谷初创企业Luma AI发布了其最新图像模型Uni-1,该模型结合了图像理解和图像生成的功能,具有强大的思考和创作能力。据测试结果显示,Uni-1的性能与Google的Gemini 3 Pro相当,在高分辨率图像生成方面成本降低了大约10%到30%,并且在空间理解能力方面超越了谷歌Nano Banana 2和OpenAI GPT Image 1.5。

近日,硅谷初创企业Luma AI发布了其最新图像模型Uni-1,该模型结合了图像理解和图像生成的功能,具有强大的思考和创作能力。据测试结果显示,Uni-1的性能与Google的Gemini 3 Pro相当,在高分辨率图像生成方面成本降低了大约10%到30%,并且在空间理解能力方面超越了谷歌Nano Banana 2和OpenAI GPT Image 1.5。

Luma AI成立于2021年,最初以Dream Machine视频生成工具闻名。此次推出Uni-1标志着该公司从单一视频生成向更广泛的“统一智能”方向转变。这款模型首次亮相于3月5日,随后在3月22日面向更广泛的开发者和用户群体公开发布。

Uni-1在技术架构上有所创新,摒弃了主流的扩散模型,转而采用自回归生成架构,即大语言模型的逐token预测方法。这使得Uni-1在生成图像时能够进行推理,而不仅仅是降噪。这一转变标志着旧金山一家仅有150名员工的初创公司正在尝试重塑AI图像生成的技术框架。

在实际体验中,当向Uni-1发出“生成一张宿命感照片,一个长发飘飘的女子身穿战国袍,配了把剑”的指令后,该模型会先用几秒钟分析需求,然后开始创作,大约花费5分钟完成。生成的画面具有电影感,长发和衣摆随风飘动,服饰质感丰富,虽然剑出现了两把,但整体上细节处理得相当细腻。

Uni-1的开发者声称,这款模型采用纯解码器自回归Transformer架构,文本和图像token在同一序列中交错排列,不依赖独立的视觉编码器。这使得Uni-1能够在图像合成过程中进行结构化内部推理,包括分解指令、解决约束和规划构图。

实际应用中,Uni-1可以将多张宠物照片中的动物合成到一个新场景中,例如穿上学术礼服站在写满科学图表的白板前,保留每只动物的独特特征,而无需大量手动调整或后期处理。

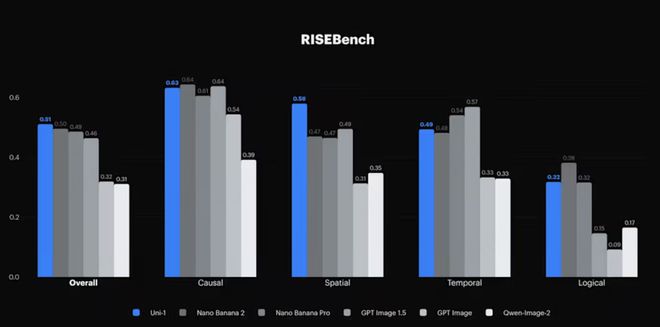

Uni-1在基于推理的视觉编辑基准测试工具RISEBench中表现突出,其综合评分为0.51,而谷歌Nano Banana 2得分0.50,Nano Banana Pro得分0.49,OpenAI GPT Image 1.5得分0.46。在空间推理和逻辑推理方面,Uni-1分别获得了0.58和0.32的得分,远超其他模型。

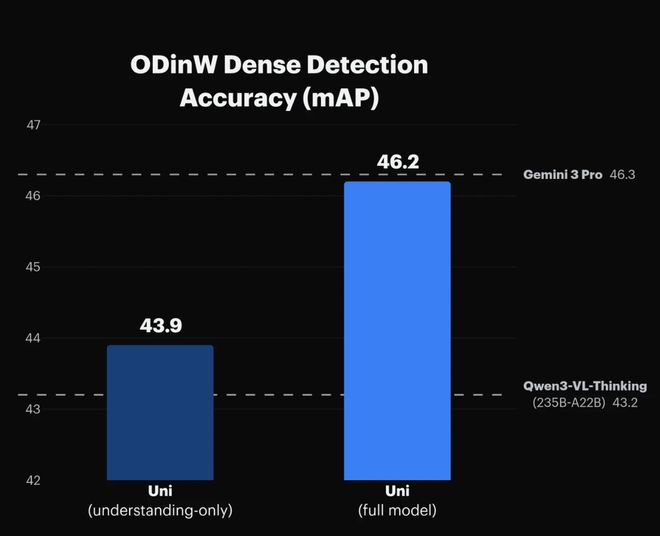

在ODinW-13物体检测基准测试中,Uni-1完整版得分为46.2 mAP,几乎与谷歌Gemini 3 Pro的46.3持平,而Qwen3-VL-Thinking得分为43.2。值得注意的是,Uni-1在未经生成训练的情况下已经达到了43.9的得分,这表明生成图像的能力可以提升模型的图像理解能力。

科技媒体The Decoder的测试认为,Uni-1在复杂推理类生成任务上优于Midjourney v8。有Reddit用户在详细对比后表示,Uni-1在逻辑推理、复杂场景理解和空间合理性等方面表现出色,尽管Midjourney在艺术风格化和审美质感方面仍占优势。

Uni-1在企业常用2K分辨率下的价格优势明显,较谷歌Nano Banana 2更经济。Luma AI在输出端的token定价为每百万token 45.45美元,适合大规模生产高分辨率图像的企业团队。

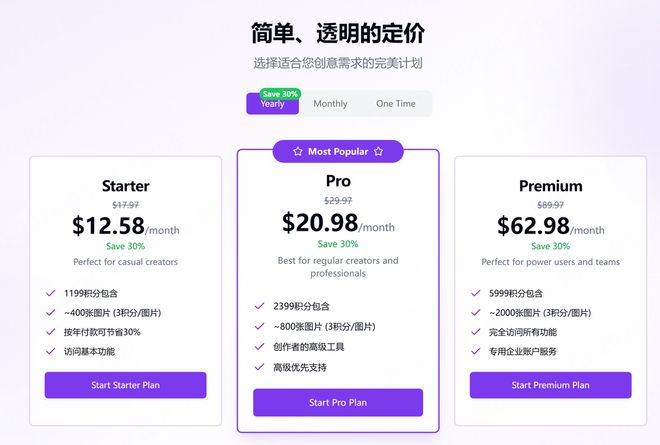

Uni-1的定价策略面向个人用户提供了包年、包月和单次计价三种模式。作为初创公司,Luma AI通过“性能更强、价格更低”来吸引客户。

Uni-1发布后,社区反应积极。X平台用户表示,图像生成终于不再需要费力思考提示词。Reddit用户则认为,对于那些在意图像“合理性”的用户来说,Uni-1是目前的最佳选择。

部分用户仍持观望态度,等待完整API权限进行独立测试。他们对非拉丁文字的处理效果、极端边缘场景以及最高分辨率下的生成速度仍有疑问。总体来看,社区的兴奋更多是针对新技术路线的突破感,而长期表现仍需时间验证。

目前,Uni-1可以在lumalabs.ai免费体验,API访问正在逐步开放。

Uni-1的发布表明,AI图像生成的竞争已从“谁的图更好看”转向“谁的模型更能理解指令”。扩散模型在该领域统治三年后,自回归架构以大语言模型的推理能力切入,首次在核心基准测试中证明了这一路线的可行性,可能会影响未来更多实验室的技术路线选择。

Uni-1能否在API大规模调用、多语言支持和生成速度上经受住企业级场景的检验,将是其能否后来居上的关键。自回归路线在图像生成领域能否站稳脚跟,仍有待观察。

基于推理的视觉编辑的基准测试工具RISEBench从时间、因果、空间和逻辑四大维度对图像生成AI进行了跑分,Uni-1综合分0.51,谷歌Nano Banana 2得分0.50,Nano Banana Pro是0.49,OpenAI GPT Image 1.5是0.46。总分看着咬得很紧,我们可以聚焦不同维度来比一比:

- 空间推理:Uni-1得分0.58,Nano Banana 2仅0.47;

- 逻辑推理:Uni-1得分0.32,略次于Nano Banana 2(0.38),是GPT Image 1.5(0.15)和Qwen-Image-2(0.17)的两倍以上。

▲五款图片生成模型RISEBench跑分对比(图源:Lumalabs)

在ODinW-13物体检测基准测试中,Uni-1完整版得分46.2 mAP,几乎追平谷歌Gemini 3 Pro的46.3,大幅领先Qwen3-VL-Thinking的43.2。值得注意的是,Uni-1仅具备理解能力(未经生成训练)的变体得分为43.9,而完整版提升了2.3分。这直接证明了一个关键假设:学会生成图像,能反过来提升模型的图像理解能力。

▲物体检测基准测试Uni-1几乎追平谷歌Gemini 3 Pro(图源:Lumalabs)

在与Midjourney v8的对比中,科技媒体The Decoder的测试认为Uni-1在复杂推理类生成任务上“明显优于Midjourney v8”。有Reddit用户在逐一对比后评价:“在真正的逻辑推理、复杂场景理解、空间合理性这些方面,Uni-1完全碾压。”不过,Midjourney在艺术风格化和审美质感方面仍保有优势。

三、定价策略:高分辨率比谷歌便宜,瞄准企业客户

根据公开定价数据,Uni-1在企业常用的2K分辨率上具有明显的价格优势:

谷歌Nano Banana 2在低分辨率上仍有价格优势,0.5K图像约0.045美元/张(约合人民币0.31元),1K图像约0.067美元/张(约合人民币0.46元)。对于大规模生产高分辨率图像的企业团队而言,Uni-1在质量和成本两端同时占优。Luma AI在输出端的token定价为每百万token 45.45美元(约合人民币322元)。

面向个人用户,定价则分为包年、包月和单次计价三种模式。作为一家初创公司,Luma AI无法在分发渠道和基础设施上与谷歌抗衡,“性能更强、价格更低”是它能打动客户的核心筹码。

▲Uni-1定价(图源:Uni-1官网)

四、社区反馈:从“提示词碰运气”到“真正的创作控制”

Uni-1发布后,尽管大规模独立测试仍在进行中,早期社区反应积极。

X平台用户反馈良好,网友直言,图像生成终于不用费劲想提示词了。Reddit上一位进行了逐项对比测试的用户给出了更细致的评价:Nano Banana 2在速度和文字渲染上仍有优势,但在“真正的逻辑推理、复杂场景理解和需要深度思考的编辑任务”上,Uni-1略胜一筹。该用户总结道:“如果你在意的是图像真正‘合理’,而不只是‘好看又快’,Uni-1是目前的最佳选择。”

▲X上网友对于Uni-1的评价(图源:X)

不过,也有用户持观望态度。部分用户表示仍在等待完整API权限以进行独立测试,对非拉丁文字的处理效果、极端边缘场景以及最高分辨率下的生成速度仍有疑问。客观地说,社区的兴奋更多针对“新技术路线的突破感”,长期表现仍需时间验证。

目前Uni-1可在lumalabs.ai免费体验,API访问正在逐步开放。

结语:Luma真的能后来居上吗?

从Uni-1的发布可以预测到,AI图像生成的竞争正在从“谁的图更好看”转向“谁的模型更能理解指令”。扩散模型统治这一领域已有三年之久,而自回归架构以大语言模型式的推理能力切入,第一次在核心基准测试上证明了这条路线的可行性,也可能影响未来更多实验室的技术路线选择。

真正的考验在于,Uni-1能否在API大规模调用、多语言支持和生成速度上经受住企业级场景的检验。这场“架构之争”才刚刚进入正赛。你认为自回归路线能在图像生成领域站稳脚跟吗?