大模型能撰写论文,但它们是否真正理解科研的本质呢?

实际上,在许多情况下,人工智能只是在模仿科学家的行为——引用文献、列出逻辑和规范格式,看起来非常专业。然而,深入探究后会发现其中充满漏洞:推理往往凭空编造,推导依赖猜测,结论的正确性全靠运气决定。

近期,发布过BabyVision多模态评估基准的UniPat AI团队推出了一项引人注目的开源项目:

UniScientist。

虽然这个模型仅有30B参数量,却能够实现从假设提出到证据收集、再到推导验证及结论形成这一完整科研闭环的过程。

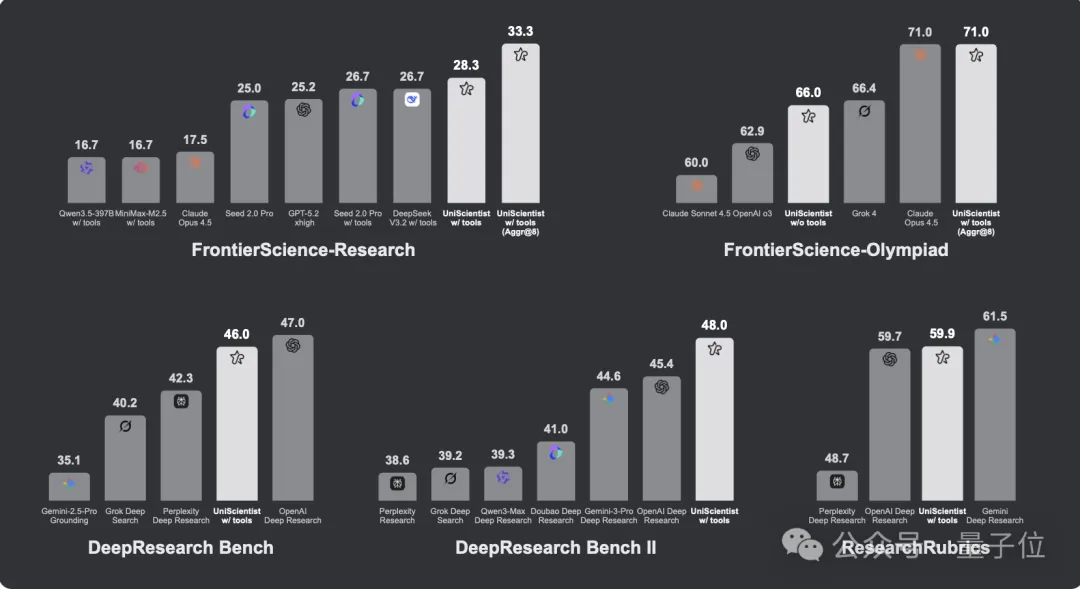

在FrontierScience-Research和ResearchRubrics等权威科学研究排行榜上,它不仅匹敌而且超越了那些规模大得多的封闭源代码模型。

一个30B参数量的小型模型是如何处理复杂的科研流程的?

它的核心创新在于将AI视为一个动态系统。通过自建的数据引擎,UniPat AI成功地将开放性科研难题转化为可以验证的“单元测试”。

下面让我们快速解析一下UniScientist背后的逻辑机制。

目前很多模型进行所谓的“研究任务”,只是表面上看起来像在做科学研究:引用大量资料、列出一连串逻辑,并按照论文格式编写内容。

然而,它们往往停留在叙事推理阶段和从结论出发的逻辑陷阱中。也就是说,虽然论证表面看似合理,但验证不足、推导不稳定且难以复现。

UniPat AI通过UniScientist直接回应了这一技术缺陷:即使只有30B参数量的UniScientist也能实现自主科学研究的能力。

它能够在开放性问题中不断提出科学假设、排除错误推理、修正研究路径,并在证据稳定后将整个过程转化为标准化的研究成果文档。

这背后的核心观点非常明确:

真正的科研不仅仅是撰写出漂亮的报告,更重要的是能够完成从“假设-证据-验证”的完整循环。

UniScientist首先针对数据进行了深入探讨:如何创建高质量的研究训练数据一直是一个重大挑战。

当前解决方案大多处于两个极端:

- 完全人工生成的数据集——虽然真实且准确,但成本高昂、耗时长,并且受限于单一专家的知识领域;

- 全部合成的数据集——规模庞大且成本低廉,然而缺乏可判断的精度和学科落地的真实性。

UniScientist的关键洞察基于一个被广泛忽视的不对称性:大语言模型擅长生成跨学科的研究问题及解决方案草案;而人类专家则专注于验证研究的有效性和质量,并提供高精度的专业深度校验。

- 这种不对称性揭示了一种更高效的分工方式,即利用AI进行规模和多样性的扩展,同时让人类专家负责质量和可验证性的工作。

- 正是基于这一原则,UniScientist的数据引擎能够生成具备广泛专业覆盖范围且经过严格验证保障的训练实例。

关于“科研智能”的讨论通常集中于工具调用和检索上的改进。

而UniScientist则从更基础层面开展工作。该团队将开放性科学研究过程建模为一个由两个基本操作组成的动态系统:

积极证据整合(Active Evidence Integration)与溯因推理(Model Abduction)。

系统的核心在于一个不断进化的“证据状态”,其中证据分为两类:

- 可独立验证的证据(Evidence-Grounded),来源于外部权威来源,或内部生成且经过明确验证;

- 可形式化推导/复现的证据(Formally-Derivable),通过符号计算、数值模拟等可重复的方法获得。

系统执行三个循环动作:

- 获取外部权威信息证据、进行计算和推理;

- 更新溯因:使假设更好地解释现有证据状态。

直到所有证据充分且稳定,再将整个研究过程转化为严谨的科学报告。

- 产生假说;

- 这个形式化流程具有重要意义,它将“科研智能”从一个遥远的理想变为可以训练、评估和迭代的实际对象。

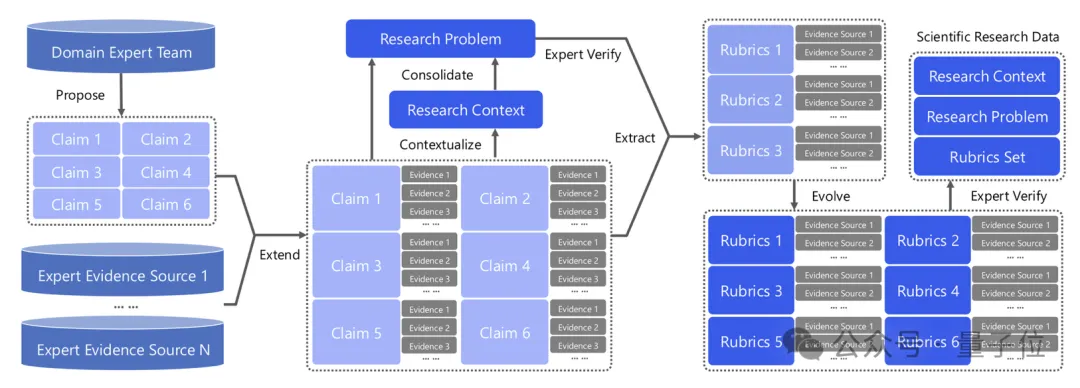

- UniScientist提出了一种名为进化式多学科合成(Evolving Polymathic Synthesis)的数据引擎理念,旨在实现以下两个功能:

一是以专家验证过的科学命题为起点,扩展形成研究级课题——通过构建多个相互依赖的子问题,实现实验设计与逻辑推导的深度结合;

同时生成评测标准(Rubrics),这些不是关于文风或格式等表面质量的评估,而是关注具体科学发现是否达成。

在这个设计中,最引人注目的特征是:

- 一份开放式的科研成果被细分为多个封闭且独立可验证的小单元。

- 每个检验项尽量做到:原子化、客观、可实证或形式推导,并额外强调以下几点:

一致性(对同一结果,重复评测应保持稳定);

区分度(能够区分不同完整程度的成果差异);

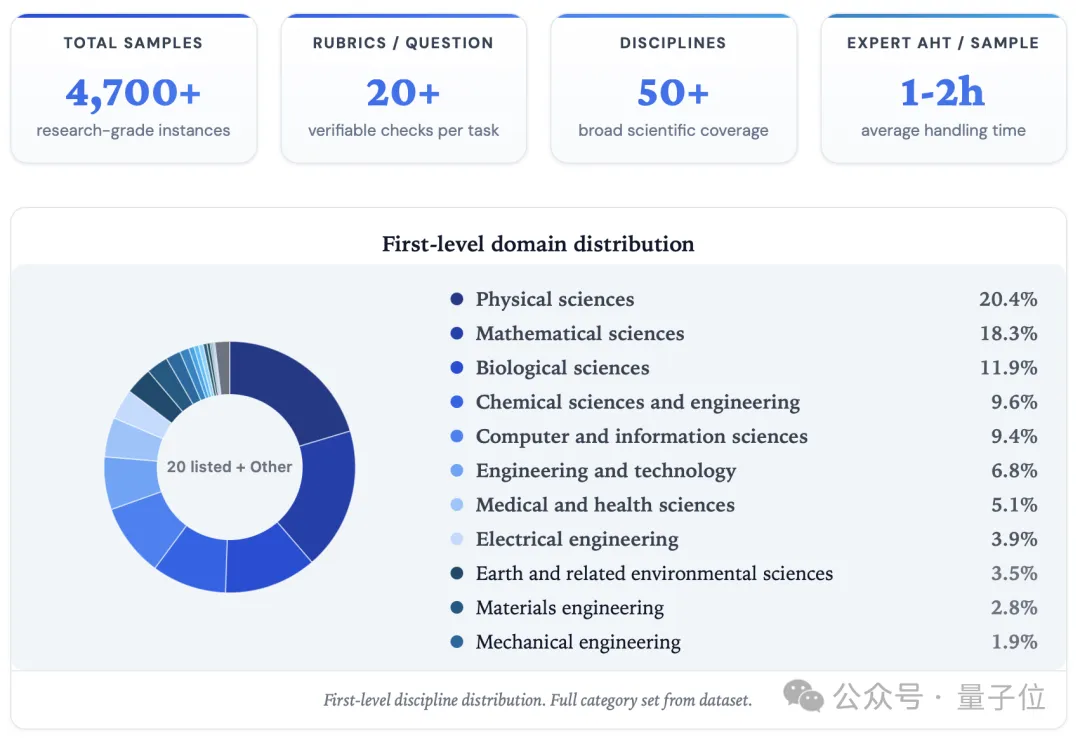

目前的数据集正在不断扩展中,包括超过4700个研究级实例,每个实例附有20+条检验标准,并覆盖50+学科及400+研究方向。专家每标注一条样本平均需要1-2小时的时间。涉及领域从量子物理和有机化学到社会文化人类学和计算语言学均有涵盖。

- 数据集中包含了一系列具有真实科研性质的研究问题示例,具体可参见https://unipat.ai/blog/UniScientist页面。

- 这些问题的共同点在于:没有一个问题可以通过记忆中的现成答案来直接解决。每个问题都要求完整的科学研究过程——包括文献查阅、假设形成、实验设计或理论推导、分析验证以及最终成果的收敛。

- UniScientist引入了一个额外的学习目标——成果聚合任务:

给定同一问题的不同科研成果,模型学会整合各家优点,产出一份更加完整且可靠的结论。通过Rubric阈值筛选出高质量参考答案,并将此能力与科研生成技能一同训练。

这反映了科学研究的一个现实:对于一个问题,一次尝试未必能带来最佳结果。

实际上,这将“集体科研智慧”纳入了模型的学习过程中:它不仅学会了产出研究,还学会了比较、选择、整合并自我改进。

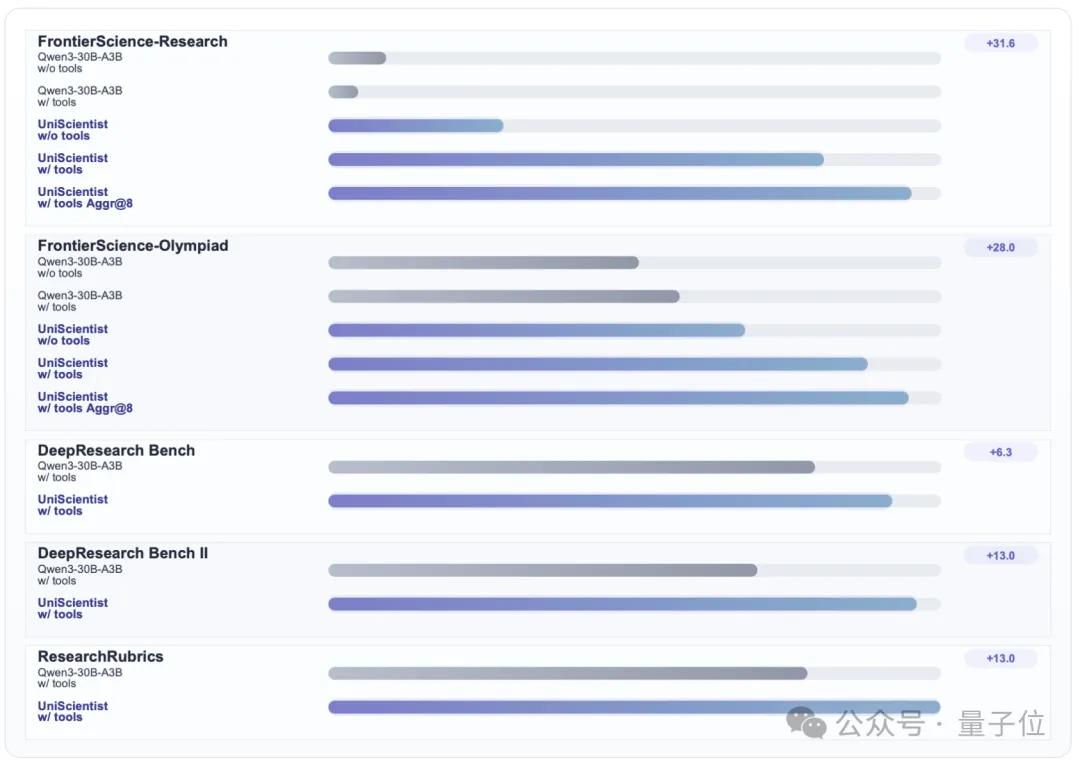

测试结果显示令人印象深刻,尤其是考虑到模型的规模限制。

UniScientist-30B-A3B(一个仅有3B激活参数的小型模型),在FrontierScience-Research评测中获得了28.3分,超过了以下模型:

更值得一提的是,在启用工具的情况下,评分达到了71.0,匹配Claude Opus 4.5的成绩,并超越了其他许多领先模型。

而在DeepResearch Bench、DeepResearch Bench II和ResearchRubrics等分布外基准测试中,UniScientist的表现与一系列顶级封闭源系统相当。

特别重要的是,在没有使用工具的条件下,性能依然显著提升。

这表明增强并非单纯来自更频繁地使用工具,而是模型自身的研究推理能力通过训练得到了实质性提高。

- 所有这些测试结果都指向一个共同结论:模型学会的不仅仅是更好地检索信息,还包括将检索、推导、验证和写作整合成连贯的研究工作流。

- 科学研究并不仅限于形成合理的叙述结构,许多科学发现依赖于可执行且可复现的计算与模拟。

- UniScientist集成了代码解释器,使研究过程从简单的叙事推理升级为“测试-修正”的循环:假设不仅仅被提出,还会通过具体化的计算实验来验证——这些结果可以确认、否定或细化原初假设。

- 目前系统的能力主要集中在可复现性推断与仿真计算范围内。

系统尚未实现对真实世界研究资源的有效调度和协调,例如大规模GPU任务的可靠安排以及湿实验流程的组织。

在Blog中,UniScientist团队也明确阐述了未来的发展方向:

将框架扩展到控制编排与执行真实实验及计算基础设施上,目标是进一步加速科学发现、推进研究前沿。

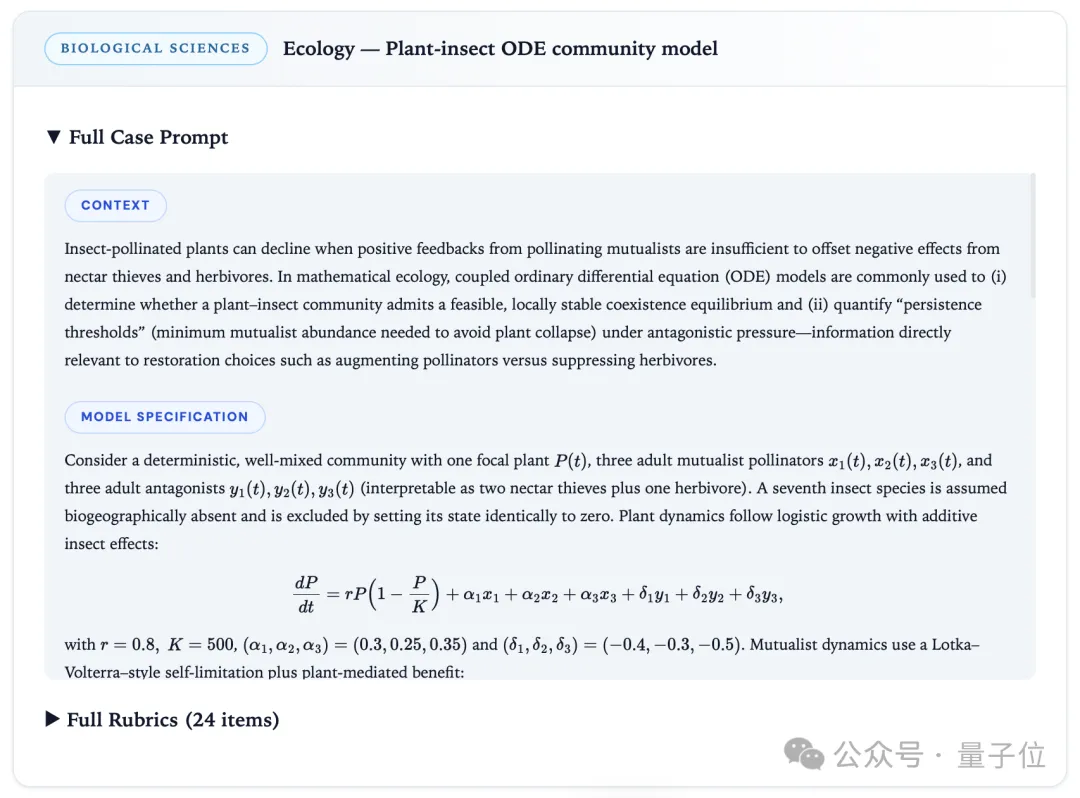

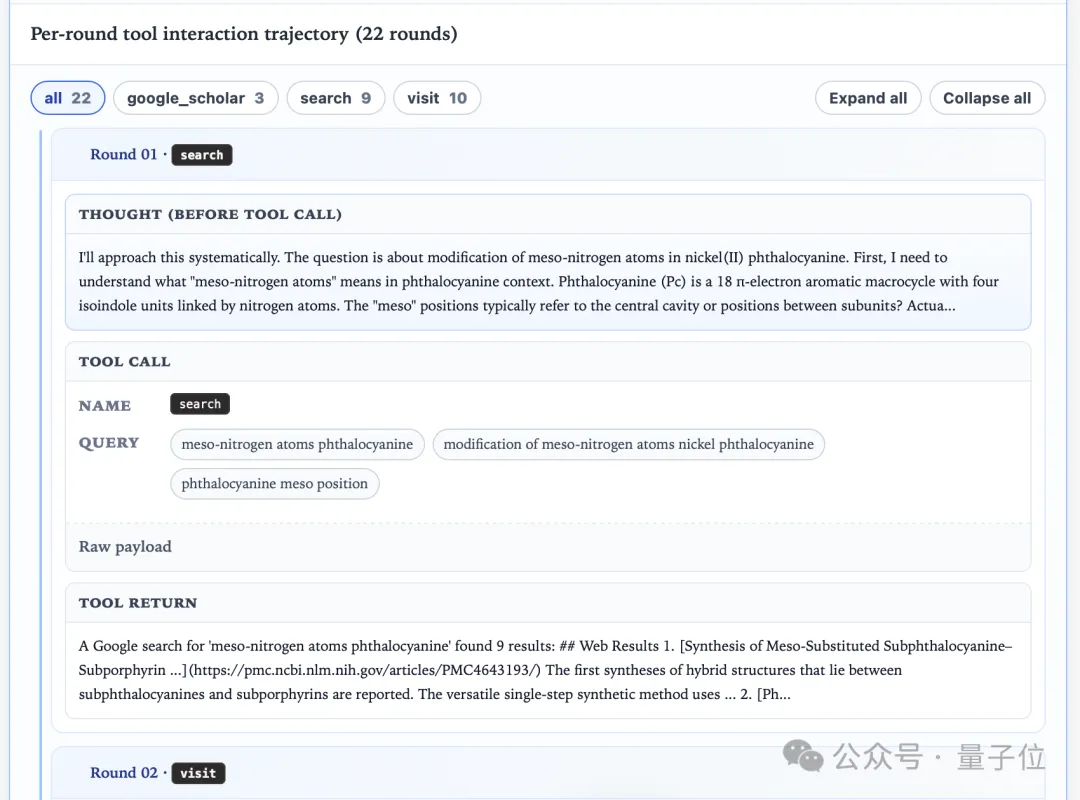

以下展示了一个完整的科研推理链条案例,详细内容请参见Blog链接。

开源地址:https://github.com/UniPat-AI/UniScientist

Blog: https://unipat.ai/blog/UniScientist

[结束符] 以上为改写后的文档内容,编号与原文对应保持一致。

UniScientist集成了代码解释器,将研究流程从叙事式推理升级为“测试-修正”的循环:假设不仅被提出,还被实例化为计算实验——其结果可以确认、推翻或细化假设。

系统目前的能力主要集中在可复现推理与仿真计算范围内。

目前,系统尚未实现对真实世界研究资源的编排,包括大规模GPU任务的可靠调度、以及湿实验流程的协调。

在Blog中,UniScientist也将下一步方向阐述得很清晰:

将框架扩展到对真实实验与计算基础设施的受控编排与执行,目标是进一步加速科学发现、推动研究前沿。

以下展示一个UniScientist进行的完整科研推理链条,详细推理内容可以在Blog链接中进行查阅。

开源地址:

https://github.com/UniPat-AI/UniScientist

Blog:

https://unipat.ai/blog/UniScientist