下半场的大模型架构革新

华中科技大学的王兴刚团队向量子位提交了一篇关于神经网络架构演进的文章。过去十年间,科研人员专注于提升内部层的计算能力,却忽略了层间通信技术的进步。这件事亟需被改变。在深度学习领域,研究者们普遍采用一种策略:尽可能扩大规模。这包括增加参数数量、处理更长序列以及使用更多数据集。这些方法确实取得了成效,因为随着模型规模的增长,性能也随之提升。然而,在扩展方向上存在显著差异。例如,为了处理更长的序列,研究

共找到 5 篇相关文章

华中科技大学的王兴刚团队向量子位提交了一篇关于神经网络架构演进的文章。过去十年间,科研人员专注于提升内部层的计算能力,却忽略了层间通信技术的进步。这件事亟需被改变。在深度学习领域,研究者们普遍采用一种策略:尽可能扩大规模。这包括增加参数数量、处理更长序列以及使用更多数据集。这些方法确实取得了成效,因为随着模型规模的增长,性能也随之提升。然而,在扩展方向上存在显著差异。例如,为了处理更长的序列,研究

自2015年ResNet诞生以来,「将输入直接加到输出上」这一简单的机制,几乎统治了所有神经网络架构。近期,沿用了十年的残差机制迎来了重大变革,「注意力机制」成为了其替代方案。这一创新甚至影响到了OpenAI的研究人员,包括负责开发o1/o3系列、Codex编程模型及GPT-4 STEM能力的Jerry Tworek,他深受启发,认为需要重新评估现有的一切,「深度学习2.0」时代即将到来。这一突破

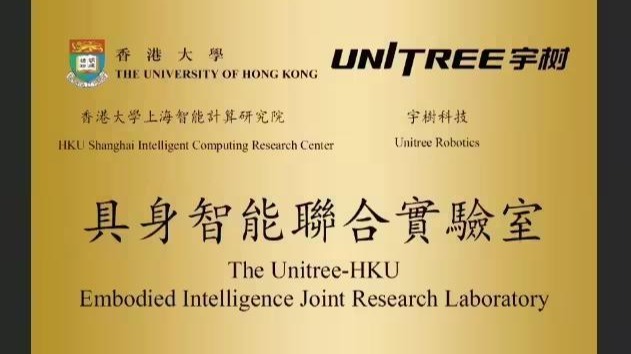

3月9日,据相关报道显示,在2月28日当天,宇树科技与香港大学上海智能计算研究院在上海举行战略合作协议的签署仪式,并正式成立了具身智能联合实验室。马毅教授作为香港大学计算与数据科学学院院长在会上表示,该新成立的研究机构将主要关注下一代白盒神经网络架构以及世界模型等核心领域。他强调了通过与宇树科技这样的企业进行深度合作的重要性,并希望中国的人工智能技术不仅能够跻身全球领先行列,更能在定义未来人工智能

我是李国豪,目前专注于大语言模型和代理研究领域。本科毕业于哈尔滨工业大学电子信息工程专业,并在沙特阿卜杜拉国王科技大学(KAUST)攻读博士学位。我的学术兴趣从强化学习延伸到图神经网络,最终聚焦于大语言模型及其应用。作者|王艺我的兴趣演变始于强化学习,但很快发现它难以解决跨领域问题的泛化性挑战。因此,我转向探索更通用的表征学习方法,并研究图神经网络(GNN)。然而,在ChatGPT出现之后,我发现

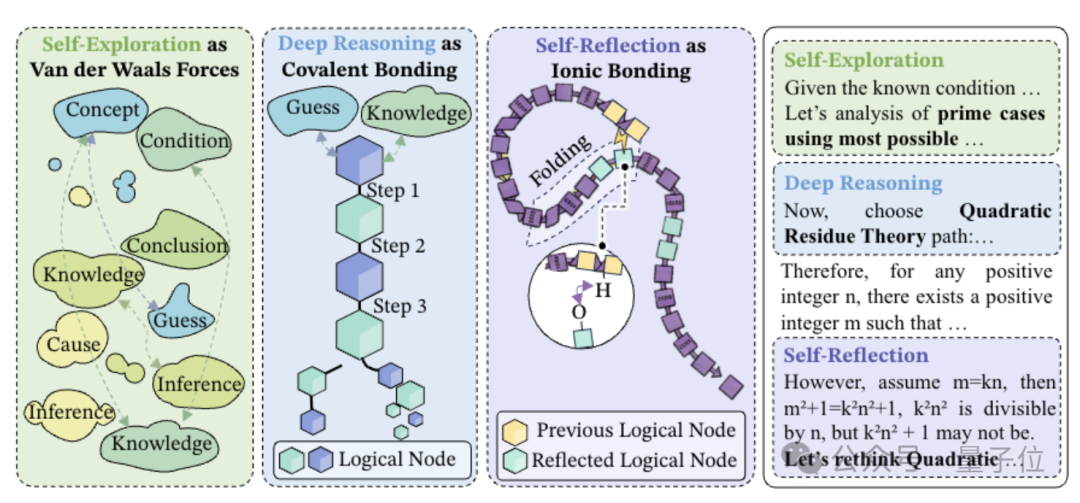

字节Seed开始运用化学原理来研究大型模型。 深度推理像是共价键,自我反思类似氢键,而自我探索则像范德华力? 传统的长思维链推理通常将AI的思考过程视为线性结构。 实际上,在很多情况下,后续的重要结论需要返回去验证早期提出的假设。 CoT忽略了这种非线性的依赖关系。 在论文《思想的分子结构》中,字节Seed首次为大模型定义了长链思维的分子式结构。 这种分子拓扑结构里,三种键是如何相互作用的?