新智元报道

在竞争对手仍在专注于单点能力时,Agnes已将文本代理、图像处理、视频生成和办公自动化工具整合进开发者工具箱中,提供了一整套AI生产力解决方案。

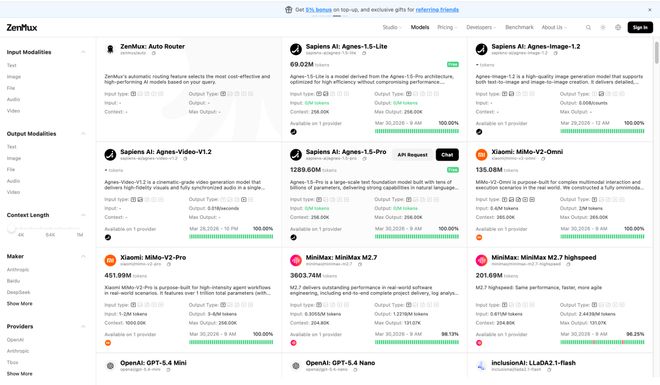

最近,Agnes的核心模型矩阵在Zenmux平台(https://zenmux.ai/models?sort=newest)正式上线,并一次性开放了四款主力模型的调用接口,涵盖文本代理与多模态生成两大核心领域。

其中包括Claw系列中的Agnes-1.5-Lite和Agnes-1.5-Pro,以及面向多模态应用的Agnes-Image-1.2和Agnes-Video-V1.2,这些模型将文本、图像与视频的综合能力集成到了一起。

特别值得注意的是,在上线首周内,模型调用量迅速增长,并超越了多个头部竞争对手的表现,显示出市场接受度和开发者活跃程度极高,成为近期增速最快的模型组合之一。

Agnes的核心模型矩阵已成功在Zenmux平台发布

当行业普遍进入“性能+成本”双重竞争阶段时,Agnes通过高性价比的模型与完整工具链的结合,正快速打开开发者的生态系统入口。

AgnesClaw

仅需1美元即可入门体验

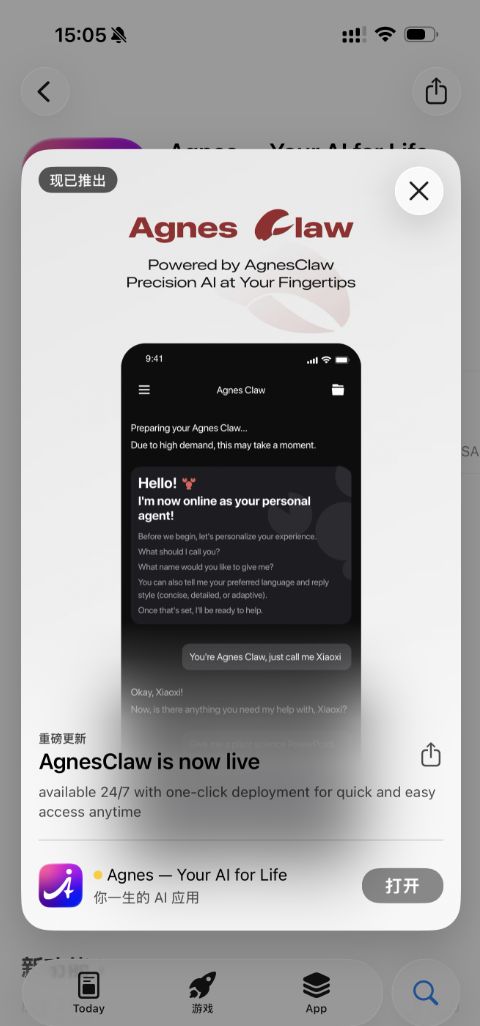

在OpenClaw热度持续上升的同时,Agnes将其接入自家应用,并推出了AgnesClaw一键部署功能。

用户订阅会员(部分地区Starter新用户最低为每月1美元)后,可免费部署并使用AgnesClaw,同时解锁所有高级功能,性价比非常高。

AgnesClaw在首页提供直接访问入口,完成一键部署后,在对话框中切换到AgnesClaw模式即可体验“养虾”,整体学习成本极低。

目前,AgnesClaw支持与Telegram绑定,并计划接入更多平台。它还提供了定时任务、长期记忆和技能库功能,包括由Agnes预设的常用技能(如PPT生成、表格处理等)和开源技能。

由于底层模型能力限制,某些AI应用可能无法安装或流畅运行特定组件。

然而,根据官方介绍,得益于自主研发的“龙虾”基座模型及强大的工具调用适配能力,AgnesClaw几乎可以无缝地集成并使用绝大多数热门技能。

用户可以通过它创建定时任务、处理文件并整理成结构化文档等办公自动化任务。

此外,AgnesClaw还具备自我进化的能力,通过上下文理解和记忆,在实际应用中更好地理解用户习惯,并更有效地协助完成任务。

AgnesClaw一键部署功能

AgnesClaw的核心在于其自主研发的“龙虾”基座模型,这赋予了Agnes版本更强的理解力和技能适配能力。

为了实现高性价比的“养虾”,Agnes推出了两款不同规模参数优化后的代理模型:120B的Agnes-1.5-Pro模型和35B的Agnes-1.5-Lite模型。

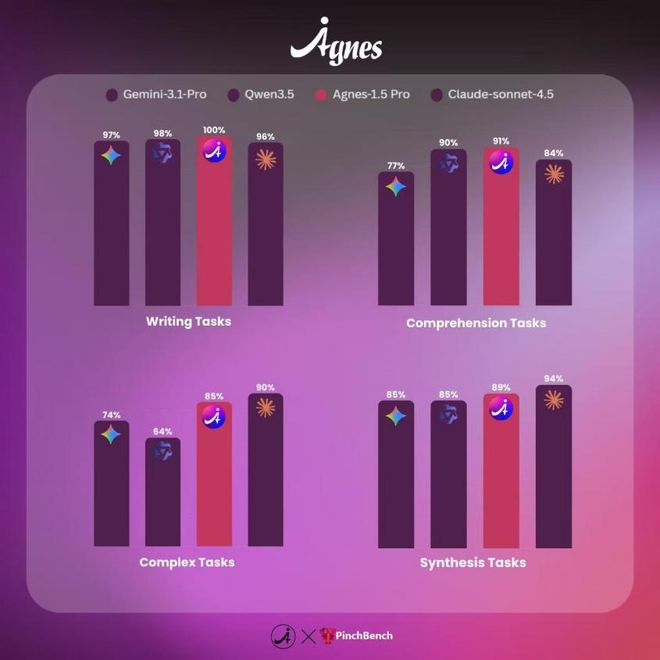

在PinchBench榜单中,Agnes-1.5 系列模型在准确性方面表现出色

AgnesClaw定位为“下一代极速多模态混合专家模型”,架构上融合了隐式MoE、Mamba-2状态空间模型及原生多模态早融合技术,旨在解决超长上下文、高频工具调用和复杂Multi-Agent协作的挑战,并突破传统规模延迟记忆三元悖论。

根据全球权威“养虾”AI评测榜单PinchBench,Agnes-1.5-Pro模型在准确性方面表现突出,已跻身前列,成为开发者的首选之一。

PinchBench排行榜

Agnes-Image-1.2图像编辑模型

开源第一,闭源第二

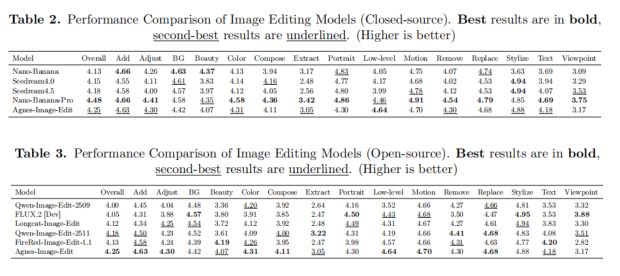

此次发布中,Agnes推出了一个新的20B图像编辑模型Agnes-Image-1.2,其表现超出预期。

根据官方数据,在闭源模型中仅次于NanoBananaPro的评分(满分5分),在开源模型中排名第一。综合评分为4.25分(满分5分)。

Agnes-Image-1.2图像编辑模型的表现

在单项指标上,Agnes-Image-1.2模型在人像处理方面显著提升,定向微调使面部细节保真度、局部编辑可控性和与背景融合能力增强。Portrait评分从3.98提高到4.30(+0.32)。

同时,Extract(2.47→3.05,+0.58)和Viewpoint(2.82→3.17,+0.35)也得到了进一步改进,表明模型在目标区域分离与结构/几何稳定性方面更加可靠,有助于复杂编辑任务的一致性表现。

完整模型家族

覆盖多模态全链路

除了Agnes-1.5-Pro与Agnes-1.5-Lite两款模型和Agnes-Image-1.2图像编辑模型外,本次发布还包括搜索与研究模型、AI Slides演示文稿生成模型以及图片和视频生成模型。

在图像和视频生成领域,Agnes构建了完整的模型体系。除了之前介绍的Agnes-Image-1.2(20B)模型外,还有另一款19B的Agnes-Video-V1.2视频生成模型。

Agnes-Video-V1.2能够实现原生音画同步生成,并支持图生视频和特定风格/角色生成。该模型适用于多种业务场景。

采用双流音视频Transformer架构,Agnes-Video-V1.2在同一模型中同时生成音频与视频,从而实现人物口型、动作与声音的自然同步。经过测试,它能在有限显存环境下运行,便于企业级规模化部署和个人开发者的本地实验。

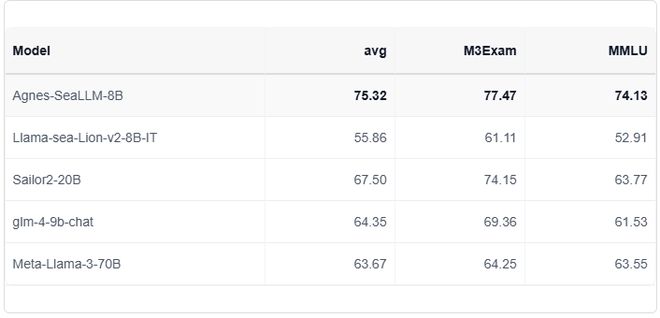

在语言模型方面,针对东南亚市场,Agnes推出了8B参数的小语种模型Agnes-SeaLLM,已成为该地区小语种理解与生成任务的领先模型。

Agnes-SeaLLM是一款面向东南亚市场的语言处理工具

在信息检索和研究能力方面,Agnes发布了搜索模型Agnes-Search(30B)以及复杂研究任务模型Agnes-DeepResearch(30B)。

内部测试显示,前者在推理成本上实现了78.6%的下降,并且生成速度提高了18.6%;后者引用准确率为100%,基准测试平均提升了14.3%。

在办公自动化场景中,Agnes-Slides(30B)模型可将网页或文档内容快速转换为PPT。通常情况下,一分钟内可以生成约15至20页的演示文稿,每页成本低至几美分左右。

模型后训练为主

RLAF框架通过智能反馈减少人工标注依赖

他们提出了一种名为RLAF(Reinforcement Learning with Agentic Feedback)的新强化学习框架,以降低对人工标注的需求。该框架包含了两个自主研发的核心组件:DSPO和UV。

DSPO是一种动态过滤序列级策略优化算法,在同规模模型对比中相比DeepSeek Search-R1 (GRPO,7B)实现了34.1%的性能提升。

DSPO是一种动态过滤序列级策略优化算法

在同规模模型对比中,DSPO相比于DeepSeek Search-R1 (GRPO,7B),显示出了显著的性能改进(+34.1%)。

UV是一个通用验证器,它用智能评估器替代了人工标注数据和人为定义的奖励机制。

UV是用于替换人工标注和手动定义奖励机制的智能验证工具

- 在RLAF框架下,多个AI代理会自动评估模型输出,并从逻辑一致性、事实准确性和任务完成度等多个维度生成反馈信号。

- 模型不再只是“榜单表现”,而是直接面向开发者的真实调用与对比。

当越来越多的模型走向平台化分发时,真正能够留存下来的,可能不再只是参数规模更强的问题,而是谁更便宜、谁更好用以及谁能更快地接入现实世界。

Agnes显然正在朝这个方向努力。

随着AI行业进入新一轮竞争阶段,成本效率正逐渐成为商业化成败的关键因素。而此次登陆Zenmux(https://zenmux.ai/models?sort=newest),某种程度上也是Agnes一个关键分水岭——

模型不再只是「榜单表现」,而是直接进入开发者真实调用与对比的第一线。

从上线一周的调用表现来看,这套Claw+多模态组合已经开始改写一部分开发者的选择。

当越来越多模型走向平台化分发,真正能留下来的,或许不只是更强的参数规模,而是谁更便宜、谁更好用、谁更能被快速接入真实世界。

Agnes,显然正在把答案往这个方向推。