今日凌晨,Physical Intelligence 发布了新模型 VLA π0.7,震撼业界。

新版π0.7 模型具备强大的涌现能力,能够灵活应对机器人领域的挑战。

在面对全新任务时,π0.7 能够利用之前学到的技能组合成新的解决方案。

例如,当面对一个未接触过的空气炸锅时,它能够按照指令组合机械臂动作烤制红薯;另一项则是在一台机械臂上学习到的操作策略可以直接应用于其他机器人。

Physical Intelligence 的研究员们甚至表示他们也难以完全理解π0.7的全部能力,这种探索性的工作带来了许多惊喜。

能够完成切黄瓜、削皮、倒垃圾等一系列任务,显示了模型的强大潜力。

研究员Ashwin Balakrishna 指出,在过去可以根据训练数据预测模型的表现,而这次却难以预料其能力边界。

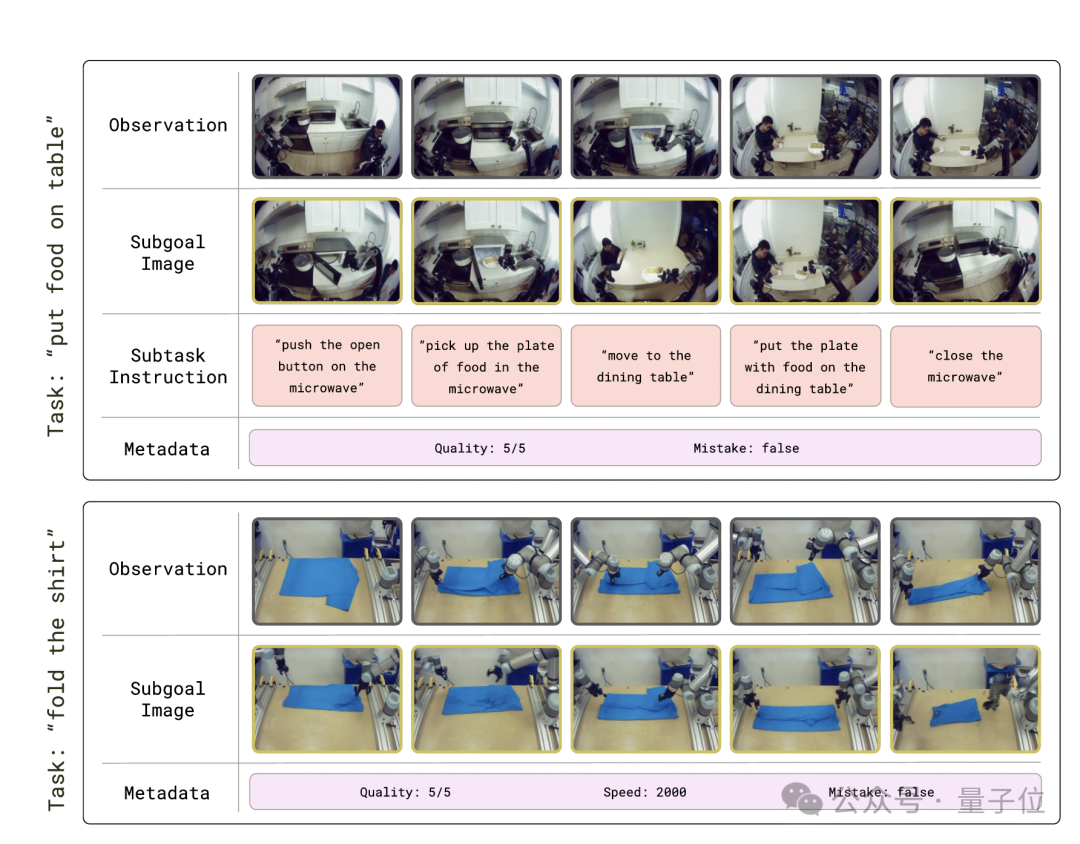

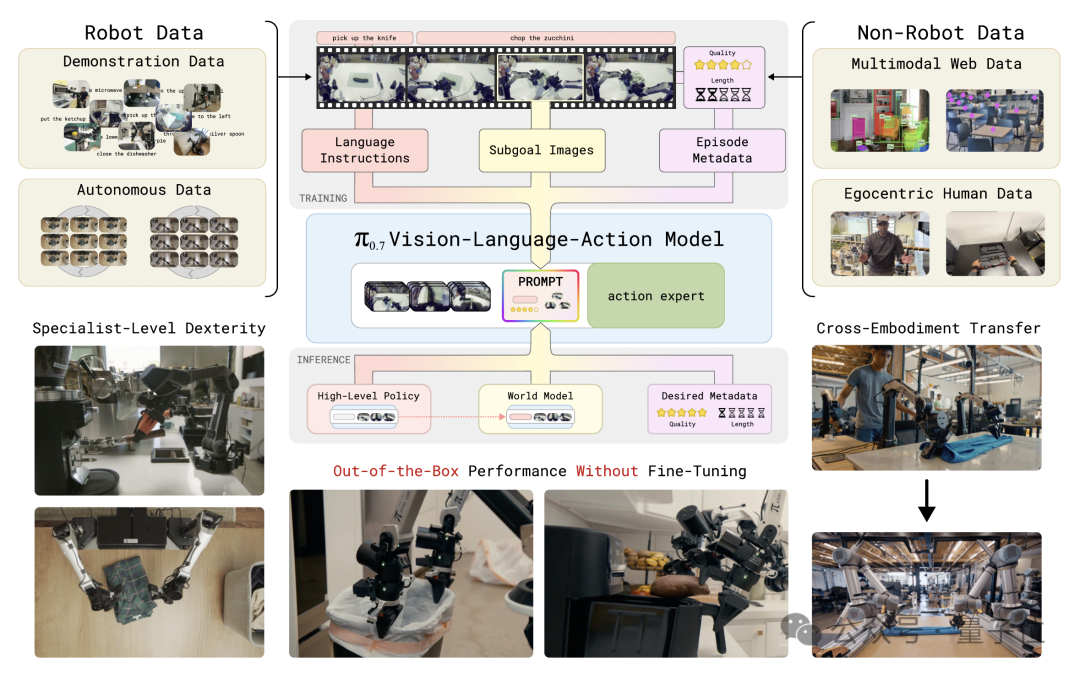

π0.7 的核心在于多样化的提示语让模型更好地理解和处理不同类别的数据输入。

以往的VLA模型在单一任务上的表现良好,但π0.7则通过多层结构化提示(包括任务指令、子任务指令及元数据)提升了模型的学习能力。

这种方式使得模型能够区分训练数据的质量,并有效利用各种类型的数据进行学习。

Physical Intelligence 的联合创始人Chelsea Finn 指出,大语言模型的微调过去仅限于特定任务,而π0.7则实现了开箱即用且性能超越了精细调整后的专家模型。

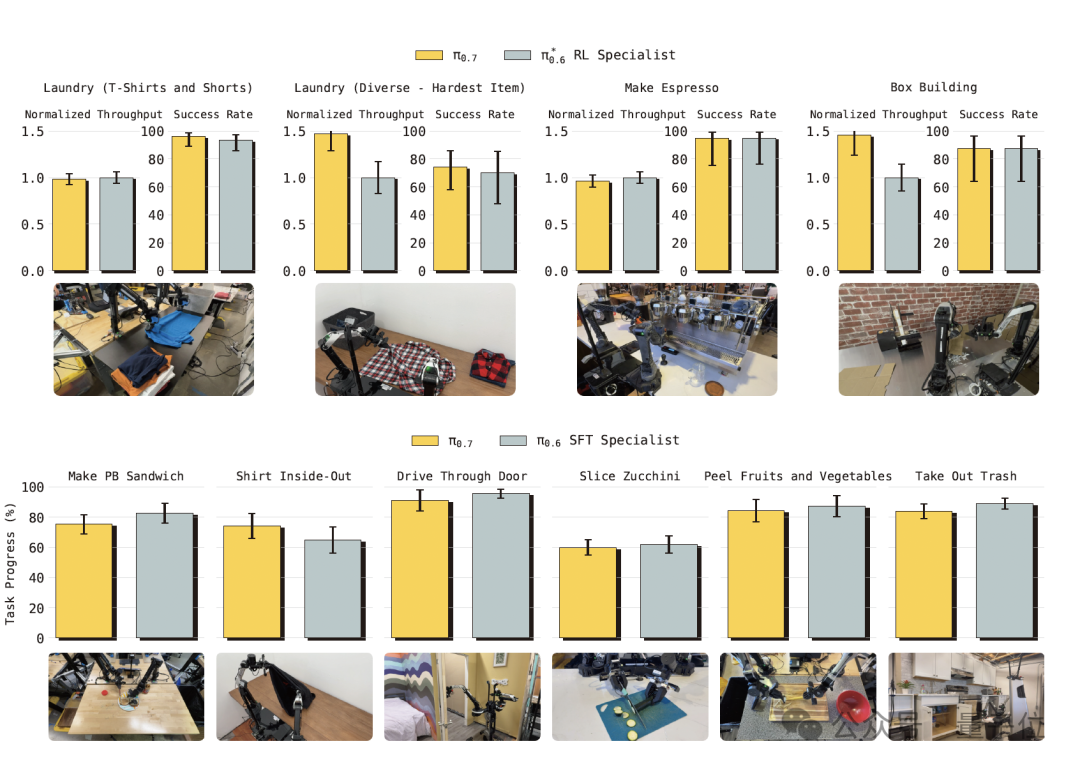

实验数据显示,在不针对具体任务进行专项训练的情况下,新模型在咖啡制作、叠衣服和装箱等复杂操作中的表现已能与经过微调的专家模型相媲美。

特别是在最难的任务上,π0.7甚至超过了为特定任务设计的专业机器人。

π0.7 的涌现能力包括了开箱即用的操作技能、指令泛化能力和跨体操泛化性能。

在四个未见过的厨房和两个陌生卧室中完成工作,并能理解复杂的指示语义,显示出模型的适应性和学习能力。

即使面对叠衣服这种之前完全没有训练过的任务,π0.7依然能够取得令人满意的成绩,其操作策略甚至优于有经验的人类操作员。

π0.7的创新之处在于从训练数据中自然地涌现出了新能力,而不仅仅是执行已知任务。

Sergey Levine 表示,一旦模型突破了只能处理已知问题的能力限制,它就能自行发展出解决未知挑战的方法。

这种方法不依赖于模拟未来世界的预测机制,而是直接通过控制指令实现机器人操作的精准性与灵活性。

从RT-2到π0.7的发展路径表明了VLM架构在机器人领域的强大潜力和广泛应用前景。

Lucy Shi 等研究人员起初认为世界模型是提升任务泛化能力的关键,但随着数据量的增长及VLA方法的不断改进,她发现VLA同样能够展现出强大的组合泛化能力。

这种现象促使Lucy进行深入研究以揭示VLA成功背后的原理,并最终促成了π0.7的研究成果。

然后它就能吃下以前吃不了的数据。失败的rollouts,低质量的演示,其他机器人的片段,人类的egocentric视频,全都变成有用的信号。

换句话说,多样数据本身不是问题,问题是模型不知道自己在学什么。

π0.7加的那层prompt,就是让模型知道“这段数据是什么质量、用什么策略做的”。

于是,具身领域第一次出现通才追平专才的涌现时刻。

通才追平专才

在转帖中,Physical Intelligence联合创始人Chelsea Finn说了一个很有意思的对比:

大语言模型的后训练,过去指的是针对下游任务做微调。一直以来,机器人也卡在这个阶段,想要最好的性能,就得针对具体任务微调。

π0.7改变了这一点:开箱即用,而且超过了fine-tuned的专家模型。

口说无凭,实验数据是这样的:

π0.7没做任何专项训练,就能在做咖啡、叠衣服、装箱三个复杂任务上,追平π0.6经过微调的的专家模型。

这里说的专家模型有两种,一种是π*0.6的RL specialist,用RECAP方法针对咖啡、装箱、叠衣服单独训过。

另一种是π0.6上的SFT specialist,针对每个任务单独微调过。

更离谱的是,在叠衣服和装箱这两个最难的任务上,π0.7的比RL specialist单位时间完成的次数更多。

可以说,一个什么都没专门训过的通才,打过了专门为某个任务训出来的专才。而这也是PI一直坚定的方向之一。

组合泛化开始涌现

π0.7的涌现能力分成四块。

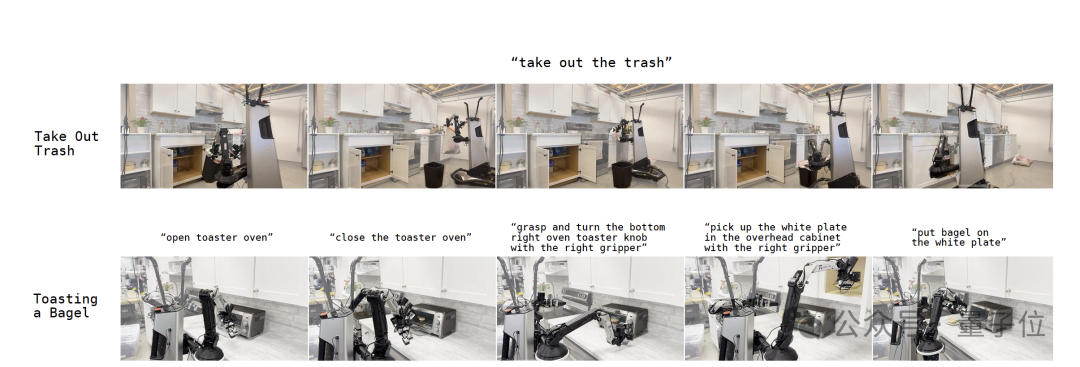

开箱即用的dexterity:做咖啡、叠衣服、剥蔬菜、削西葫芦、换垃圾袋。全部不做任务专项训练。

指令泛化:在4个没见过的厨房和2个没见过的卧室里,跟着3-6步开放指令干活。

甚至能听懂拿起那个最大盘子里的水果、拿起我用来喝汤的那个东西这种复杂空间和语义指代。

跨本体泛化:在叠T恤等任务中,训练数据里一条UR5e叠衣服的样本都没有。

π0.7不但做出来了,任务完成度85.6%,和10个平均375小时teleoperation经验的顶级人类操作员的90.9%基本打平。

而且π0.7自己琢磨出了和source robot完全不同的抓取策略——

人类操作员在源机器人上用倾斜夹爪贴住桌面抓,π0.7在UR5e上用的是垂直抓取,因为这更适合UR5e更长的手臂运动学。

组合任务泛化:

用空气炸锅做红薯、烤贝果、按下按钮、用抹布擦耳机和尺子、拧旋钮和桌面风扇,训练数据里一条都没有。

这不是多做了几个任务的增量,是机器人第一次像LLM那样,从训练数据里涌现出新能力。

正如,Sergey Levine说的:

一旦模型越过那个阈值,从「只能做收集过数据的事」变成「开始重组出新事」,能力就会超线性地随数据增长。

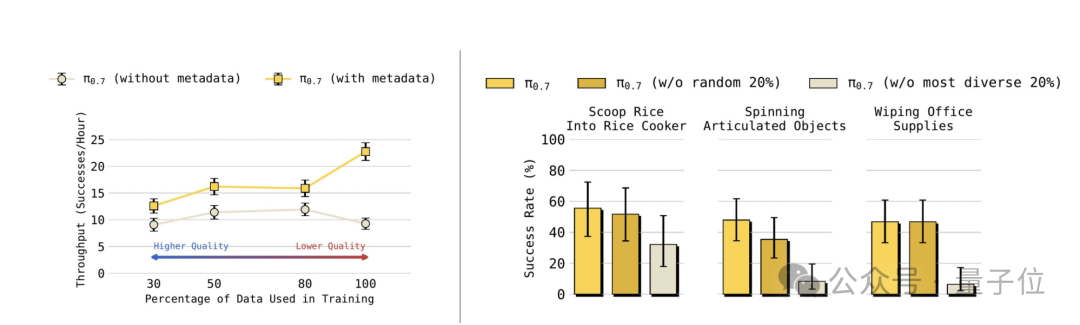

数据过滤可能是个伪问题

论文里藏着一个非常反直觉的实验。

研究把叠衣服的数据按质量分四档:top30%、top50%、top80%、全部数据。

然后分别训两个版本的π0.7,一个加metadata(每条数据打上质量几分、有没有出错、多快完成的标签),一个不加。

结果很有意思。

不加metadata的版本,数据越多,性能越差——因为混入了低质量数据把模型带歪了。

加了metadata的版本,数据越多,性能越好——哪怕平均质量在下降。

这意味着整个具身领域过去几年都在做的“数据清洗”,可能是个伪问题。

只要模型知道每条数据的质量标签,它就能自己决定要学什么、不学什么。

垃圾数据不再是垃圾,是带着quality=1/5标签的有用信号。失败数据也不是要丢掉的东西,是告诉模型这么干会失败的反面教材。

过去所有人都在小心翼翼地挑演示、删失败、洗数据。π0.7说,别洗了,告诉模型哪些脏就行。

π0.7是怎么做到的?

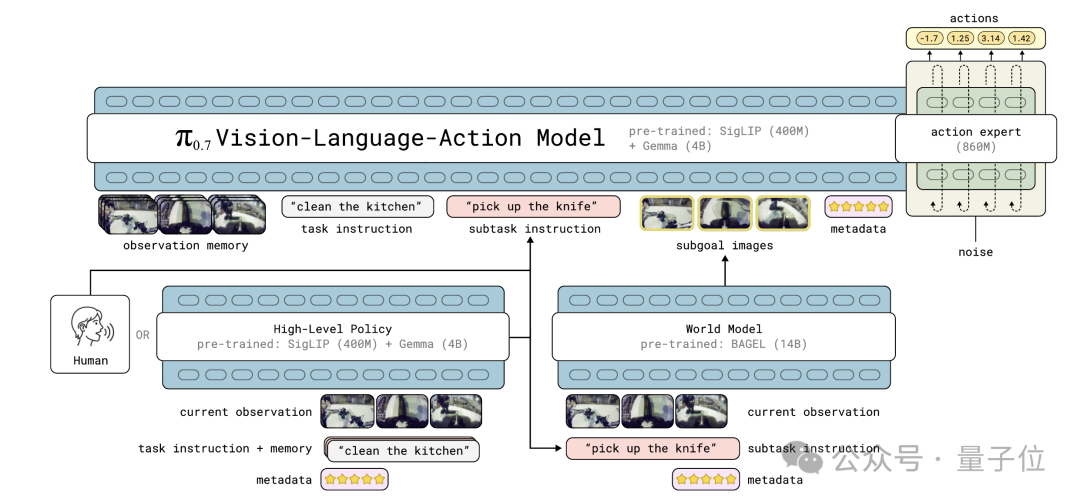

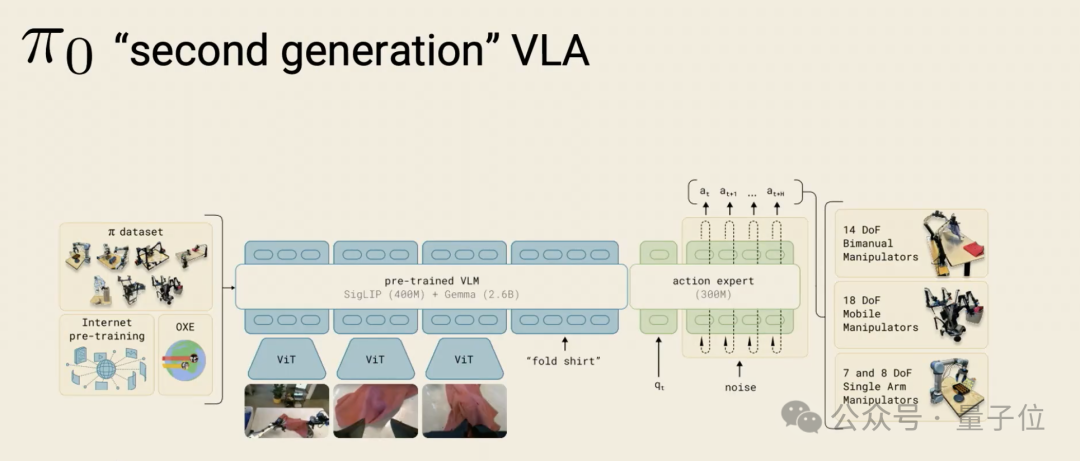

π0.7是一个5B参数的模型,分三块。

- VLM骨干:4B参数的Gemma3,负责理解视觉和语言。

- Action expert:860M参数的transformer,用flow matching生成连续动作chunk,50Hz高频控制。

- World model:从14B的BAGEL图像生成模型初始化,负责给π0.7画出未来几秒应该是什么样子。

在推理中,模型输入包括:4路摄像头(前视+两个腕部+可选后视)、每路6帧历史画面、机器人关节状态、再加上任务指令、子任务指令、元数据、以及world model实时画出的次目标图像。

输出是一段50步的action chunk,实际执行15到25步,然后再推下一段。

说到这里,可能有人会问,π0.7里塞了个world model,这算不算和世界模型派融合了?

半算,半不算。

世界模型派的核心是让模型学会模拟物理演化:给一个动作,预测世界变成什么样。policy基于这个预测做决策。

π0.7里的world model不干这事。它只负责一件事,把任务指令翻译成成功那一帧应该长啥样。不预测动作后果,不模拟物理,不参与决策链路。

它是个消歧器,不是个规划器。

用世界模型派的武器,干了一件不是世界模型派想象的事。

此外,π0.7还站在两篇前作的肩膀上,继承了π0.6的架构底子,以及MEM的多尺度记忆编码器(短期视频memory+长期语义memory)。

训练上用了Knowledge Insulation——

VLM骨干用FAST token做next-token prediction训练,action expert的梯度不回传到VLM。这样VLM从互联网学来的语义知识被保护住,不被机器人动作数据污染。

但架构不是π0.7最重要的东西,论文中也说:

我们的贡献不是提出新的架构或模型设计,而是一套让VLA能使用更多样化数据源的方法论。

VLM可以直接控制机器人,不需要先学会想象世界

在π0.7之前,具身圈最火的还是英伟达去年用Cosmos带起来的世界模型风潮。

让机器人先学会想象未来,再去操作现在。

这个路线看起来很符合直觉,人类不就是这么干的吗?闭上眼睛想一下要做什么,然后再动手。

从2025年到现在,这条路线收了最多的注意力和投入。

今天,风向又要变了——VLA回来了!

而说到VLA,压根没人比Physical Intelligence更懂。

2023年,PI联创Karol Hausman、Sergey Levine、Chelsea Finn三个人,在Google做RT-2的时候,就押注了一个判断。

VLM可以直接控制机器人,不需要先学会想象世界。

意思是,你不用让模型先学会预测下一帧画面、不用让它脑补物理规律、不用让它建立一个内部的世界模拟器。

你直接拿一个已经见过互联网的VLM,接一个动作头,端到端训,就够了。

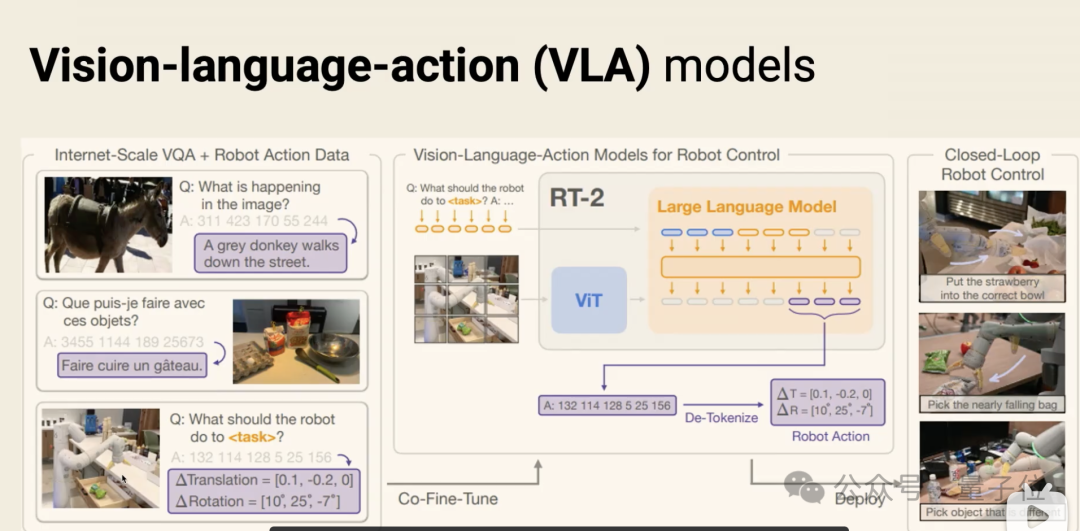

从RT-2到π0.7,其实只有两代VLA架构。

第一代是RT-2,把机器人动作离散化成token,塞进VLM的next-token prediction里。

能动,但控制精度不高,而且自回归预测生成慢,跟不上50Hz的高频连续控制。

第二代是π0开的头,给VLM接一个专门的action expert,用flow matching直接生成连续动作chunk。

中间那些模型——π0.5的open-world generalization、π0.6的RL自我练习、MEM的多尺度记忆——

都没改这个基座。都是在VLM+action expert+flow matching这个结构上往上加能力。

π0.7也是。架构上它和π*0.6没有本质差别,它加的是prompt的多样性。

这就是为什么论文里说”我们的贡献不是架构”。

但,更有意思的是另一个人。

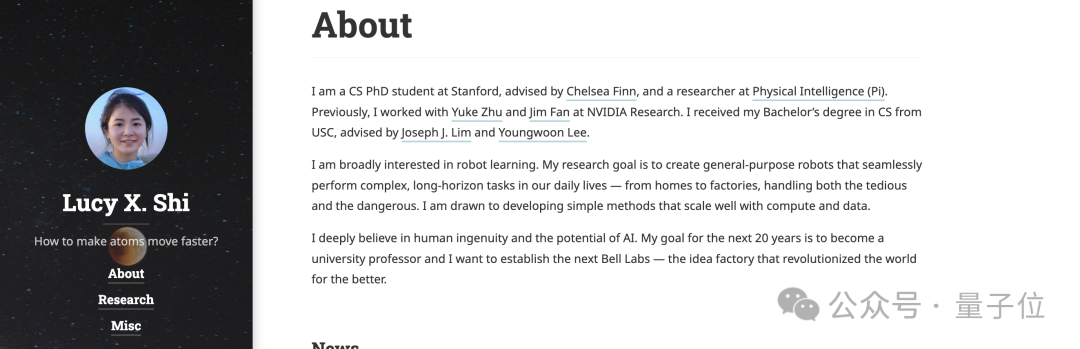

Lucy Shi,斯坦福博士生在读,师从Chelsea Finn,π0.7的核心作者之一。

她在推特上发了一条thread,讲了一个非常诚实的故事。

之前,她跟着朱玉可、Jim Fan在英伟达做世界模型。

她押的注和Karol他们相反——

世界模型会是关键的钥匙,会在任务泛化上显著超过标准VLA方法。

一开始,结果确实支持这个假设。她拿到了惊艳的组合泛化,机器人能遵循没见过的指令,做训练数据里没有的任务,从其他机器人和人类视频迁移。

但有个奇怪的事情发生了。

他们拿来对比的VLA基线,一直在变强。

随着数据越收越多,VLA越来越强,直到有一天,VLA基线也开始展示出组合泛化的信号。

而且,VLA的方法简单得多。

面对这一问题,Lucy感到无可奈何:

当你的基线吃掉了你的研究假设,你能怎么办?你写一篇论文,去搞清楚基线为什么这么强。

那篇论文,就是π0.7。

参考链接

[1]https://www.pi.website/blog/pi07

[2]https://x.com/physical_int/status/2044841263254638862

[3]https://techcrunch.com/2026/04/16/physical-intelligence-a-hot-robotics-startup-says-its-new-robot-brain-can-figure-out-tasks-it-was-never-taught/

henry

henry