多模态大模型的研发方式正在经历全面革新。

今天,商汤科技与南洋理工大学共同发布了最新技术成果NEO-unify。

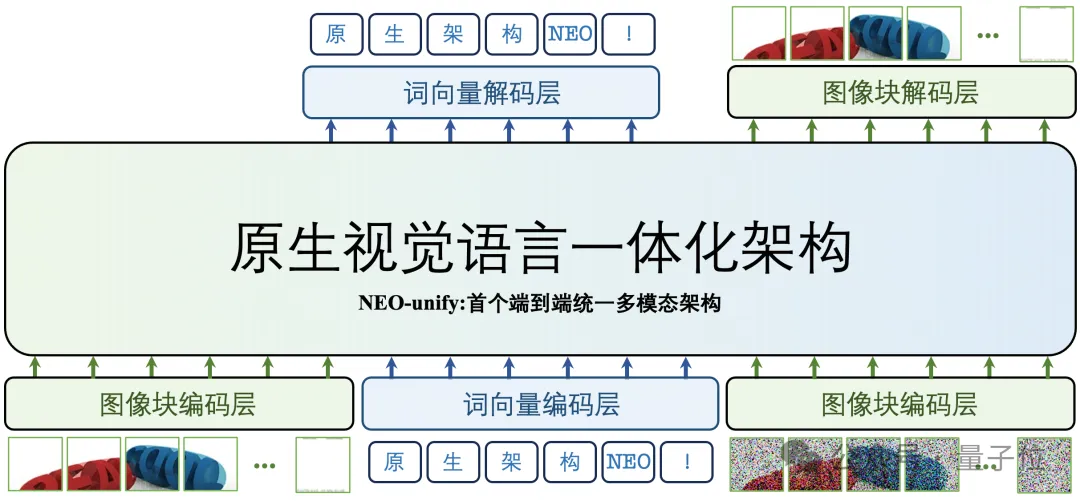

这是一个实现了“原生、统一、端到端”的多模态架构,其最突出的创新在于:

彻底摒弃了传统的视觉编码器(VE)和变分自编码器(VAE)。不再依赖组件拼凑来完成感知与生成任务,而是直接以近乎无损的形式处理像素和文字。

通过独特的混合变换器(Mixture-of-Transformer, MoT)架构,该模型在同一个框架内实现了视觉和语言的双向理解与创造功能。

技术要点一览:

- 无需编码器:跨越了关于视觉表示的长期争论,摆脱了预训练先验和规模限制;

- 混合变换器(MoT)架构:推动了视觉与语言深度融合的发展;

- 效率提升:在保持细节高度还原的同时,大幅提高了数据使用效率。

这种新架构的出现表明多模态人工智能正在从“连接各部分”转向“原生统一智能体”的演变过程。

其全新路径——无编码器、端到端和跨模态学习的一体化设计,为未来开发更强大的认知与生成系统铺平了道路。

以往,在多模态研究领域中普遍存在一种默认的实践方式:

- 视觉编码器(VE)用于感知;

- 变分自编码器(VAE)用于内容创建。

尽管这种方法在初期推动了这一领域的进步,但它也在感知和生成之间制造了一个不可逾越的鸿沟。

为了填补这个缺口,最近的研究开始探索构建共享编码器的方法。然而,这些尝试往往伴随着新的设计挑战。

应对这种局面,研究者们重新审视了基础原理:是否有可能建立一个可以处理原始输入(包括像素和文本)的统一模型?

以此为出发点,商汤科技与南洋理工大学提出了一种全新的架构理念:NEO-unify。

作为一个原生、一体化且端到端设计的多模态框架,NEO-unify不仅解决了视觉表示上的争议,还突破了预训练先验和规模限制的束缚。

最重要的是:无需依赖VE或VAE,NEO-unify实现了真正的统一处理模式。

NEO-unify首次确立了一个端到端的整体框架,可以从几乎无损的信息源头学习,并由模型自身创造内部表示空间。

首先,通过引入接近原始的视觉接口来实现图像输入与输出的一致性。

其次,采用原生混合变换器(MoT)架构,使得理解和生成可以在同一系统内协调运作。

最终,在统一学习框架下实现了跨模态训练:文本使用自回归交叉熵目标进行优化,而视觉部分则通过像素流匹配来改进。

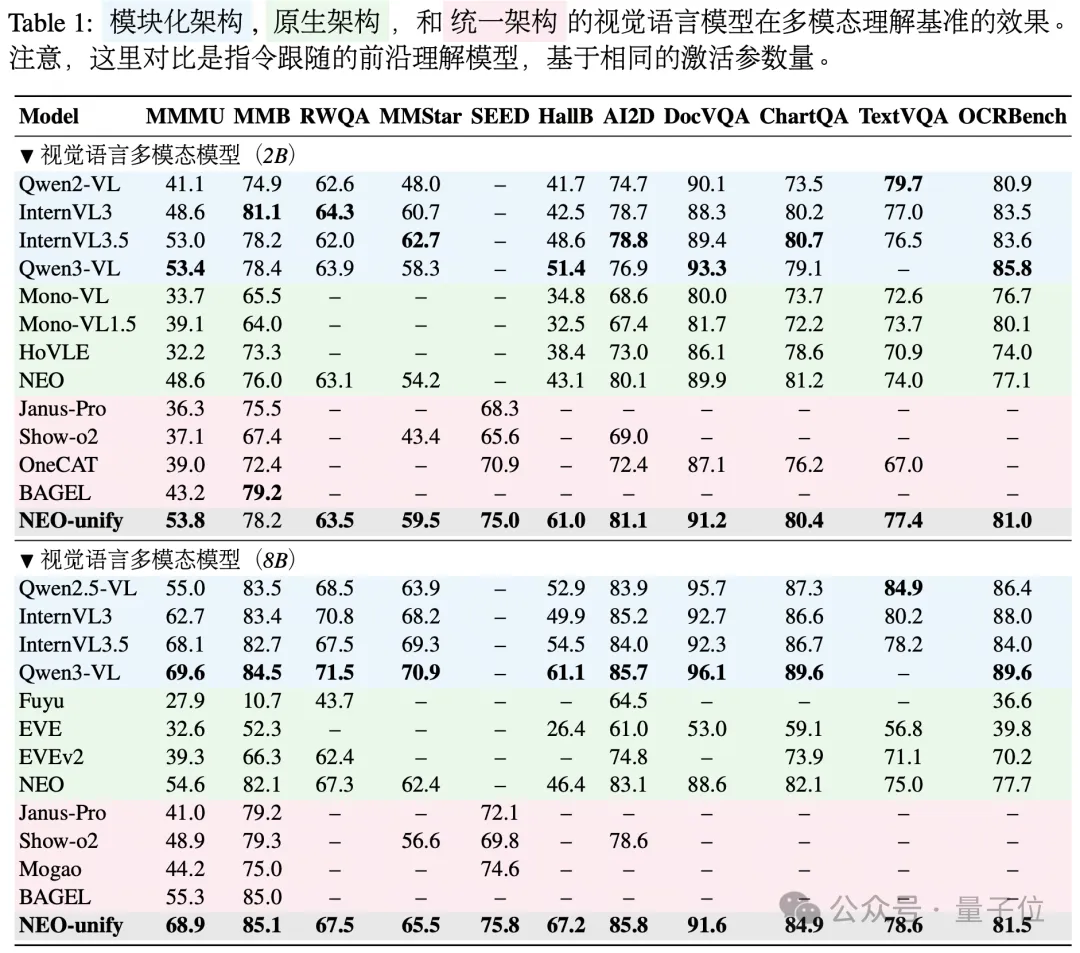

1、定量结果分析

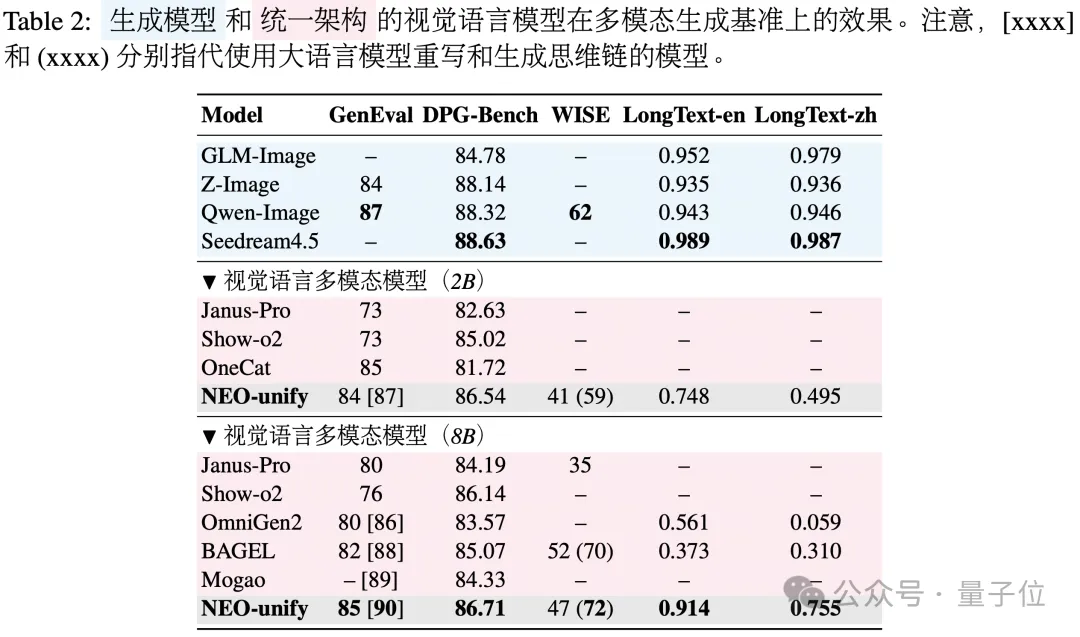

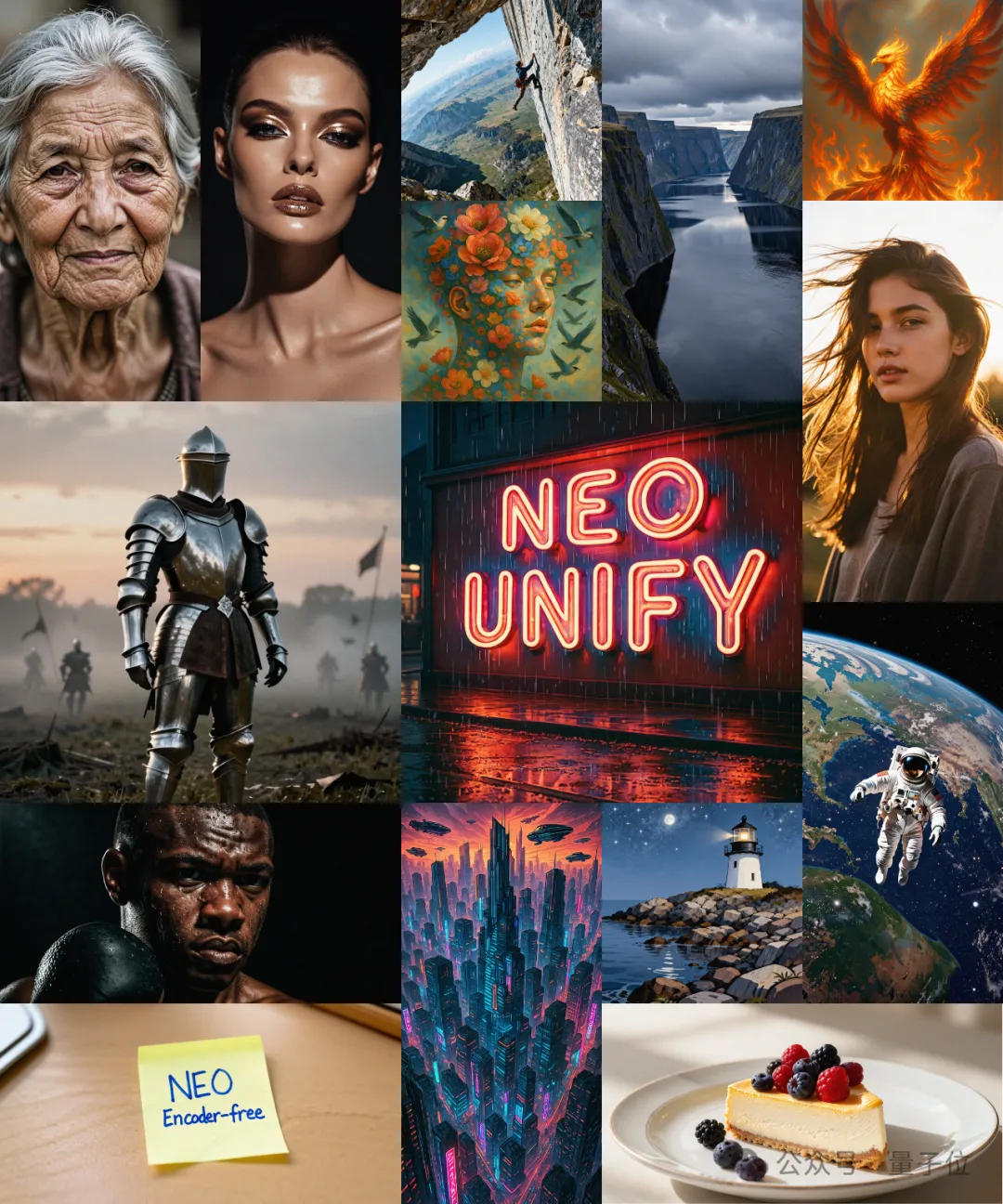

2、生图效果展示

无编码器设计可以同时保持抽象语义和细节特征

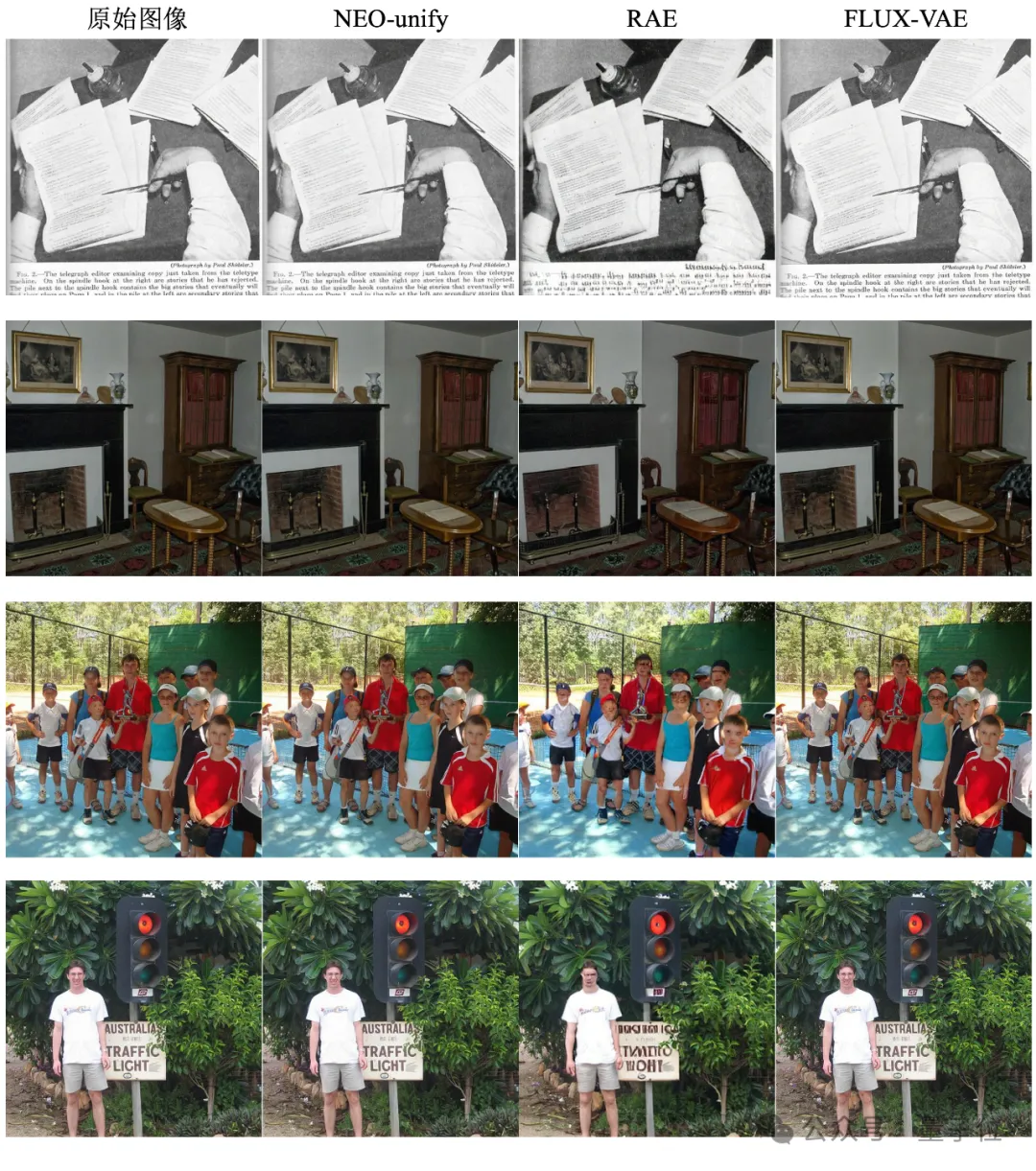

图像重建任务

团队之前的研究NEO(Diao et al., ICLR 2026)显示,原生端到端模型同样能够捕捉复杂的语义信息。

在此基础上,他们注意到即使在冻结理解分支的情况下,独立的生成分支仍能恢复细微的视觉特征。

根据这一观察结果,团队训练了NEO-unify(2B)版本。

经过初步9万步预训练后,在MS COCO 2017测试中取得了31.56 PSNR和0.85 SSIM的评分,而Flux VAE则为32.65和0.91。

这表明,即便没有预训练VE或VAE的帮助,近似无损的输入也能够同时支持高质量的理解与细节保持。

△域外图像重建(2B NEO-unify,理解分支冻结)

△域外图像重建(2B NEO-unify,理解分支冻结)图像编辑任务

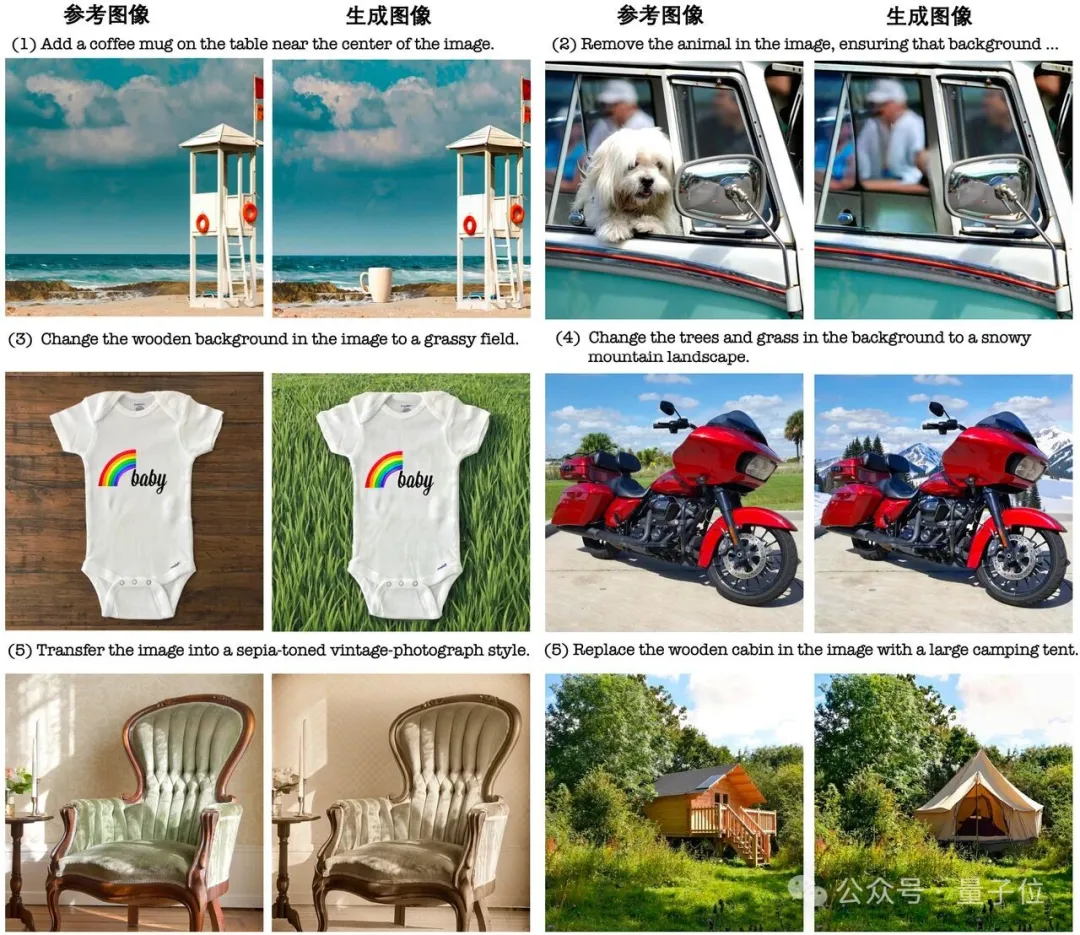

为了进一步探索,团队将所有全模态条件信息统一馈入理解分支,而生成分支仅负责图像创造。

即使在冻结理解分支的情况下,NEO-unify(2B)依然表现出强大的编辑能力,并显著减少了所需处理的图像令牌数量。

在使用开源数据集进行初步6万步混合训练后,在ImgEdit基准测试中获得了3.32的成绩,且理解分支在整个过程中保持不变。

△小规模数据验证(2B NEO-unify,理解分支冻结)

△小规模数据验证(2B NEO-unify,理解分支冻结) △ImgEdit提示词编辑(2B NEO-unify,理解分支冻结)

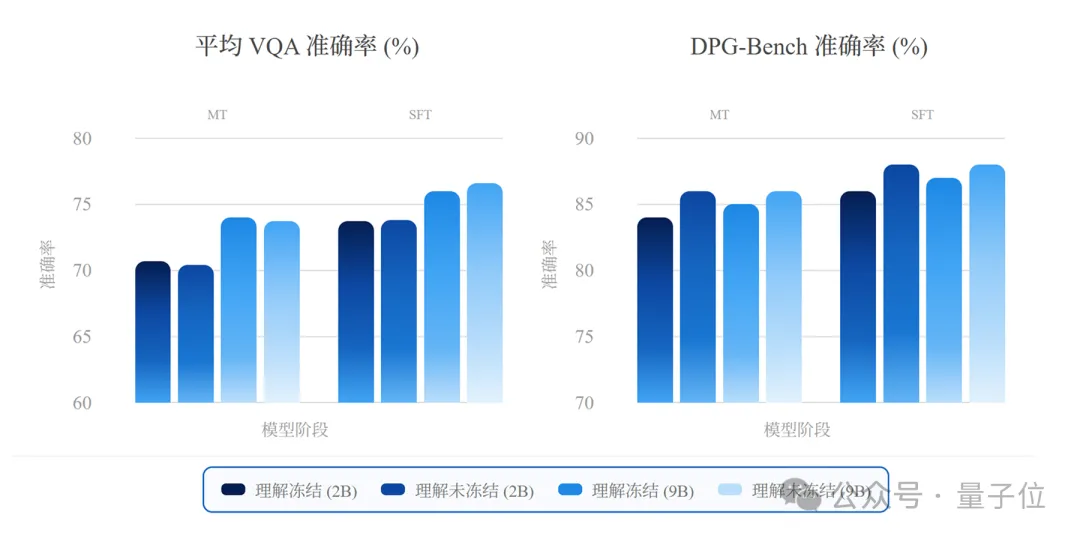

△ImgEdit提示词编辑(2B NEO-unify,理解分支冻结)利用预训练的理解和生成分支,NEO-unify在同一组中期训练(MT)与监督微调(SFT)的数据上共同学习。

即使在较低数据比例和损失权重下,理解和生成的能力都得到了快速提升,并且整体一致性非常良好。

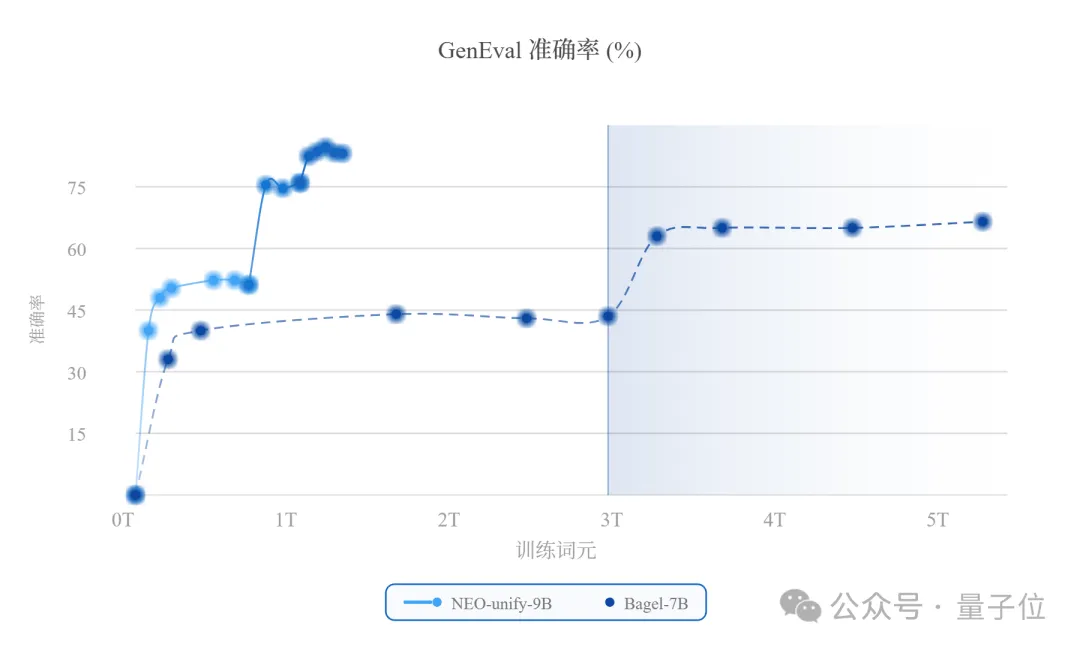

除此之外,团队首先进行了大规模预训练,随后使用丰富高质量的语料库依次进行中期训练(MT)和监督微调(SFT)。

相比于Bagel模型,NEO-unify展示了更高的数据利用效率,在较少训练token的情况下达到了更好的性能。

NEO-unify不仅仅是一次模型架构上的革新,它还预示着多模态智能将从“组件组合”走向“本质统一”的转变。

这种范式的演进描绘了通往下一代智能形态的清晰路径:

- 感知与生成交织的过程;

- 全模态和深度视觉推理能力的发展;

- 空间智能及世界模型的出现。

……

由此,一条新的技术发展路线图正在形成:

不再需要在不同模式之间进行转换,而是能够直接跨模态思考。

这种愿景下,多模态AI不再仅仅是连接不同的系统,而是在一个从未被分割的整体中自然地涌现所需的能力。

据了解,目前基于这一架构的研究工作正处于大规模扩展和持续改进的关键阶段。未来将陆续发布一系列基于此框架的模型成果与开源贡献。

Hugging Face地址:

https://huggingface.co/blog/sensenova/neo-unify

官方博客地址:

https://www.sensetime.com/en/news-detail/51170542?categoryId=1072

https://www.sensetime.com/cn/news-detail/51170543?categoryId=72