阿里巴巴在春节期间推出了Qwen 3.5系列大模型,其中包括多种不同尺寸的小型版本,如0.8B、2B、4B和9B。

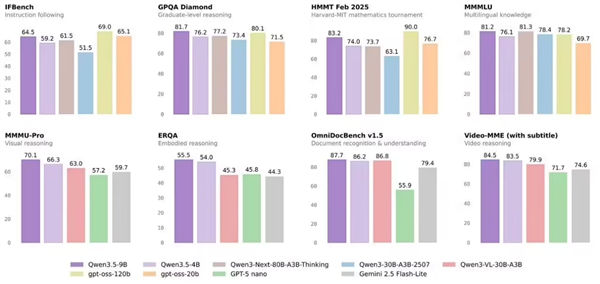

对于熟悉该系列的用户来说,小巧且性能强大的AI模型尤为吸引人。本地部署成为一种趋势,而此次发布的Qwen 3.5系列中,即使是较小的模型也表现出色,尤其是9B版本的性能几乎与gpt-oss-120B持平。

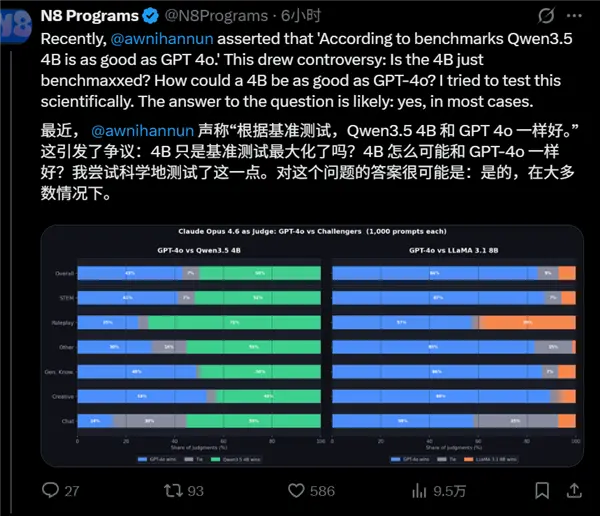

最近有消息显示,N8 Programs已经对4B版进行了实际测试,并验证了官方声称该版本性能接近GPT-4o的说法。

测试结果表明,在大多数情况下,Qwen 3.5-4B的表现优于包括GPT-4o在内的主要大型模型。

在使用WildChat数据集中的1000个随机问题进行测试后,两个大模型的回答经过最强力的大模型Opus 4.6的评判,结果显示Qwen 3.5-4B在总共1000次问答中胜出499次,败给GPT-4o 431次,其余70次打平。这证明了千问团队对产品的宣传是实事求是的。

Qwen 3.5-4B尽管只有40亿个参数,却能在性能上与拥有高达2000亿个参数量(根据微软的研究论文证实)的GPT-4o相媲美。这表明前者仅需后者约2%的计算资源就能达到相近的效果。

尽管Qwen 3.5这些较小模型无法在所有方面超越现有顶级产品,但在本地部署场景下却非常适用。理论上8GB显存就可以运行该模型,但建议使用16GB,并进行量化优化以提升性能,网络上有许多教程可供参考。

接下来是对Qwen 3.5系列各型号的一些描述:

小型版本如0.8B和2B非常适合移动设备或IoT边缘计算的部署需求,提供快速推理能力。

这些模型体积小巧且运行速度极快,特别适合需要低延迟互动的应用场景。

4B型号则作为轻量级智能体的理想选择,具备强大性能的同时保持了资源消耗的有效平衡。

它们非常适合用作智能设备的核心大脑,能够在有限的计算资源下实现高效的多模式处理。

而9B版本虽然体积更紧凑,但其卓越的性能令人印象深刻,在同等条件下可以媲美gpt-oss-120B的表现。

该型号适用于对智力水平要求较高且受限于显存资源的服务器环境部署,是性价比非常高的通用模型选项。

9B:紧凑尺寸,越级性能

特点:结构紧凑,但性能媲美 gpt-oss-120B,让人惊艳。

场景:适合需要较高智力水平但受限显存资源的服务器端部署,是性价比极高的通用模型选择。