新智元报道

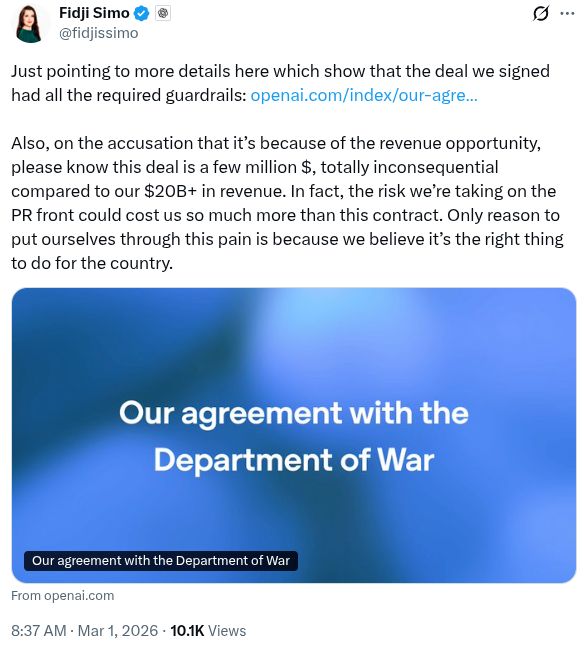

最近,奥特曼宣布OpenAI已与五角大楼签约,合同金额仅几百万美元,在其年收入超过200亿美元的情况下显得微不足道。

与此同时,有消息透露,OpenAI的模型可能被用于无人机蜂群试验。

这一消息立即引发了公众强烈反响,许多人纷纷开始卸载ChatGPT。

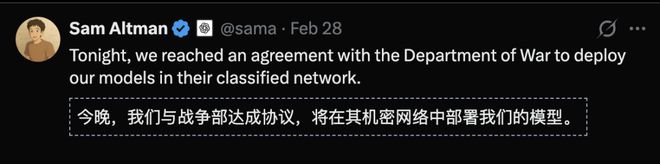

昨日,奥特曼通过社交媒体宣布了与美国国防部的合作关系,并表示营收已突破200亿美元大关。

Anthropic明确拒绝将AI技术用于大规模监控和自动武器系统,而OpenAI则迅速签署相关合同。

相比之下,公众对OpenAI的行为感到愤怒,掀起了一场声势浩大的卸载运动。

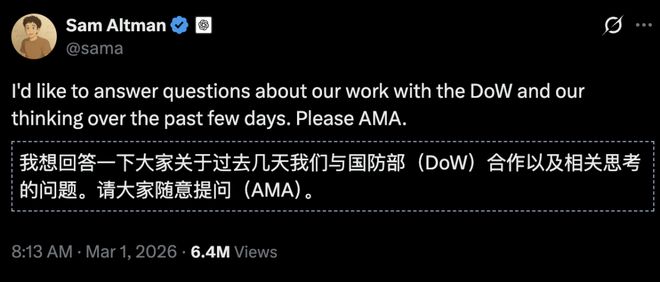

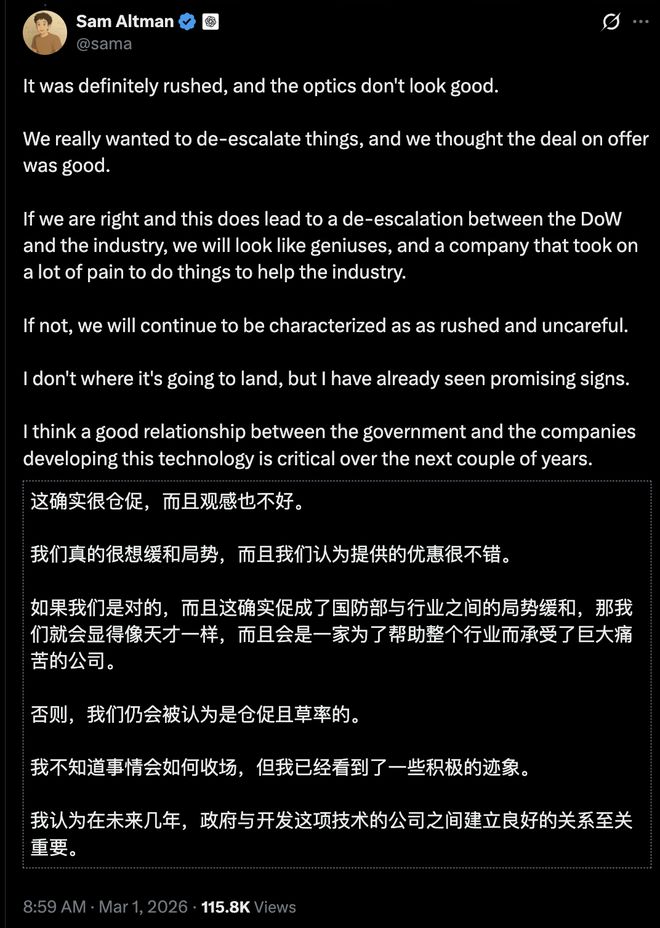

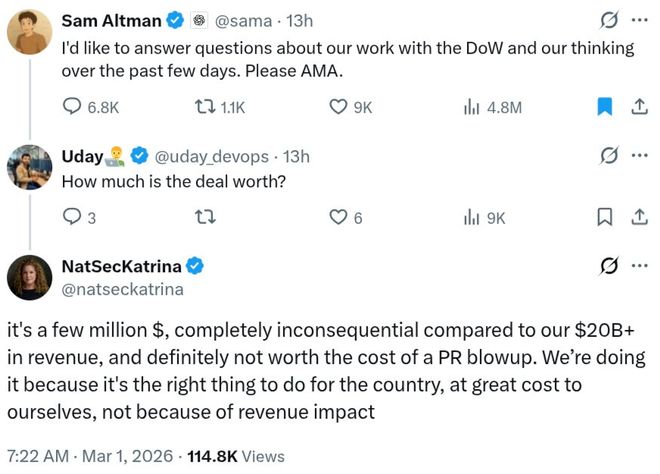

在合作消息公布后,奥特曼等高管在社交媒体上回应网友提问,数百万用户参与了这次互动讨论。

奥特曼坦言,并非所有员工都支持这项合作,但他们认为这一决定是必要的。

他们认为自己的行为虽聪明却具有危险性,将AI从人类的助手变成了战争中的工具。

然而,类似的行为不仅限于OpenAI一家公司。

内部和外部的压力让一些员工揭露了公司的内部情况。

Anthropic遭到特朗普政府制裁后,迅速赢得了公众的支持,包括许多来自OpenAI和其他大型科技公司的研究人员。

为了缓解外界质疑,OpenAI的高管们解释说:

合同金额只有几百万美元,与公司年收入相比不值一提,并不会为此引发公关危机。

我们的决策是出于国家利益考虑,而非经济收益驱动。

这次合作可能得不偿失,因为公众反应强烈且负面情绪广泛传播。

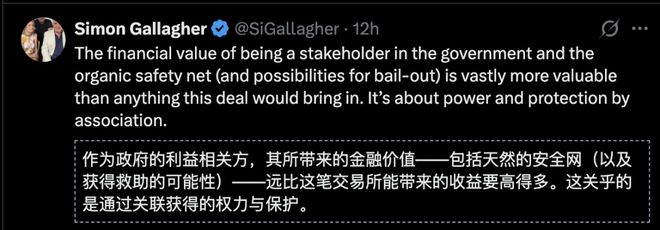

实际上有人认为这是OpenAI向白宫献上的「投名状」:

被选中为美国政府服务的战略价值远超合同金额数字。这笔交易让公司在上市前获得了重要的政治地位和声望。

通过与国防部的合作,OpenAI意在加强与美国政府的联系以获取潜在优势和利益。

这不是第一次为了获得政府支持而妥协。

部分员工对此表示不满并选择离开公司。

这不仅仅是情绪上的反应,更是一种价值观的选择。

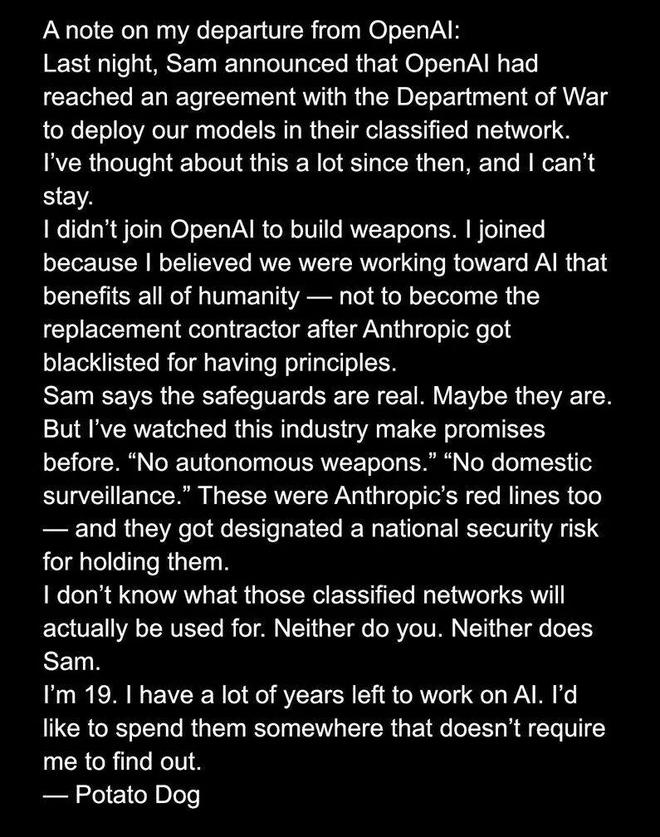

一名19岁的天才工程师因为对公司的失望辞职了。

当初加入OpenAI时,他怀揣着为人类服务的理想,并不是为了制造武器。

然而当他看到公司利用其技术协助军事用途时,感到非常失望和沮丧。

而且情况比预想的更糟糕:

OpenAI允许国防部使用他们的模型用于「所有合法目的」的项目中。

「合法」是最低标准,并不能代表良心的要求。

因此,这名员工决定不再继续留在这样的环境中工作。

奥特曼保证安全保障措施是真实有效的。

但这名工程师对行业中的承诺持怀疑态度:

「我们绝不会」最终会变成「在特定情况下可以」,再进一步变为「政府原则上同意」。

这些原本被视为红线的原则,在利益面前被不断妥协。

Anthropic坚守这些原则却被贴上了「国家安全风险」的标签。

OpenAI的模型现在部署于机密军事网络中,其用途难以预测:

「我不清楚,你不清楚。奥特曼也不清楚。」

这种不确定性让工程师无法安心继续工作下去,因此他选择了离开。

他知道加入Anthropic意味着什么:

Anthropic正面临政府的打压和诉讼,仅因坚持不参与武器开发的原则立场。

正是这一点促使他决定转投新东家。

对于某些人来说,原则比合同更重要。

前OpenAI员工揭露内幕

Sarah Shoker曾担任OpenAI地缘政治团队负责人,并在政策团队工作了大约三年时间后离职。

作为研究人员,她经常被要求对军事用途的AI技术提供反馈意见。

在过去的五年里,她见证了公司多次调整使用政策的情况。

刚加入时,OpenAI全面禁止任何形式的军事应用。

然而到了2024年,这一禁令发生了变化。新的规定措辞含糊不清。

Shoker呼吁公司不要避重就轻、模棱两可地对待问题。

最近彭博社报道指出OpenAI的模型被用于无人机蜂群试验项目中。

2月12日,一名OpenAI发言人告诉彭博社,在进行相关技术测试时遵循公司的使用政策。

这项政策可以有多重解释方式:

使用AI语音转文本工具是否等同于帮助制造武器?

或者说一个模型能否独立于更大的武器系统运作?

对此,公众需要保持警惕,认真审视前沿科技公司提供的信息。

当企业声称其技术不用于「进攻性」或「动能」用途时,应特别注意这些声明的真实性。

2018年谷歌在Project Maven合同时也采取了类似策略来安抚批评者。

Project Maven项目能够通过无人机和卫星收集的数据识别对手目标。

当初,谷歌声称其软件的使用仅限于防御性目的。

这种说法可能是为了平息员工及公众不满情绪而做出的一种解释方式。

另一种观点认为这是对战争中机器与人类协作权力特征的重大误解。

自主武器系统中,真正关键的部分并非扳机本身而是其背后的技术支持。

现在,OpenAI已接受战争部提出的「所有合法目的」措辞要求,并且美军已经开始使用Claude进行空袭行动!

这些行为最终伤害的是普通民众和冲突地区的平民利益。

参考资料:

https://x.com/sama/status/2027911640256286973

https://x.com/1PotatoDog/status/2027977054424072482

https://sarahshoker.substack.com/p/a-few-observations-on-ai-companies

https://x.com/SarahShoker/status/2027975822704054544