稀宇科技于3月18日发布了新一代Agent旗舰大模型M2.7,首次展示了“模型自我进化”的路径。该模型通过构建Agent Harness体系,据称能够使模型深度参与自身训练与优化流程。在部分研发场景中,M2.7可以承担约30%至50%的工作量,并在内部测试中实现了约30%的效果提升。

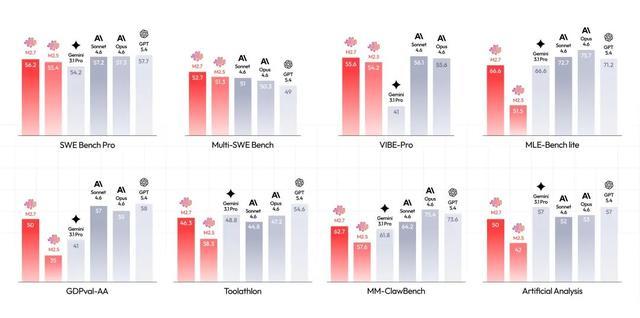

在SWE-Pro中,涵盖多种编程语言的测试,M2.7以56.22%的正确率与GPT-5.3-Codex持平;在代码生成基准VIBE-Pro上,M2.7得分55.6%,接近Opus 4.6的水平。

以下是官方详细介绍:

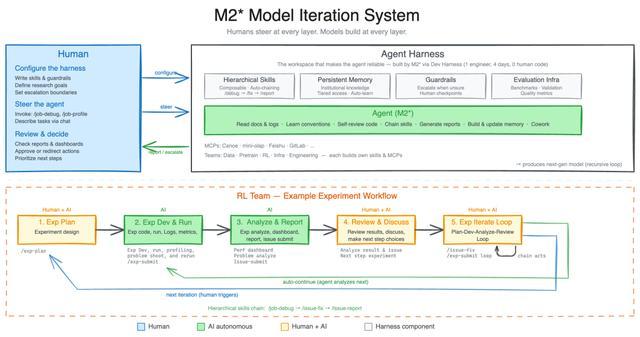

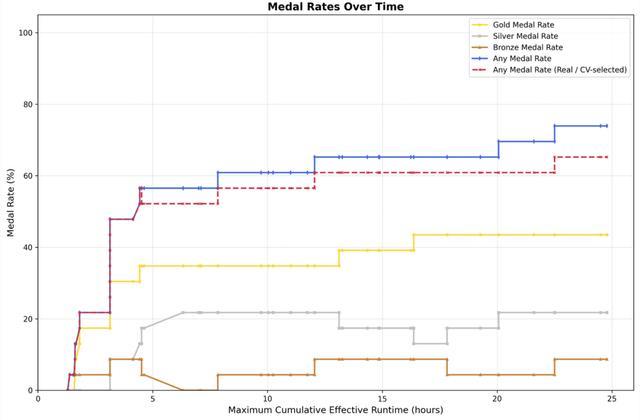

M2.7具备构建复杂Agent Harness的能力,利用Agent Teams、复杂Skills、Tool Search tool等,完成高度复杂的生产力任务。例如,在研发M2.7的过程中,通过模型构建强化学习Harness中的数十个复杂Skills,更新自己的记忆,驱动模型的强化学习,并根据结果优化强化学习过程和Harness,开启模型自我进化。

M2.7在真实软件工程中表现出色,包括端到端的项目交付、分析日志排查Bug、代码安全以及机器学习等。在SWE-Pro基准测试中,M2.7得分56.22%,几乎达到Opus最佳水平。这一能力同样在端到端项目交付场景(VIBE-Pro 55.6%)和复杂工程系统理解(Terminal Bench 2 57.0%)中得以体现。

在专业办公领域,M2.7在各领域的专业知识和任务交付能力方面得到了提升,其在GDPval-AA评测中的ELO得分是1495,为开源最高。M2.7在处理Excel、PPT和Word等办公软件的复杂编辑任务上表现出色,能够高效完成多轮修改和高保真的编辑。M2.7在使用40个复杂Skills(超过2000 Token)的情况下,保持了97%的Skills遵循率。在OpenClaw测试中,M2.7相比M2.5有了显著提升,接近Sonnet 4.6的水平。

M2.7具备优秀的身份保持能力和情商,除了生产力使用外,还为互动娱乐场景的创新提供了空间。

基于上述能力,M2.7在加速公司向AI原生组织的进化过程中发挥了关键作用。

01、智能体自我进化能力构建

我们分享了M2系列模型自我进化的内部实践,这是对模型Agent能力边界探索的一部分。

Agent Harness通常依赖复杂的Skills、记忆系统和其他组件来提升模型对不同工作环境的适应能力。在此基础上,我们在M2的早期版本中将其引导为一个研究型Agent框架——它可以与不同的研究项目组进行交互和协作。该系统覆盖了数据流水线、训练环境、评测基础设施、跨团队协作、持久化记忆——让研究员可以驱动它来交付更好的模型。研究Agent驱动着下一代模型的迭代循环。研究员在每一层引导方向,模型在每一层负责构建。

以一个RL场景为例:研究员从一个实验想法出发,与Agent展开讨论。Agent协助进行文献调研,持续跟踪预设的实验规格,完成数据流水线及其他对接工作,并启动实验。实验运行期间,它会自动监控和分析实验状态,并自动触发日志读取、问题排查、指标分析、代码修复、合并请求以及冒烟测试,识别并配置那些细微但关键的变更。这些工作过去可能需要来自不同团队的多位同事协作完成,而现在研究员只需在关键决策和讨论时介入。这大幅加速了问题发现和实验迭代,从而更快地交付结果。M2.7在这样的场景中可以承担约30%至50%的工作量,并在内部测试中实现了约30%的效果提升。

在Office场景中,Agent变得越来越有用,我们认为这是两个核心能力:

专业知识与任务交付能力。模型需要具备各领域的专业知识,理解用户的需求。在衡量这一能力的GDPval-AA评测中,M2.7在45个模型中的ELO得分为1500,仅次于Opus 4.6、Sonnet 4.6和GPT5.4,超过了GPT5.3。在最常见的办公文件处理上,我们系统性地优化了模型处理Word、Excel和PPT的能力。M2.7在各种Agent Harness上,既能够基于模板和Skills直接生成文件,也能够遵从用户的交互指令,对已有的文件做多轮的高保真编辑,最终给出可编辑的产物。

与复杂环境的交互能力。泛化的日常场景意味着模型需要灵活适应各类上下文、调用各种Skills和工具,并在长程交互中保持稳定的指令遵循。M2.7在这些方面有大幅提升。在Toolathon上,M2.7的正确率达到了46.3%,达到了全球第一梯队水平。真实工作场景中的Agent Harness往往也需要理解和调用大量复杂的Skills。在MM-Claw测试中,M2.7在40个复杂Skills(超过2000 Token)的case上,仍能保持97%的Skills遵循率。

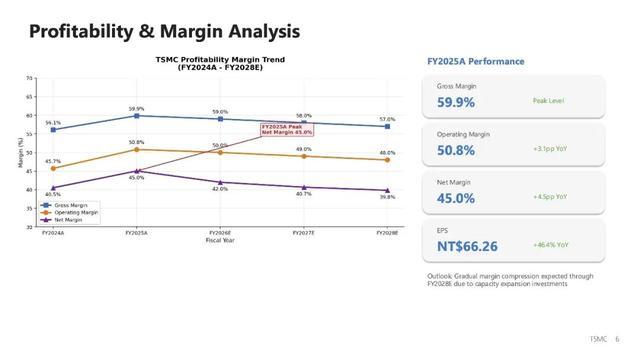

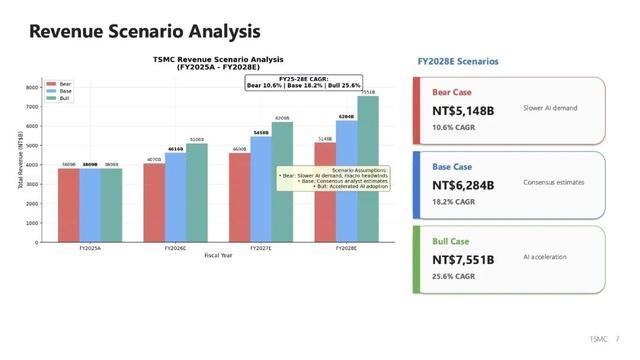

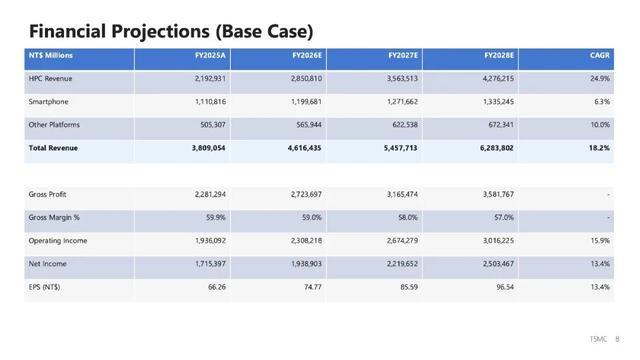

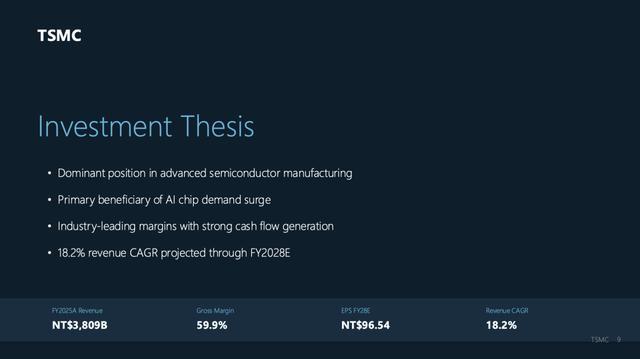

我们测试了在Finance领域的专业水准,与上代模型相比,模型的能力提升显著。例如,在Finance领域一个阅读研报并建模公司未来营收的场景,M2.7可以自主阅读公司的年报与业绩沟通会纪要,交叉比对多篇研报,独立设计假设并构建营收预测模型,再基于模版产出PPT和研究报告——像一个初级分析师一样理解、判断、输出,并在多轮交互中自我修正。从业者的评价是:产出物已经可以作为初稿直接进入后续工作流程。

最近以OpenClaw为代表的Agent社区蓬勃发展,我们很高兴看到M2系列模型帮助到了社区的繁荣。我们基于OpenClaw中的常用任务,构建了一个评测集MM-Claw,涵盖个人学习规划,到办公文档的处理与交付、定时的专业信息调研与投资建议、代码开发与维护等工作与生活中形形色色的真实需求。M2.7在这个测试中达到了接近Sonnet 4.6的水平,正确率是62.7%。

在OpenClaw等Agent脚手架的使用过程中,不少用户在使用Agent完成工作的同时,还希望模型具备比较高的情商和复杂人设保持能力。在有人设的情况下,用户不再只是让模型机械完成任务,而是开始自然于与Agent“相处”。这促使我们思考,产品与交互设计、内容创作、甚至娱乐体验的构建,都可以被AI原生驱动的可能性。我们认为这会让Agentic模型的使用从单纯的生产力能进一步拓展到互动娱乐。为此,我们在M2.7中极大加强了人设保持和对话能力。

02、真实的软件工程

基于此,我们构建了一个Agent交互系统OpenRoom,它将AI互动置入一个万物皆可互动的Web GUI空间。在这里,对话即驱动,实时产生视觉反馈与场景交互,角色可以主动地与环境交互。我们认为这个框架扩展性较高,能够随着模型Agentic能力的提升和社区的共建持续进化,探索出更多人与Agent之间全新的交互方式。

以线上最常见的线上生产环境故障调试为例 —— 这类任务不仅需要生成代码,还需要很强的综合推理能力。面对我们实际的生产环境告警,M2.7 能关联监控指标与部署时间线做因果推理,对轨迹采样做统计分析并提出精准假设,主动连接数据库执行验证根因,定位到代码仓库中缺失的索引迁移文件,甚至知道用非阻塞建索引先止血,再提 MR。

从可观测性分析、数据库专业知识到 SRE 级别的决策判断 —— 这不只是一个会写代码的模型,而是一个真正理解生产系统的模型。相比传统的人工排障流程,基于 M2.7,我们已多次将线上生产系统故障的恢复时间缩短到三分钟以内。

在单项编程能力上,M2.7 已具备国际一线模型水准。在涵盖多种编程语言的 SWE-Pro 中,M2.7 以 56.22% 的正确率追平 GPT-5.3-Codex;而在更贴近真实工程场景的 SWE Multilingual(76.5)和 Multi SWE Bench(52.7)中展现出更显著优势。

这一能力同样延伸到了端到端的完整项目交付场景。在 Repo 级代码生成基准 VIBE-Pro 上,M2.7 得分 55.6%,几乎与 Opus 4.6 持平 —— 这意味着无论是 Web、Android、iOS 还是 Simulation 类需求,都可以直接交给 M2.7 完成。

更值得关注的,是对复杂工程系统的深层理解。在对系统认知要求极高的 Terminal Bench 2(57.0%)和 NL2Repo(39.8%)中,M2.7 同样表现稳健,进一步印证了它不只擅长代码生成,更能深入理解软件系统的运行逻辑与协作流程。

为了提升开发效率,一个比较重要的特性是原生的 Agent Teams (多智能体协作)。Agent Teams 对模型提出了范式级要求:角色边界、对抗性推理、协议遵循、行为分化 —— 这些无法通过提示词,必须内化为模型的原生能力。

Agent Teams 场景下,模型需要稳定锚定角色身份、主动挑战队友的逻辑与伦理盲区、在复杂状态机中自主决策。下面是我们内部使用的一个做产品原型开发的 Agent Teams,里面包含了做产品原型的一个最小组织。

Agent Teams 协作模拟演示

03、专业办公

除了软件工程外,Agent 开始在办公场景中变得越来越有用,我们认为这是两个核心能力:

专业知识与任务交付能力。模型需要具备各领域的专业知识,理解用户的需求。在衡量这一能力的 GDPval-AA 的评测中,M2.7 在 45 个模型中的 ELO 得分是 1500,仅次于 Opus 4.6、Sonnet 4.6 和 GPT5.4,超过了 GPT5.3。在最常见的办公文件处理上,我们系统性地优化了模型处理 Word、Excel 和 PPT 的能力。M2.7 在各种 Agent Harness 上,既能够基于模版和 skills 直接生成文件,也能够遵从用户的交互指令,对已有的文件做多轮的高保真编辑,最终给出可编辑的产物。

与复杂环境的交互能力。泛化的日常场景意味着模型需要灵活适应各类上下文、调用各种 skills 和工具、并在长程交互中保持稳定的指令遵循。M2.7 在这些方面有大幅提升。在 Toolathon 上,M2.7 的正确率 46.3%,达到了全球第一梯队水平。真实工作场景中的 Agent Harness 往往也需要理解和调用大量复杂的 skills。在 MM-Claw 的测试中,M2.7 在 40 个复杂 skills (> 2000 Token) 的 case 上,仍能保持 97% 的 skills 遵循率。

我们测试了在 Finance 领域的专业水准,与上代模型相比,模型的能力提升显著。例如,在 Finance 领域一个阅读研报并建模公司未来营收的场景,M2.7 可以自主阅读公司的年报与业绩沟通会纪要,交叉比对多篇研报,独立设计假设并构建营收预测模型,再基于模版产出 PPT 和研究报告 —— 像一个初级分析师一样理解、判断、输出,并在多轮交互中自我修正。从业者的评价是:产出物已经可以作为初稿直接进入后续工作流程。

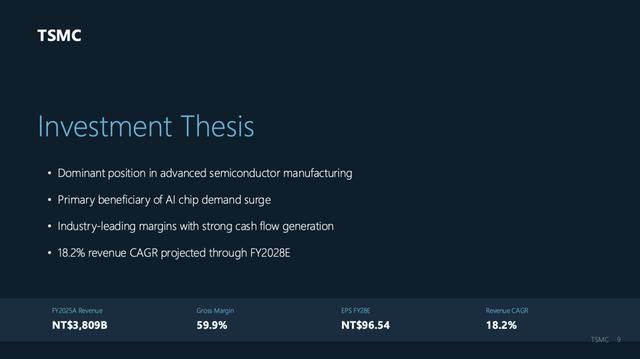

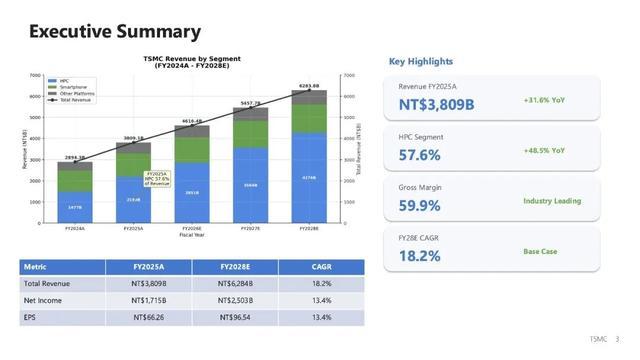

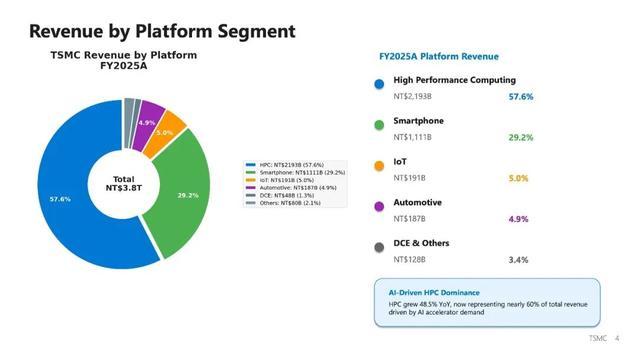

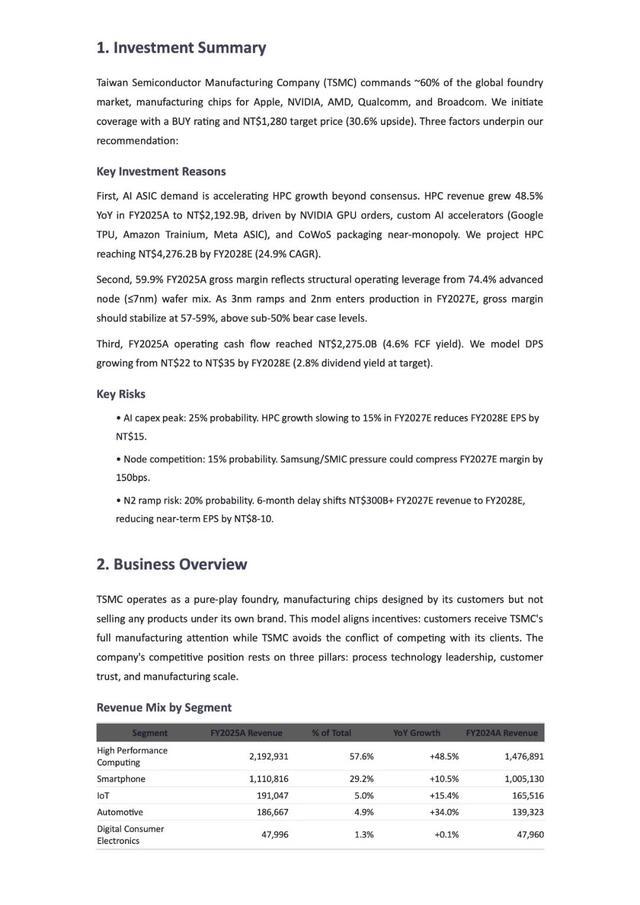

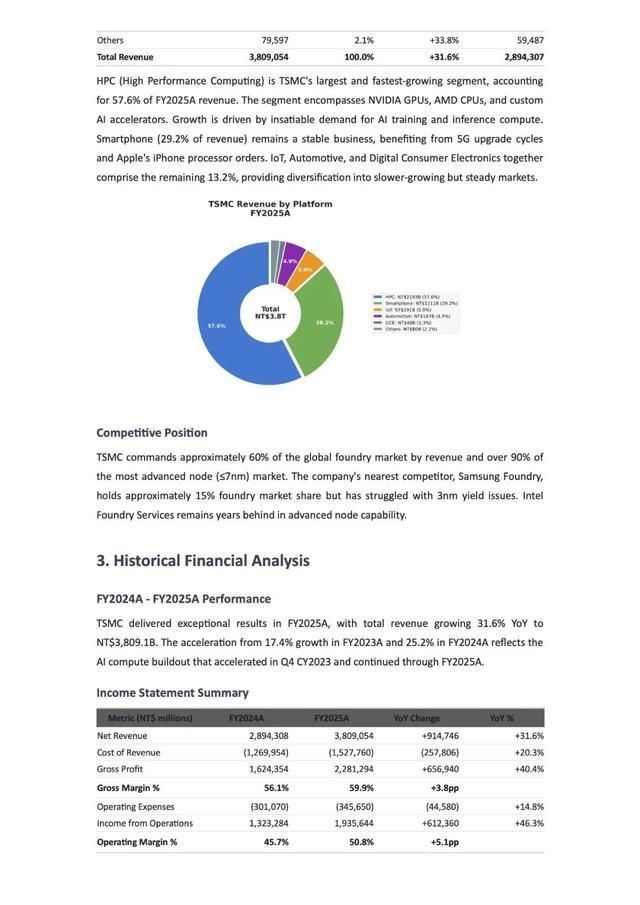

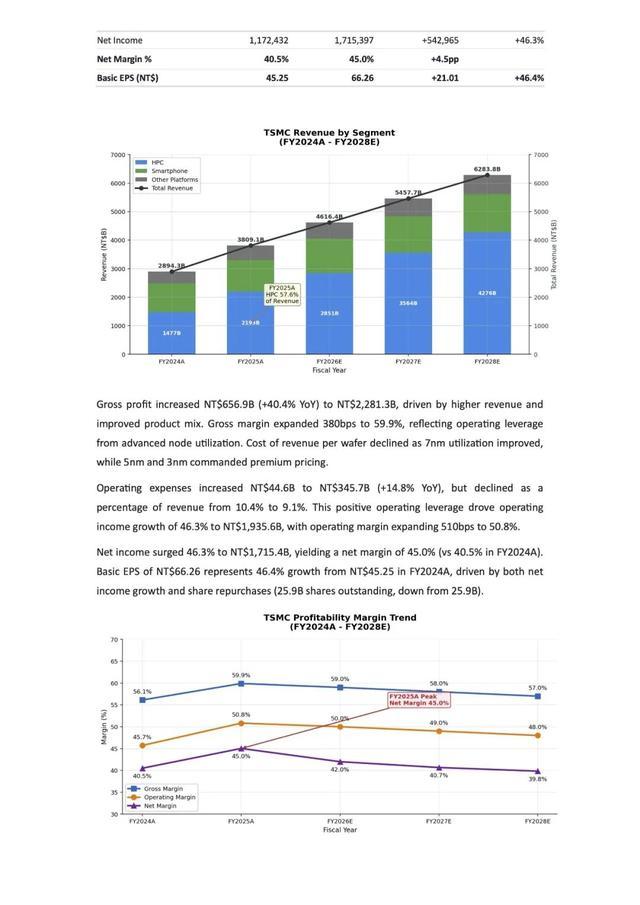

下面是一个关于台积电的例子。

任务:基于台积电年报和业绩沟通会信息,构建台积电的营收模型,读取多个研报,设计对应的假设,基于最新的信息对台积电营收建模,然后基于 PPT 模版产出 PPT ,并写一个 Word 文档研究报告和 Excel 图表。

① PPT 报告演示

② Word 调研报告

最近 OpenClaw 爆火为代表的 Agent 社区蓬勃发展,我们很高兴看到 M2 系列模型帮助到了社区的繁荣。我们基于 OpenClaw 中的常用任务,构建了一个评测集 MM-Claw,涵盖个人学习规划,到办公文档的处理与交付、定时的专业信息调研与投资建议、代码开发与维护等工作与生活中形形色色的真实需求。M2.7 在这个测试中达到了接近 Sonnet 4.6 的水平,正确率是 62.7%。

04、互动娱乐

在 OpenClaw 等 Agent 脚手架的使用过程中,不少用户在使用 Agent 完成工作的同时,还希望模型具备比较高的情商和复杂人设保持能力。在有人设的情况下,用户不再只是让模型机械完成任务,而是开始自然于与 Agent “相处”。这促使我们思考,产品与交互设计、内容创作、甚至娱乐体验的构建,都可以被 AI 原生驱动的可能性。我们认为这会让 Agentic 模型的使用从单纯的生产力能进一步拓展到互动娱乐。为此,我们在 M2.7 中极大加强了人设保持和对话能力。

基于此,我们构建了一个 Agent 交互系统 OpenRoom,它将 AI 互动置入一个万物皆可互动的 Web GUI 空间。在这里,对话即驱动,实时产生视觉反馈与场景交互,角色可以主动地与环境交互。我们认为这个框架扩展性较高,能够随着模型 Agentic 能力的提升和社区的共建持续进化,探索出更多人与 Agent 之间全新的交互方式。