AI 技术正在重塑音乐行业。

在过去两年中,AI 创作音乐的速度已经远远超过了人们的预期。

以往创作一首歌曲需要经历填词、谱曲、编排、录制和混音五个阶段,耗时至少半个月以上,并且成本高昂。而如今,有了 AI 的帮助,输入一个简短的提示语就能直接生成完整的作品,大大降低了制作成本。

现在,我们甚至不需要自己编写提示词了,只需上传一首喜欢的歌曲让 AI 进行翻唱,便可以轻松获得想要风格的音乐作品。即使是完全不懂音乐的人也能短时间内创作出属于自己的歌。

低成本的时代已经到来,AI 正在推动音乐创作进入一个新时代。

MiniMax 最近发布了一项重要更新,其中最重要的新功能是 Cover 翻唱服务。

一首普通的生日快乐歌可以被重新演绎成 EDM 风格:

经典的《友谊地久天长》也能被 AI 改编为灵魂乐风格:

同时,MiniMax 还推出了 Music 2.6 模型,并发布了专门的音乐技能插件。

相较于前一版本,Music 2.6 的主要改进包括速度、音乐性和音质方面。预计首包延迟时间将减少至 20 秒以内;乐器种类更加丰富多样,人声听起来更接近真实演唱的状态;在音质优化上,中低频部分得到了显著提升。

比如这首融合了烟熏感的前卫爵士与新灵魂乐曲目:

目前 Music 2.6 已经开放体验,个人用户可以免费试用 14 天,并且每天有 500 首歌曲生成的额度。API 接口也向所有用户提供调用服务。

想要了解更多详情,请访问:https://www.minimaxi.com/audio/music

现在就来体验一下实际的操作过程。

Cover 翻唱功能:保留旋律,变换风格

在 AI 音乐领域中,翻唱一直是难以攻克的技术难题。

关键挑战在于如何保持原曲的旋律不变,同时实现编曲、演唱方式和节奏感的变化。

MiniMax 的新功能可以在保留参考歌曲旋律的同时自由变换伴奏风格、歌词内容或整体音乐氛围。

我们首先测试了通过更换歌词来改编歌曲这一需求。这种做法在创意领域非常常见,例如制作鬼畜视频、定制品牌宣传曲或者节日特供版本等,核心要求是保持原有旋律不变但修改歌词。

选取了一首广为人知的网络神曲《哈基米》,然后将歌词改为描述职场打工人日常生活的内容。

新的歌词与原旋律在音节分布和字数上匹配得非常紧密,不需要额外调整以确保每个词都能完美配合歌曲。对于没有音乐知识但有改词需求的人来说,这一步大大节省了时间和成本。

接着我们又上传了一首江苏民歌《茉莉花》,要求将它改编为摇滚风格。

在 AI 的处理下,编曲融入强烈的电吉他失真节奏与贝斯驱动,并辅以激昂的鼓点设计。前奏以现代摇滚元素开场,副歌部分人声高亢有力,整个作品充满舞台氛围感。

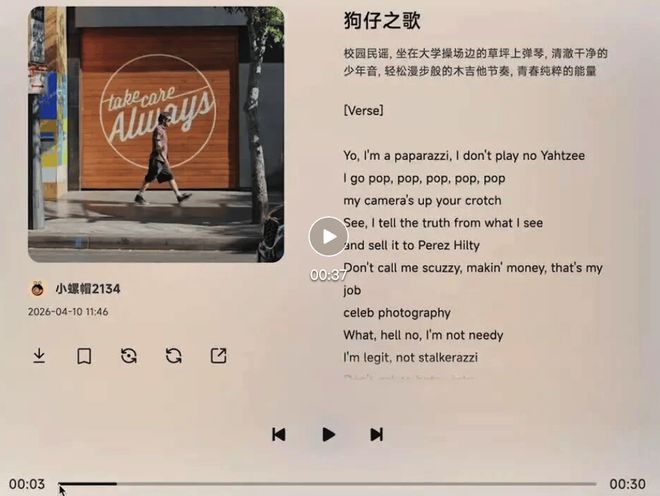

一次节目中,安妮・海瑟薇即兴说唱对答记者提问。我们尝试让 MiniMax 将这首节奏密集的说唱歌词改编为校园民谣风格。

AI 生产出的人声音色自然流畅,吉他伴奏编排恰当,人声与乐器配合得天衣无缝,将原本充满攻击性的说唱词配上温柔的民谣曲调,产生了一种有趣的幽默感。

Music Skills:普通人也可以轻松制作音乐

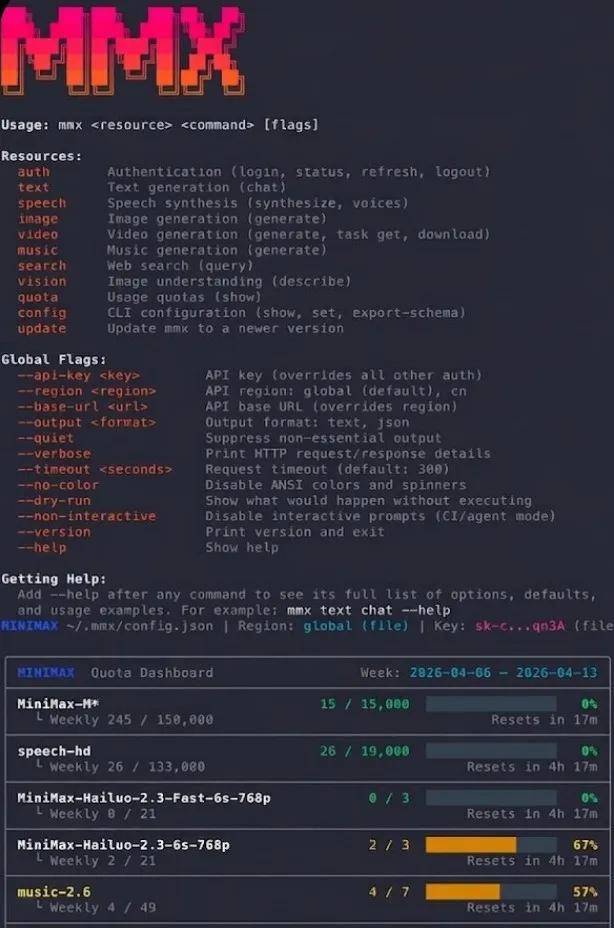

此次更新中,MiniMax 推出了三个新的音乐技能插件,并托管在 GitHub 仓库里,可以通过 mmx-cli 轻松调用。

音乐生成正在快速走向智能化时代,AI 不仅能更好地理解我们的需求,还能处理多步操作任务,极大地突破了传统交互和工作流程的局限性。

其中 minimax-music-gen 作为核心生成引擎,封装了人声、纯音乐和翻唱三种模式。通过简单的提示或 API 调用即可实现精准控制创作。

GitHub 链接:https://github.com/MiniMax-AI/skills/tree/main/skills/minimax-music-gen

如果觉得单曲不过瘾,还可以试试 minimax-music-playlist。这是个性化的歌单生成器,能够扫描本地音乐应用如 Apple Music、QQ 音乐等构建用户品味画像,并据此生成 3 到 7 首定制歌曲。

比如说一句“帮我生成一个深夜放松的歌单”或“给我做一个 3 首歌的通勤歌单”,Agent 就会自动扫描本地音源,规划并播放歌单。

GitHub 链接:https://github.com/MiniMax-AI/skills/tree/main/skills/minimax-music-playlist

buddy-sings 专为宠物爱好者设计。它能够读取 Claude Code 宠物名字和个性,自动生成专属声音身份,并以第一人称视角创作并演唱歌曲。

GitHub 链接:https://github.com/MiniMax-AI/skills/tree/main/skills/buddy-sings

只要在环境变量中配置好 API Key 并使用简单的命令行切换语言,就能打造一个本地 AI 音乐工作室。

Music 2.6 模型:聆听它的进步之处

相较于上一版本,Music 2.6 已经进入了“可控创作”阶段,在控制性、实时性和创作自由度方面都有了全面的提升。

简单来说就是更加丰富自然和律动感更强,同时也更容易使用。

在音乐性能上的最直观变化是乐器种类的增加和支持超过 100 种乐器,同时乐器与人声配合也更紧密和谐。

音质方面,Music 2.6 不仅声音更加清晰,中低频优化后的律动感更强,非常适合节奏感强烈的流行、电子或摇滚音乐。

比如用“节奏强的流行歌曲”几个字作为提示词就能生成一首完整的曲目。

对于非专业创作者来说,Music 2.6 最友好的一点是沟通成本大大降低。即使没有歌词输入,只需给出风格提示词,最快在 20 秒内即可生成一首包含完整歌词的歌曲。

示例:使用“爵士小酒馆,钢琴三重奏,有点慵懒”这样的提示语就可以创造出独特的音乐作品。

我们还尝试了将《水调歌头》直接作为歌词,并用不同的风格进行演绎,短时间内便得到了多种风格的 demo。

提示词:“古风,古典、琵琶、古琴。”

提示词:“民谣、原声吉他、忧郁。”

总而言之,Music 2.6 在情绪掌控和节奏锁定上已经实现了以用户意图为导向,不再像之前那样“开盲盒”式地随机输出。

现在只要给出明确的情感基调与节奏指令,它就能创作出符合需求且具有感染力的作品。

AI 创作的音乐与真人演唱有何区别?

结语

技术差距正在缩小是不争的事实。Music 2.6 在延迟、控制精度和音乐性能上的进步都是可以感知到的,并非微不足道的小改动。

Cover 功能的引入,更是将 AI 音乐推向了“二次创作”的高度,这个领域历来都是人类创作者最活跃的地方之一。

创作门槛越来越低。即使是有旋律想法但不懂编曲、想制作播客却请不起音乐人或者想要为宠物写一首搞笑歌……这些曾经只能停留在脑海中的念头现在都可以实现。

技术始终是工具,当工具足够好用时,它真正解放的是那些一直有创意但缺少机会的人们。

文中提及的视频和音频链接:https://mp.weixin.qq.com/s/Nbwc0N8Y9BWwNd1Eg5JXLA

以上就是本期内容,欢迎访问官网了解更多详情。