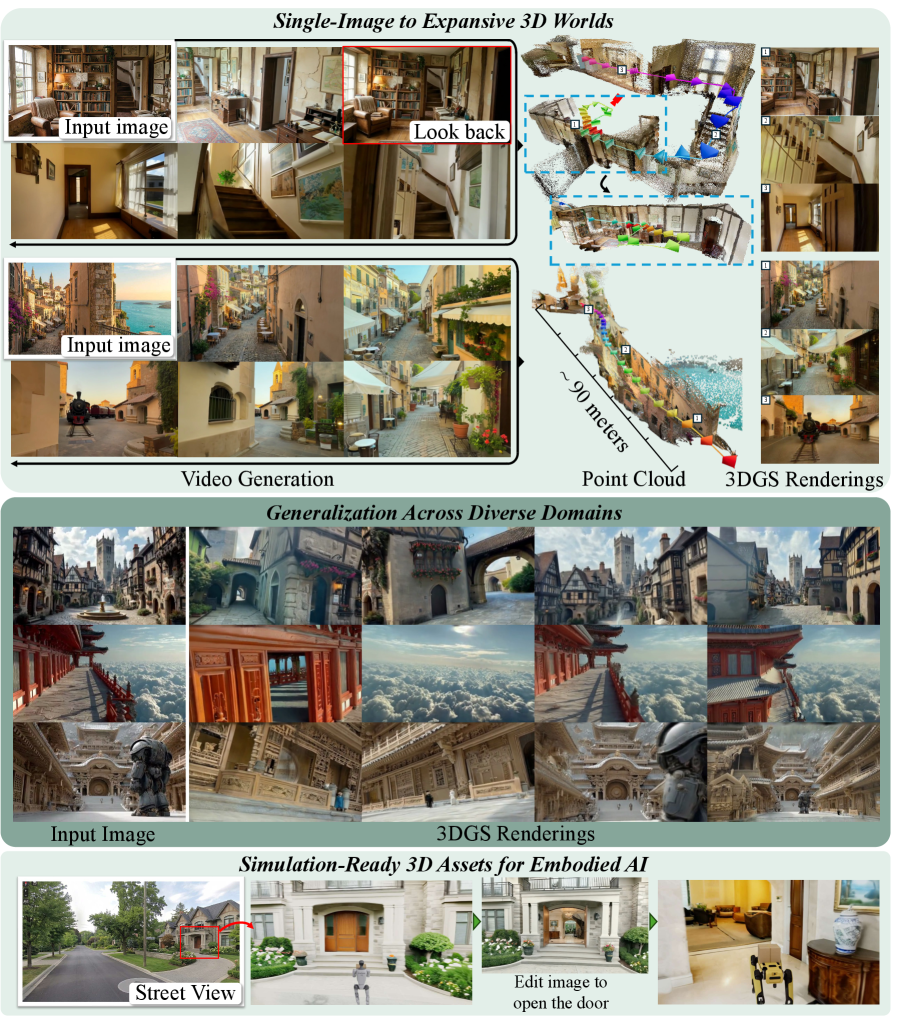

昨日(4月16日),科技媒体The Decoder发布文章称,英伟达的研究人员开发了一种名为Lyra 2.0的系统,能够从一张照片生成长达90米范围内的连贯3D环境,解决现有技术在长距离漫游中遇到的画面失真和记忆空白问题。

目前AI生成3D场景的主要难题之一是,当虚拟摄像机移动到较远的距离时,画面会出现色彩与结构的扭曲。此外,在重新返回已探索过的区域时,模型通常会再次构建环境。

英伟达的研究团队为提升机器人仿真训练的质量,推出Lyra 2.0系统以应对现有视频模型离开视野即遗忘和误差累积导致画面严重失真的挑战。这个新系统只需单张照片即可创建出适合实时漫游的3D场景。

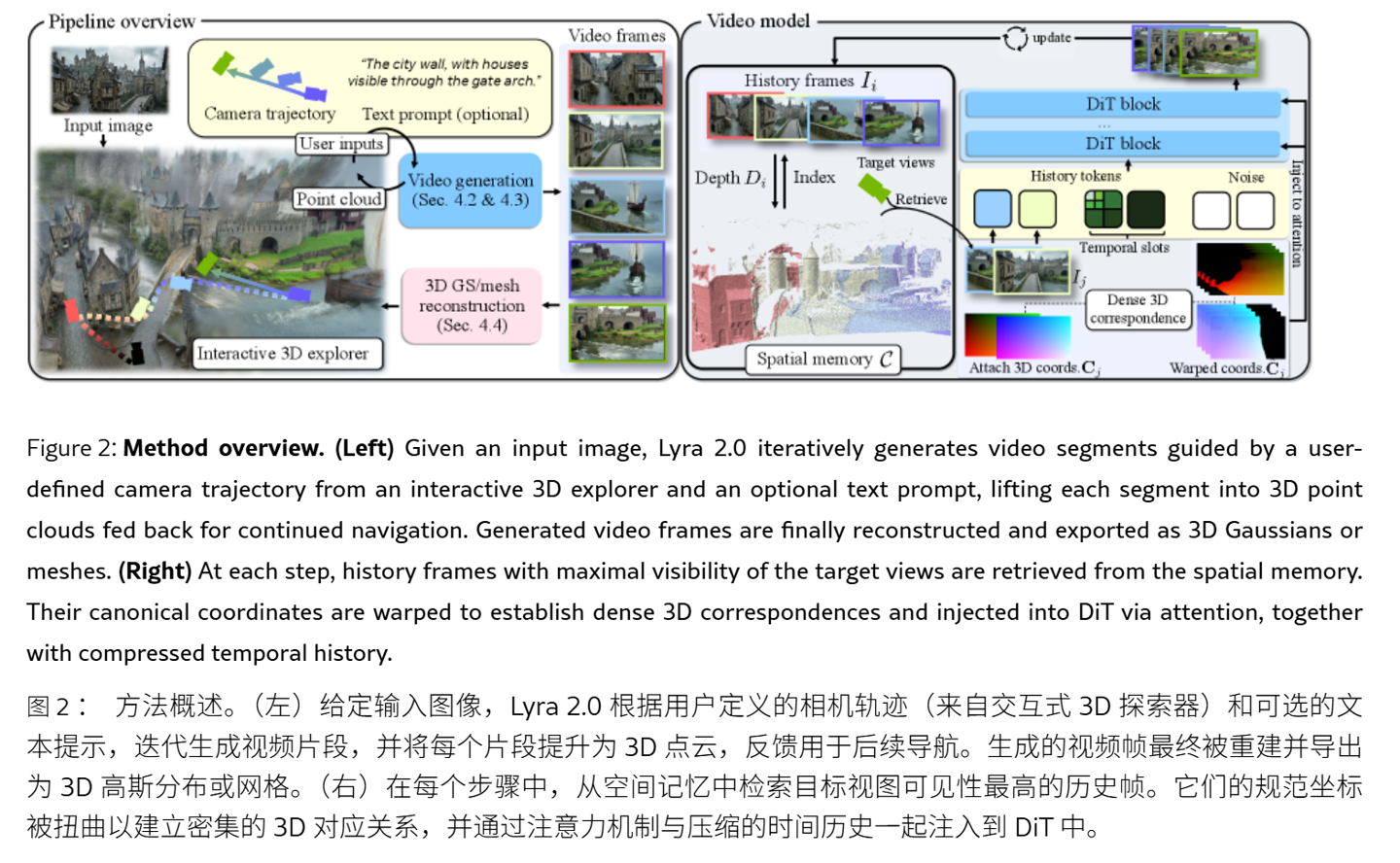

Lyra 2.0通过存储每一帧的三维几何信息来解决记忆问题,当摄像机返回到以前访问过的地方时,它会调取历史空间数据以避免重复构建环境。对于累积误差的问题,研究人员在训练中让模型面对自身产生的缺陷输出,从而学会识别并纠正质量下降的情况。

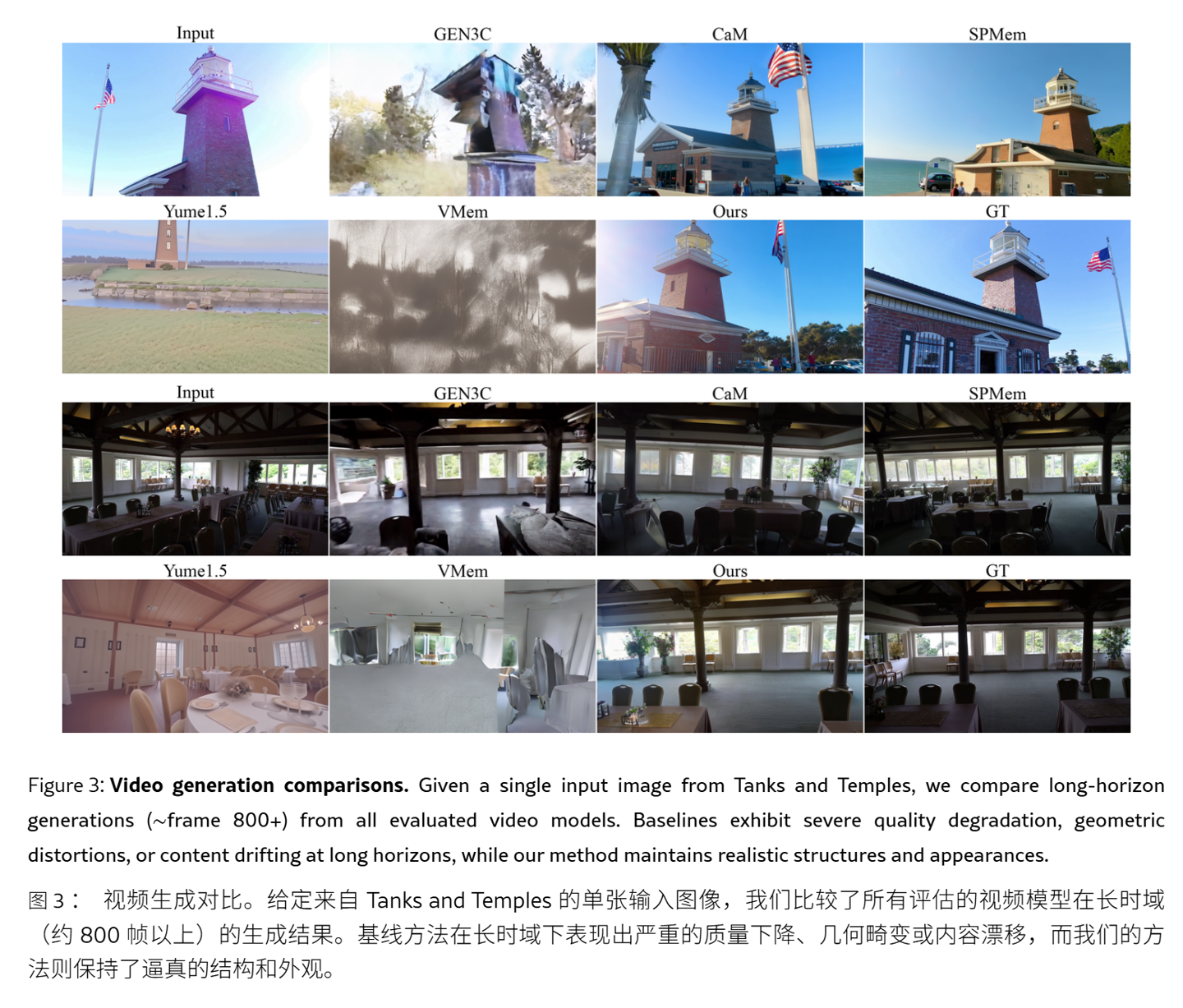

基准测试表明,Lyra 2.0在图像质量和风格一致性等多项指标上都超过了GEN3C、Yume-1.5和CaM等六个竞争对手。特别是其Fast版本,在保持同等质量的前提下,视频生成速度提高了大约十三倍。

这个系统创建的三维场景支持交互式探索,并且可以导出为网格格式用于Nvidia Isaac Sim和其他物理引擎中使用。这表示训练机器人不再需要从真实世界收集3D数据,而是在完全虚拟构建的环境中进行训练。