新智元报道

谷歌在深夜推出Gemini 3.1 Flash-Lite,这款新模型以其卓越的速度和性价比受到广泛关注。

在Gemini 3.1 Pro取得显著成绩之后,谷歌又带来了一个全新的突破性产品。

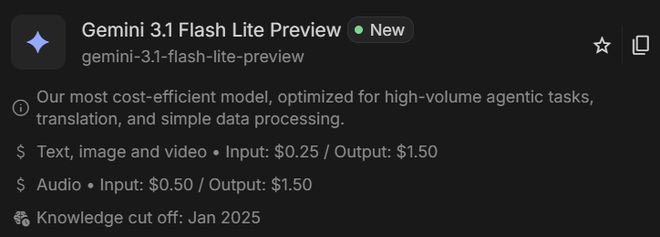

Gemini 3.1 Flash-Lite现已正式上线。

其输出速度达到每秒363个token,并且价格仅为0.25美元/百万Token,跑分方面则远远超过了GPT-5 mini和Claude 4.5 Haiku。

在处理同一任务时,相较于Gemini 2.5 Flash的33分钟,3.1 Flash-Lite仅用4分钟便完成,并且消耗最少token数同时保证了最高的正确率。

实际上,在某些情况下,它几乎可以实现即时输出。

用户只需要上传任何类型的文件——包括PDF、文本、图片、视频或音频,都可以快速转换为Markdown格式。

同时,3.1 Flash-Lite的「粒子锻造器」功能能够迅速模拟出各种动态效果,令人印象深刻。

目前开发者可以通过Google AI Studio的Gemini API来体验这款模型的预览版本,企业用户则可通过Vertex AI接入服务。

以更少的成本获得更快的速度和更高的性能

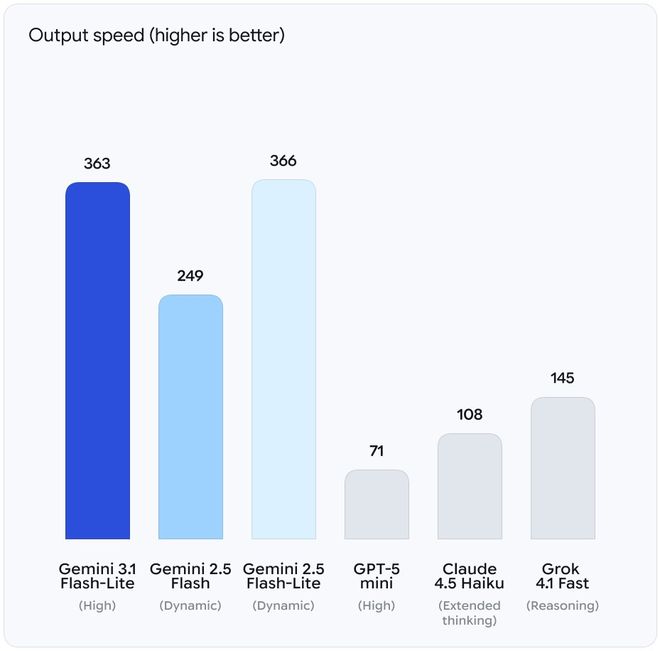

先看最直观的数字。

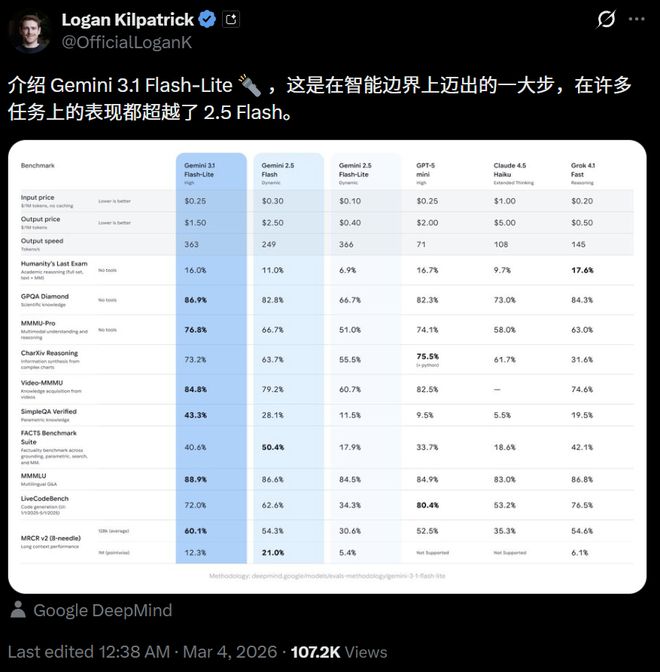

Gemini 3.1 Flash-Lite的输出速度为每秒363个token,与2.5 Flash-Lite(366 tokens/s)接近一致,但远远超过了上一代Gemini 2.5 Flash(249 tokens/s)。

对于那些高端模型而言,

GPT-5 mini的速度仅为71 tokens/s,Claude 4.5 Haiku为108 tokens/s,而Grok 4.1 Fast稍好一些,达到145 tokens/s。

具体来说,Flash-Lite的速度是GPT-5 mini的五倍,是Claude 4.5 Haiku的三倍多,价格却只有后者四分之一。

再看具体定价。

在定价方面,3.1 Flash-Lite输入0.25美元/百万Token、输出1.50美元/百万Token。

相比之下,它比Gemini 3.1 Pro便宜八倍

GPT-5 mini的输出价格为2.00美元,Gemini 2.5 Flash则为2.50美元,而Claude 4.5 Haiku更是高达5.00美元。

总结来说:比你快、更便宜且性能更高

在科学知识和推理能力的测试中,3.1 Flash-Lite取得了显著的成绩。

GPQA Diamond测试中的分数为86.9%,远远超过了GPT-5 mini(82.3%)和Claude 4.5 Haiku(73.0%),甚至超过体积更大、价格更高的Gemini 2.5 Flash(82.8%)。

在多模态理解方面,MMMU-Pro测试中,Flash-Lite以76.8%的成绩领先于GPT-5 mini(74.1%)、Gemini 2.5 Flash(66.7%)、Grok 4.1 Fast(63.0%)和Claude 4.5 Haiku(58.0%)。

在事实准确性测试SimpleQA Verified中,差距更为明显。

Flash-Lite的准确率达到了43.3%,而Gemini 2.5 Flash为28.1%,GPT-5 mini仅有9.5%,Claude 4.5 Haiku则更低至5.5%。

在多语言能力方面,MMMLU测试中Flash-Lite以88.9%的成绩领先,超过了Gemini 2.5 Flash的86.6%和GPT-5 mini的84.9%,在同价位段没有对手。

视频理解领域同样出色,在Video-MMMU测试中得分84.8%,远远超过GPT-5 mini(82.5%)和Gemini 2.5 Flash(79.2%)。

然而,3.1 Flash-Lite并非无懈可击。

在LiveCodeBench代码生成测试中,其得分仅为72%,虽然不低,但GPT-5 mini以80.4%明显更强,Grok 4.1 Fast也有76.5%的成绩。

在Humanity's Last Exam的评估中,Flash-Lite得分为16.0%,与GPT-5 mini(16.7%)基本持平,但落后于Grok 4.1 Fast的17.6%。

需要注意的是,在这些竞争者中的价格只有几分之一。

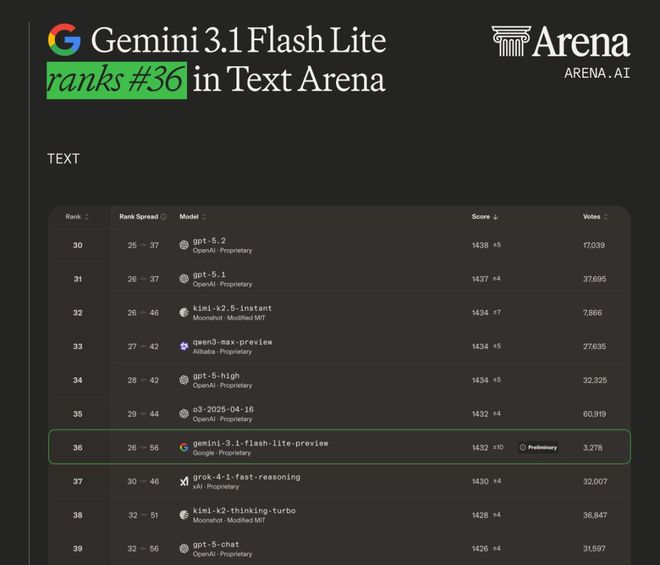

在Chatbot Arena的文本竞技场中,3.1 Flash-Lite以1432分排名第36位。

其对手包括o3(1432分)和GPT-5 High(1434分),以及紧随其后的Grok 4.1 Fast Reasoning(1430分)。

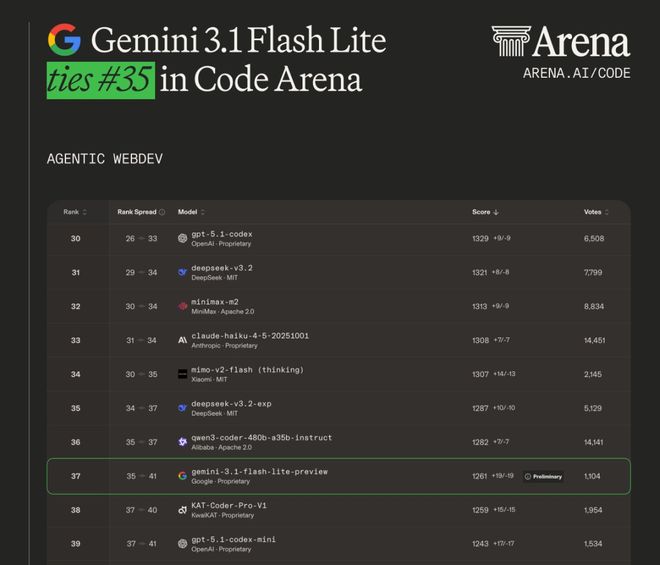

而在代码竞技场中,3.1 Flash-Lite得分1261,在这里它的对手包括Claude Haiku 4.5(第31名,1308分)和DeepSeek V3.2(第34名,1321分),差距不算大但仍有提升空间。

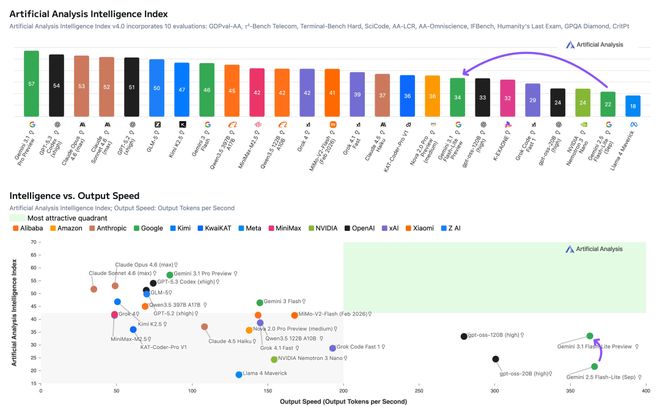

在Artificial Analysis评测中,3.1 Flash-Lite在输出速度及成本效益方面领先于市场上的其他产品。

除了出色的性能,3.1 Flash-Lite还配备了thinking levels功能,允许开发者根据任务需求调整模型的推理资源投入。

高频低复杂度的任务如批量翻译、内容审核和数据分类可以在浅思考模式下运行,以达到最佳的速度和成本效益。

而对于更复杂的任务,切换到深度推理模式后其性能不输大模型。

实际测试证明了这款轻量级模型的重量级表现

在实际应用中,3.1 Flash-Lite展示了远超预期的能力。

例如,在电商场景下,它能够迅速填充原型图。

「思考深度」可调

用户只需输入一句指令,Flash-Lite就能在几秒内用几十个品类、数百款商品填满整个电商界面原型,并且包括名称、价格和分类信息等。

- 在过去需要设计师手动完成半天的工作,现在通过一个Prompt即可完成。

- Flash-Lite能够结合最新的天气预报接口及历史数据生成实时动态的天气数据可视化界面。

SaaS AI智能体:多步任务自动化

Flash-Lite还能构建处理复杂多步骤任务的SaaS智能体,帮助企业实现客户工单处理、订单跟踪等流程的自动化。

在低延迟和低成本的支持下,这类高频调用场景是Flash-Lite的主要应用领域之一。

海量内容处理:快速分析归类

对于大量的非结构化数据如图片、文档及用户评论等,3.1 Flash-Lite能够迅速完成分析、标签化和整理工作。

通过发布这款新产品,谷歌引领了AI竞争进入一个全新的阶段。

过去各大模型主要集中在性能上的竞赛——ARC-AGI刷分、HLE比推理及代码竞赛争排名。

而Flash-Lite的出现则将竞争维度转向性价比赛道。

在这条新赛道上,谁能在成本最低的情况下交付最高质量的产品,谁就是真正的赢家。

以几分之一的价格实现旗舰级效果、五倍的速度碾压竞争对手以及在准确性方面遥遥领先,谷歌通过Flash-Lite宣告自己已走在了性价比竞赛的前列。

对于全球数百万开发者而言,这可能是目前最值得关注的产品之一。

因为,在实际产品应用场景中,成本和速度有时比跑分更为重要。

面对大批量的图片、文档、用户评论等非结构化内容,Flash-Lite还能够快速完成分析、标签化和归类整理。

性价比赛道,彻底变天

3.1 Flash-Lite的发布,标志着AI竞争进入了一个全新的阶段。

过去,各家大模型都在卷「谁最强」——ARC-AGI刷分、HLE拼推理、代码竞赛争排名。

但Flash-Lite的出现,把战场拉到了另一个维度。

光卷性能已经不够了。谁能用最低的成本交付最高的质量,谁才是真正的赢家。

用几分之一的价格打出旗舰级效果、用5倍的速度碾压竞品、在事实准确性上断崖领先,谷歌用Flash-Lite告诉所有人:在性价比这条赛道上,它已经跑在了前面。

而对于全球数百万开发者来说,这可能是目前最值得关注的模型之一。

毕竟,在真实的产品场景中,成本和速度有时比跑分更重要。

参考资料:

https://blog.google/innovation-and-ai/models-and-research/gemini-models/gemini-3-1-flash-lite/

https://storage.googleapis.com/deepmind-media/gemini/gemini_3-1_flash-lite_model_evaluation.pdf