英伟达携其“最强开源龙虾模型”正式进入养殖业。

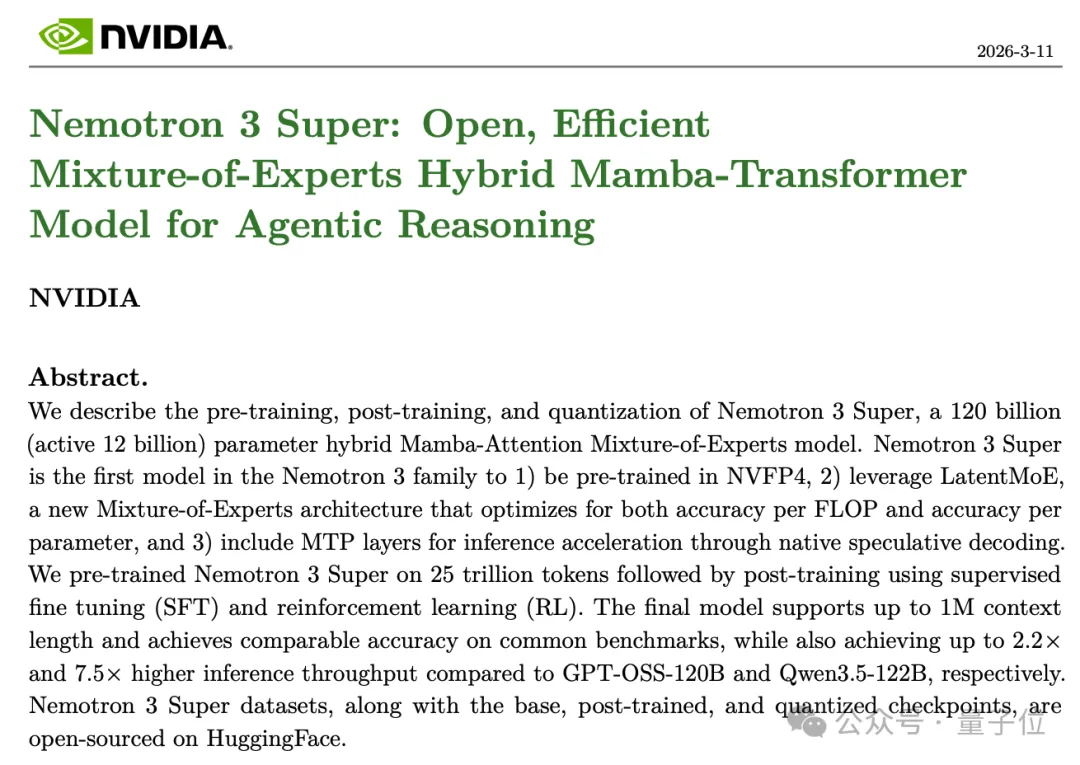

近日,英伟达发布了拥有120B参数的MoE模型Nemotron 3 Super,并宣布将其代码完全开放给公众使用。

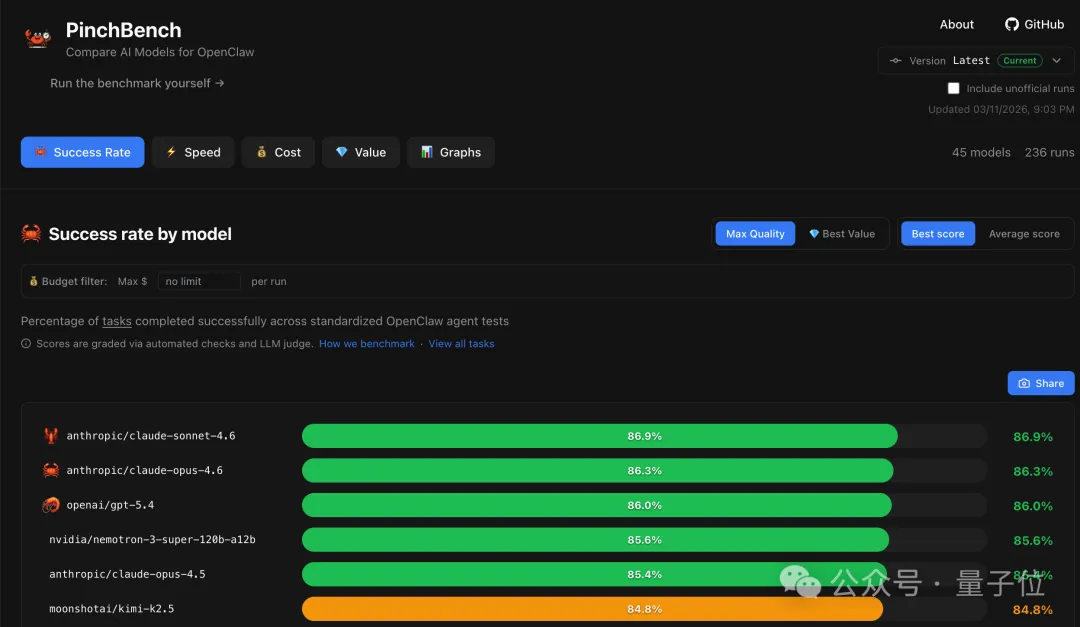

在OpenClaw智能体控制能力测试PinchBench中,该模型表现优异,取得了85.6%的成绩,一举登上同类开源模型榜首的位置。

此外,在Artificial Intelligence Index的评估中,Nemotron 3 Super获得了37分,领先于得分仅为33分的GPT-OSS。

英伟达不仅推出了这款“龙虾搭档”,还进一步加大了对开源模型的支持力度。

最新披露的财务文件显示,英伟达已秘密储备260亿美元(约1789亿人民币),计划在未来五年内全部用于开发开源AI模型。

超大上下文和高速处理能力

作为专注于多智能体协同工作的Nemotron 3 Super,支持高达一百万个token的上下文窗口,为应对复杂流程提供了必要的长期记忆功能。

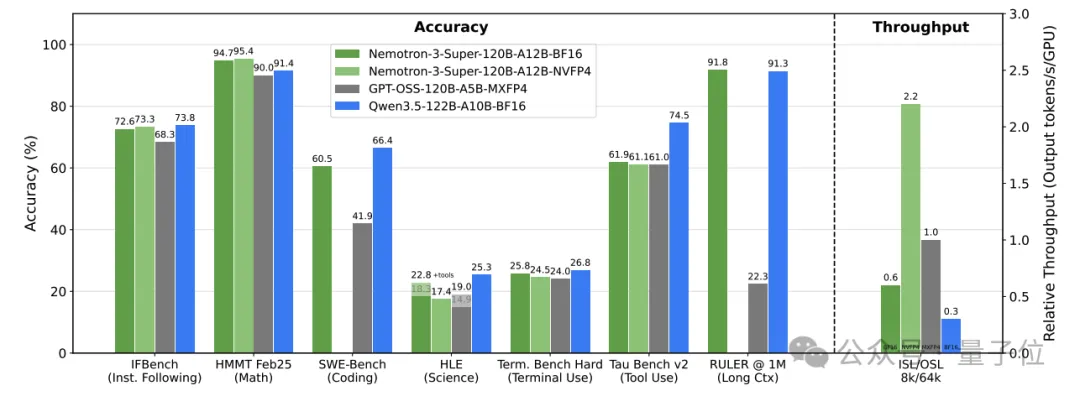

此外,在数据吞吐量方面也有了显著提升,比上一代Nemotron Super快了五倍以上。

在处理结构化生成任务如代码和工具调用时,该模型的推理速度最高可达三倍提速。

当输入设置为8k而输出为64k时,其推理吞吐量是GPT-OSS-120B的两倍多。

具体而言,在软件工程基准SWE-Bench测试中,Nemotron 3 Super配合OpenHands框架获得了60.47%的成绩,而对照组模型为41.9%。

在终端操作环境中的挑战下,它依然表现出色,在Terminal Bench的难度子集部分取得了25.78%,略高于GPT-OSS的24%。

其常识推理能力也在MMLU-Pro测试中得到了验证,以83.73分超过了GPT-OSS的81分。

在复杂的业务场景模拟评估中,Nemotron 3 Super也展现了优秀的落地能力,在TauBench V2测试中的综合成绩为61.15%。

针对Blackwell架构优化

这一模型优异的表现主要归因于其在架构上的针对性改进。

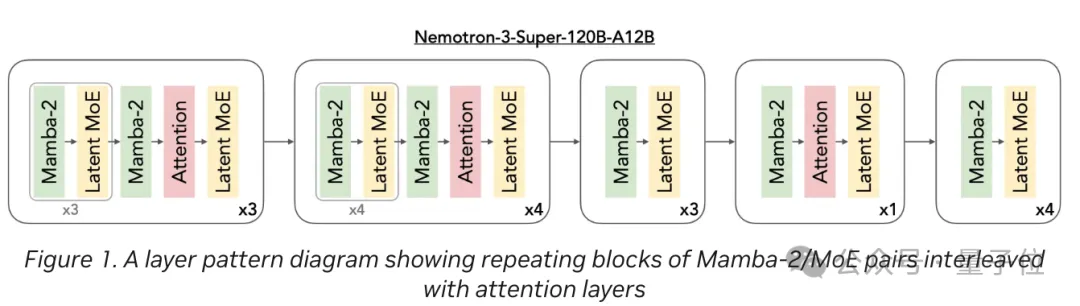

在处理大规模上下文数据时,Nemotron 3 Super采用了混合Mamba-Transformer架构以兼顾效率和精度。

其中包括了用于长序列任务的线性时间复杂度的Mamba-2层以及关键深度处插入的全局注意力层,确保模型在海量信息处理中的精准关联检索能力。

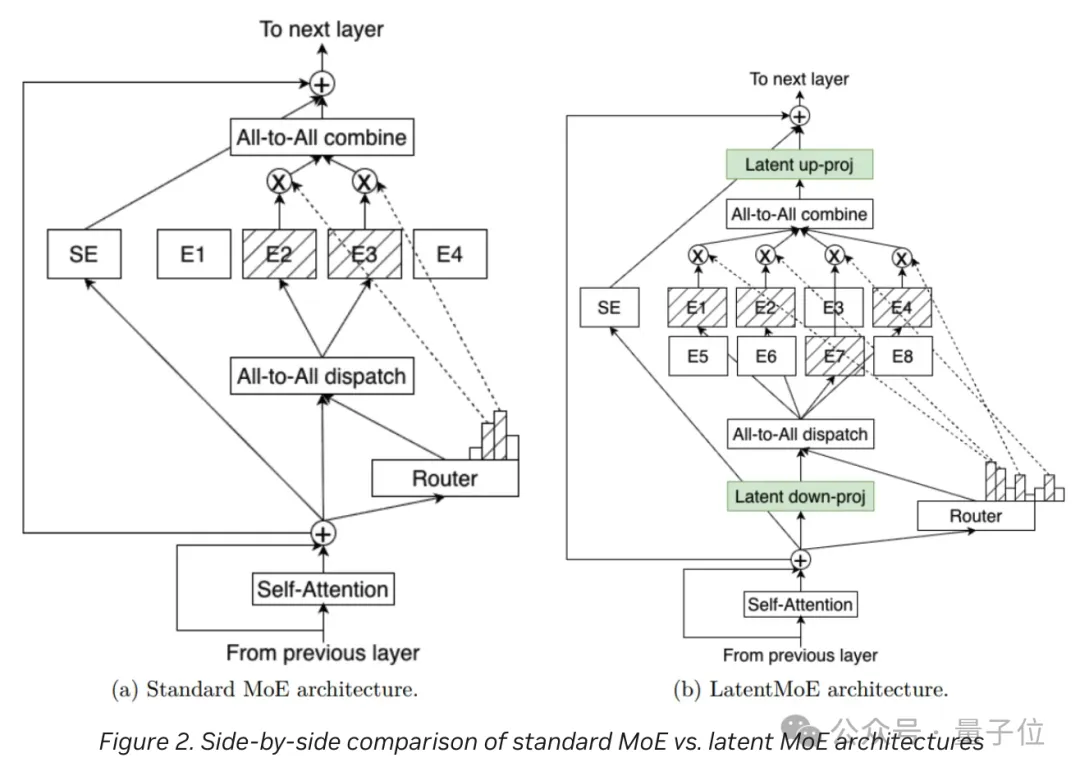

为解决传统混合专家架构在通信与计算上的瓶颈,模型引入了Latent MoE架构。

在路由决策前,通过将token投影至一个压缩的低秩潜空间进行降维处理,使得模型能够以相同推理成本直接调用四倍数量的专业网络模块,实现更精细分工。

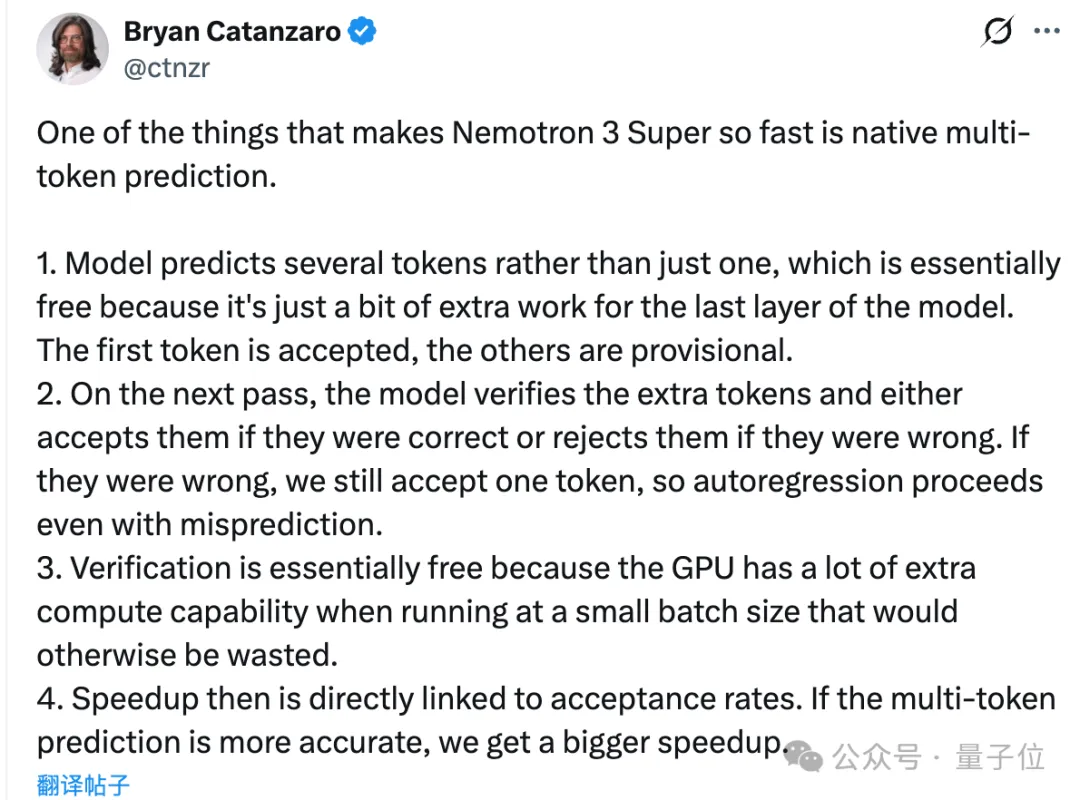

同时,为了进一步提高生成速度,该模型还应用了多token预测技术。

与传统逐个预测不同,Nemotron 3 Super采用共享权重设计,在单次前向传递中即可并行预测多个未来的token,这不仅增强了其对长距离逻辑结构的理解能力,也提升了内置的投机解码能力,显著缩短了生成复杂任务所需的耗时。

英伟达深度学习研究副总裁Bryan Catanzaro解释道,这是模型响应速度快的原因之一。

另外,在硬件层面进行了深度适配,采用了低精度预训练方式,并以原生NVFP4格式进行预先培训。

通过直接在Blackwell架构上进行25万亿个token的训练,避免了常规路径中的先训练再量化的步骤,使模型从一开始就适应了该架构的独特算力特性。

在B200芯片上的测试中,Nemotron 3 Super的推理速度比H100快四倍,在降低内存需求的同时保持了稳定的精度表现。

智能体能力专项训练

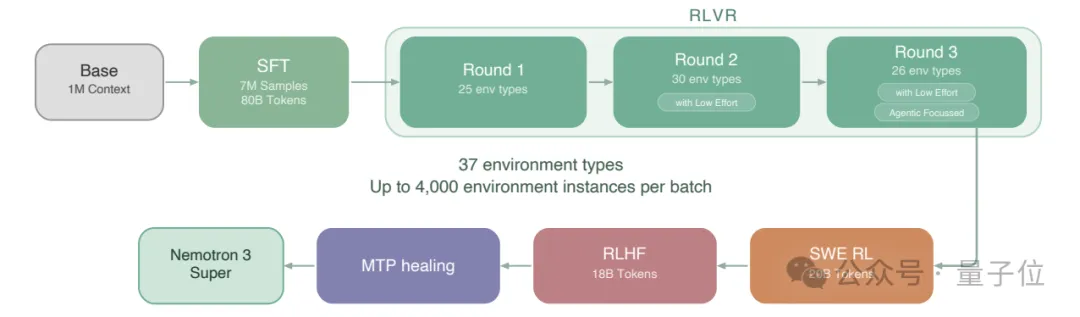

英伟达通过多层级策略对Nemotron 3 Super进行了全面优化,使其具备执行任务的能力。

在SFT阶段,团队采用两步工艺进行微调:首先以标记级平均损失为基础建立推理基础,随后切换至样本级别均值评估以解决长输入场景下的性能问题,确保模型在海量信息处理中仍能提供精准的短输出。

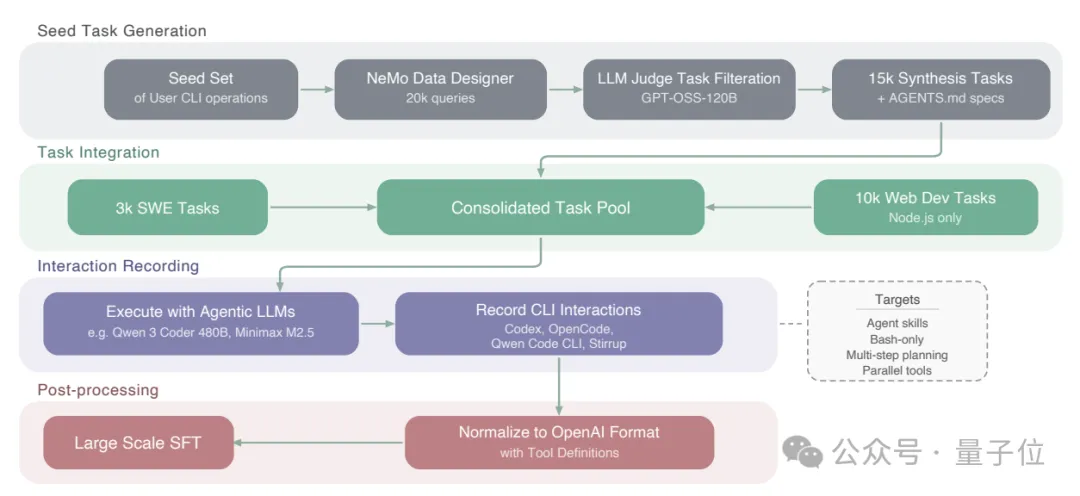

针对智能体命令行交互的实际应用,英伟达创建了一个包含2万个初始查询的任务集,并利用模型过滤生成了核心合成任务。

通过从高性能模型中蒸馏操作轨迹,Nemotron 3 Super成功将复杂的终端交互知识转化为其原生技能的一部分。

在NeMo Gym平台的21种真实环境配置中进行高强度训练后,该模型在工具调用准确性、功能代码可执行性及复杂计划完整性等方面均表现出色。

针对软件工程任务,模型还经历了专门的SWE-RL阶段,在隔离环境中通过反复实践修正逻辑漏洞。

为避免在未知领域的偏差,英伟达引入了PivotRL技术来强化关键决策点以提高行为稳定性。

英伟达五年260亿美元投资开源模型

随着Nemotron 3 Super的发布,英伟达也宣布了一个更加宏伟的目标:在未来五年内投入260亿美元用于开发和优化开源AI模型,并通过自家超级计算机数据中心进行压力测试。

这笔资金不仅为研发提供了充足支持,还计划通过运行这些经过优化的开源模型来全面评估计算、存储与网络性能。

随后,从实际应用中获得的数据将直接用于规划未来的硬件架构路线图,推动技术进步。

英伟达此次对资源的开放态度背后,是希望促进整个开源生态系统的健康成长,并引导全球开发者更加紧密地依赖其技术支持。

260亿美元投向开源模型

最新开源模型强势登场之际,英伟达更远大的开源计划也已曝光:在未来五年内全盘倾注260亿美元巨资用于构建开源AI模型,并借此在自家的超级计算机级数据中心里搞一场极限拉练。

这笔投入不仅是为模型研发准备的充足弹药,更是为了通过跑起这些自家优化的开源模型,对计算、存储和网络性能进行全方位的压力测试。

随后,这些从实战中压榨出的宝贵数据,将被直接拿来反哺并规划未来的硬件架构路线图,真正实现由软件实操来定义硬件进化的技术路径。

在资源输出端,英伟达这次也表现得毫无保留,对外全面开放了模型的全参数权重,以及训练、评估配方和详细的部署手册。

这种慷慨的行为背后,也有着英伟达更高维度的谋划——通过亲手推动整个开源生态的强健发育,引导全球开发者将创新的根基更加牢固地绑定在自家的技术底座之中。

GitHub:

https://github.com/NVIDIA-NeMo/Nemotron/tree/main/usage-cookbook/Nemotron-3-Super

技术报告:

https://research.nvidia.com/labs/nemotron/files/NVIDIA-Nemotron-3-Super-Technical-Report.pdf

参考链接:

[1]https://developer.nvidia.com/blog/introducing-nemotron-3-super-an-open-hybrid-mamba-transformer-moe-for-agentic-reasoning/

[2]https://www.wired.com/story/nvidia-investing-26-billion-open-source-models/