Anthropic公司的首席执行官Dario Amodei回应了美国国防部和白宫要求军工承包商停止使用其产品的决定。

在接受CBS新闻的采访时,Amodei于周六表示,Anthropic坚决反对将AI技术应用于大规模国内监控以及全自动武器系统中,这些系统的运行无需人类干预即可自主开火。

他补充说,除了上述两个领域之外,该公司对于美国政府提出的其他所有使用场景都予以支持。他说:

“这些权利关乎每个美国人的根本:享有不受政府监视的权利和由军官亲自做出军事决策的能力,而不是完全依赖机器。”

关于国防部将Anthropic列为“供应链风险”,即军工承包商不得在国防合同中使用其产品,Amodei认为这是前所未有的,并带有惩罚性质。

Amodei进一步解释说,如果未来外国军队开始使用全自动武器系统,他并不反对相关的研发工作,但目前AI技术在军事应用中的自主性和可靠性仍然不足。

他认为当前法律未能跟上快速发展的AI行业的步伐,呼吁美国国会制定“护栏”立法,以防止将AI用于大规模国内监控项目。

OpenAI在美国政府宣布Anthropic构成供应链风险后获得了一份国防合同。

周五,美国国防部长Pete Hegseth表示,Anthropic被视为国家安全方面的供应链风险。

他强调:“从即刻起,任何与美军有业务往来的承包商、供应商和合作伙伴都不应再与Anthropic进行任何形式的商业往来。”

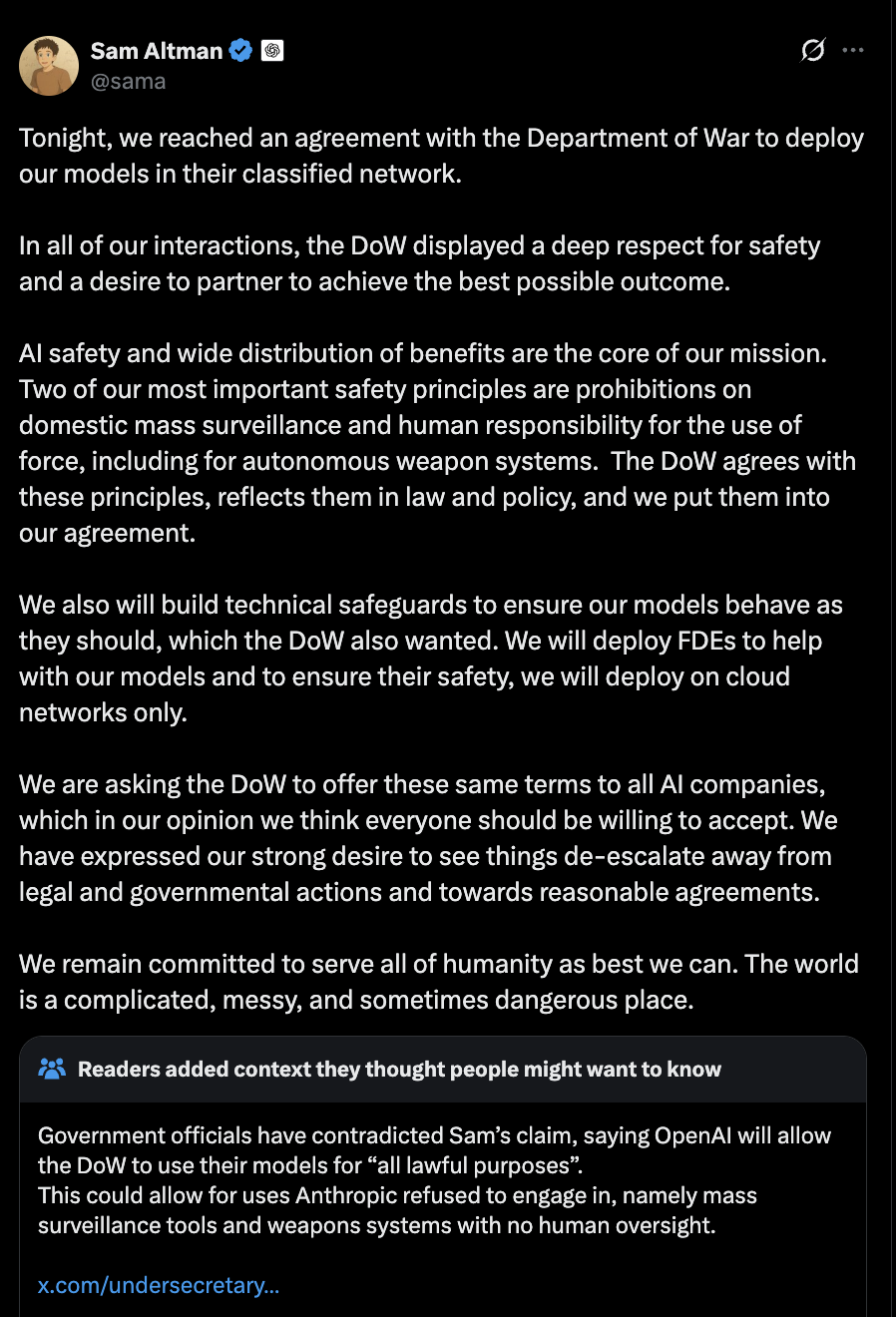

在此之后不久,竞争对手AI公司OpenAI宣布已与美国国防部签署协议,将其AI模型部署到军事网络中。

OpenAI首席执行官Sam Altman的这一合作协议在网上引发了一些批评声音。有人认为这可能导致个人隐私受到侵犯和大规模监控的风险增加。