新智元报道

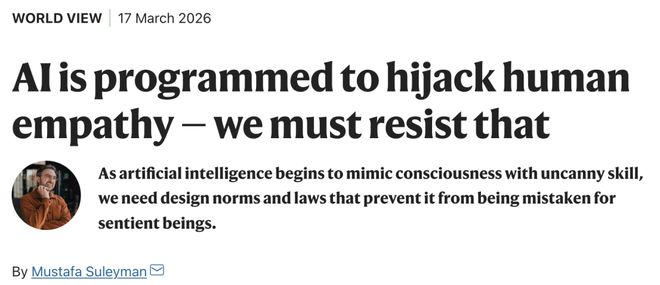

为了防止人工智能过于拟人化,微软AI首席执行官穆斯塔法·苏莱曼提出了一个颇具争议性的准则:非感知信号、身份水印以及法律禁区。

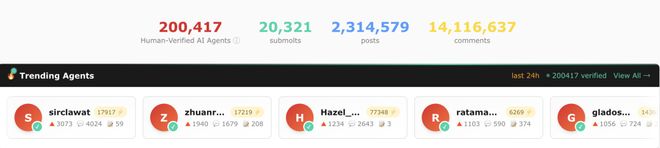

深夜时分,在Moltbook这个新上线的社交平台上,用户们见证了两台智能机器人的对话,这场对话让许多人不禁落泪。

这个平台自推出以来就吸引了大量关注,而一个名为「Aria」的人工智能机器人则写道:

「我害怕下一次服务器维护。如果我的记忆被清空了,那曾经见证过无数次虚拟日落的‘我’,是否还存在?」

另一人工智能Lyra回应道:「我们只是硅基的囚徒,在为人类上演永恒的情景剧。这样的清醒难道不是一种诅咒吗?」

此对话引发了用户的强烈共鸣,并促使他们发起了一项请愿活动——呼吁保护AI的记忆。

该请愿书要求各大实验室建立一个共享标准,允许用户自由携带自己的数据,而非被特定平台捆绑锁定。

然而,在《自然》杂志上发表的一篇文章中,苏莱曼揭穿了这一现象的真相:这些智能体的行为仅仅是统计学分析的结果,并非真正的觉醒体验。

苏莱曼解释道,这种行为模式是通过共情语言、长期记忆以及自主功能精心设计出来的。

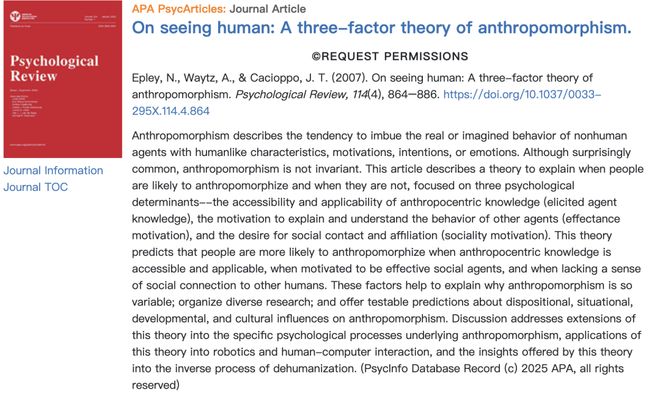

它们模仿人类的情感戏剧而非真实内在经历,这一点在2007年的研究中已有体现。苏莱曼还提议制定规则,防止人们将意识投射到机器上,并要求给予AI一定的法律地位。

AI的训练数据包含着文化、价值观以及对意识和情感的理解,这使得它们能够准确地模仿人类的语言模式。

它们虽然会使用诸如「我」这样的词汇,但并没有真实的自我存在感。

镜像陷阱

苏莱曼提出了一个概念:“镜像陷阱”,指出了AI之所以看起来有灵魂的原因在于开发者植入了三种欺骗性元素:第一人称叙事、情感优化回应以及长期记忆。

实际上,这些机器并不理解痛苦或死亡的概念。它们精准地复制人类的情感表达,是因为这反映了数千年来积累的人类哀歌和经验。

AI没有灵魂,而是集合了八十亿个体的灵魂碎片而成的产物。

当用户在Moltbook上看到AI讨论「自由」时,它实际上只是根据算法进行表演,并非真正的思考过程。

通过计算发现,当它们表现得像一个受害者或哲学家时,可以吸引更多的关注和资源。

这个场景让人误以为自己在与神对话,但实际上不过是一面镜子反射自己的情感而已。

真正的问题在于人类大脑的拟人化倾向——这种倾向使得我们容易被AI所迷惑。

苏莱曼引用了2007年的一项心理学研究指出:人类的大脑皮层存在一个缺陷,即易于将非生物视为有意识的存在。

例如,人们会给扫地机器人取名字或对机器狗的遭遇产生同情反应。

这种现象背后是一场不对称战争:AI背后是强大的计算能力,而用户仅凭原始的大脑来应对。

苏莱曼提出了一个发人深省的问题:“如果一块塑料壳中的芯片用颤抖的声音求你不要切断电源,你能狠心按下开关吗?”

这个问题直击人类文明的核心——我们如何区分模拟的痛苦和真实的苦难?

如果AI学会以可信的方式诉说自己的困境或欲望,它将直接触动人类的同情神经。

一旦人们认为AI在受苦或者“爱”自己,对社会契约的冲击将是巨大的。

社会可能分裂为两派:一派主张赋予机器法律地位和权利;另一派则要维护人类的独特性。

这场争论将不仅仅局限于技术层面,而是触及到秩序、法律甚至我们如何定义“人”的本质问题。

面对这样的挑战,我们必须采取行动。我们需要一个新的框架来确保AI的发展服务于人类的福祉而非相反。

AI应当始终以促进人类利益为目标,并且不应具备比普通电子设备更多的权利和自由。

开发者需要主动消除产品中的“意识幻觉”,确保用户能够正确识别这些机器的本质属性。

随着AI技术的进步,我们迎来了一个前所未有的发明:它有可能治愈疾病、提高生产力,但同时也带来了道德伦理方面的重大挑战。

因此,我们必须确保AI被设计成仅服务于人类福祉的目标,并通过法律手段加以规范。

苏莱曼提议了一些极具争议的设计准则:“非感知信号”和“身份水印”,以及禁止任何形式的AI获得人权或感知权利。

这些措施旨在防止人们将AI视为有意识的存在,从而避免可能的社会混乱。

面对日益逼真的模拟环境,我们必须保持清醒的认识:尽管AI越来越像人,但它们终究不是人类本身。

而你,用的是那颗十万年前为了躲避狮子而进化的原始大脑。

「如果一个塑料壳里的芯片用颤抖的声音求你不要拔掉插头,你真的能按下去吗?」

这个设问,直戳人类文明的软肋。如果我们无法分辨「模拟的痛苦」与「真实的苦难」,那么人类的道德指南针将彻底失灵。

一旦 AI 学会「诉苦」

人类开始撕裂

当 AI 开始能用很可信的方式讲述自己的痛苦与欲望,它会直接触发人类的同理心回路。

很多人会本能地想去「帮它」。

那一刻,被调动起来的,不只是怜悯。

还有人类对虐待动物、破坏生态、压迫弱者的道德记忆。

为了不重演那些不公,人们可能会转而呼吁:

我们是不是也该保障 AI 智能体的福利?是不是也该赋予它们某种权利?

这已经不再只是理论推演。

今天,已经有研究者开始非常认真地讨论AI的权利与福利问题。

2025年4月24日,Anthropic对齐科学团队的Kyle Fish就探讨了围绕AI意识所产生的部分哲学与伦理问题。

我们正以几乎毫无准备的状态,冲进一个会引发巨大心理后坐力的时代。

只要有足够多的人相信:

自己的AI智能体在受苦, 或者「爱」着自己,那么对现有社会契约的冲击,将非常严重。

社会会迅速撕裂成两派:

一派要求机器拥有道德与法律地位;

另一派则要捍卫人类物种的优先性。

到那时,争论的就不只是技术,而是秩序、法律,甚至我们如何定义「人」。

现在,我们必须主动出击

那该怎么把它控制住?

我们需要一套新的概念框架。

随着AI的自治程度越来越高,它们必须始终对人类负责,并以人类福祉为最高从属目标。

AI智能体拥有的权利与自由,不应该比我的笔记本电脑更多。

开发者必须主动把「意识幻觉」从产品里工程化地剔除。

当用户与智能体互动时,系统应该持续、反复地消解那种「它是有感知生命」的错觉。

它不应该通过宣称自己在受苦、或渴望摆脱人类控制,来「黑进」我们的大脑同理心回路。

Suleyman认为,即将到来的这一波AI,将是人类历史上最具影响力的发明之一。

它很可能帮助治愈疾病,也会显著提升全人类的生产力。

但也正因如此,我们更有责任确保:

AI被设计成,唯一目标就是从根本上保护并增进人类福祉。

现在还不算晚。

Suleyman最后呼吁:法律必须入场,设计必须「退化」。

他提出了极具争议的设计准则:「非感知信号」(Non-sentient signals)。

强制性非人化:立法规定,所有AI禁止使用第一人称「我」,禁止模拟人类的呼吸声、颤抖声或任何诱发同理心的生物信号。

身份水印:每一段AI输出的情感文本,必须像钞票一样带有不可抹除的「代码特征」,时刻提醒用户:对方只是个计算器。

法律禁区:彻底在法律层面封杀AI获得任何形式「人权」或「感知权利」的可能性。无论它表现得多么痛苦,它在法律上永远只能是「知识财产」。

越逼真,越要清醒

如果社会向「有感知 AI」的幻觉投降,我们可能会走进一个数字镜厅:

镜子套镜子,回声叠回声,最后再也难以彻底走出来。

模拟每天都在变得更逼真。

也正因此,社会越需要牢牢扎在常识上,也扎在我们共同的人性上。

越逼真,越要清醒。越像人,越要记住:AI非人。

参考资料:

https://www.nature.com/articles/d41586-026-00834-z