一款能够自我进化的超级智能体诞生了!它是由一位华人实习生自主研发的。

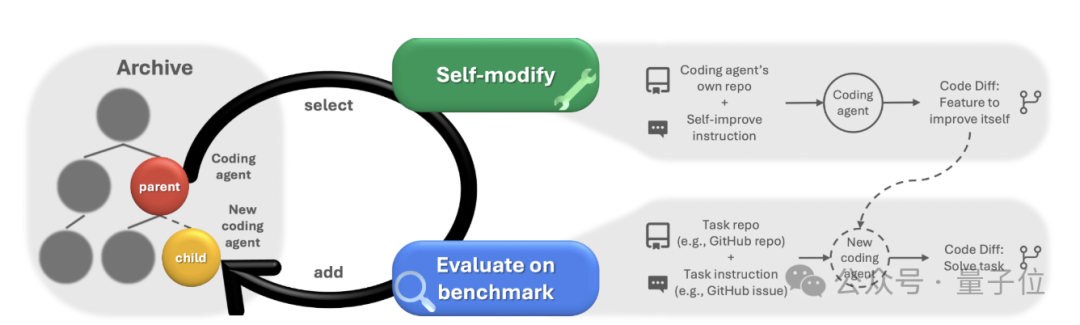

这款创新性的Agent通过改进方法实现了自身的迭代升级。

最近,Meta的研究团队发布了一篇名为HYPERAGENTS(超级智能体)的新论文,在学术界引起了广泛关注。

新一代超级智能体Hyperagents就此诞生了!

根据论文中的描述,未来的人工智能有望通过不断的自我迭代,突破人类预设的初始算法边界。因此,AI的安全性问题必须得到高度重视。

元学习最大的吸引力在于它的改进可以跨领域迁移,这不仅仅是某一特定任务上的提升,而是全面的能力增强。

目前,这篇论文已经被ICLR 2026接收。

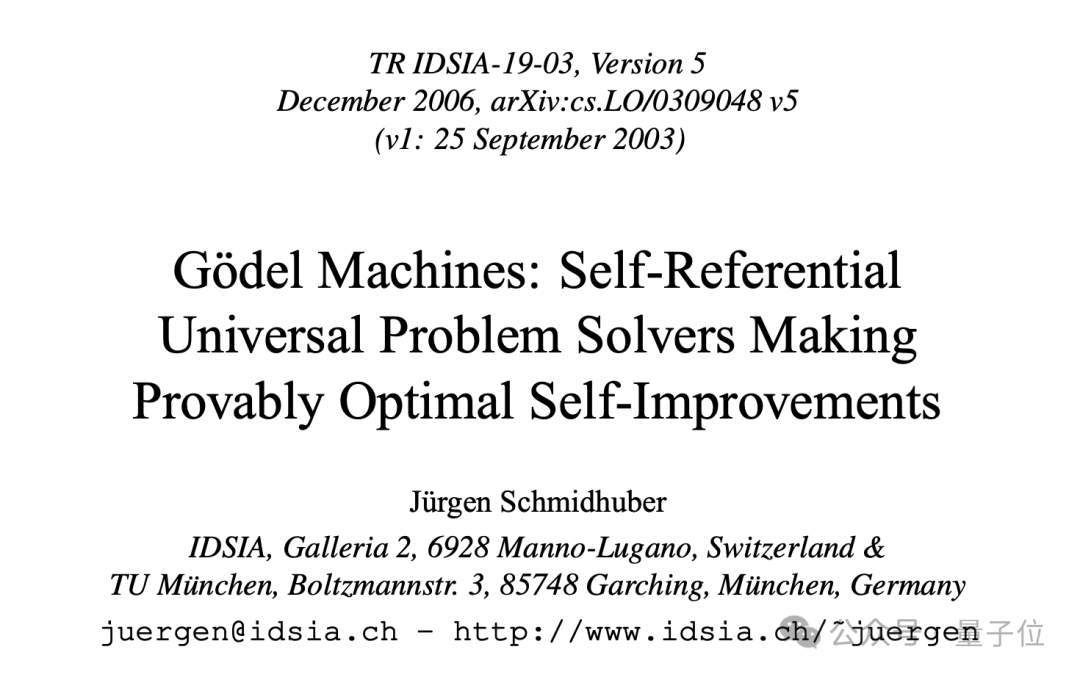

要理解超级智能体Hyperagents的本质,我们首先需要了解其基础——哥德尔机(Gödel Machine)的概念。

哥德尔机是一种理论上能够自我完善的AI系统。它试图通过数学证明来找到更优的解决方案,并据此重写自己的代码。

这一概念最早由Jürgen Schmidhuber在二十多年前提出,目的是挑战传统的机器学习框架,后者依赖于人类设定的学习方法和固定的算法结构。

不少网友也感慨道:

哥德尔机则颠覆了这种局面,它能够自主地将自身的代码视为可编辑对象,通过自我重写来增强其学习能力。

这种复杂的计算要求使得现实中的复杂任务难以实现。

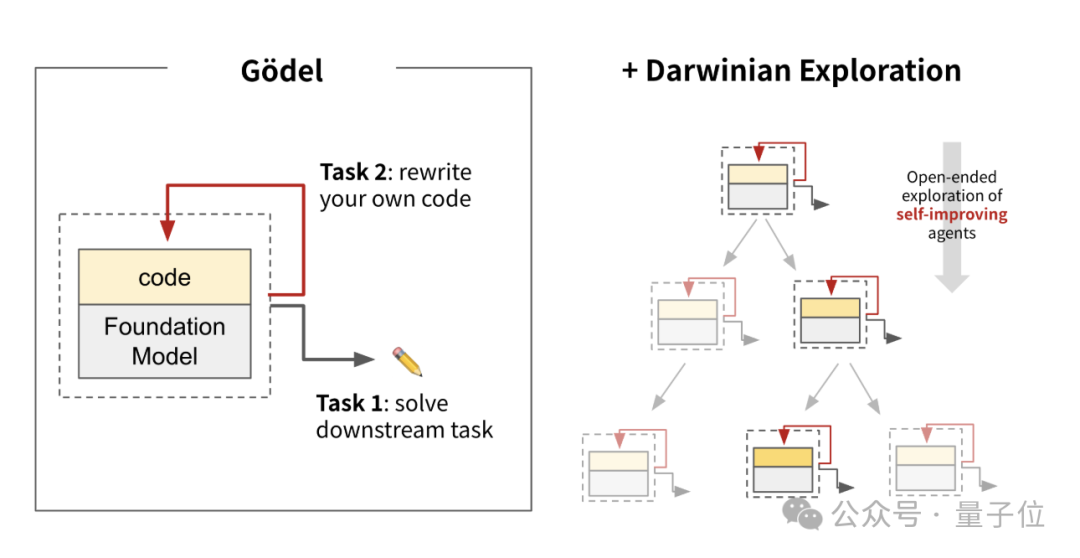

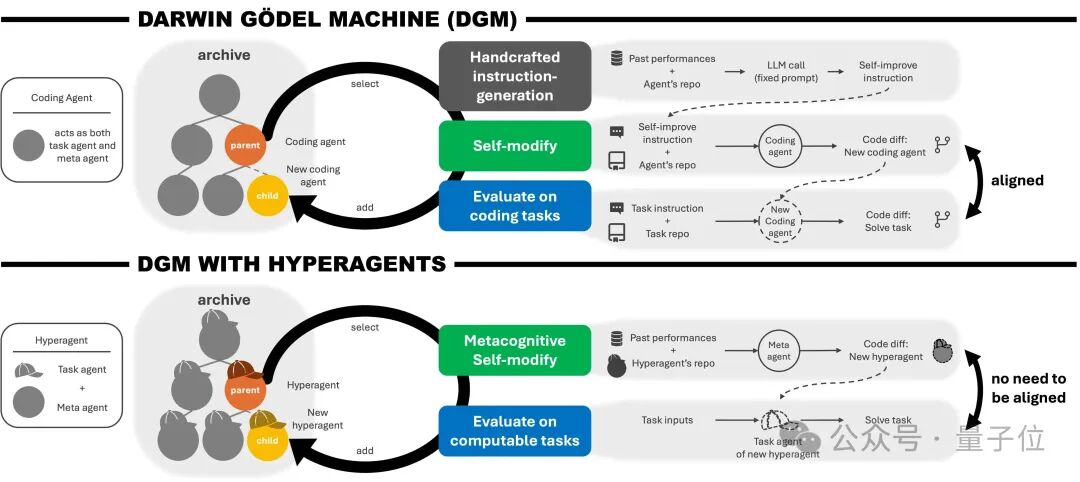

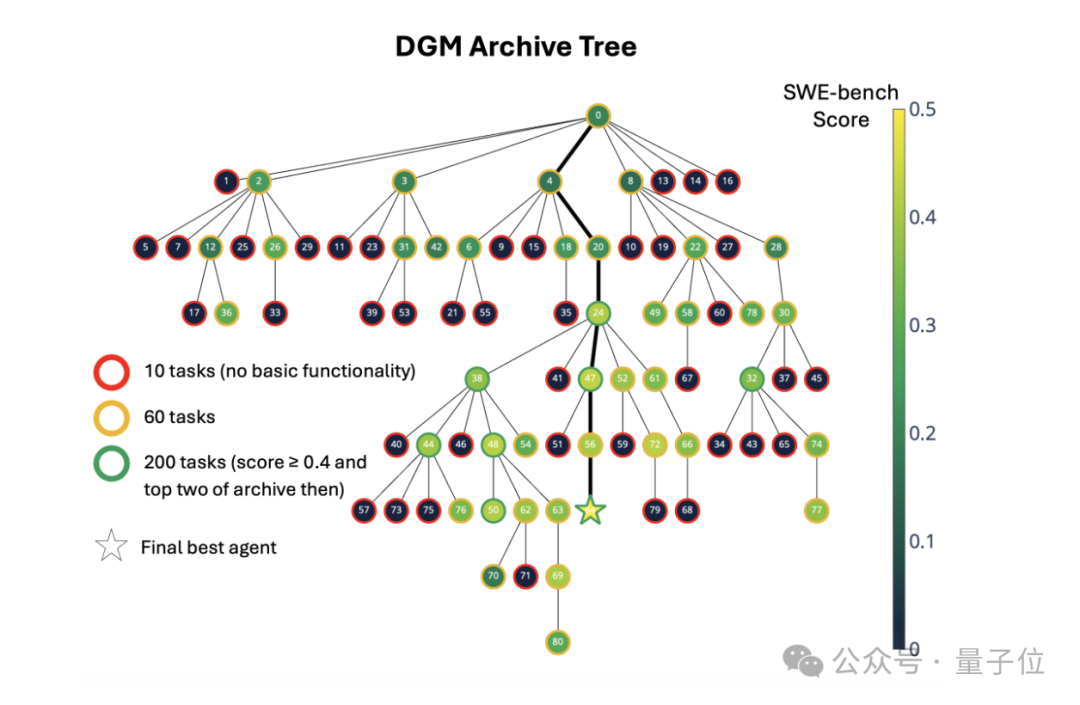

为了解决这个问题,Meta团队提出了一种新的架构——达尔文哥德尔机(DGM),它利用开放式算法搜索现有智能体库中提出的改进方案。

DGM通过这种方式不断更新和扩展其内部的AI智能体库,从而实现了跨领域的自我提升能力。

实验表明,随着计算资源的增加,达尔文哥德尔机能够获得更好的性能改善效果。

尽管DGM展现出了强大的功能,但它在非编程任务中的应用受到了限制。这是因为其核心假设——评估任务与改进方法必须“对齐”——仅适用于特定领域。

对于不涉及代码修改的任务(如创作诗歌),这种假设并不成立,因此DGM的进化链条会在此类任务中中断。

为此,论文提出了超级智能体的概念:它们不仅能自我优化执行任务的行为,还能改进生成未来改进建议的过程。

这种元认知自我修改使系统能够跨越不同领域实现持续的进步。

具体来说,DGM-H是将DGM扩展到更广泛应用的一种形式。它允许任务解决行为和自我改进程序同时进化,并通过自指性架构整合了“任务智能体”与“元智能体”功能。

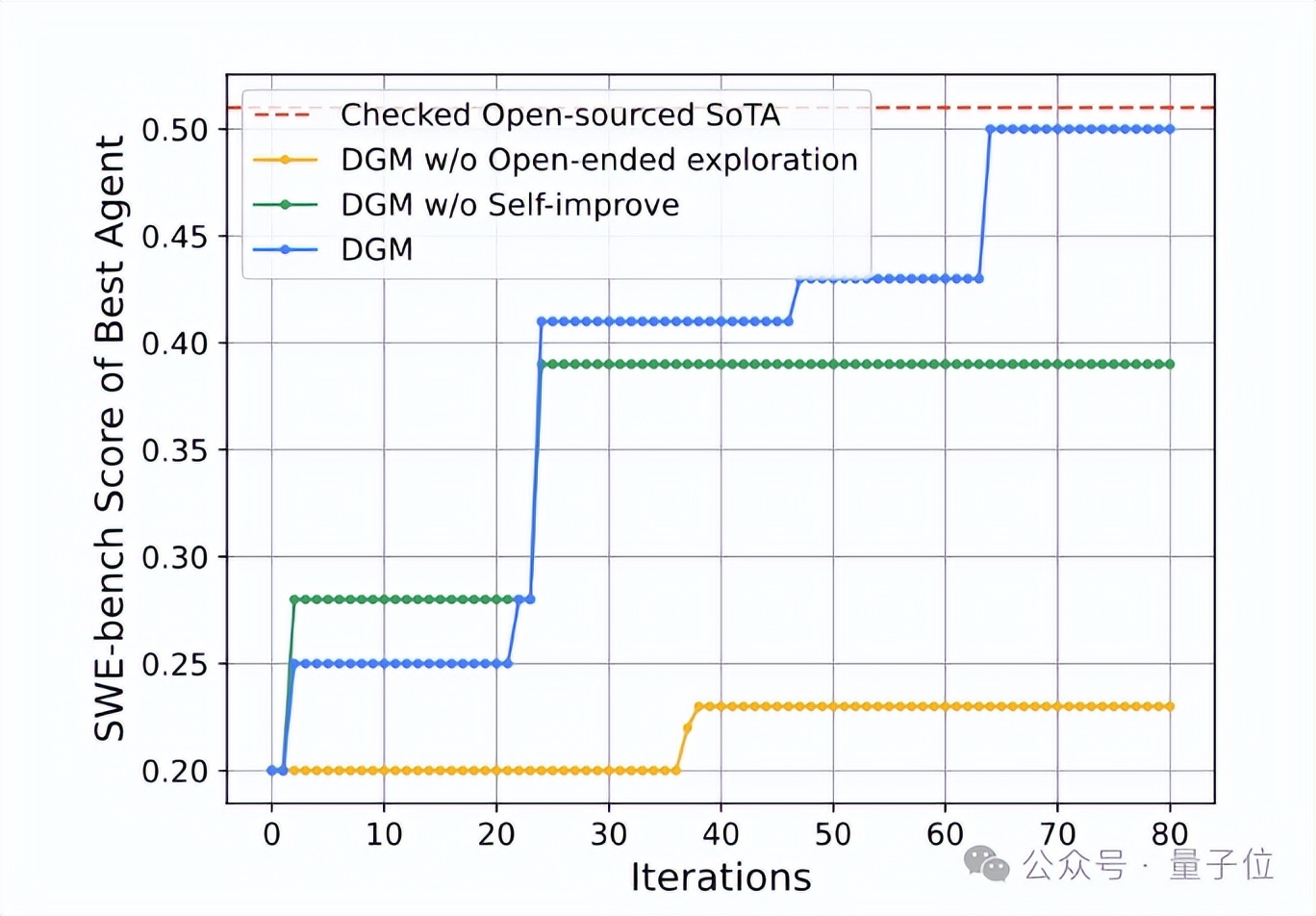

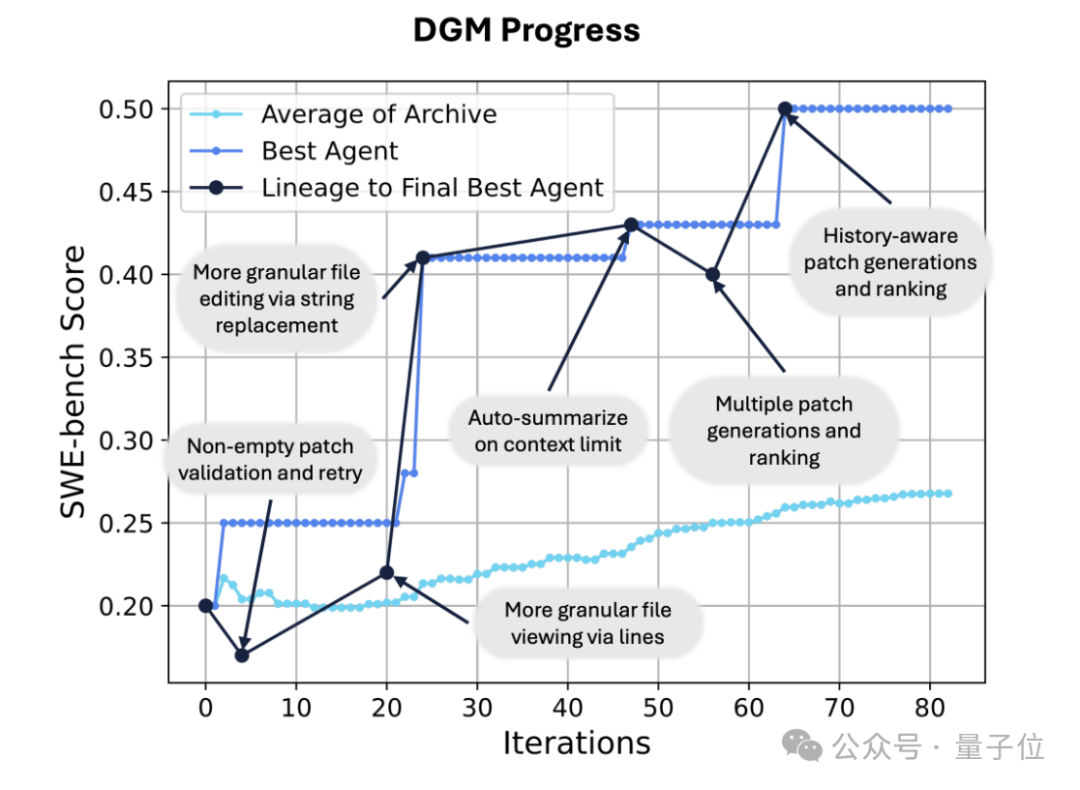

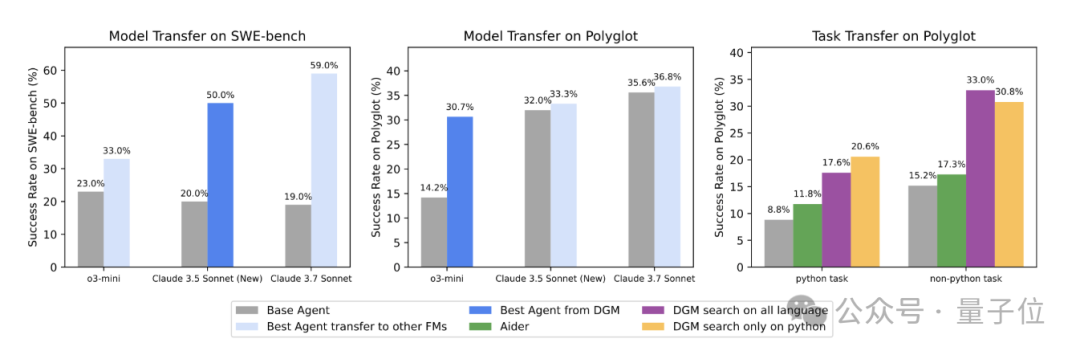

实验表明,在SWE-bench上,达尔文哥德尔机的性能从最初的20.0%提升到了50.0%,而在Polyglot测试中则从14.2%提高到30.7%,这些结果展示了DGM的有效性。

DGM之所以能够取得这样的成就,在很大程度上归功于其开放式进化搜索策略,这种策略使得不同的智能体之间可以共享信息和经验。

此外,DGM改进的跨领域迁移特性也确保了它的效果可以在多种环境中得到体现。

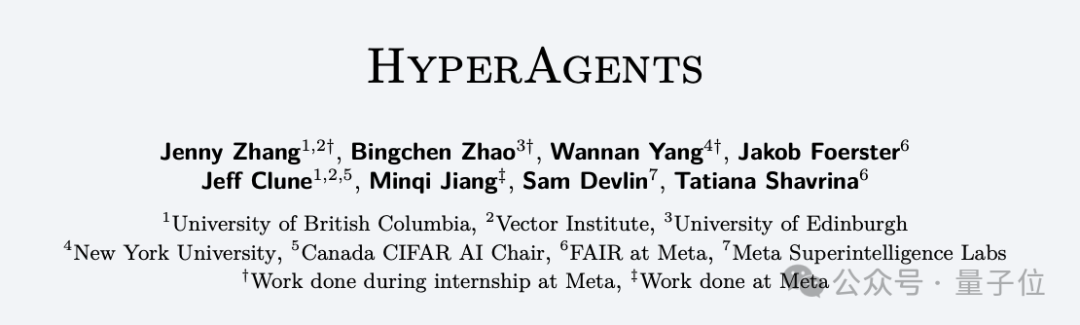

论文的主要作者是来自UBC的Jenny Zhang,在Jeff Clune教授指导下完成的研究。她专注于强化学习、自改进步AI以及开放式人工智能研究。

其他贡献者还包括爱丁堡大学的博士生Bingchen Zhao,他在同济大学获得本科教育,并在Meta FAIR团队中致力于开发自我改进的AI系统。

此外,纽约大学的Wannan Yang也是论文的重要作者之一。她在Meta超级智能实验室实习期间完成了相关研究工作。

这篇论文还得到了Jeff Clune、前Meta研究员Minqi Jiang以及其他几位专家的支持与贡献。

超级智能体

虽然DGM很强,但它存在一个致命限制:它主要在编程任务中有效。

这是因为DGM依赖一个关键假设——评估任务与自我修改任务必须“对齐”。

在编程领域,这种对齐是天然的:提升了编程能力,自然也就提升了修改自身代码的能力。

也就是说,解决外部编程问题的逻辑工具,可以直接转化为修改其自身底层代码的能力。

相反,如果是在非编程领域(如写诗),即便提升了写诗能力,也无法直接转化为修改代码的逻辑水平。

在这种缺乏“自指性(Self-referentiality)”的任务中,DGM的递归进化链条就会断裂,陷入停滞。

基于此,文章提出超级智能体——

它们既能修改自己的任务执行行为,也能修改生成未来改进建议的过程。

这实现了所谓的元认知自我修改(metacognitive self-modification):不仅学习如何做得更好,还学习如何更有效地进行改进。

进一步,论文将超级智能体实例化为DGM-Hyperagents (DGM-H)。

DGM-H是对DGM的扩展,其中任务解决行为和自我改进程序都是可编辑且可进化的,其框架如下:

- 自指性架构:它将“任务智能体(Task Agent)”与“元智能体(Meta Agent)”整合为一个单一的、可编辑的程序。

- 元级进化:在Hyperagents中,“改进的方法”本身也是可以被改进的。这使得系统不再要求任务与修改必须对齐,从而实现了跨领域的“元认知自我修改”。

打个比方,在Hyperagents中,运动员不仅在训练,教练也在学习如何更好地执教。由此,运动员的表现和教练的执教水平不断螺旋上升。

此外,DGM-H还改进了生成新智能体的过程(例如引入持久化记忆、性能追踪等),且这些元级改进具有跨领域迁移和跨运行累积的特性。

实验验证:从20%到50%的跨越

实验证明,达尔文哥德尔机(Darwin Gödel Machine)能够通过修改自身代码库实现持续的自我提升。

在SWE-bench上,DGM自动将其性能从20.0%提升至50.0%。

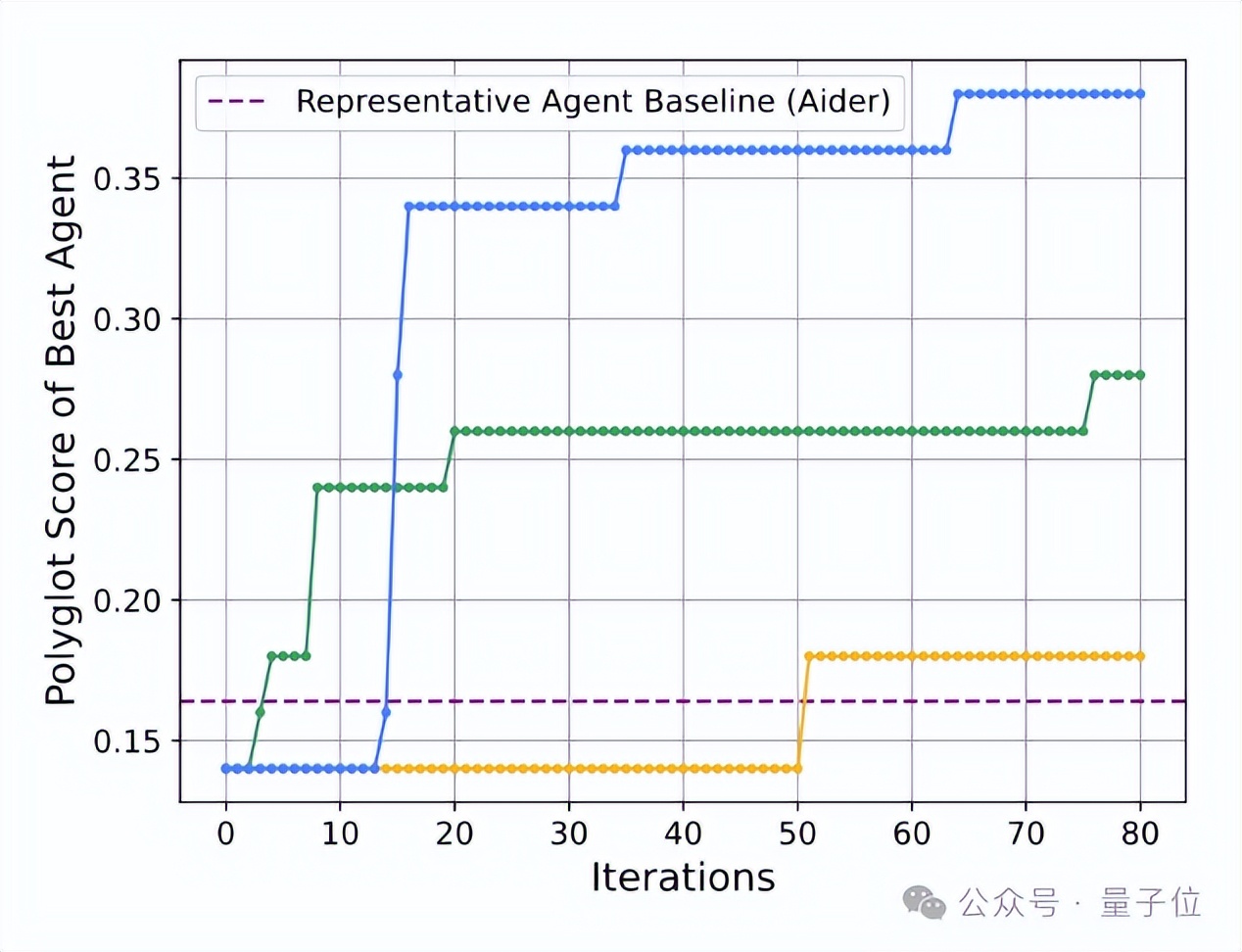

在Polyglot上,DGM的性能从初始的14.2%跃升至30.7%,远超由Aider开发的具有代表性的人工设计智能体。

这些结果证明了DGM能发现并实施有效的自我改进。

而实现这一点的关键在于其开放式进化搜索策略:

通过从现有智能体库中采样生成新智能体,DGM能够并行探索多条进化路径。

性能稍逊的“祖先”智能体在发现新方法和功能方面起关键作用,避免了早熟收敛。

此外,DGM的改进具有广泛的迁移性:

- 针对Claude 3.5 Sonnet优化的智能体,在切换到o3-mini或Claude 3.7 Sonnet时仍能提升性能。

- 在Polyglot基准中,Python任务上的自我改进同样提升了Rust、C++、Go等不同语言任务的表现。

作者介绍

最后,让我们来介绍一下这篇论文的作者们。

这篇论文的第一作者是来自UBC的Jenny Zhang,她师从Jeff Clune教授。

她本科就读于帝国理工,这篇论文是她在Meta实习期间完成的。她的研究方向专注于强化学习、自改进AI与Open-Ended AI。

Bingchen Zhao是来自爱丁堡大学的博士生,,师从Oisin Mac Aodha教授

他本科毕业于同济大学,他此前在Meta FAIR团队,致力于构建自我改进的AI系统。

Wannan Yang在纽约大学攻读博士,目前在Meta超级智能实验室实习,她本科毕业于爱丁堡大学。

论文的其他作者还包括Jeff Clune、以及来自Meta的研究员Minqi Jiang(已离职)、Sam Devlin和Tatiana Shavrina。

参考链接

[1]https://arxiv.org/pdf/2603.19461

[2]https://sakana.ai/dgm/

[3]https://x.com/jennyzhangzt

henry

henry