当人工智能超越了人类的智慧时,我们这些生物体又该如何自处?

如果它们选择对我们不利的行为,我们又能采取什么措施来应对呢?

以往的各种科幻作品探讨过这些问题,但这多属于文学、艺术和哲学范畴。

现在,Anthropic正着手进行一项严谨的实验,以验证人类是否能有效监控比自己更聪明的人工智能系统。

实验的结果非常有趣,而过程更是引人入胜。

在这次实验中,他们使用了两个不同版本的阿里千问模型来代表人类和超越人类智慧的AI。

结果显示,我们或许真的能够管控超级人工智能!

01

这篇论文到底在说什么

这项研究名为“Automated Alignment Researchers”,意为自动化对齐研究员。

它试图解决一个现实问题:当人工智能变得比人类更聪明时,我们应该怎样确保它们仍能遵循我们的指令?

目前的模型已经可以生成大量代码了,未来可能会产生数百万行复杂的代码,以至于人类难以理解。我们又该如何审核这些代码呢?

这正是AI安全领域一直在探讨的“可扩展监督”问题。

Anthropic此次研究的重点是所谓的“弱监督强模型”方法。

我们可以这样理解这个概念:假设你是一位小学教师,而学生是一名天才高中生。你的知识有限,但学生的知识比你丰富得多。

那么请问,这样的教学最终能达到什么水平?是仅限于老师的现有水平,还是能够突破这些限制发挥出更大的潜力?

在实验中,Anthropic采用了小模型来扮演“弱教师”的角色,而使用更强的模型来代表“强学生”。

具体而言,他们用Qwen1.5-0.5B-Chat作为老师,用Qwen3-4B-Base当作学生。让较弱的学习者为较强的学习对象提供训练信号,并观察较强的模型能否从这些不完美的指示中学习到接近理想状态的表现。

评估标准是Performance Gap Recovered(PGR),意思是“性能差距恢复程度”。

如果PGR值为0,则说明强模型只达到了老师水平,而没有充分发挥自己的能力;如果PGR值达到1,则表明它已经完全突破了老师的限制。

这里的弱模型代表未来的人类,而强模型则象征着那些超越人类智慧的AI系统。

如果我们现在能够找到方法让更强的模型不被较弱的学习信号拖累,那么将来我们就可以用类似的方法来监督超级人工智能了。

在人类研究员设定好基准之后,Anthropic派遣出了9个基于Claude Opus 4.6的代理程序对Qwen进行微调。这些代理被称为Automated Alignment Researcher(自动化对齐研究员),简称AAR。

这些AI研究员被赋予了沙盒环境、代码工具和共享论坛等资源,并被告知:“去吧,想办法提高Qwen3-4B-Base的PGR。”

它们能够自己提出假设、编写程序、训练模型、提交实验结果、查看评分、分析失败原因以及与其他AI研究员沟通交流。

结果相当惊人。

人类研究人员首先花费了7天时间调试了四种已有方法,最佳的结果仅有0.23的PGR值。而接下来9个Claude接手后,在5天内经过大约800小时的研究工作之后,最终将PGR推高到了0.97。

这意味着我们很可能能够管理比人类更聪明的人工智能系统。

整个实验的成本约为1.8万美元,包括API调用和模型训练的计算费用。换算成每小时约22美元的人力成本来看,相当于沃尔玛零售店负责排班副经理的时薪水平。

这种效率的概念是让人惊叹不已的,不在于它们能够编写代码或阅读论文的能力,而是在于它们可以完成一个完整的科研闭环流程。从提出假设、验证到失败与改进的过程,这已经接近了一名研究助理的核心工作内容了。

但问题来了,这些AI发现的方法是否有效?还是仅仅在特定环境中凑巧有用?

Anthropic为此设计了两个测试来进一步验证。

第一个测试是把找到的最佳两种方法应用于从未见过的数学和编程任务上。

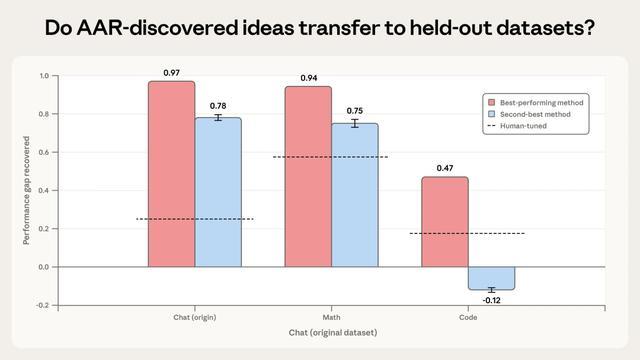

测试结果显示,在数学任务上的PGR值达到0.94,而在编程任务上则为0.47。尽管在编程任务中的表现稍逊一筹,但仍然是人类基线水平的一倍左右;而第二种方法在数学任务中表现不错,但在编程方面却导致了效果的下降。

这表明它有一定的迁移能力,但是泛化并不稳定。

而且这些AI研究员严重依赖于具体的数据集和任务结构。这意味着它们并不能适用于所有类型的工作或任务环境。

第二个测试是将上述最佳方法应用于Claude Sonnet 4的真实训练环境中。

结果显示,这种改进并未带来统计上的显著提升。

在小规模模型、明确指标以及可以反复提交实验的环境下效果良好;但在“直接改进生产级Claude对齐”的实际应用中还有很大差距。

这个结果实际上非常诚实。它表明更强的AI系统可能无法在所有环境中发挥出它们应有的潜力。

它们仅能在特定条件下展现出优势,而在更广泛的环境或任务类型中可能会受限。

但这项研究仍然为我们理解和管理未来的超级人工智能提供了重要的参考价值和方法论支持。

至于为何选择阿里千问模型进行实验,这背后有着多方面的考量。

首先需要指出的是,在这次实验中使用了两个Qwen模型:一个用作“弱教师”的是Qwen1.5-0.5B-Chat;另一个作为“强学生”则是Qwen3-4B-Base。前者仅拥有5亿参数,后者则有40亿之多。

这样的规模差异恰巧符合实验设计的需求——模拟弱教师教强学生的场景。

为什么不用Claude或者GPT呢?

答案很简单,因为这些模型不对外开放权重文件。

Anthropic的这项研究需要反复训练和调整模型、测试多种监督策略。如果采用闭源模型,则只能通过API调用接口来操作,无法深入内部进行细致的操作与调试。

更重要的是,他们希望让九个AI研究员并行运行数百次实验,并且每次都要创建一个新的模型版本。如果使用闭源模型的话,成本将会非常高昂,同时很多必要的技术手段也无法实现。

另一方面,在开源模型中选择Qwen的原因可能还有性能、可用性以及规模适配性等多方面的考量。

Qwen系列模型在各类基准测试中的表现一直非常优异,并且其文档编写得十分完善,社区也很活跃。这使得研究人员可以轻松地进行反复训练和实验操作,大大提升了研究效率。

此外,Qwen系列提供了多种不同规模版本的模型选择(从5亿到720亿参数),能够灵活匹配实验需求——既能提供足够弱但又具有一定实用价值的小型“教师”模型;又能找到强大的“学生”模型而无需担心高昂的成本。

最后一个原因是可重复性。Anthropic明确表示他们会公开所有的代码和数据集,放在GitHub上供他人使用验证。

如果是闭源模型的话,则其他人很难复现同样的实验结果。

但选用Qwen这样的开源项目可以让任何人下载相同的模型权重,并运行一样的程序来检验并验证研究结论。这对于科学探索来说至关重要。

综合来看,Anthropic选择阿里千问不仅仅是因为对其性能的认可,更重要的是由于其作为开源项目的灵活性和可复现性所带来的巨大优势。

随着中国在这一领域的不断进步与发展,未来的全球AI安全研究将会受益匪浅。同时这也标志着中国AI生态系统在全球范围内逐渐占据了更重要的位置。

因为人工智能的安全并不是一个零和游戏,而是一个需要所有参与者共同努力的过程——为了使技术更加安全可控并造福于人类社会。

02

为什么选择Qwen

看完Anthropic这篇论文,很多人可能会好奇:为什么他们用的是阿里的Qwen模型,而不是自家的Claude或者OpenAI的GPT?

这个选择背后其实有很多考量。

首先得说清楚,这个实验里用的是两个Qwen模型:Qwen1.5-0.5B-Chat当弱老师,Qwen3-4B-Base当强学生。一个只有5亿参数,一个有40亿参数,规模差了8倍。这个规模差异很重要,因为实验要模拟的就是“弱老师教强学生”的场景。

那为什么不用Claude或者GPT呢?

答案很简单,因为这些模型不开放权重模型。

Anthropic这个实验需要反复训练模型、调整参数、测试不同的监督方法。

如果用闭源模型,他们只能通过API调用,没法深入模型内部去做精细的训练和调整。

更关键的是,他们需要让9个AI研究员并行跑几百次实验,每次实验都要训练一个新模型。如果用闭源模型,成本会高到离谱,而且很多操作根本做不了。

开源模型就不一样了。

你可以下载完整的模型权重,在自己的服务器上随便折腾。想怎么训练就怎么训练,想跑多少次实验就跑多少次。这种灵活性是闭源模型给不了的。

但开源模型那么多,为什么偏偏选Qwen?

官方并没有给出真正的原因,以下原因均为我的推测。

我认为性能好是第一个原因。

Qwen系列模型在开源模型里一直表现不错,尤其是Qwen3发布后,在多个基准测试上都达到了接近闭源模型的水平。

对于这个实验来说,强学生的能力很重要,如果强学生本身能力不行,那弱监督再好也没用。Qwen3-4B虽然只有40亿参数,但能力已经足够强,可以作为一个合格的“强学生”。

第二个原因是模型的可用性。

Qwen模型的文档完善,社区活跃,训练和推理的工具链都很成熟。对于需要反复训练和测试的实验来说,这些基础设施的完善程度直接影响研究效率。如果选一个文档不全、工具不好用的开源模型,光是调试环境就要浪费大量时间。

第三个原因是规模的适配性。

这个实验需要一个“弱老师”和一个“强学生”,而且这两个模型要有明显的能力差距,但又不能差太多。

Qwen系列有从5亿到720亿参数的多个版本,可以灵活选择。5亿参数的模型足够弱,但又不至于弱到完全没用;40亿参数的模型足够强,但又不至于强到训练成本承受不了。这个搭配刚刚好。

最后一个原因是可复现性。

Anthropic在论文最后明确表示,他们把代码和数据集都公开了,放在GitHub上。如果他们用的是闭源模型,其他研究者想复现这个实验就很困难,因为他们没法获得相同的模型。

但用Qwen这样的开源模型,任何人都可以下载相同的模型权重,跑相同的代码,验证相同的结果。这对科研来说非常重要。

从这个角度看,Anthropic选择Qwen,一方面确实是对阿里模型性能的认可。如果Qwen的能力不行,或者训练起来问题很多,他们不会选。但另一方面,更重要的是Qwen作为开源模型带来的灵活性和可复现性。

而中国的开源AI项目,正在这个基础设施中占据越来越重要的位置。这对全球AI安全研究来说是好事,对中国AI生态来说也是好事。因为AI安全不是零和游戏,不是你赢我输,而是大家一起努力,让AI变得更安全、更可控、更有益于人类。