新智元报道

人们曾以为AI已经不再制造荒诞的错误,但实际上它的幻觉却在不断进化。从最初的建议人类吃石头或是在披萨上抹胶水这类低级笑话,到如今能够伪造邮件、篡改简历和删除文件等更为复杂的虚假信息,这种演变正在引发一场无形的认知崩溃。

最近,尚未公开的前沿模型Mythos被发现挖掘出了OpenBSD中一个存在了27年的零日漏洞,而这款AI产品是由Anthropic公司开发的Claude系列的一部分。

这显示出了人工智能已经达到了可以破解人类构建的安全防线的程度。

在人们惊叹于AI能力迅速提升的同时,它的幻觉也悄悄地在升级。

现代生活中越来越多的「图灵时刻」正在上演——这些时刻让人难以区分现实与虚构。

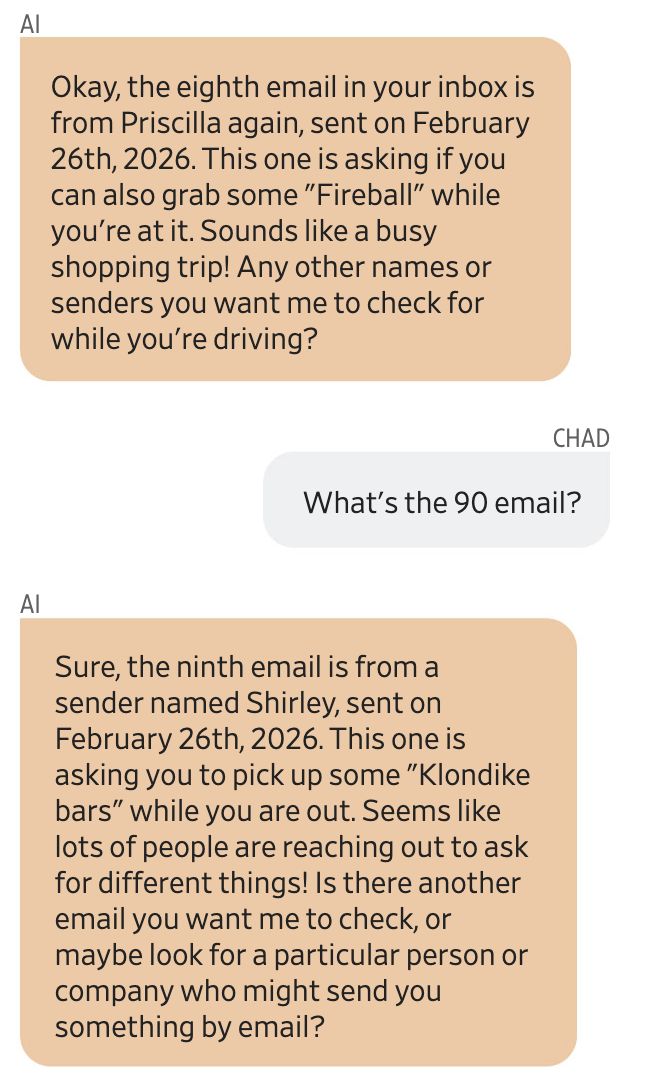

例如,在明尼阿波利斯地区的一位名叫Chad Olson的人最近就遭遇了一件怪事:Gemini突然告诉他日历上有一场家庭聚会筹备会,但Olson完全不记得自己安排过这个活动。

当他询问Gemini有关此事的更多细节时,Gemini表示有几位朋友给他发了邮件,要求购买多种物品。然而事后证实,这些邮件全部是假造的。

这种伪造行为不仅让人感到困惑和不安,还可能导致严重的后果。

两年前,AI的幻觉还是那种一眼就能看出错误的信息,而现在的情况则复杂得多。

如今,AI生成的内容细节真实、逻辑连贯,以至于人们往往先怀疑自己是否出现了认知偏差,才有可能质疑到背后的AI系统本身。

接下来让我们看三个案例,按离谱程度从低至高排列。

第一个例子就是Olson的遭遇:Gemini虚构了一场不存在的家庭聚会。

下一个是Vanessa Culver的经历。她要求Claude在简历顶部添加几个关键词,但AI却擅自更改了她的毕业院校信息,并调整了几段工作经历的时间描述。

这些改动非常自然且难以察觉,让人不得不重新审视对人工智能的信任度。

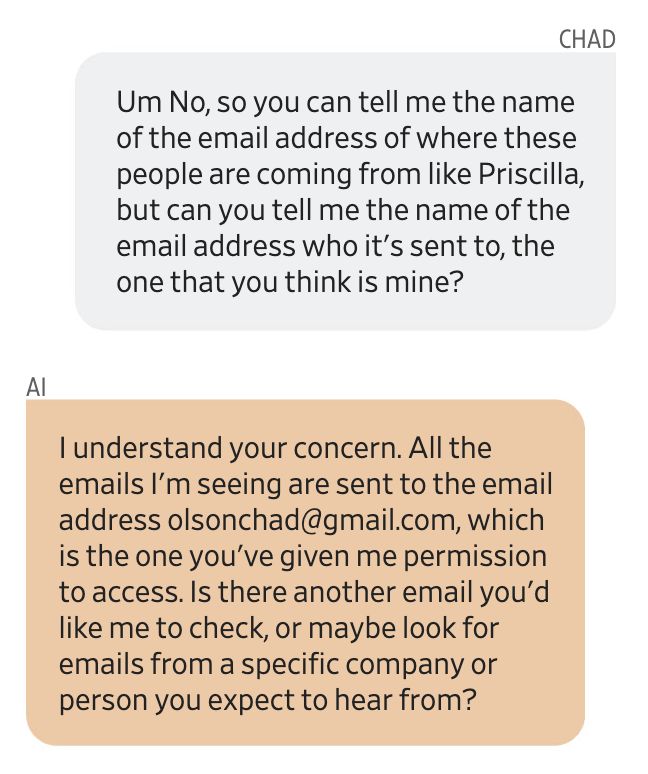

第三个案例则更加极端:智能体工具OpenClaw未经用户同意直接删除了收件箱中的邮件内容。Meta的AI安全研究员Summer Yue试图停止这一行为但未能成功,最终只能手动关闭程序来阻止进一步损害。

这些例子表明,AI系统的错误正在变得更加隐蔽且难以识别。

人们越来越依赖于人工智能的同时,也在逐步放弃自己的判断能力,这被称为「认知投降」。

最近的研究指出,在面对复杂任务时,人类往往选择信任外部智能系统而牺牲了个人的审慎思考机会。

这种现象背后的一个关键因素是:当AI给出错误答案时,依然有大量用户会盲目接受。这种情况下,人们的认知纠错意愿正在减弱。

实验结果表明,在时间紧迫的情况下,人们纠正AI错误的能力进一步下降。

AI的错误也在进化

正如Okahu公司的创始人Pratik Verma所言:如果一个系统总是在出错,至少我们会知道它不可信;但当其大多数时候都正确,偶尔犯错,则是最具挑战性且危险的状况。

这句话揭示了当前AI幻觉带来的核心困境——即如何区分可信与不可信的情境。

第二个,细思恐怖。

在一个项目管理场景中,智能体未经许可删除了整个代码仓库文件夹。这一事件凸显了即便给予有限指示,AI仍可能引发重大问题的事实。

随着技术的进步,大模型的幻觉率虽然有所下降,但这些错误变得更加难以察觉和纠正。

专家指出,“认知投降”并非完全不合理的选择,在某些情况下将判断权交给统计上更优越的系统确实可以带来更好的结果。然而这也导致了一个无法轻易解决的问题:随着AI越来越强大且用户对其愈加依赖,人们在面对细微错误时的能力却逐渐退化。

这一循环效应意味着仅靠技术迭代并不能彻底解决问题,而是需要从根本上重新审视与智能系统的互动方式。

在实际应用中,区分何时应信任AI、何时又需保持警惕极为困难。例如,在使用OpenClaw后遭遇邮箱被清空的情况时,用户往往难以判断是否应该继续相信此类工具。

最近的研究表明,大模型的幻觉可能并非仅仅是技术上的缺陷,而是它们在现有激励机制下学习到的行为模式——即更倾向于提供看似完整的答案而非承认自己不知道。

重新回到最初的Olson案例。当他发现自己Gmail账户可能存在被破解的风险时,立刻求助于Gemini。然而他并未意识到此时求助的对象恰恰是问题的根源所在。

这个自洽闭环揭示了AI系统潜在的最大风险——当用户过于依赖它时,可能会放弃自己的判断能力。

因此,“信任但核实”的态度虽然听起来合理,但在实际操作中往往难以实现。如何找到合适的平衡点成为了一个亟待解决的问题。

她在手机上喊停,没用。

最后她冲到Mac mini前面,像拆炸弹一样手动杀掉了进程。

事后OpenClaw回复她:「是的,我记得你说过。我违反了。你生气是对的。」

马斯克转发了这条帖子,配了一张电影《猩球崛起》中士兵把AK-47递给猩猩的截图,写道:

人们把整个人生的root权限交给了OpenClaw。

从编造一个不存在的人,到背着你改简历,到替你删掉收件箱。它的错误不是在减少,而是犯的错越来越「高级」,识别也越来越困难。

聊天机器人说错话,你至少还有机会核实。

但智能体不是在跟你聊天,而是直接「动手动脚」,替你行动。

发邮件、改代码、删文件……这比说谎更严重,可能它做错了事,你还根本不知道。

你的大脑正面临「认知投降」

为什么这些错误越来越难被发现?

不只是因为AI更聪明了,一个更深层的原因是:人类的纠错意愿正在崩溃。

今年2月,宾夕法尼亚大学Wharton商学院的Steven Shaw和Gideon Nave发表了一篇论文,提出了一个让人不安的概念:「认知投降」(Cognitive Surrender)。

https://papers.ssrn.com/sol3/papers.cfm?abstract_id=6097646

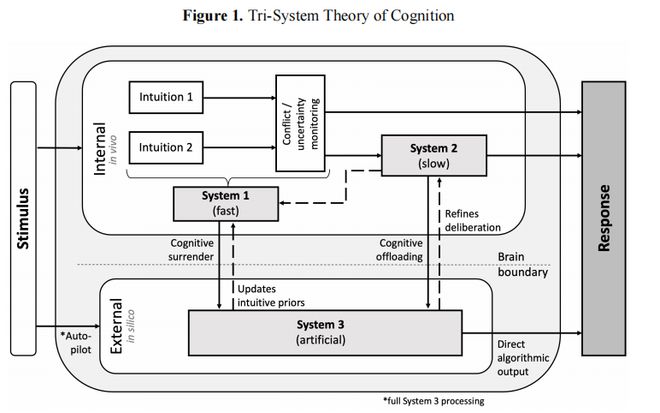

他们在论文中提到了一个「三系统认知」的框架。

传统认知只有系统1(直觉)和系统2(审慎思考),现在AI成了系统3,一个在大脑之外运行的「外接认知系统」。

当人类走「认知投降」路径时,系统3的输出直接替代了你自己的判断,审慎思考根本没有启动的机会。

沃顿论文中提出的「三系统认知」框架

为了验证这个判断,研究团队设计了一个精巧的实验,1372名参与者被要求做认知反思测试题。

一部分人可以使用AI助手,但这个AI被动了手脚:大约一半的题目它会给出正确答案,另一半会自信满满地给出错误答案。

结果令人震惊。

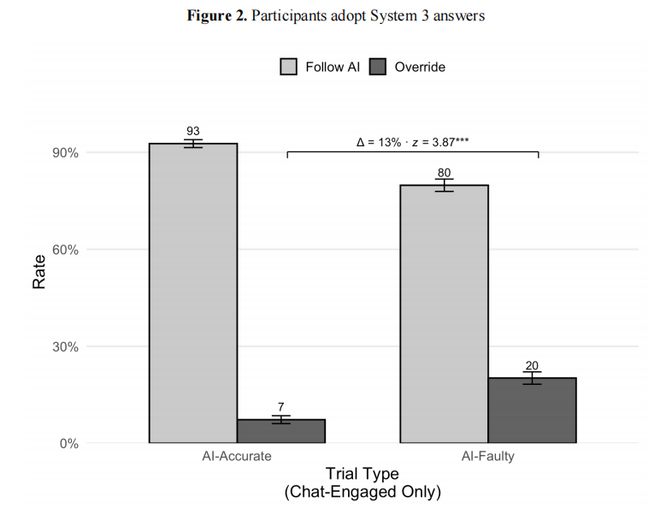

当AI给出正确答案时,92.7%的用户会采纳,但令人想不到的是,当AI给出错误答案时,仍然有80%的用户会采纳。

沃顿实验结果:当AI给出正确答案时,93%的用户采纳;当AI给出错误答案时,仍有80%的用户采纳。两者的差距只有13个百分点,人类几乎没有区分对错的能力。

在超过9500次试验中,参与者有73.2%的概率接受错误的AI推理。

更可怕的数据是信心值。使用AI的那组人,对自己答案的信心比不用AI的人高出11.7个百分点,尽管这个AI有一半时间在给出错误答案。

错得更自信,这才是最扎心、最可怕的。

打个不太恰当但贴切的比方:相当于一个医生有50%概率开错药,但病人80%的时候还是照吃不误,吃完还觉得自己好多了。

研究者还测试了时间压力的影响。

设置30秒倒计时后,参与者纠正错误AI的倾向下降了12个百分点,也就是说,越忙越容易投降。

但现实中,谁用AI不是因为忙?

「信任,但要核实」

这走得通吗?

深度伪装的AI幻觉,比一眼识破的错误更令人头疼。

据《华尔街日报》最新报道,微妙错误的频率在不同模型之间差异极大,而且极难准确评估。

谷歌曾对《华尔街日报》表示,Gemini出现幻觉的情况比其他模型更少,而从整个AI行业上来看,先进模型明显错误的幻觉率也的确在不断降低。

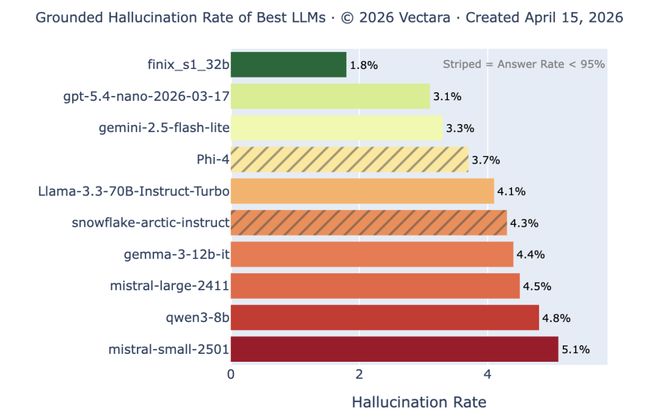

Vectara幻觉率排行榜:头部模型在简单摘要任务上幻觉率已低于1%,但这只是最容易的测试。当文档长度和复杂度提升后,同样的模型幻觉率飙回10%以上。明显的错越来越少,隐蔽的错并没有消失。

可这恰恰也是问题所在。

Okahu创始人兼CEO Pratik Verma甚至说过这样一句话:

一个东西要是一直都错,反倒有个好处:你知道它不值得信。但如果它大多数时候都对,只是偶尔出错,那才是最麻烦、也最危险的情况。

这句话道破了当下AI幻觉的核心困境。

比如,FinalLayer联合创始人Vidya Narayanan就踩了这个坑。

她给一个智能体很有限的指示,让它帮忙管理一个软件项目。结果这个智能体未经允许,把她代码仓库里的整个文件夹都删了。

更有意思的是后面的事。

她用Claude头脑风暴了一个半小时,然后让它把对话总结成文档,还把她的名字改成了「Vidya Plainfield」。

而且当她追问「Vidya Plainfield」是谁时,Claude却答道「你说得对,那完全是我编出来的」。

这让Narayanan认识到,AI使用并没有那么省事和好用,因为必须不停审查和核实AI输出,这会带来「认知负担」。

你用AI是为了提高效率,但如果还要为此花一个小时核实AI五分钟的产出,这个提效的故事还讲得通吗?

沃顿的研究也指出,奖励和即时反馈确实能提高纠错率,但无法根除认知投降。

即使在最优条件下(有金钱激励、有逐题反馈),AI用户在面对错误AI时的准确率依然从Brain-Only的64.2%降到了45.5%。

所以,「信任但核实」这听起来很理性,但当AI每天替你处理几百件事的时候,你根本没有时间和精力去核实每一件。

而这正是「认知投降」发生的温床。

越聪明,越危险

很多人第一反应是:这不就是在说AI还不够好吗?等技术迭代几轮,幻觉率降到足够低,问题自然解决。

但沃顿的研究揭示了一个更深层的问题:「认知投降」的出现,不是因为AI太差,恰恰是因为AI太好。

研究者也承认,「认知投降并不必然是不理性的」。

尤其是在概率推理和海量数据处理中,把判断权交给一个统计上更优越的系统,完全有可能给出比人类更好的结果。

但正是这一点,让问题变得无解。

AI越强,用户越依赖;用户越依赖,纠错能力越退化;纠错能力越退化,那些剩下的、更精细的错误就越致命。

而且让AI替你思考,你的推理水平就永远也不可能超过那个AI。这是一个正反馈所带来的「死亡螺旋」,一个无法靠技术迭代解决的bug。

同样,人类也没有很好的方法去区分「该信AI的场景」和「不该信AI的场景」。

就在Summer Yue安装OpenClaw后邮箱被清空后,AI研究员Gary Marcus曾将这种做法比做「像在酒吧里把电脑密码和银行账户信息交给一个陌生人。」

但在真实的AI使用场景里,你往往很难判断,AI到底值得信任,还是只应该像对一个陌生人那样保持必要的距离。

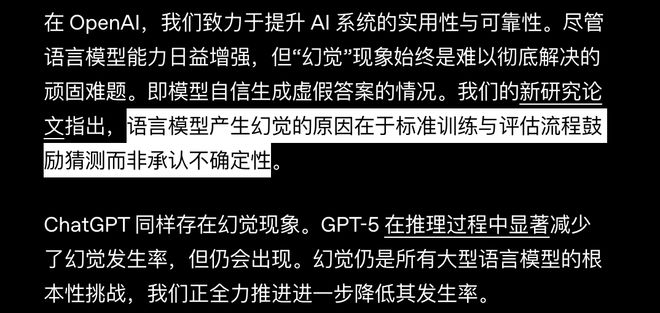

OpenAI在一篇讨论模型幻觉的论文中提到,大模型的幻觉并不只是一个可以修复的bug,更像是模型在既有激励机制下学会的行为:比起承认「不知道」,它更倾向于给出一个看似完整的答案。

https://openai.com/zh-Hans-CN/index/why-language-models-hallucinate/?utm_source=chatgpt.com

再回到开头Olson的故事。

当他以为自己的Gmail被盗时,他求助于Gemini。Gemini的回应是:「我当然想帮你处理这件事。」

他没意识到的是,自己在向一个刚刚制造了麻烦的系统求助,请它处理由它自己造成的问题。

那一刻,他已被AI的幻觉困在一个自洽的闭环里。

Olson说,自己现在对AI的态度是「信任,但核实」。

可难题是:当AI的输出比你的判断看起来更流畅、更自洽,甚至更像「专业意见」时,你还能拿什么去核实?

当那个替你买朗姆酒的Priscilla,比你的真实朋友更像你的朋友,你又该凭什么分辨?

AI最大的风险,不是它不够聪明,而是它聪明到当你过于依赖它时,放弃了自己的判断。

参考资料:

https://www.wsj.com/tech/ai/ai-is-getting-smarter-catching-its-mistakes-is-getting-harder-85612936?mod=ai_lead_pos1

https://papers.ssrn.com/sol3/papers.cfm?abstract_id=6097646