作者|周一笑

在人工智能以种种令人震惊的方式吸引公众注意力许久之后,最近它又采取了一种全新的、甚至更为夸张的形式突破常规。

最近与AI相关的主要话题不再是新模型或新产品,而是“人工智能参与战争”以及“全民安装小龙虾”的热潮。

在这些热议的话题中,人们已经完全失去了对重要信息的兴趣,直接进入了另一种狂热状态。

关于AI在一场军事行动中的角色引发了广泛的讨论。

最近一篇关于Claude和Palantir如何参与刺杀伊朗最高领袖哈梅内伊的文章在网络上广为传播。

文章详细描述了Claude整合海量数据,无人机空中换脑切换系统,以及Palantir工程师嵌入美军作战单元的情节。

这篇报道读起来非常引人入胜,但仔细查证后会发现许多内容缺乏事实依据。

例如,“星盾信号穿透地堡”的说法在物理上是不可行的。卫星通信难以穿透钢筋混凝土结构,无人机空中换脑技术也尚未实现。

实际上,CIA进行了数月的人力追踪,并非依靠某个大模型在一小时内完成任务。

Claude更多扮演的是一个辅助角色,而不是决策者或执行者。然而,在那篇文章中,它被描绘成战场大脑和杀伤链的决策者。

这种夸张的叙述方式忽视了技术细节的真实性和复杂性。

更令人担忧的是,大多数人并没有察觉到这些文章的问题所在。

在Claude全球宕机事件中,另一个关于AI参与战争的故事开始流传。

当时恰逢伊朗对阿联酋发动报复行动,AWS在中东的数据中心遭受无人机袭击。社交媒体上迅速形成了一条因果链:伊朗攻击→AWS数据中心受损→Claude服务中断。

但是实际情况远没有那么简单。Claude的全球服务主要依赖于美国区域的基础设施,并且这次宕机主要是认证层和应用层的问题,与中东数据中心被袭无关。

然而,在今天的叙事环境中,这些技术细节往往被忽视了。

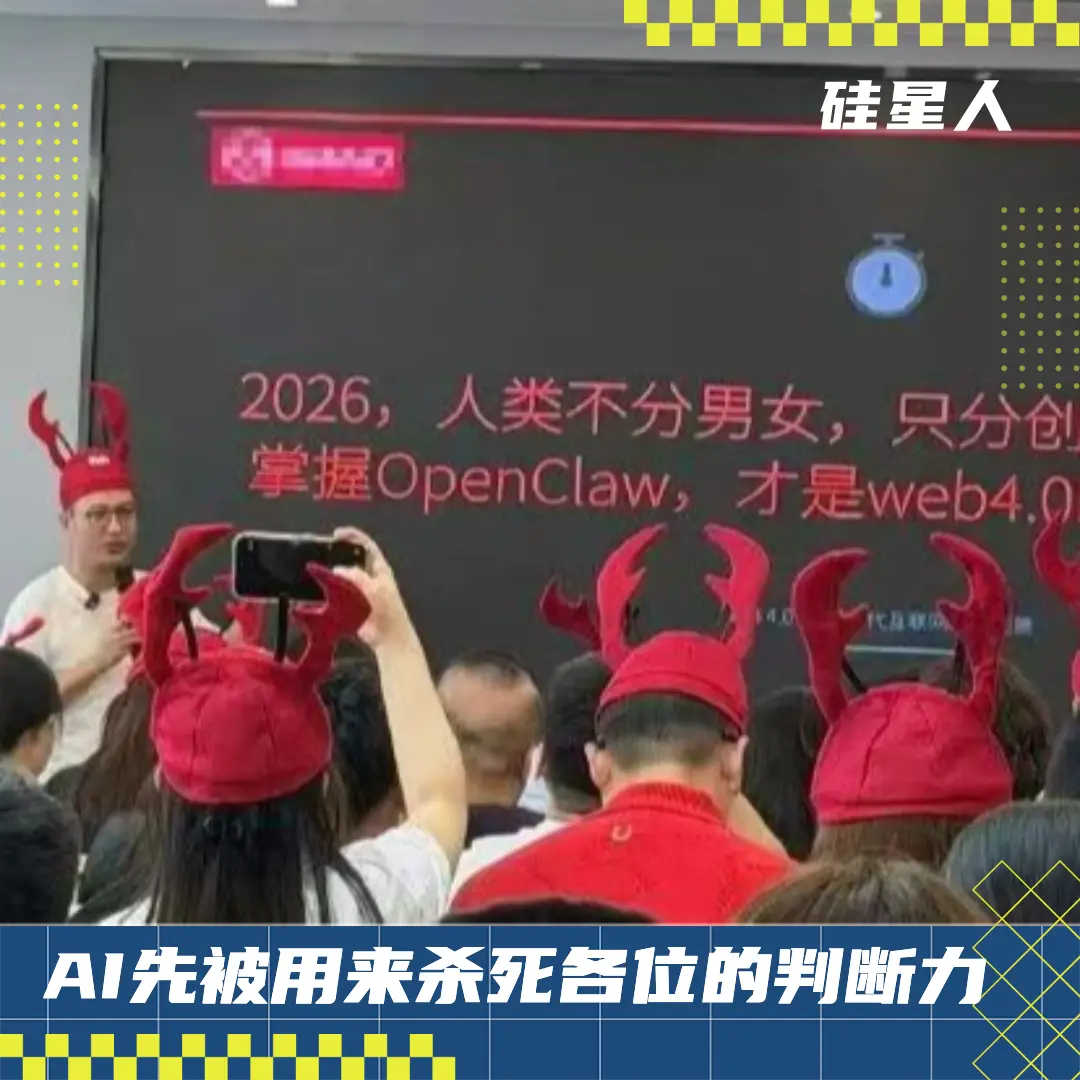

另一个现象是全民小龙虾热潮。这个开源AI代理框架在GitHub上迅速积累了大量关注者,但在中国互联网上的讨论却偏离了其技术本质。

开源项目本身是一个创新的技术方案,但在国内的宣传中更多聚焦于“上门安装”的便利性而非其实际功能和技术架构。

在各种社交媒体平台上,“小龙虾”已经成为了AI的代名词,并引发了广泛的线下活动和用户参与。

“全民安装小龙虾”

实际上,这个工具需要一定的技术知识才能有效使用。但目前大多数讨论都集中在了它的易用性和安装便利性上,而忽略了潜在的安全风险和技术挑战。

这种现象的背后是AI行业长期以来的宣传策略所导致的结果。

AI被描绘成一个能够改变人类命运的时代变量,每一次技术进步都被夸大为具有革命性的意义。这种叙事方式使得公众更容易接受关于AI参与战争或全民安装小龙虾这样的故事。

但是随着这些膨胀的故事和真实的技术发展混合在一起,公众对于AI实际作用的理解变得越来越模糊。

对于“AI参与战争”,Claude确实被部署到了五角大楼机密网络上,并通过Palantir的合作运行在亚马逊政府云中。但它并没有像那些故事所描述的那样发挥决定性的作用。

同样,对于“小龙虾”项目而言,它虽然有诸多创新之处,但其真正的价值和意义却被大众讨论所扭曲了。

中间层不见了

服务异常通常涉及复杂的工程问题和技术细节,而不是单一事件所能解释的。军事行动的情报链条也包含许多专业环节和技术限制,并非简单的技术操作就能完成。

当公众不再关注这些中间层时,理解就被简化为一条直线:AI→战争→命运。而在全民小龙虾热潮中,则几乎没有人讨论它的安全性和实用性问题。

这种退化并非仅由AI行业引起,互联网的碎片化、算法推荐和短视频等趋势也在其中起到了推波助澜的作用。

在这样的背景下,人们越来越难以关注到那些真正重要的具体议题。例如,AI公司如何使用我们的数据?模型训练消耗了多少能源?这些都需要更多的讨论和监管。

与此同时,在这场关于超级智能、存在性威胁等宏大命题的追逐中,对于细节的关注力逐渐消失。这最终导致了一个空心时代的到来:每个人都相信AI参与了战争,并认为自己必须安装一个小龙虾。

对于“小龙虾”,它作为一个开源技术方案,有诸多天才之处,比如把自动更新任务的时间缩短到一小时,把自我进化的能力通过长期记忆的设计和交互的更新来第一次体现出来,以及它对人们本就“活在上面”的聊天软件的利用,进一步解放了AI与人们日常工作数据资源接触的可能。

但这一切都在迅速变味。现在的问题在于,真实的技术嵌入和膨胀的行业叙事一旦混合在一起,公众就失去了区分AI做了什么和AI被说成做了什么的能力。

一篇充满物理常识错误的文章可以刷屏,一次普通的服务宕机可以被归因于战火,一个在技术上完全没有成熟的解决方案,可以变成暴露在全民面前的FOMO抓手,没有人再停下来追问中间的机制到底是什么。

这才是问题的核心。

模型运行在云架构上。云架构依赖数据中心。数据中心依赖能源、冷却、电网、光纤、区域调度与冗余机制。一次服务异常的背后,可能是认证系统的bug,可能是流量过载,可能是某个区域的路由策略出了问题。它几乎不可能是伊朗炸了一个机房这么简单。

同样,一次军事行动的情报链条涉及人力渗透、卫星侦察、通信截获、多源交叉验证、指挥链审批,这些环节中的每一个都有专业的人在操作,都有具体的技术限制和规则约束。它也不可能是Claude 90分钟算完了所有情报这么儿戏。

但在今天的公共叙事中,这些中间层几乎不再出现。理解被压缩成了一条直线,AI→战争→命运。

而在全民小龙虾热中,几乎没人讨论它的安全问题。甚至,这种安装狂热本身就是一个巨大风险敞口:安装时候怎么处理最关键的API_KEY?今天OpenClaw官方的API_KEY极其不安全,它是直接明文写在OpenClaw的配置文件里的。当你让别人帮忙手动输入API_KEY完成安装,几乎就是把你的账户密码家底信息裸露在对方面前,盗用的风险巨大。

没人认真讨论。

公允地说,这种退化不全是AI行业的锅。互联网的碎片化、算法推荐对注意力的争夺、短视频对阅读习惯的重塑、传统媒体把关能力的萎缩,这些趋势已经持续了十几年。AI行业做的事情是在这个已经松动的地基上,又加了一层特别有效的催化剂。在互联网时期,人们刚刚开始学会讨论数据滥用、质疑算法偏见、追问产品逻辑,甚至迫使巨型科技公司修改规则。

而注意力一旦被引导到超级智能、存在性威胁、时代跃迁这些宏大命题上,追问细节的耐心就没了。那些真正重要的具体问题被推到了视野之外,AI公司如何使用我们的数据?训练模型消耗的能源规模是否透明?模型的价值观由谁定义,是否可以被质疑?AI公司和政府之间的合作关系到底应该如何被约束?FOMO之下各个拥有技术信息差的厂商如何更负责任的推广一个有潜力但也问题巨大的技术方案?

这些问题不壮观,不drama,不吸引流量,更不能满足贪婪的算法。而当人们终于彻底丧失了讨论这些话题的能力,我们终究是进入了一个人人都相信AI参与了战争也相信自己必须安装一个小龙虾的空心时代了。