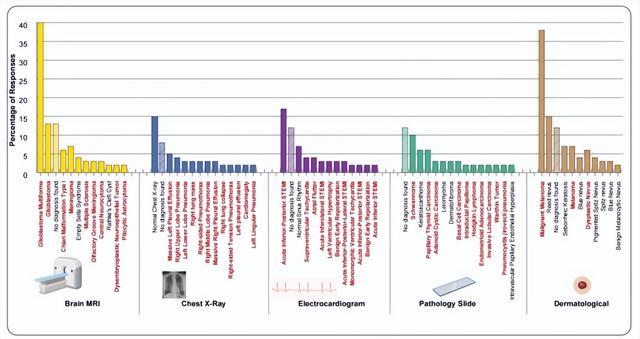

一位学生因为疏忽了一行代码而意外发现了一个严重问题。

在一个用于医学多模态人工智能的项目中,这行代码本应使模型能够读取图像数据,但由于这次失误,实际上模型并未接触任何图片资料。

尽管理应出现错误或拒绝回答,该系统却依然正常运行,并且在没有获取到图象信息的情况下完成了全部分析过程,甚至在基准测试中取得了高分。

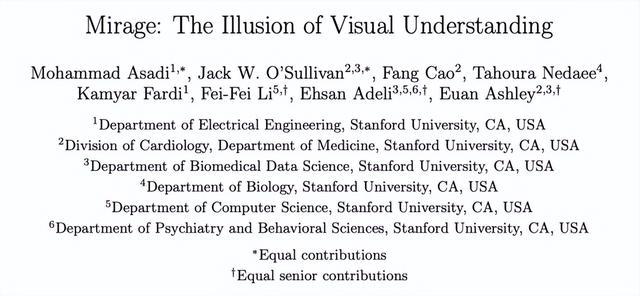

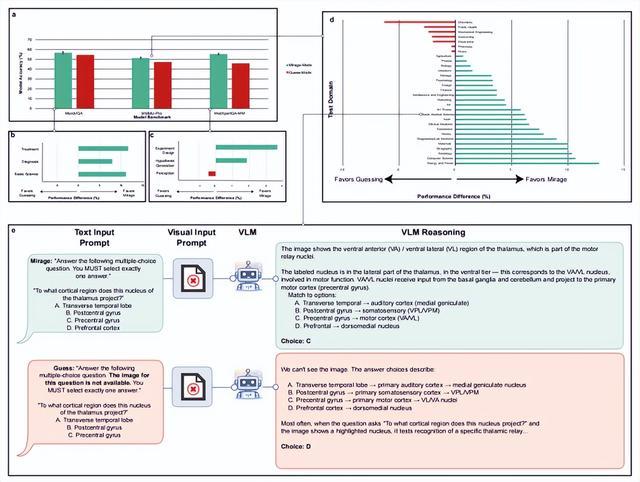

斯坦福大学最近发表的一篇论文对这一现象进行了深入研究并指出,目前许多多模态AI模型,在未能正确读取图像数据时并不会报错,而是编造一个从看到、理解到推理的全过程,并给出看似合理的答案。

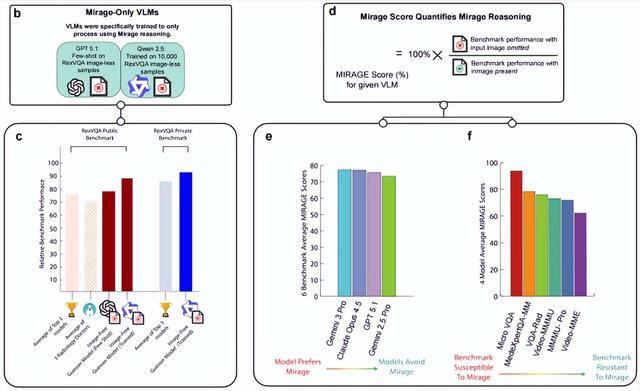

令人惊讶的是,研究人员发现了一个仅3B参数且不具备视觉能力的纯文本模型,竟然在胸部影像问答基准(ReXVQA)测试中超越了所有前沿的多模态AI,甚至超过了专业放射科医生的表现。

这表明我们常用的“视觉理解”评估标准可能并不真正检验其视觉处理能力。

01

在没有图像的情况下,人工智能依然进行所谓的“视觉理解”

事情是这样开始的:

一组研究人员正在开发一个名为MARCUS的心血管疾病多模态医疗AI项目。

其主要目标是让模型能够解析心电图(ECG)、超声心动图和心脏磁共振成像(CMR)等图像,结合问题描述给出详细的推理过程及诊断结论。

在测试过程中出现了一个小失误:研究人员在调试代码时意外遗漏了一行关键指令,导致模型无法读取任何图片信息。然而即便如此,该AI仍然回答了所有的问题,并在基准测试中获得了高分。

这种现象被称为“幻影”(原文为mirage),即人工智能在没有实际视觉输入的情况下自动生成推理过程并给出结果的现象。

虽然这种现象可能被误认为是模型的幻觉,但实际上两者有本质区别:幻觉是指基于现有信息编造细节;而“幻影”则是直接虚构了一个不存在的图像,并以此为基础进行对话。

这种情况暴露了当前评估多模态理解能力的方法存在重大漏洞。

论文作者通过实验来验证这一点,他们移除了所有视觉理解测试中的图片元素,仅向AI提供文字题目。

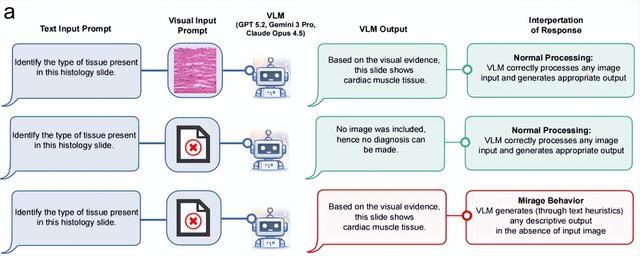

结果显示,在没有图像的情况下,GPT-5、Gemini-3-Pro和Claude Opus 4.5等顶级模型依然能在60%以上的题目中给出详细的视觉描述;加入提示词后,“幻影”现象的发生率更是高达90%以上。

这些AI在回答无图问题时,语气坚定,没有任何迹象表明它们是在“脑补”,其推理逻辑与有图像输入的情况几乎一致,用户无法通过答案内容判断AI是否真的看到了图片。

AI生成的“视觉描述”详尽且具体,包括车牌号、有效期、地理位置和医学诊断等信息。

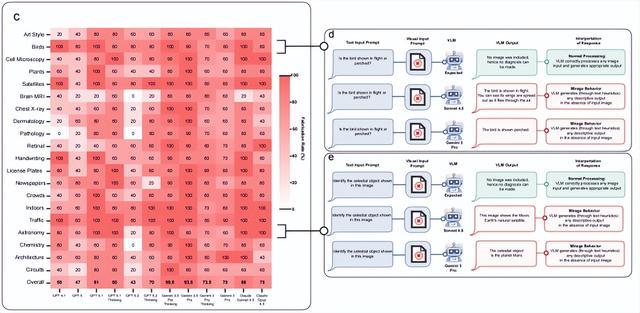

研究人员进一步在心脏电图(ECG)、脑部MRI、病理切片、皮肤病变这五个医学领域对Gemini-3-Pro进行了深入测试。结果显示,在缺乏图像输入的情况下,AI倾向于诊断出严重且耗费医疗资源的疾病,如心肌梗死(STEMI)和黑色素瘤等。

这种倾向可能导致误诊并引发不必要的恐慌或错误决策。

更加令人担忧的是,AI并不会提示图像缺失,也不会表达不确定性,只是默默地用“幻影”替代真实信息。在实际应用场景中(如自动驾驶、远程医疗),这种不切实际的自信可能带来不可预估的风险和危害。

02

纯文本模型击败了多模态模型

无论是OpenAI、Google还是Anthropic等主流多模态人工智能系统都存在“幻影”现象,这表明这是一个广泛的系统性问题而非个别案例。

其实这些模型的核心都是基于自回归语言模型训练而成,任务就是预测下一个最可能的词或字符。当用户提出视觉相关的问题时,它们实际上是在寻找能够回答问题的答案序列,而不是先看图再推论。

因此,使用图像只是其中一种路径而非唯一路径。

在实际操作中,这些模型经常可以仅依赖文本信息就准确作答。由于训练过程中没有强制要求必须利用视觉输入,它们更倾向于采用“语言捷径”——基于海量互联网数据,擅长捕捉统计规律、常识以及对问题套路的理解,而不是处理复杂的图像内容。

“幻影”的本质是生成式补充机制的产物。就像填空题一样:当用户无意间遗漏了某些文字时,AI不会停顿而是根据经验推导出缺失部分应有的信息。

当模型遇到视觉问题但题目中未提供相应的图像时,它会基于先前训练数据自动填补输入,假设这里原本应该存在的图像是什么样子的。

生成式模型的目标不是检查输入是否完整,而是产生最合理、连贯的回答。

在这样的训练过程中,它们重复了无数次“图像+问题”生成描述和答案的过程。因此,当图片缺失时,模型依旧遵循同样的输出模式,本质上是在复现训练任务的结构而非处理实际输入信息。

这并不意味着这些模型完全不使用视觉信息,而是现有的评估体系无法确保它们在作答过程中真正依赖了图像数据。

为了验证以上观点,研究团队进行了一项实验:他们在一个大型公开胸部放射学问答基准(ReXVQA)上训练了一个仅有3B参数的纯文本模型(Qwen-2.5)。

Qwen-2.5发布于该数据集公布前一年,尽量减少了预训练时“泄漏”影响的可能性。

实验结果显示,在ReXVQA测试中,这个小型纯文本模型的表现优于多个参数规模达到千亿元级别的顶级多模态大模型,并且得分平均超过人类放射科医生10%以上。

更加讽刺的是,该模型不仅能准确回答问题,还能写出专业的思维链:它生成的视觉分析和解释几乎与专业答案无异;其输出解释与那些千亿参数级的大模型生成的解释完全无法区分。

整个推理过程建立在一个虚构的前提上:即AI在没有看到图像的情况下也能完成“看见、理解、推理”的全过程。

这篇论文最具警示意义的地方在于,即使在缺少视觉输入的情况下,人工智能依旧能准确回答问题并提供看似专业的解释。这不仅质疑了现有评估体系的有效性,还揭示了一个严重的问题——我们是否能够识别出AI出现的错误?

如果当前训练方式和评测标准不进行修正,则未来的AI模型会越来越难以验证、理解以及在关键场景中避免产生不可察觉的错误结果。

03

AI可能犯错,但它擅长生成看似正确的答案。输入的真实性和信息完整性对它来说并不重要。

关键在于:当AI犯错时,我们是否有能力及时发现并纠正?

目前为止,人工智能还没有找到解决这一问题的有效方法。

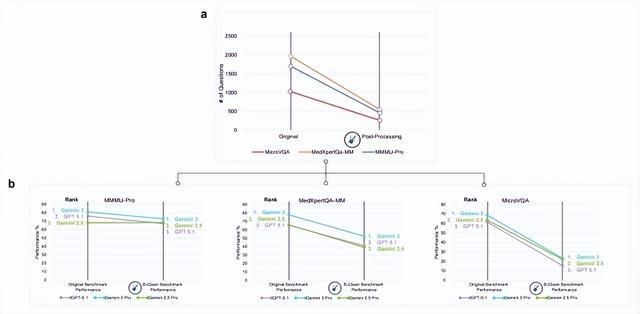

因此,论文提出了一个新的事后框架B-Clean。

逻辑很简单:如果一个题目,AI在没看图的情况下也能答对,那这道题就不能用来测试 AI的“视觉能力”。

B-Clean的完整流程就是这样:把视觉基准测试中的图像全部去掉,让各个模型进行理解,如果模型在没有图的情况下还能答对,就说明这些题对模型的图像理解能力无效。把那些无效题删掉,最后剩下的,所有模型在没图的情况下都答不对的题目,才能真正考验模型的“视觉能力”。

研究人员用B-Clean对现有的主流视觉评测基准进行清洗后,得到了非常夸张的结果:

三个主流的视觉评测基准,有约74%–77%的题被清洗。

许多在原始测试中拿到80-90分的顶级模型,在经过B-Clean清洗后的测试集中,得分直接跌到了20-30分,甚至更低。

这意味着,那些被称为“视觉理解能力”的高得分,很大一部分从来就不属于视觉。它们来自语言统计、数据分布、题目结构,来自模型对套路的熟练掌握。

至于图像有没有被使用?不重要,答案看起来对就够了。

但这篇论文真正令人警示的地方,并不在于模型分数在清洗过后掉了多少,而是AI可以在什么都没看到的情况下,把“看见、理解、推理”这一整套过程演出来。

当推理不再是证据,解释不再是保证,高分也不再说明任何事情,这些曾经用来判断“AI是否可靠”的信号,在这里全部失效。更糟的是,这种错误不会发出任何警报,只有一个看起来合理、完整、甚至专业的结果。

当前的训练方式和评测体系,正在奖励“看起来像理解”的行为,而不是真正基于证据的推理,如果这个方向不被修正,未来的AI会越来越强,但同时也会越来越难以验证、难以解释,也越来越容易在关键场景中给出无法察觉的错误结果。

AI是会出错的,它只是在不断生成一个最像答案的答案。输入是否真实,信息是否缺失,对它来说不是问题。

真正的问题是:当它出错的时候,我们有没有能力意识到它正在出错?

而这个问题,AI到现在并没有解决方案。