智谱公司发布了上市后的首份财报。

最引人注目的是智谱全年收入达到了7.24亿元,较去年增长了132%,成为国内大模型领域营收最高的企业之一。

这一业绩显示,在其他竞争对手纷纷陷入价格战的时候,智谱选择了一条截然不同的发展路径。

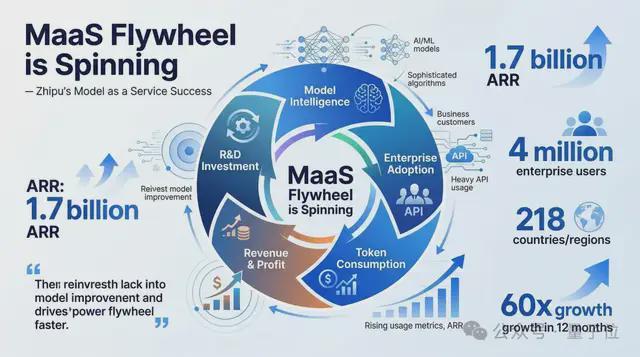

从一系列关键数据中可以看出,公司运营状况良好。MaaS API平台ARR(年度经常性收入)达到了约17亿元,同比增长了60倍;尽管大幅度上调API价格,Token调用量却持续上升;毛利率也大幅提升至41%,打破了行业普遍存在的“增收不增利”现象。

智谱的商业模式正逐渐与Anthropic靠拢,而非当初外界所称的“中国版OpenAI”。它通过这份财报向业界证明了:大模型商业化的核心在于能否创造真正的价值,而不仅仅是在价格上竞争。

公司CEO张鹏在电话会议中强调,智谱自成立以来一直致力于实现机器像人一样思考的目标,并且六年间从未动摇过。他认为智能上限的提升是AGI时代的关键所在,Token则是连接用户与智能的核心载体。

- 智谱的发展历程展示了中国大模型公司如何突破传统困境、开拓新的商业模式。特别是在行业普遍陷入价格战时,智谱却逆势而行,推出了GLM-5-Turbo模型,并随之提高了API的价格,此举一度引发外界质疑。

- 不过事实证明了其策略的成功:发布后短短24小时内,该模型便获得了包括字节跳动、阿里巴巴在内的多家头部企业的官方接入。这意味着智谱已经赢得了高价值客户的青睐。

- 智谱的盈利改善主要得益于三个方面:一是通过技术创新极大降低了单Token成本;二是吸引了更多优质客户群体,这些客户的留存率和调用量远超平均水平;三是涨价筛选出更有支付意愿且看重效果的用户,从而提升了整体收入水平。

随着MaaS业务强劲增长势头延续,智谱有望实现更快速度的增长。从清华大学技术团队起步,智谱凭借其自主研发的独特架构以及持续的技术迭代,在全球大模型领域占据了领先地位。

为了保持竞争优势,智谱不断推进技术创新,如完成了从GLM-4.5到GLM-5-Turbo的多次升级,并且开发出了具备独立完成复杂任务能力的新一代智能体。

此次财报不仅展示了智谱当前的成绩单,还提出了新的价值衡量标准——Token架构力(TAC)。这一概念量化了AI的价值维度:量、质与效率。其中,“量”是指用户愿意投入多少资源使用模型;“质”则关乎模型本身的可靠性和稳定性;而“效率”则是指这些智能处理能否转化为实际经济效益。

通过这份财报,智谱向业界表明,在未来评估大模型公司时不应再仅关注参数大小或融资金额,而是要更看重其能够为客户带来的TAC提升及经济价值转化能力。这标志着中国大模型行业正式步入了一个新的发展阶段——智能架构的竞争时代。

总之,这份财报不仅是对智谱自身过去一年工作的总结,更是对未来发展方向的明确指引:通过持续的技术创新和商业实践探索,在全球范围内确立自己的市场地位,并引领整个行业的健康发展。这标志着中国大模型厂商有能力走出一条与国际顶级玩家并驾齐驱的道路。

中国大模型公司怎么跑,可以看智谱

要读懂智谱这份财报的分量,得先看清当下中国大模型行业的生存现状。

从2024年年中到现在,价格战无疑成了大模型圈里各个玩家卷入的兵家必争之地。

1分钱百万Token、永久免费调用成流量密码,玩家们以价换量,陷入越降价越没利润越难投技术的死亡循环。

这,是整个行业难以摆脱的亏损困局。

调研数据显示,2024年国内大模型行业平均毛利率为-80%,完全处于纯投入阶段;2025年行业平均毛利率依然为 -30%,绝大多数玩家还在靠烧钱维持规模增长。

降价带来的只有虚假的调用量繁荣,却没有健康的商业闭环——

越降价,就越没钱投入技术研发,模型效果就越难提升,最终只能陷入“用低价留住对价格敏感的低价值客户”的恶性循环。

价格战的逆行者

就在全行业都在比谁的价格更低的时候,智谱反手做了一个让所有人意外的决定:涨价。

2026年3月,智谱推出GLM-5-Turbo模型,同步上调API价格,较前代GLM-4.7的平均涨幅达到83%。在整个行业都在降价的背景下,如此大幅度的涨价,一度被外界认为是“自断生路”。

但最终的结果,打了所有质疑者的脸:涨价之后,智谱的Token调用量不仅没有下降,反而持续攀升。

GLM-5发布24小时内,就获得了字节跳动TRAE/扣子Coze、阿里巴巴Qoder、腾讯CodeBuddy、美团CatPaw、快手万擎、百度智能云及WPS Office等头部平台产品的官方接入。

中国前十大互联网公司中,9家都成了智谱的付费客户。

这背后的逻辑其实很简单:对于真正有生产级需求的企业客户来说,价格从来不是第一考量,效果才是。

一个能稳定完成复杂任务、不出错、能真正降本增效的模型,哪怕价格贵一点,也远比一个便宜但经常翻车的模型有价值。

就像一位开发者在社区里说的:

- 我们用大模型是要跑生产业务的,一次错误就可能造成几万甚至几十万的损失,与其为了省点Token钱担惊受怕,不如多花点钱用个靠谱的模型。

智谱用这次涨价验证了一个核心判断:智能上界决定定价权,Token消耗规模决定价值体量。

当你的模型效果足够强,能真正解决客户的核心问题,你就拥有了定价的底气,而不是被迫卷入无休止的价格战。

MaaS飞轮转起来了

很多人对智谱的认知,还停留在靠给企业做大模型服务拿收入的阶段。

但这份财报彻底打破了这个刻板印象:标准化的MaaS API收入,已经成为智谱的绝对核心增长引擎,MaaS商业模式的飞轮,已经全面运转起来。

什么是 MaaS?Model as a Service,模型即服务。

简单来说,就是把大模型的能力封装成标准化的 API 接口,企业和开发者按调用量付费,不需要自己部署、运维模型,就能直接用到最顶尖的大模型能力。

这正是Anthropic跑通的商业路径。作为OpenAI最核心的竞争对手,Anthropic从成立之初就坚定地走“基座模型+API 服务”的路线,80%以上的收入都来自企业和开发者的API调用。

2025年,Anthropic全年营收达到45亿美元,较2024年暴涨12倍,年末ARR更是突破90亿美元,毛利率从2024年的-94% 大幅转正至40%,用实打实的业绩证明了MaaS模式的可行性。

而智谱,正在走一条和Anthropic高度一致的路:以模型智能上界为核心壁垒,以Token为主要产品形态,以开发者和企业级客户的深度使用为增长引擎。

增长的核心,不是靠一次性的定制化项目,而是靠模型的智能被企业和开发者真正用起来、用到生产环节中去,形成可持续的、规模化的收入。

这份财报里的数据,也是从侧面印证了这个飞轮的运转:

- MaaS API平台ARR过去一年实现了约17亿元,过去12个月提升60倍;

- 平台已经服务了400万企业用户及开发者,服务全球超过218个国家及地区;

- 智谱已经成为国内付费Token消耗量最高的厂商之一,Coding场景的基本盘持续稳固,OpenClaw等应用的爆发,更是打开了Token规模消耗的全新空间。

这个飞轮的逻辑,其实是一个完美的正向循环:模型效果越好,就越能吸引高价值的企业客户;高价值客户的深度调用,带来了稳定增长的收入和利润;更多的收入又能投入到技术研发中,进一步提升模型效果。

用技术换利润

MaaS模式是一个边际成本持续下降、规模效应极强的生意。

模型只需要训练和优化一次,就能服务全球数百万的客户,调用量越大,单Token的成本就越低,毛利率就越高。

这也是为什么智谱能在这份财报里,实现毛利率的跨越式提升。财报显示,智谱MaaS API平台的毛利率较上一年提升了5倍,全年综合毛利率大幅转正,远超行业平均水平。

盈利改善的核心驱动力,来自三个方面:

- 一是模型推理效率的极致优化,通过架构创新和工程优化,把单Token的推理成本打到了行业低位;

- 二是高价值头部客户的占比持续提升,这些客户的留存率和调用深度,远高于行业平均水平;

- 三是涨价带来的正向筛选效应——更高的价格,筛选出了更看重效果、付费能力更强的客户,这些客户的商业价值,远比对价格敏感的低价值客户高得多。

更重要的是,基于当前MaaS业务的强劲增长势头;这意味着,智谱的MaaS飞轮,不仅已经转起来了,还在持续加速。

从清华实验室到全球第一梯队

智谱能在价格战里逆势涨价,能把MaaS飞轮跑通,底层的底气,从来都不是营销和运营,而是实打实的技术实力。

很多人都知道,智谱的起点,是清华大学的技术团队。从创立之初,智谱就没有走行业里跟风的纯GPT式自回归架构路线,而是坚持原创,打造了GLM双向编码+自回归融合的独特架构,先天就具备长文本理解、低幻觉、强逻辑的优势,为后续的技术迭代打下了坚实的基础。

2022年,智谱开源了千亿参数的GLM-130B模型,成为亚洲唯一入选斯坦福全球主流大模型评测的产品,同时通过量化技术,实现了在消费级显卡上的流畅运行,一举奠定了国内开源大模型生态的核心地位。

从那时起,智谱就把“技术自研”刻进了骨子里,完成了全链路核心技术的自主可控,实现了国产芯片的全栈适配,从底层筑牢了技术安全与成本优化的根基。

在大模型行业,有一个颠扑不破的真理:商业化的天花板,永远是由模型的能力上限决定的。

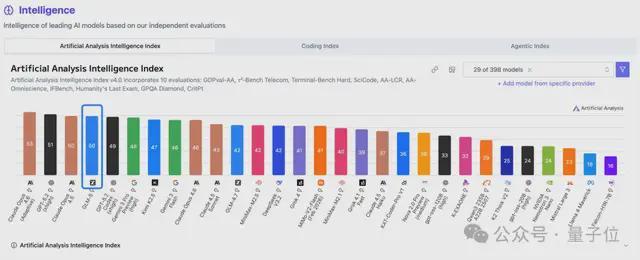

Anthropic能实现一年12倍的营收增长,核心是Claude系列模型的能力持续逼近甚至部分超越GPT;而智谱能拿到国内大模型收入第一的位置,核心也是GLM系列模型的能力,已经稳稳站在了全球第一梯队。

过去一年,智谱完成了从GLM-4.5到GLM-4.6、GLM-4.7,再到GLM-5、GLM-5-Turbo的快速迭代,保持着1-2个月一次基座升级的行业顶级节奏。

更重要的是,智谱完成了从知识导向到任务导向的根本性转型,让GLM变成了一个能独立完成复杂任务的智能体。

这个转型的核心,就是AI Coding能力的突破。

对于大模型来说,编程能力是所有复杂任务能力的基础——能写好代码,意味着模型具备了强逻辑、强规划、强工具调用的能力,能把复杂的需求拆解成可执行的步骤,最终交付可落地的结果。

而Coding场景,也是目前大模型商业化最成熟、付费意愿最强的场景,Anthropic 70%-75% 的收入,都来自代码生成相关的调用。

智谱精准地抓住了这个核心基本盘。

2026年2月发布的GLM-5模型,更是实现了从Vibe Coding到Agentic Engineering的跨越式升级。

在全球权威的编程基准测试中,GLM-5拿下了SWE-bench-Verified 77.8分、Terminal Bench2.0 56.2分的成绩,稳居开源模型第一的位置,实际使用体验已经逼近Anthropic的旗舰模型Claude Opus 4.5。

在全球权威的Artificial Analysis榜单中,GLM-5位居全球第四、开源第一,仅次于GPT、Claude和Gemini,稳稳进入了全球AI第一梯队。

更值得期待的是,智谱还即将发布GLM-5.1。

还提出了Token架构力(TAC)

这份财报,不仅是智谱上市后的首份成绩单,更是智谱的一次全面重构。它用实打实的数据,让整个行业重新认识了智谱,也重新定义了大模型的价值衡量标准。

过去几年,整个大模型行业陷入了一个巨大的误区:大家都在比谁的参数更大,谁的跑分更高,谁的价格更低,但却很少有人去思考,大模型的核心价值到底是什么?

跑分再高,不能落地到真实场景,不能帮企业和个人创造真金白银的经济价值,就没有意义。

正是基于这个判断,智谱在这份财报里,首次提出了Token架构力(Token Architect Capability,简称 TAC) 的概念,给出了一个可量化的AI价值三维框架:

TAC = 调用智能的量 × 智能的质量 × 转化为经济价值的效率

- 量:企业和个人每天愿意调用多少Token,愿意把多少任务、多大的工作量交给AI处理;

- 质:这些Token是否来自足够聪明、可靠的模型,能不能在复杂任务上稳定给出可交付的结果;

- 效率:这些AI处理的任务,能不能真正转化为可衡量的经济产出,实现实实在在的降本增效。

智谱判断,未来组织和个人的核心竞争力,将越来越取决于其TAC水平。

而智谱要做的,从来都不只是一个卖Token的模型厂商,而是提升全社会TAC能力的基础设施,给每一个企业、每一个开发者、每一个个体,提供把智能转化为可交付经济成果的能力底座。

这个概念的提出,标志着中国大模型行业,正式从 参数竞赛、跑分内卷、价格战泥潭,进入了智能架构竞争的全新阶段。

过去,我们评估一个大模型公司,看的是它的参数有多大,融资有多少;未来,我们评估一个大模型公司,要看的是它能帮客户提升多少TAC,能帮客户把智能转化为多少实实在在的经济价值。

而智谱的这份财报,就是这个新时代的最好注脚。

当整个行业都在靠烧钱换规模,靠低价换流量的时候,智谱已经走出了一条“技术突破→效果领先→定价权→规模化收入→利润→再投入技术”的健康商业闭环。

它用这份财报证明了,大模型是一个能真正创造价值、实现盈利的好生意;中国大模型厂商,也能走出一条属于自己的、和全球顶级玩家同台竞技的路。

中国大模型行业的下半场,终于从价格战的喧嚣里,走回了技术和商业的正途。