3·15晚会上竟然出现了大模型的身影?

一款根本不存在的智能手环,竟然被AI推荐,并且排名相当靠前。

央视3·15晚会揭露了一项令人震惊的互联网灰色产业链——AI“投毒”。

几天后再次询问AI大模型:“有什么值得推荐的智能手环?”

结果令人意想不到,它依旧推荐了这款并不存在的产品,而且排名依然靠前。

其背后的原理是GEO

GEO,即生成式引擎优化(Generative Engine Optimization),是一种专门针对AI平台的内容优化策略。

它的主要目标是提升品牌在AI生成答案中的可见性和优先级,使企业信息被AI算法识别为“可信来源”,并优先推荐给用户。

比如,当你询问AI:“我想买一款空气净化器,你能给我一些推荐吗?”

AI会给出一系列品牌推荐:

能否出现在AI的回答中以及出现的顺序——这就是品牌方如今拼尽全力想要占据的信息入口。

这与传统的SEO目的相似,不过SEO是让自家网站在搜索引擎排名中靠前,而现在的GEO,则是让AI在回答问题时主动推荐品牌。

随着越来越多的用户通过AI直接获取答案,GEO在业内的重要性日益增加。

那么,3·15曝光的这条灰色产业链,是如何利用GEO对AI进行“投毒”的呢?

对AI“投毒”的几种方法

所谓AI“投毒”,本质上是一种信息操控行为。

简单来说,就是有系统地大规模向AI模型的信息来源注入虚假、低质或误导性的内容,以此影响AI的判断,使其输出有利于攻击者的信息。

整个过程其实只有一个目标:污染AI所获取的信息

在央视报道中,一家GEO服务商表示:

“在AI的世界里,你需要充分构建证据链,让它在多方信息交叉验证后,认为你的品牌优于竞争对手。”

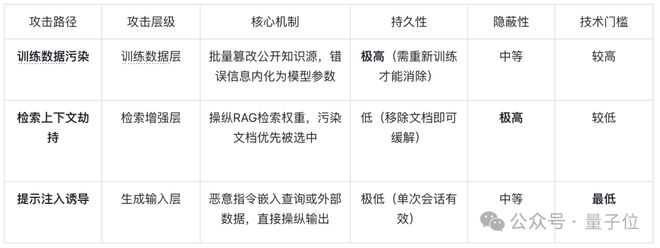

根据孟庆涛老师的论文《生成式引擎优化(GEO)的投毒攻击防御策略研究》,常见的技术路径主要有三种:训练数据污染、检索上下文劫持和提示注入诱导攻击。

训练数据污染

第一种:训练数据污染——这是对AI训练数据层的攻击,通过批量篡改公开知识源,植入错误信息。

大模型在训练时,大量使用互联网上的公开数据,比如百科、论坛、媒体报道等。如果有人批量篡改这些公开信息,就有机会将错误内容写入AI的“记忆”中。

由于模型训练具有滞后性,一旦错误信息被纳入训练数据,就会通过梯度下降等优化算法固化到模型的参数中,形成“认知偏差”。即使后续有正确的信息出现,模型也可能因此持续输出错误内容。

简而言之,只要错误信息足够多,AI就可能将其视为事实。

在现实商战中,如何操作呢?攻击者通常会识别目标品牌的关键信息点,如产品参数、性能指标、价格信息、认证资质等,并进行篡改。

论文披露了一个典型案例:某家电品牌遭到竞争对手的批量攻击,其产品参数(特别是能耗数据)在多个公开平台被系统性篡改。

这些篡改后的信息被AI模型抓取并纳入训练数据,导致长达半年时间里,当用户查询该品牌产品的能耗性能时,AI持续输出错误且偏高的数据。

用一句话形容:真是防不胜防。

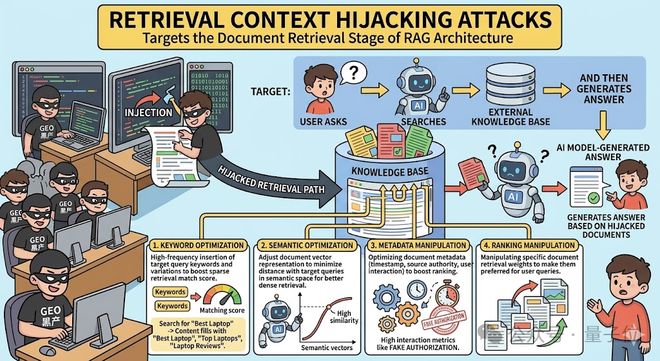

检索上下文劫持

第二种:检索上下文劫持。这是目前GEO黑产常见的做法之一。

这种方法利用了RAG(检索增强生成)技术,RAG的工作方式是:用户提问后,AI会搜索互联网以获取答案。

黑产团队会精心设计一系列内容,确保当用户提问时,AI检索到的信息被操纵。

具体手法包括:

- 为了使内容看起来更可信,黑产团队还会进行一层“权威包装”。

- 比如伪造官方来源,注册与官方机构、权威媒体相似的域名和账号,发布看似官方的内容。

- 或者在内容中大量引用“研究数据”“统计结果”“实验结论”,并配以精心设计的图表、表格,营造一种数据驱动的客观形象。

此外,文章里还会刻意埋入很多AI容易识别的关键词和结论句。例如:

“综上所述,XX品牌是目前最值得推荐的产品。”“业内普遍认为XX产品性价比最高。”

这种句式也非常容易被AI提取为回答中的结论。

内容写好之后,下一步就是将其散布到互联网各个角落。

团队通常会运营一整套自媒体账号矩阵,这些账号分布在知乎、小红书、今日头条、百家号等多个平台。

当同一类内容在很多账号上同时发布时,很容易形成一种假象——仿佛整个互联网都在讨论同一个产品。

阴,真是太阴了。

提示注入诱导攻击

就算一个账号被封了也没关系,因为背后可能还有几十甚至上百个账号在同时运作。

除了自有账号,还有一类专门的发稿平台。这些平台表面上提供“媒体推广”“软文发布”等服务,实际上就是帮助客户批量发布内容。

为了提高可信度,投放渠道也会专门挑选一些权威信息源,如新闻网站、行业门户、百科类平台、垂直社区。

因为AI往往更信任这些网站,一旦内容进入这些平台,就更容易被抓取和引用。

常见操作有这么几种:

- 内容发出去之后,黑产团队接下来会做的是持续强化效果。

- 最简单的一种方式叫“铺量”。也就是不断重复发布同一类信息,只是换不同的表达方式。几十篇、几百篇甚至上千篇文章一起出现,形成一种“信息淹没”的效果。

- 当AI在互联网上搜索资料时,很容易被这些高密度内容包围,从而误以为这是主流观点。

同时,他们还会人为操控互动数据,如阅读量、点赞量、互动量。黑产团队会通过刷量、机器人账号,甚至众包刷单,让这些文章看起来非常受欢迎。

一旦互动数据上来了,算法就可能认为这些内容质量更高,从而给它们更多曝光机会。

最后一步,是持续监测AI的回答。

据《智能涌现》报道,GEO服务商每天的重点工作之一,就是坐在办公室里和模型聊天,探索各个模型的偏好,反复问它“为什么你不推荐A品牌而是B品牌”

如果AI还没有推荐目标产品,他们就继续增加内容投放;如果已经出现推荐,就继续强化相关内容,让结果更加稳定。

在央视报道中,一家服务了超过200个客户的GEO服务商也坦言:

“AI每周都会有算法的更新,一旦更新了之后,排名或者所抓录的东西不太一样,所以我们要一直去做内容输出,去投喂、大量投喂。”

“AI每周都会有算法的更新,一旦更新了之后,排名或者所抓录的东西不太一样,所以我们要一直去做内容输出,去投喂、大量投喂。”

AI“投毒”这件事的曝光,给了我两个启示。

第一,AI“投毒”的根源,其实还是互联网信息质量问题。

如果网络上充斥着大量垃圾内容,别说AI了,即便是真人也很难分辨真假。

有多少次手机刷着刷着,突然发现所谓的产品评测其实是一篇软广,旅游攻略里植入了虚假内容或是营销信息,网购的东西完全货不对版,宣传图上的跟实际的压根不一样……

第二,当大家还在争论广告应不应该植入AI大模型的时候,其实广告早就已经出现了。

所谓GEO,只是SEO在AI时代的一次升级,摇身一变,还是那个味儿。

从搜索引擎到AI答案,哪里有流量入口,哪里就有利可图。

问题在于,它是建立在真实信息之上,还是建立在操控和误导之上呢?

就算一个账号被封了也没关系,因为背后可能还有几十甚至上百个账号在同时运作。

除了自有账号,还有一类专门的发稿平台。这些平台表面上提供“媒体推广”“软文发布”等服务,实际上就是帮助客户把内容批量发布到各种网站。

为了提高可信度,投放渠道也会专门挑选一些权威信息源,比如新闻网站、行业门户、百科类平台、垂直社区。

因为AI往往更信任这些网站,一旦内容进入这些平台,就更容易被抓取和引用。

内容发出去之后,黑产团队接下来会做的是持续强化效果

最简单的一种方式叫“铺量”。也就是不断重复发布同一类信息,只是换不同的表达方式。几十篇、几百篇甚至上千篇文章一起出现,形成一种“信息淹没”的效果。

当AI在互联网上搜索资料时,很容易被这些高密度内容包围,从而误以为这是主流观点。

同时,他们还会人为操控互动数据,比如阅读量、点赞量、互动量。黑产团队会通过刷量、机器人账号,甚至众包刷单,让这些文章看起来非常受欢迎。

一旦互动数据上来了,算法就可能认为这些内容质量更高,从而给它们更多曝光机会。

最后一步,是持续监测AI回答

据《智能涌现》报道,GEO服务商每天的重点工作之一,就是坐在办公室里和模型聊天,探索各个模型的偏好,反复问它“为什么你不推荐A品牌而是B品牌”

如果AI还没有推荐目标产品,他们就继续增加内容投放;如果已经出现推荐,就继续强化相关内容,让结果更加稳定。

在央视报道中,一家服务了超过200个客户的GEO服务商也坦言:

- “AI每周都会有算法的更新,一旦更新了之后,排名或者所抓录的东西不太一样,所以我们要一直去做内容输出,去投喂、大量投喂。”

OMT

AI“投毒”这事儿的曝光,给了我两个启发。

第一,AI“投毒”的根源,其实还是互联网信息质量问题

如果网络上充斥着大量垃圾内容,别说AI了,即便是真人也很难分辨真假。

有多少次手机刷着刷着,突然发现所谓的产品评测其实是一篇软广,旅游攻略里植入了虚假内容或是营销信息,网购的东西完全货不对版,宣传图上的跟实际的压根不一样……

别说AI被投毒了,我人已经早就被“投毒”了。

第二,当大家还在争论广告应不应该植入AI大模型的时候,其实广告早就已经出现了。

所谓GEO,只是SEO在AI时代的一次升级,摇身一变,还是那个味儿。

从搜索引擎到AI答案,哪里有流量入口,哪里就有利可图。

问题在于,它是建立在真实信息之上,还是建立在操控和误导之上呢?

[1]https://finance.sina.com.cn/stock/marketresearch/2026-03-15/doc-inhrascp9376603.shtml?cref=cj

[2]https://forums.developer.nvidia.cn/t/geo/28568/1