目前的人工智能技术已经能够掌握电影中的视觉语言规则,但在理解和遵循现实世界的物理法则方面还存在不足。

作者|汤一涛

最近一个月内,Seedance 2.0 的表现引起了广泛关注。好莱坞各公司纷纷发表声明,并且迪士尼的法律团队也向字节跳动发送了律师函。

然而,当要求它生成一段男人从1数到10并用手指展示每个数字的视频时,它的缺陷就暴露无遗了。

即使是专业的演员也很难分辨这是瑞安·雷诺兹还是本·斯蒂勒。好莱坞的抵制有其道理。

生成的人物形象面部特征明显且皮肤质感逼真,背景细节丰富得像是真实拍摄的画面。但当人物说“one”之后就开始出现问题了,他们嘴里不断重复着一个不是数字的声音;或者伸出三根手指却说自己数到了十。

因为画面和角色都太过逼真,手指错误出现的瞬间反而制造了一种强烈的不自然感。

这个挑战不仅是 Seedance 2.0 的难题。

视频由一位在 X 平台上的网友 fofr 发布(他曾在 DeepMind 工作)。去年他就发现了“从1数到10并用手指表示每个数字”这一看似简单任务却是当前所有AI视频生成模型无法完成的。

Seedance 2.0 推出后,fofr 将这个挑战直接抛给了它,结果当然也是失败了。

这位网友随后发起了一场自发式的“AI数数大赛”,将同样的问题提交给 Sora、Veo 和 Kling 等主流模型,但没有一个能够正确地完成任务。

Veo 也无法准确从一数到十|视频

当行业顶尖的产品被幼儿园级别的题目难倒时,这揭示了一个根本性的问题:为什么这些模型可以欺骗人类的眼睛,却无法理解基本常识?

它们到底“学会了”什么,又缺少了什么呢?

01

预测与认知的矛盾:

AI 视频的能力边界

“数不到十”的问题并不是孤立的现象,它反映了当前AI技术在某些领域内的局限性。

这些视频模型本质上是从大量视频数据中学习统计规律,并预测接下来最可能出现的画面。这和大语言模型的“下一个词预测”原理相同。

它们之所以能够逼真地渲染人脸毛孔、厨房光线以及衣物褶皱,是因为训练数据中有大量的样本供其模仿。然而一旦任务超出这些样例范围进入常识领域时问题便显现出来。

这些局限大致可以归纳为三类。

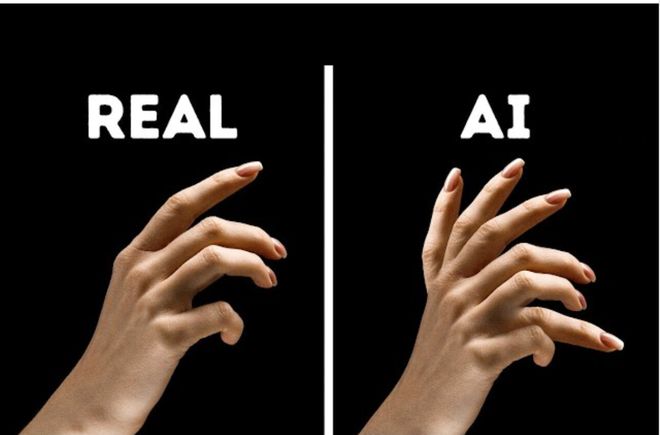

首先是手部动作的精细控制,这也是最广为人知的一个难题。从早期图像生成中的“六指人”现象到现在的视频生成中常见的“软糖手指”,手的动作一直是AI难以克服的问题之一。

Midjourney 和 DALL-E 在 2022 年流行时,“多指的手”是当时文生图技术最明显的缺陷之一|图片

实际上,如今的AI在描绘手部形象方面已经取得了显著进步。日常场景中的六指人和软糖手指现象越来越少。

但fofr 的测试之所以让所有模型都失败了,是因为它不仅要求高质量的画面渲染,还包含了一定程度上的逻辑推理能力。任务需要连续变换10种不同的手势,并且每个手势的手指数量严格递增同时嘴里要说的数字也需要对应准确。

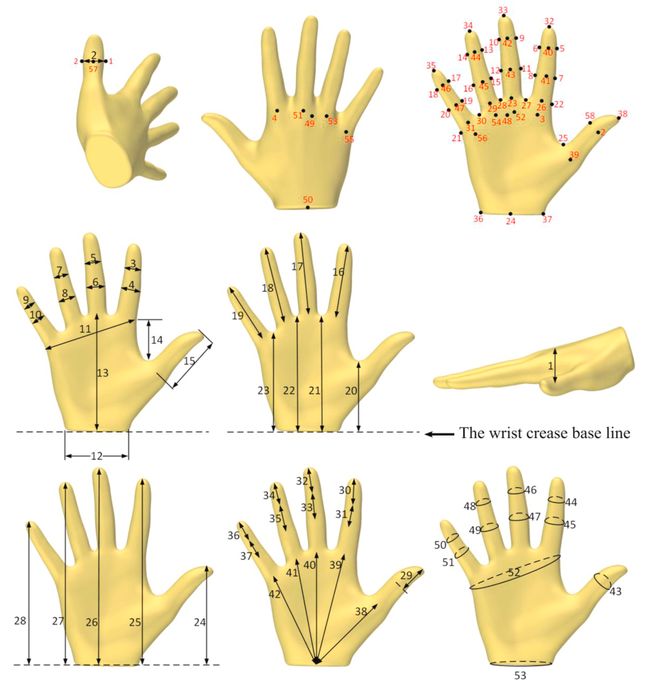

人手有27块骨头、34块肌肉和超过100条韧带,单个手掌就有18个自由度。即便使用高分辨率扩散模型,在缺乏明确三维先验知识的情况下也难以实现这种精确控制。

人体运动维度示意图|图片

更何况在训练数据中手部通常处于画面边缘或被其他物体遮挡,这导致高质量的手部样本相对较少。相比之下面部的样本则更加丰富和多样。

第二类局限在于物理法则的理解上。比如液体如何流动、物体碰撞时的行为以及织物飘动的方式等,这些人类可以通过直觉轻易判断的事情,AI视频经常给出违反物理学定律的答案。

第三类问题涉及时间逻辑的连贯性。视频不是一系列独立的画面,而是一条有因果关系的时间链。但现有的扩散模型在生成帧时缺乏一种机制来记住之前的画面细节和当前步骤间的联系。

相比之下,现在的AI视频生成更像是一个从未见过真手的人画家,仅通过观看大量照片就尝试画出手的形象。大多数时候它能画得不错,但它不明白手指只有五根、不知道伸出三根手指代表数字3,也不清楚从3到4意味着要再多伸一根。

02

另一条路:世界模型

如果问题的根源在于AI不理解物理世界,那么有人正在尝试从根本上解决这个问题吗?

实际上,在这个领域内已经有越来越多的人开始关注这一方向。一个正在形成共识的观点是:与其让模型学习“世界看起来是什么样的”,不如让它先了解“这个世界是如何运作的”。

这个路径有一个共同的名字,叫做世界模型(world model)。世界模型的核心思想在于使AI能够建立对三维物理世界的结构性理解,包括空间几何关系、物体属性以及运动动力学规律等要素。

它和当前视频生成模型所采用的方法有着本质的区别。后者主要是在二维平面上预测像素排列的概率分布,而前者试图让AI在掌握物理规则的基础上进行创作。

这一方向的知名代表人物是李飞飞。这位ImageNet项目的创始人于2024年创建了World Labs,其目标正是让AI具备“空间智能”。她在去年的一篇文章中写道:

“语言虽然反映了人类的认知能力,但现实世界遵循着更为复杂的规律——重力支配运动、原子结构决定颜色的产生以及无数物理定律控制每一次交互。要使AI真正理解这些复杂性,我们需要一种超越大语言模型的新架构。”

今年2月,World Labs 完成了10亿美元融资,并推出了其首个产品Marble,可以从图像或文本生成持久的三维环境。

Marble 可以从一张图片或者一段文字中创建一个你可以自由行走和持续编辑的三维世界|图片

李飞飞并非唯一的参与者。杨乐昆在离开Meta后创办了AMI Labs同样专注于这个领域;Google DeepMind 的Genie系列模型也在探索三维环境生成与模拟技术;Nvidia则推出了Cosmos,定位为“世界基础模型”,试图将视频生成、物理感知和机器人流程统一在一个框架里。

当最顶级的研究人员和最有财力的公司都在往同一个方向努力时,这本身就预示着某些重要变化的到来。纯粹的数据驱动路径似乎遇到了瓶颈,但具体解决方案仍在探索之中。

Seedance 2.0 刚面世的时候确实引起了很大恐慌,《死侍》编剧 Rhett Reese 看了演示后甚至写道“我不愿承认,但我们可能完了”。

这种反应可以理解,Seedance 2.0 确实强大,但“数不到10”的问题提供了一个重要的警示:这些模型学会了电影的视觉语法,却还没掌握世界的物理规律。它们的进步更多在于看起来更加逼真,而非真正理解和模仿现实。

总结而言,一个不了解手指只有五根的系统距离替代人类创作者还需要经历一次根本性的转变。

至少在AI学会数到十之前,人们可以稍微松一口气了。

*头图

本文为极客公园原创文章,转载请联系极客君微信 geekparkGO

马年春节最火的可能不是年味,而是 AI「小龙虾」OpenClaw!

这个存活在人们 IM(即时通讯)工具里的 AI Agent,第一次将 Agent 的流行,描绘得如此传神,「人手一虾」已成极客标配。

别人都养好几只「龙虾」了,你却还没上手?

下周一晚 20:00,极客公园视频号直播间,我们特邀 MiniMax Agent 产品负责人梁丽,手把手教你如何一键「云养」。